1 entropie-capacite theorie de l'information

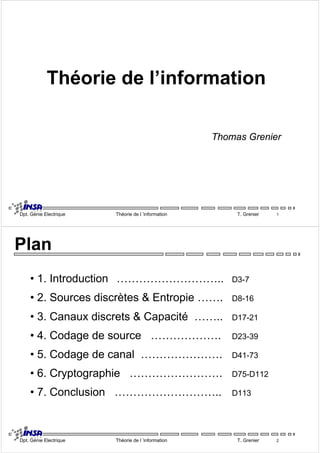

- 1. Théorie de l’information Thomas Grenier Dpt. Génie Electrique Théorie de l ’information T. Grenier 1 Plan • 1. Introduction ……………………….. D3-7 • 2. Sources discrètes & Entropie ……. D8-16 • 3. Canaux discrets & Capacité …….. D17-21 • 4. Codage de source ………………. D23-39 • 5. Codage de canal …………………. D41-73 • 6. Cryptographie ……………………. D75-D112 • 7. Conclusion ……………………….. D113 Dpt. Génie Electrique Théorie de l ’information T. Grenier 2

- 2. 1. Introduction 1948 : Shannon Æ Théorie de l'information Réflexion sur les techniques de communication (XIX°) - Mécanique, accoustique - Ondes radio-électrique - Télégraphe (code morse) - Téléphone, …. Système de communication = Σ fonctions physiques réalisables ª Mauvaise compréhension des perturbations, des débits … Vue d’ensemble d’un système de communication indépendante des moyens techniques & physiques Dpt. Génie Electrique Théorie de l ’information T. Grenier 3 / Ca ne sert à rien ! ☺ 1960 / conquête spatiale Æ codage de source Aujourd'hui à 9GSM Ö codage de source & canal 9TV Num Ö codage de source & canal 9Réseaux Ö codage de canal (erreurs) 9@business Ö cryptage Dpt. Génie Electrique Théorie de l ’information T. Grenier 4

- 3. • Paradigme de Shannon = modèle sys. com. Source = je parle Canal = l'air ambiant Perturbations = bruit sonore Destinataire = tu écoutes Dpt. Génie Electrique Théorie de l ’information T. Grenier 5 • Modèle détaillé 9Th. Signaux Ö décrit messages et perturbations 9Modulation Ö modifie les signaux pour les propager 9Electronique Ö réalise les fonctions 9Th. Information Ö propose une mesure quantitative de l'information et étudie sa représentation, sa transmission, sa dégradation Dpt. Génie Electrique Théorie de l ’information T. Grenier 6

- 4. 9Source : siège d'évènements aléatoires qui constituent le message émis Ö Entropie 9Canal : transmet et dégrade le message Ö Capacité Des messages différents portent la même information, le codage cherche le message avec les meilleures propriétés. 9Codage de source Ö supprime la redondance, réduit le coût 9Codage de canal Ö protège contre les perturbations 9Cryptage Ö protège contre les curieux Deux théorèmes fondamentaux : z Codage de source z Codage de canal Dpt. Génie Electrique Théorie de l ’information T. Grenier 7 2. Sources discrètes & Entropie Sources débitant des messages sous forme discrète ! 9Source discrète d'information : suite de variables aléatoires discrètes X1, X2, … Xn 9Symbole ou lettre : élément fondamental irréductible contenant une information, cad réalisation particulière de la source d'information. 9Mot : succession finie de symboles 9Alphabet : totalité des D lettres [X] = [x1,x2, …., xD] Dpt. Génie Electrique Théorie de l ’information T. Grenier 8

- 5. 9Source discrète sans mémoire : source pour laquelle la probabilité d'apparition d'un symbole ne dépend pas des symboles précédents p ( x / x , x ,...) = p ( x ) in in − 1 in − 2 in 9Source discrète à mémoire : source pour laquelle la probabilité d'apparition d'un symbole dépend du ou des symboles précédents 9Source sationnaire : source pour laquelle les probabilités d'apparition des différents symboles ne dépendent pas de l'origine des temps p ( x ) = p ( x ) ∀ k in in + k 9Source à débit contrôlable : source pouvant générer des messages comme suite à une commande externe (Télégraphe, .) Dpt. Génie Electrique Théorie de l ’information T. Grenier 9 9Source à débit non contrôlable : source générant des messages avec un débit fixé, propriété de la source (CD audio) 9Source discrète à contraintes fixes : source pour laquelle certains symboles ne peuvent être utilisés qu'en des conditions déterminées (Morse, …) 9Source discrète à contraintes probabilistes : source à mémoire. Dans un état, la source peut générer n'importe lequel des symboles avec une probabilité qui dépend des symboles précédents (texte …) 9Source de Markov : source pour laquelle la probabilité de générer un symbole ne dépend que du symbole à l'instant n-1 in in in in in p x x x p x x ( / , ,...) = ( / ) −1 −2 −1 Dpt. Génie Electrique Théorie de l ’information T. Grenier 10

- 6. Quantité d'information & Entropie • Quantité d'information propre Propriété de l'information = imprévisibilité Quantité d'information propre : h ( x ) = f ( 1 p ( x )) Avec f croissante & f(1)=0 2 evt. indépendants apportent la somme de leur quantité d'info ( , ) ( 1 h x h y h x y = f p x y = f p x p y = f + = + ) ( ) ( ) ) ( 1 p y ( ) ) ( 1 ( ). ( ) p x ( ) ) ( 1 ( , ) f f Æ fonction logarithme (Base 2 >> bit) ( ) log( 1 p x h x = p x = − ( )) log( ( )) Dpt. Génie Electrique Théorie de l ’information T. Grenier 11 ( , ) log( 1 h x y = p x y ( , )) ( ) log( 1 h x y = p x y ( )) Règle de Bayes : p(x, y) = p(x y). p( y) = p( y x). p(x) = p( y, x) h(x, y) = h(x y) + h( y) = h( y x) + h(x) = h( y, x) h(x y) = h(x) si x et y indépendants Ex Æ cartes Dpt. Génie Electrique Théorie de l ’information T. Grenier 12

- 7. • Entropie Hyp : source discrète finie stationnaire sans mémoire Emission = variable aléatoire X = ( = ) pour i = 1,2, ..., n i i p p X x 1 n = Σ= 1 i i p Quantité d'information moyenne associée à chaque symbole de la source = entropie n n Σ Σ = = i i H X E h X p p p p ( ) = ( ( )) = .log(1 ) = − .log( ) i i i i 1 1 Dpt. Génie Electrique Théorie de l ’information T. Grenier 13 • Ex : Source binaire p (1) = p p (0) = 1 − p ⎩ ⎨ ⎧ p p p p p .log( ) (1 ). log(1 ) pour 0 1 − − − − < < p 0 si = 0 ou 1 = H X ( ) Dpt. Génie Electrique Théorie de l ’information T. Grenier 14

- 8. • Propriétés de l ’entropie 9Continuité : l'entropie est une fonction continue de chaque variable pi. 9Additivité : de part la définition de l'information propre. 9Positive : 9Bornée : ( ) ( , ,..., ) 0 1 2 = ≥ n H X H p p p ( ) ( 1 , 1 ,..., 1 ) log( n) H X ≤ H = • Redondance n n n ( ) ( ) max R = H X − H X ρ = − H X 1 ( ) max H X ( ) Dpt. Génie Electrique Théorie de l ’information T. Grenier 15 • Entropie & Débit d ’information 9Le débit d'information d'une source est donné par le produit de l'entropie de la source (valeur moyenne de l'info /symbole) par le nombre moyen de symboles par seconde soit : D = H X bits s− X ( ) ( . 1 ) avec τ durée moyenne d' un symbole τ • Source Qaire 9Source Qaire : source S dont l'alphabet possède Q éléments 9kième extension : source Sk dont l'alphabet Qkaire est obtenu en groupant par bloc de k celui de la source S Dpt. Génie Electrique Théorie de l ’information T. Grenier 16

- 9. 3. Canaux discrets & Capacité 9Canal : milieu de transmission de l'information situé entre la source et la destination. Le canal opère une transformation entre l'espace des symboles à l'entrée et celui de la sortie. 9Canal discret : les espaces d'entrée et de sortie sont discrets 9Canal continu : les espaces d'entrée et de sortie sont continus 9Canal sans mémoire : si la transformation d'un symbole x à l'entrée en un symbole y en sortie ne dépend pas des transformations antérieures 9Canal stationnaire : si les transformations ne dépendent pas de l'origine des temps Dpt. Génie Electrique Théorie de l ’information T. Grenier 17 [ ] ⎤ ⎥ ⎥ ⎥ ⎥ ⎦ ⎡ = ⎢ ⎢ ⎢ ⎢ ⎣ m m x y x y ... x y 1 1 1 2 1 x y x y x y 2 1 2 2 2 ... ... x y x y ... x y n n n m X . Y 1 2 [ ] ⎡ = p x y p x y p x y ( , ) ( , ) ... ( , ) 1 1 1 2 1 m p x y p x y p x y ( , ) ( , ) ( , ) 2 1 2 2 2 ... ... n n n m • Probabilités marginales i i j p x p x y ( ) ( , ) j i j p y p x y ( ) ( , ) i x p x p X H Σ= j y p y p Y H Σ= Dpt. Génie Electrique Théorie de l ’information T. Grenier 18 ⎤ ⎥ ⎥ ⎥ ⎥ ⎦ ⎢ ⎢ ⎢ ⎢ ⎣ ( , ) ( , ) ... ( , ) ( , ) 1 2 m p x y p x y p x y P X Y Σ= = m j 1 Σ= = n i 1 ( ) ( ).log( ( )) 1 i n i = − ( ) ( ).log( ( )) 1 j m j = −

- 10. • Entropie réunie ou conjointe n m i j H X Y ΣΣ p x y p x y ( , ) ( , ).log( ( , )) j 1 1 i = = = − • Entropie conditionnelle ou équivoque n m i j H X Y ΣΣ p x y p x y ( / ) ( , ).log( ( / )) j 1 1 i = = = − • Canaux non perturbés H X Y H Y X ( / ) = ( / ) = 0 H X Y H X H Y ( , ) = ( ) = ( ) i j i j • Canaux très perturbés H X Y H X H Y X H Y ( / ) = ( ) et ( / ) = ( ) H ( X , Y ) = H ( X ) + H ( Y ) Dpt. Génie Electrique Théorie de l ’information T. Grenier 19 Transinformation & capacité • Information mutuelle i(x; y) = log( p(x y) p(x)) Æi(x; y) = i( y; x) • Transinformation ) p x y ( , ) i j I X Y ΣΣp x y i j p x p y ( ). ( ) n m ( ; ) ( , ).log( j 1 1 i j i = = = I X Y H X H Y H X Y ( ; ) = ( ) + ( ) − ( , ) I X Y H X H X Y H Y H Y X ( ; ) = ( ) − ( / ) = ( ) − ( / ) Dpt. Génie Electrique Théorie de l ’information T. Grenier 20

- 11. • Capacité d’un canal C = Max (I (X ;Y )) • Redondance d’un canal Rc = C − I (X;Y) • Efficacité d’un canal I X Y η = ( ; ) C c I X Y ρ =1− ( ; ) C Ex Æ canal binaire c Dpt. Génie Electrique Théorie de l ’information T. Grenier 21