Introdução à estimação bayesiana

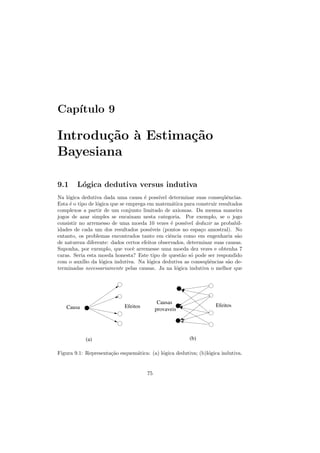

- 1. Cap´ ıtulo 9 Introdu¸˜o ` Estima¸˜o ca a ca Bayesiana 9.1 L´gica dedutiva versus indutiva o Na l´gica dedutiva dada uma causa ´ poss´ determinar suas conseq¨ˆncias. o e ıvel ue Esta ´ o tipo de l´gica que se emprega em matem´tica para construir resultados e o a complexos a partir de um conjunto limitado de axiomas. Da mesma maneira jogos de azar simples se encaixam nesta categoria. Por exemplo, se o jogo consistir no arremesso de uma moeda 10 vezes ´ poss´ e ıvel deduzir as probabil- idades de cada um dos resultados poss´ ıveis (pontos no espa¸o amostral). No c entanto, os problemas encontrados tanto em ciˆncia como em engenharia s˜o e a de natureza diferente: dados certos efeitos observados, determinar suas causas. Suponha, por exemplo, que vocˆ arremesse uma moeda dez vezes e obtenha 7 e caras. Seria esta moeda honesta? Este tipo de quest˜o s´ pode ser respondido a o com o aux´ da l´gica indutiva. Na l´gica dedutiva as conseq¨ˆncias s˜o de- ılio o o ue a terminadas necessariamente pelas causas. Ja na l´gica indutiva o melhor que o Causas Causa Efeitos Efeitos provaveis (a) (b) Figura 9.1: Representa¸ao esquem´tica: (a) l´gica dedutiva; (b)l´gica indutiva. c˜ a o o 75

- 2. 76 CAP´ ¸˜ ` ¸˜ ITULO 9. INTRODUCAO A ESTIMACAO BAYESIANA podemos fazer ´ determinar as causas mais prov´veis baseados nos dados e em e a qualquer informa¸ao a priori que tenhamos a nossa disposi¸ao. Nesta situa¸ao c˜ c˜ c˜ nos reservamos o direito de revisar aquilo que acreditamos prov´vel dependendo a de novas evidˆncias que nos sejam apresentadas. e 9.2 Axiomas de Cox revisitados Os Axiomas de Cox foram discutidos no cap´ ıtulo 2 e podem ser traduzidos em propriedades de probabilidades. Estes axiomas e as respectivas equa¸oesc˜ relacionando probabilidades s˜o: a Axioma 1. A probabilidade de uma inferˆncia dada determinada evidˆncia e e determina a probabilidade da seu oposto dada a mesma evidˆncia. Assim, a e probabilidade de chover dado que o c´u est´ nublado determina a probabilidade e a de n˜o chover dado que o c´u est´ nublado. a e a ¯ P (X|I) + P (X|I) = 1. (9.1) Axioma 2. A probabilidade de que duas inferˆncias (X e Y) sejam si- e multaneamente verdadeiras dada certa evidˆncia (I) ´ determinada pela proba- e e bilidade de que X seja verdadeira dada I e, separadamente, pela probabilidade de Y ser verdadeira dada I e X. Por exemplo, a probabilidade do Brasil ser hexacampe˜o na Alemanha e Adriano ser o artilheiro, dada a experiˆncia que a e temos em assistir jogos da sele¸ao, ´ determinada pela probabilidade do Brasil c˜ e ser hexa, dados os jogos que assistimos, e pela probabilidade de Adriano ser o a ´ artilheiro, dados os jogos que assistimos e se o Brasil for hexacampe˜o. E claro que o evento composto s´ pode ocorrer se, pelo menos, o Brasil for primeiro o hexacampe˜o.a P (X, Y |I) = P (X|Y, I)P (Y |I). (9.2) Como corol´rios imediatos dos axiomas de Cox temos o, tamb´m j´ apre- a e a sentados, Teorema de Bayes: P (Y |X, I)P (X|I) P (X|Y, I) = , (9.3) P (Y |I) e a propriedade de marginaliza¸ao: c˜ P (X|I) = dy P (X, y|I). (9.4) O teorema de Bayes resume o procedimento assumido para an´lise de dados a da seguinte maneira: P (Hipotese|Dados, I) ∝ P (Dados|Hipotese, I)P (Hipotese|I). (9.5) O termo P (Hipotese|I) ´ conhecido como probabilidade a priori e designa o e cren¸a que temos na veracidade da hip´tese antes de examinarmos os dados. c o

- 3. ´ 9.3. UM POUCO DE HISTORIA 77 P(M|O,I) m1 m2 Massa de Saturno Figura 9.2: Representa¸ao esquem´tica do resultado da an´lise de Laplace para c˜ a a a massa de Saturno. O termo P (Dados|Hipotese, I) ´ conhecido por verossimilhan¸a (no inglˆs like- e c e lihood) e expressa o qu˜o bem a hip´tese escolhida ´ capaz de reproduzir os a o e dados observados. Finalmente, o termo P (Hipotese|Dados, I) ´ a probabilidade e posterior e indica a nossa cren¸a na hip´tese ap´s a an´lise dos dados. Note que c o o a todos os termos carregam dependˆncia condicional na informa¸ao dispon´ I. e c˜ ıvel Em estat´ıstica Bayesiana todas as probabilidades s˜o condicionais. a 9.3 Um pouco de hist´ria o James Bernoulli (1713) foi, possivelmente, o primeiro a notar a diferen¸a entre a c l´gica dedutiva utilizada em matem´tica e na an´lise dos jogos de azar e a l´gica o a a o indutiva empregada na maioria dos problemas do dia a dia. Para ele a quest˜o a importante era como a l´gica dedutiva, bem conhecida desde Arist´teles, pode- o o ria ser utilizada para ajudar a resolver os problemas que exigissem racioc´ ınio indutivo. A primeira resposta aos questionamentos de Bernoulli surgiram com o Reverendo Thomas Bayes em um artigo publicado postumamente por um amigo. No entanto, a forma moderna do teorema somente nasceu em 1812 com Laplace, que redescobriu por conta pr´pria a id´ia de Bayes e a utilizou com enorme o e sucesso para resolver problemas em mecˆnica celeste, medicina e at´ mesmo ju- a e e ´ risprudˆncia. E poss´ dizer com tranquilidade que a inferˆncia bayesiana foi ıvel e descoberta e utilizada em situa¸oes pr´ticas antes da inferˆncia cl´ssica. Ape- c˜ a e a sar dos in´meros sucessos obtidos por Laplace, esta forma de inferˆncia passou a u e ser ignorada a partir da metade do s´culo dezenove por decis˜o de matem´ticos e a a que assumiram o desenvolvimento do tema. Esta decis˜o foi motivada pela a cren¸a de que n˜o seria poss´ desenvolver-se uma teoria matem´tica rigorosa c a ıvel a sobre probabilidades que representassem graus de cren¸a, intrinsecamente sub- c jetivos, como sustentavam os Bernoullis, Bayes e Laplace. Estes matem´ticos a optaram por definir probabilidades como a freq¨ˆncia relativa de ocorrˆncia do ue e

- 4. 78 CAP´ ¸˜ ` ¸˜ ITULO 9. INTRODUCAO A ESTIMACAO BAYESIANA evento no limite de infinitas repeti¸oes do experimento. Apesar desta defini¸ao c˜ c˜ de probabilidade parecer mais objetiva, ela tamb´m ´ mais limitada nas suas e e aplica¸oes. Por exemplo, Laplace utilizou a teoria de probabilidades (bayesiana) c˜ para estimar a massa de Saturno, dada informa¸ao orbital dispon´ em v´rios c˜ ıvel a observat´rios astronˆmicos. Essencialmente, Laplace calculou a probabilidade o o posterior da massa M dados os dados de orbitas O e toda informa¸ao dispon´ ´ c˜ ıvel I (as leis da mecˆnica como o melhor exemplo desta informa¸ao) P (M |O, I) (ex- a c˜ ibida na figura). Para Laplace a area sob a curva entre m1 e m2 representava sua cren¸a em um ´ c valor de massa em m1 ≤ M ≤ m2 dados a informa¸ao dispon´ (observa¸oes e c˜ ıvel c˜ leis f´ ısicas). Assim sendo o m´ximo do posterior representa a melhor estimativa a e sua largura representa a incerteza relacionada. Laplace completou sua an´lise a dizendo: “´ uma aposta de 11000 para 1 que o erro no resultado n˜o seja de um e a cent´simo de seu valor”. Laplace teria ganhado a aposta, visto que 150 anos de e dados s´ modificaram sua estimativa em 0, 63%. o 9.4 Estima¸˜o de parˆmetros ca a O problema que Laplace buscou resolver consistia na obten¸ao de um unico c˜ ´ parˆmetro a partir de nosso conhecimento pr´vio e dos dados. Nesta se¸ao detal- a e c˜ haremso o procedimento bayesiano em situa¸oes nas quais apenas um parˆmetro c˜ a est´ envolvido. a 9.4.1 Uma moeda ´ honesta? e Suponha que vocˆ esteve em Las Vegas nas f´rias e l´ tenha encontrado uma e e a moeda que achou muito estranha: ao arremessala 11 vezes, obteve 4 Caras. Seria esta moeda honesta? Por honesta entendemos uma moeda na qual vocˆ estaria e disposto a apostar 50 contra 50 em uma cara ou coroa. Em princ´ ıpio podemos descrever a propriedade de honestidade da moeda com pesos, H = 0 represen- taria uma moeda que apenas desse como resultado Coroa, H = 1 representaria uma moeda que apenas desse como resultado Cara. Uma moeda honesta cor- responderia, portanto, a H = 0, 5. Poder´ ıamos assim formular proposi¸oes do c˜ tipo: (a) 0 ≤ H ≤ 0, 01; (b) 0.01 ≤ H ≤ 0, 02 ou (c) 0.02 ≤ H < 0.03. Nosso estado de conhecimento sobre a honestidade da moeda pode, portanto, ser resumido na especifica¸ao de quanto n´s acreditamos na veracidade de c˜ o cada proposi¸ao. Se n´s associamos uma probabilidade alta a uma particu- c˜ o lar proposi¸ao isso ir´ refletir nosso grau de confian¸a nessa proposi¸ao. O que c˜ a c c˜ desejamos ´ calcular o posterior p(H|D, I) onde D s˜o os resultados observados. e a Pelo teorema de Bayes temos que: p(H|D, I) ∝ p(D|H, I)p(H|I). (9.6) Nosso conhecimento a priori consiste na observa¸ao de que encontramos uma c˜ moeda que consideramos muito estranha em Las Vegas. Como sabemos que os cassinos n˜o s˜o os lugares mais confi´veis do mundo em se tratando de jogos, a a a

- 5. ¸˜ ˆ 9.4. ESTIMACAO DE PARAMETROS 79 1 0.8 0.6 P(H|D,I) 0.4 0.2 0 0 0.2 0.4 0.6 0.8 1 H Figura 9.3: Posterior para a moeda que exibiu 4 caras em 11 arremessos. devemos manter a mente aberta sobre o grau de honestidade da moeda. Para isso introduzimos uma distribui¸ao a priori uniforme: c˜ 1 , se 0 ≤ H ≤ 1; p(H|I) = (9.7) 0 , c.c. Esta distribui¸ao a priori uniforme expressa um estado de completa ig- c˜ norˆncia. Os resultados dos lan¸amentos D ir˜o modificar nosso estado inicial a c a de completa ignorˆncia. Para sabermos como se dar´ este processo de modi- a a fica¸ao precisamos avaliar a verossimilhan¸a p(D|H, I). A verossimilhan¸a ir´ c˜ c c a depender de nosso modelo para uma moeda com uma dada honestidade H. Se assumirmos que os lan¸amentos s˜o independentes, poderemos imaginar que c a uma seq¨ˆncia particular D ´ resultado de um processo de Bernoulli com prob- ue e abilidade H de resultar em Cara e com probabilidade 1 − H de resultar em Coroa. Dessa maneira a verossimilhan¸a de uma seq¨ˆncia D com r Caras em c ue um total de N lan¸amentos seria descrita por: c p(D|H, I) ∝ H r (1 − H)N −r . (9.8) Note que para o nosso uso a constante de normaliza¸ao do modelo binomial ser´ c˜ a irrelevante (por que?). Finalmente, obtemos a distribui¸ao posterior de nosso c˜ interesse como: p(H|D, I) ∝ H r (1 − H)N −r . (9.9) O posterior ´ exibido na figura. Note que o m´ximo do posterior esta situado e a em 0.27 = 3/11, que ´ justamente a probabilidade emp´ e ırica que esperar´ ıamos. Vejamos agora o problema de uma outra maneira. Inicialmente nosso estado era de completa ignorˆncia. Suponha que tivessemos jogado a moeda uma unica a ´ vez, qual seria nosso estado de conhecimento ap´s observarmos uma Cara em o um unico lan¸amento? E ap´s dois lan¸amentos resultando em duas Caras? A ´ c o c figura mostra a evolu¸ao de nossa cren¸a ap´s estes dois resultados. Note que, c˜ c o

- 6. 80 CAP´ ¸˜ ` ¸˜ ITULO 9. INTRODUCAO A ESTIMACAO BAYESIANA 2 P(H|I) 1 0 0 0.2 0.4 0.6 0.8 1 1 P(H|D,I) 0.5 0 0 0.2 0.4 0.6 0.8 1 1 P(H|D,I) 0.5 0 0 0.2 0.4 0.6 0.8 1 H Figura 9.4: Topo: Distribui¸ao a priori. Meio: Posterior ap´s uma Cara. Baixo: c˜ o Posterior ap´s 2 caras. o ap´s duas Caras seguidas, tendemos a acreditar que a moeda seja viciada para o o lado das Caras. Isso mudaria caso os pr´ximos lan¸amentos exibissem Coroas e o c Caras de forma mais equitativa. Podemos visulaizar o Teorema de Bayes como um procedimento iterativo de atualiza¸ao a cada nova observa¸ao, assim: c˜ c˜ p(Ht |Dt , I) ∝ H δ(xt ;Cara) (1 − H)1−δ(xt ;Cara) p(Ht−1 |Dt−1 , I), (9.10) onde δ(xt ; Cara) = 1 se xt = Cara e δ(xt ; Cara) = 0 se xt = Coroa. Na pr´xima figura mostramos a evolu¸ao do posterior no caso de uma sim- o c˜ ula¸ao de uma moeda justa. c˜ Mas o que ocorreria se partissemos de uma distribui¸ao a priori diferente? c˜ Suponhamos, por exemplo, que acreditemos que a moeda seja enviesada ou para o lado da Cara ou para o lado da Coroa. Para representarmos tal vi´s e escolhemos um a priori com picos em H = 0 e H = 1 (vide figura). Note que ap´s um n´mero suficientemente grande de observa¸oes o efeito da probabilidade o u c˜ a priori ´ eliminado. Isso ´ compat´ com a mudan¸a em nossa cren¸a em um e e ıvel c c vi´s ap´s obtermos evidˆncia experimental suficiente. e o e 9.5 Intervalos de Confian¸a c No m´ximo da desnsidade posterior p(M | O, I) estimativa de maior probabil- a idade M0 , dados o conjunto de observa¸oes O e a informa¸ao extra I, assim, c˜ c˜ temos a seguinte caracteriza¸ao para M0 : c˜ dp =0 (9.11) dM M0 e d2 p < 0. (9.12) dM 2 M0

- 7. 9.5. INTERVALOS DE CONFIANCA ¸ 81 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 H Figura 9.5: Simula¸ao de uma moeda honesta. De cima para baixo: ap´s 5, 10, c˜ o 100, 500 e 1000 lan¸amentos. c 1 0.9 0.8 P(H|I) 0.7 0.6 0.5 0.4 0 0.2 0.4 0.6 0.8 1 H Figura 9.6: Prior representado nossa cren¸a em um forte vi´s. c e

- 8. 82 CAP´ ¸˜ ` ¸˜ ITULO 9. INTRODUCAO A ESTIMACAO BAYESIANA 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 1 0.5 0 0 0.2 0.4 0.6 0.8 1 H Figura 9.7: A utiliza¸ao do prior considerando forte vi´s apenas modifica o c˜ e posterior nas primeiras jogadas. Ap´s um n´mero suficiente de observa¸oes nos o u c˜ convencemos de que a moeda na realidade n˜o possui o vi´s pressuposto. a e Equivalentemente podemos utilizar a fun¸ao L(M ) = log p(M | O, I). Al´m da c˜ e estimativa do valor mais prov´vel para M , queremos conhecer a incerteza desta a estimativa. Esta incerteza est´ relacionada a largura do posterior, conforme a ` representa a figura. Assim um intervalo de confian¸a com probabilidade α ´ c e definido como o intervalo de menor amplitude que contenha a estimativa M 0 de tal forma que: m2 P (m1 ≤ M ≤ m2 ) = dm p(m | O, I) = α. (9.13) m1 Podemos avaliar o intervalo de confian¸a numericamente utilizando (??) di- c retamente. Podemos tamb´m buscar uma aproxima¸ao que permita o c´lculo e c˜ a anal´ıtico deste intervalo. Para isso podemos expandir L(M ) em uma s´rie de e Taylor em torno do m´ximo e aproximarmos o posterior por uma distribui¸ao a c˜ normal cuja largura ´ definida simplesmente pelo desvio padr˜o σ. Dessa e a maneira teremos: 1 d2 L L(M ) ≈ L(M0 ) + (M − M0 )2 . (9.14) 2 dM 2 M0 A aproxima¸ao para o posterior ser´, portanto: c˜ a 1 d2 L p(M |O, I) ≈ A exp (M − M0 )2 , (9.15) 2 dM 2 M0 que podemos relacionar a distribui¸ao normal adotando: ` c˜ −1/2 1 d2 L σ= − . (9.16) 2 dM 2 M0 ˆ Dessa forma uma estimativa com 67% de confian¸a seria dada por M = M0 ± σ, c com 95% de confina¸a ter´ c ˆ ıamos M = M0 ± 2σ.

- 9. 9.6. EXERC´ ICIOS 83 P(M|O,I) m1 M0 m2 Figura 9.8: Representa¸ao para o intervalo de confian¸a da estimativa do c˜ c parˆmetro M . a 9.5.1 Exemplo 1: Estimando a honestidade de uma moeda Se assumirmos independˆncia entre diferentes lan¸amentos da moeda e uma e c distribui¸ao a priori representando ignorˆncia teremos a seguinte distribui¸ao c˜ a c˜ posterior: p(H|D, I) ∝ H r (1 − H)N −r . (9.17) Assim teremos que: L(H) = constante + r log(H) + (N − r) log(1 − H). (9.18) A estimativa de H ´ dada pelo m´ximo de L(H), definido por: e a dL r N −r = − = 0. (9.19) dH H0 H0 1 − H0 O que resulta em r H0 = . N A barra de erro para esta estimativa ser´ dada na aproxima¸ao normal por: a c˜ −1/2 1 d2 L H0 (1 − H0 ) σ= − = . (9.20) 2 dH 2 H0 N Dessa maneira a estimativa com intervalo de confian¸a de, por exemplo, 95% c a ˆ ser´ H = H0 ± 2σ. Note que o enfoque bayesiano permite que reobtamos o resultado cl´ssico sem necessidade de descri¸ao de distribui¸oes amostrais. a c˜ c˜ 9.6 Exerc´ ıcios Estima¸ao da m´dia de dados com erro de medida gaussianos. Estime a m´dia c˜ e e de um conjunto de N medidas independentes com erros distribuios de forma normal com desvio padr˜o conhecido σ. a

- 10. 84 CAP´ ¸˜ ` ¸˜ ITULO 9. INTRODUCAO A ESTIMACAO BAYESIANA 1. Escreva a distribui¸ao normal que descreve cada medida xk em torno da c˜ m´dia µ. e 2. Escreva a fun¸ao de verossimilhan¸a para o conjunto de N medidas lem- c˜ c brando que a propriedade de independˆncia implica em e N p(xk | µ, σ, I) = p(xk | µ, σ, I). k=1 3. Escreva o teorema de Bayes para obten¸ao do posterior p(µ | xk , σ, I). c˜ Assuma a seguinte distribui¸ao a priori c˜ A , se µmin ≤ µ ≤ µmax ; p(µ|σ, I) = 0 , c.c. 4. Calcule o log-posterior L(µ) = log p(µ|σ, I). 5. Encontre a estimativa µ calculando o ponto de m´ximo do log-posterior. ˆ a Mostre que esta estimativa ´ e N 1 µ0 = xk . N k=1 6. Encontre a barra de erro aproximada s para a estimativa µ calculando a ˆ segunda derivada do log-posterior. Mostre que σ s= √ . N 9.7 Referˆncias e Um excelente livro sobre a an´lise de dados bayesiana ´: a e • Sivia, D.S., Data Analysis: A Bayesian Tutorial, Claredon Press, 1997. Sobre os axiomas de Cox e t´picos avan¸ados veja: o c • Cox,R., The Algebra of Probable Inference, John Hopkins Press, 1961. • Jaynes, E.T., Probability Theory: The Logic of Science, Cambridge Uni- versity Press, 2003.