Di 7.analytic hierarchy process @111010 (barchiesi)

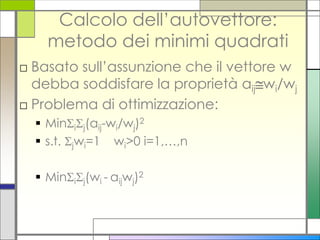

- 1. Calcolo dell’autovettore: metodo dei minimi quadrati □ Basato sull’assunzione che il vettore w debba soddisfare la proprietà aijwi/wj □ Problema di ottimizzazione: Minij(aij-wi/wj)2 s.t. jwi=1 wi>0 i=1,…,n Minij(wi - aijwj)2

- 2. Algoritmo 1. matrice dei confronti a coppie A 2. si stabilisce piccolo a piacere 3. si calcola il vettore dei pesi locali sommando i valori sulla riga e normalizzando 4. si determina il quadrato della matrice 5. si calcola il vettore dei pesi locali sommando i valori sulla riga e normalizzando 6. si calcola la variazione (differenza) tra i vettori normalizzati, se minore di stop altrimenti passo 7. 7. si torna al passo 4. finché la variazione nel risultato prodotto dall’algoritmo non diviene minore di

- 3. Esempio 1 - 1 1 1 2 1 2 1/2 1 2 a A 1 1 3 a 1/3 2 1/a 1 1 3 1 a 3 3 1

- 4. Esempio 1 - 2 □ Quando A è consistente: 3 6 18 9 18 54 A 1,5 3 9 2 A 4,5 9 27 3 0,5 1 3 1,5 3 9

- 5. Hard Data □ Le priorità possono essere derivate dai dati così come dai confronti a coppie □ Quando sono disponibili dei dati sulle alternative è ragionevole ipotizzare relazioni lineari o inversamente proporzionali □ La tentazione di derivare le preferenze dai dati è fortissima.

- 6. Giudizi mancanti - 1 □ Si possono avere meno di n(n-1)/2 giudizi nelle matrici dei confronti a coppie per i seguenti motivi: □ per ridurre il tempo nell’esprimere i giudizi; □ a causa di una riluttanza nel fare una comparazione diretta tra due particolari elementi; □ perché si è insicuri su alcuni confronti.

- 7. Giudizi mancanti - 2 □ Esistono dei metodi per gestire la carenza di giudizi. □ Tali metodi sono utili per ridurre l’inconsistenza delle matrici: se un giudizio, a seguito di un’ispezione manuale o attraverso un algoritmo computerizzato, sembra errato si può considerare mancante.

- 8. Matrici quasi-reciproche □ Possono essere presenti dei coefficienti nulli □ aij=aji=0 per alcuni valori di i e j con i≠j □ Data una matrice A quasi-reciproca si può ricavare una nuova matrice B nella quale i coefficienti che non appartengono alla diagonale principale coincidono con quelli di A, mentre i coefficienti della diagonale, che nella matrice A sono uguali a 1, assumono in B il valore mi, essendo mi il numero di coefficienti nulli presenti nella riga i-sima di A.

- 9. Matrici incomplete – metodo di Harker □ mi rappresenta il numero di confronti non effettuati nei quali è coinvolto l’elemento i □ Harker ha dimostrato che le componenti dell’autovettore principale della matrice B costituiscono delle stime corrette dei pesi degli elementi confrontati □ Il metodo è rilevante nei casi in cui gli elementi da confrontare sono molti, perché al crescere del numero di confronti risulta più difficile mantenere la coerenza nei giudizi □ La scelta del numero di confronti da effettuare implica un trade-off tra affidabilità del risultato e tempo che il decisore è disposto a spendere per la valutazione.

- 10. Matrice di sintesi □ Quando i decisori sono più di uno: □ si analizza la consistenza di tutte le matrici raccolte □ si torna dai decisori se l’inconsistenza non è accettabile □ se i giudizi non sono troppo dispersi attorno alla media geometrica si calcola la matrice di sintesi (tramite la media geometrica per preservare la reciprocità) □ si valuta la consistenza della matrice di sintesi □ se i giudizi sono troppo dispersi si riportano i decisori sull’albero □ L’obiettivo è ottenere il “consenso” sui giudizi

- 11. Sintesi gerarchica □ Calcolati i pesi locali di tutti gli elementi dell’albero si può procedere al calcolo dei pesi globali □ I pesi locali di ogni elemento vengono moltiplicati per il peso globale dell’elemento “padre” □ Procedendo con una logica top-down (sintesi gerarchica) si trasformano tutti i pesi locali in pesi globali

- 12. I pesi globali □ I pesi globali degli elementi alla base dell’albero rappresentano il risultato principale della valutazione □ I pesi globali consentono di valutare tutte le alternative rispetto all’obiettivo generale □ L’alternativa con il ranking più alto è quella preferita

- 13. □ L’AHP non rispetta l’assioma dell’indipendenza dalle alternative irrilevanti del teorema di Arrow

- 14. Esercitazione □ Appello 23 febbraio 2010