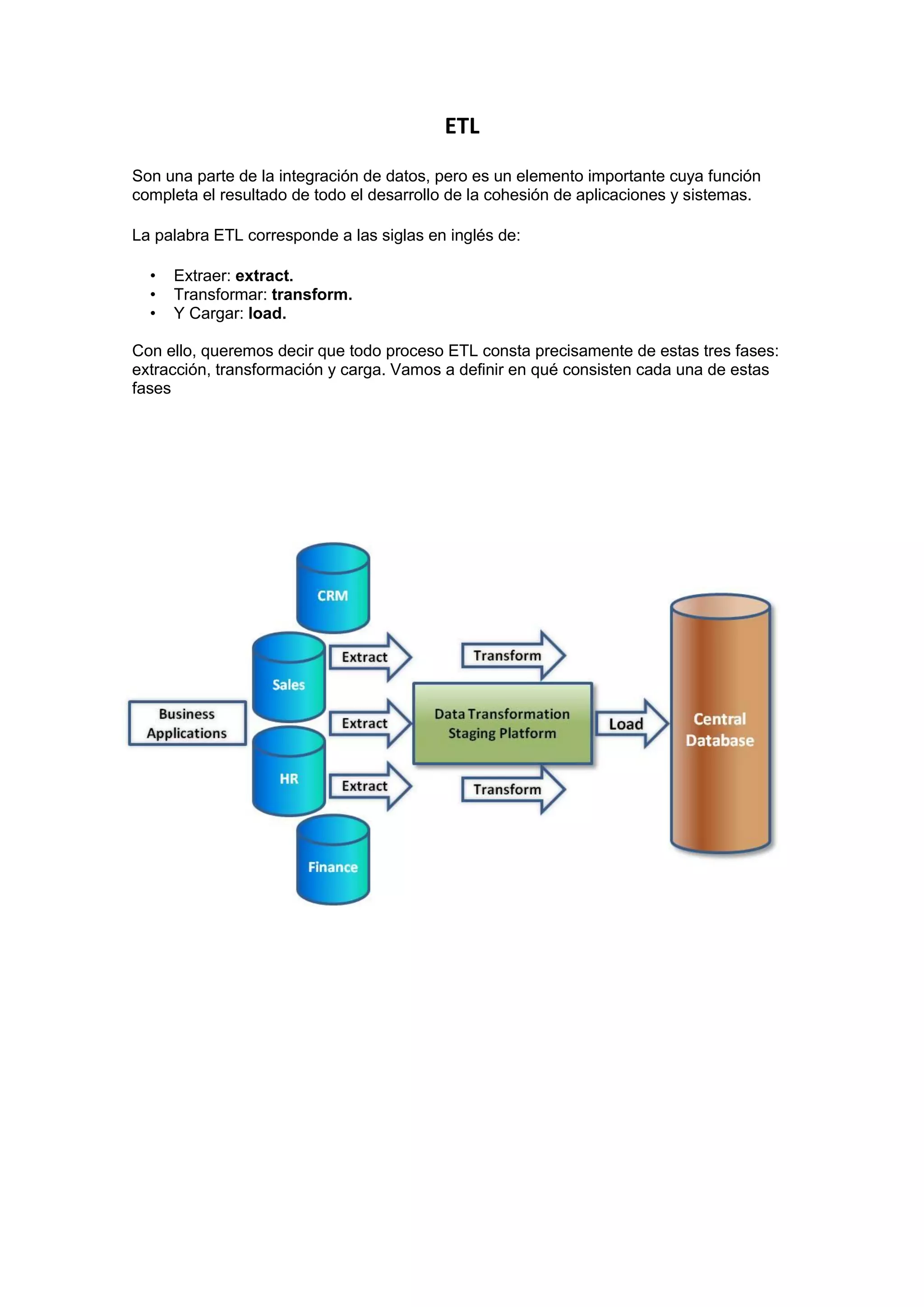

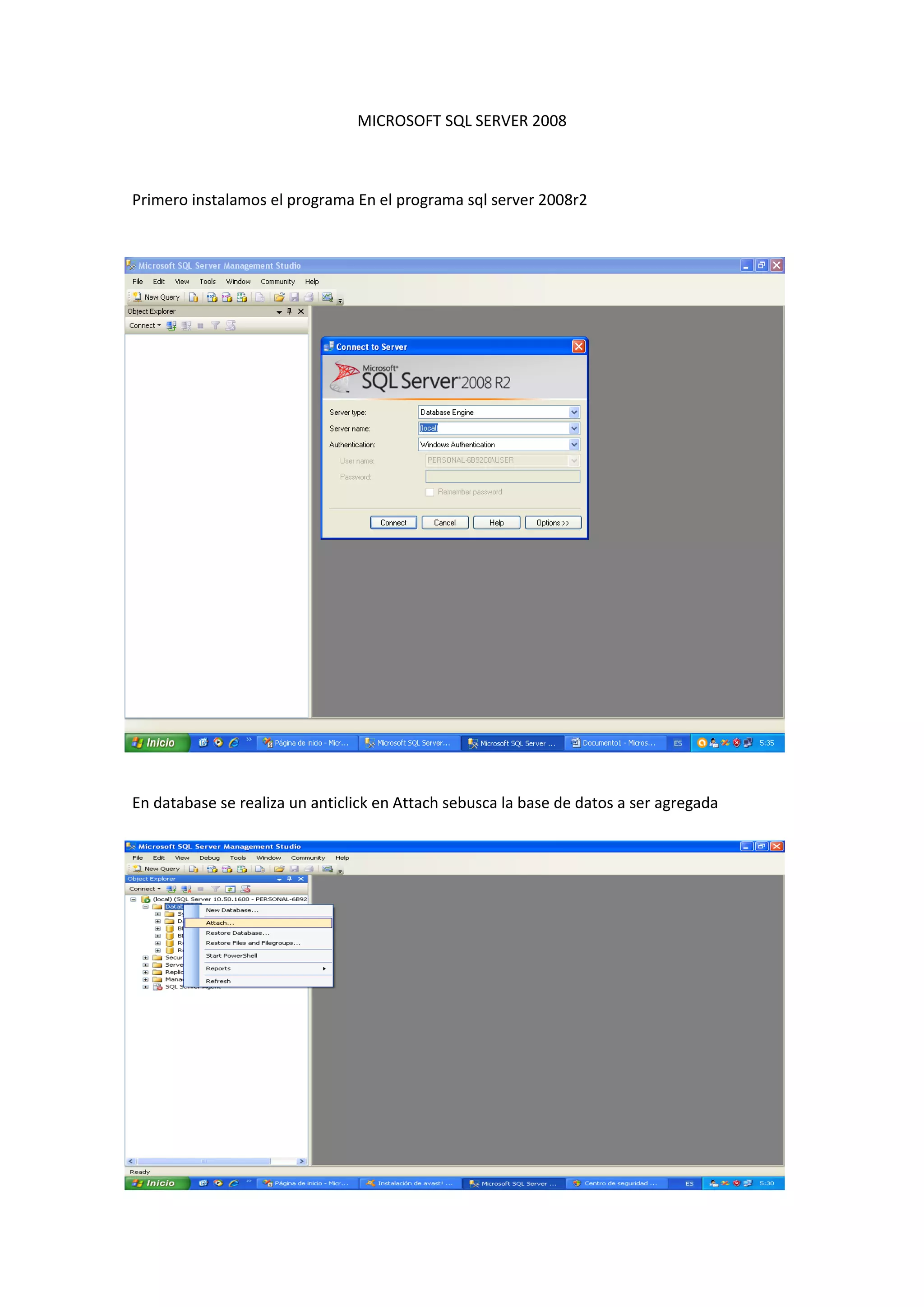

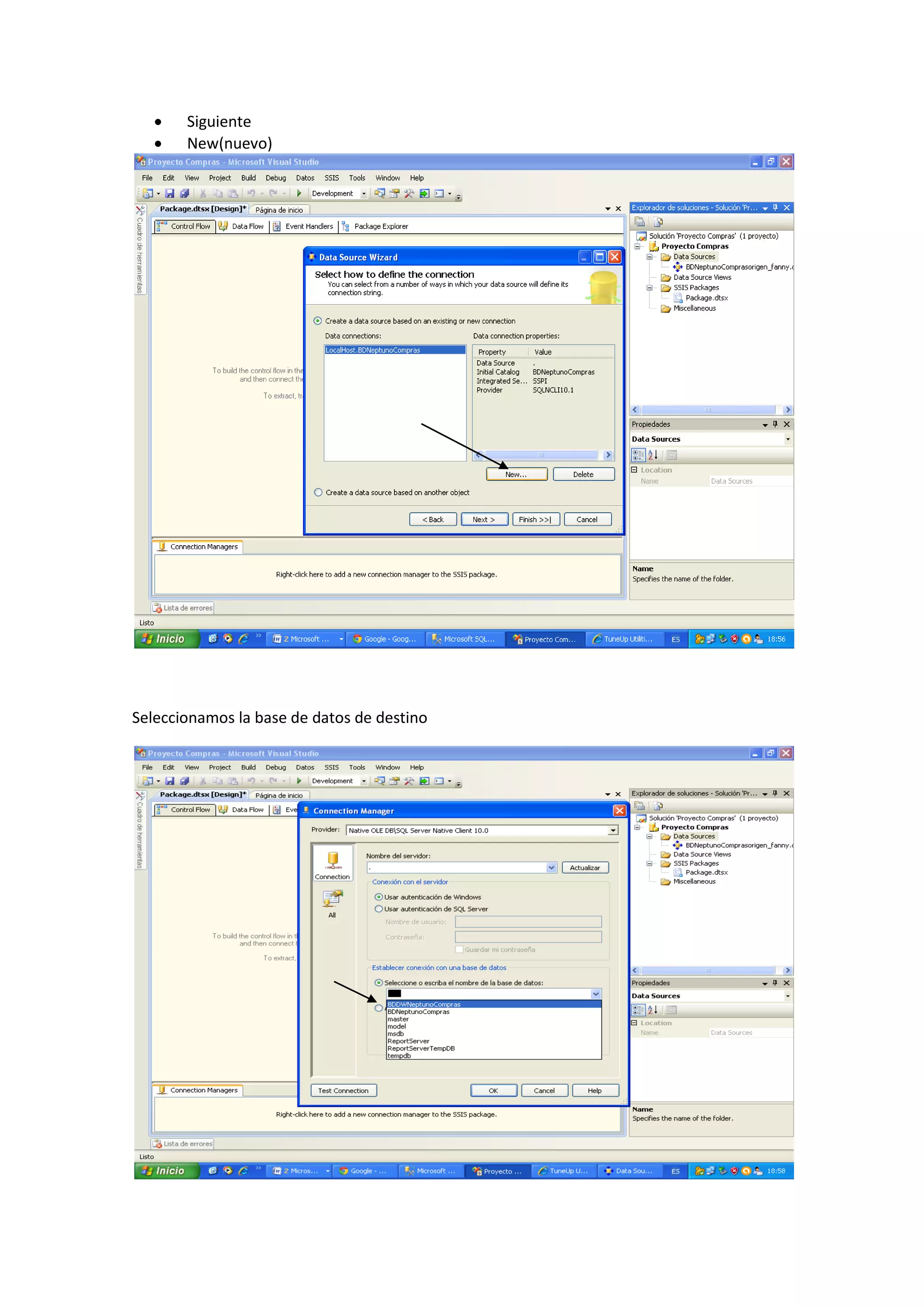

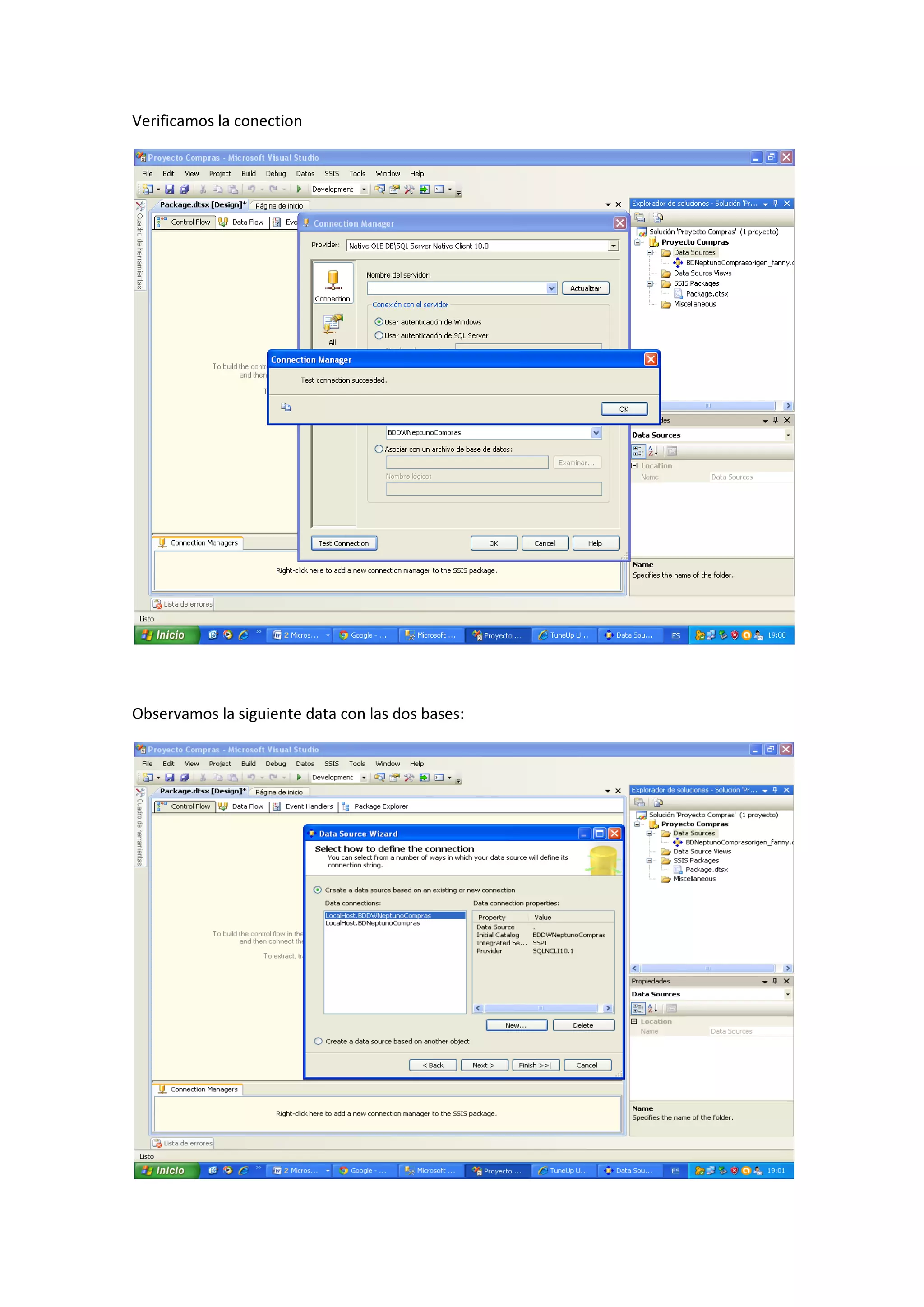

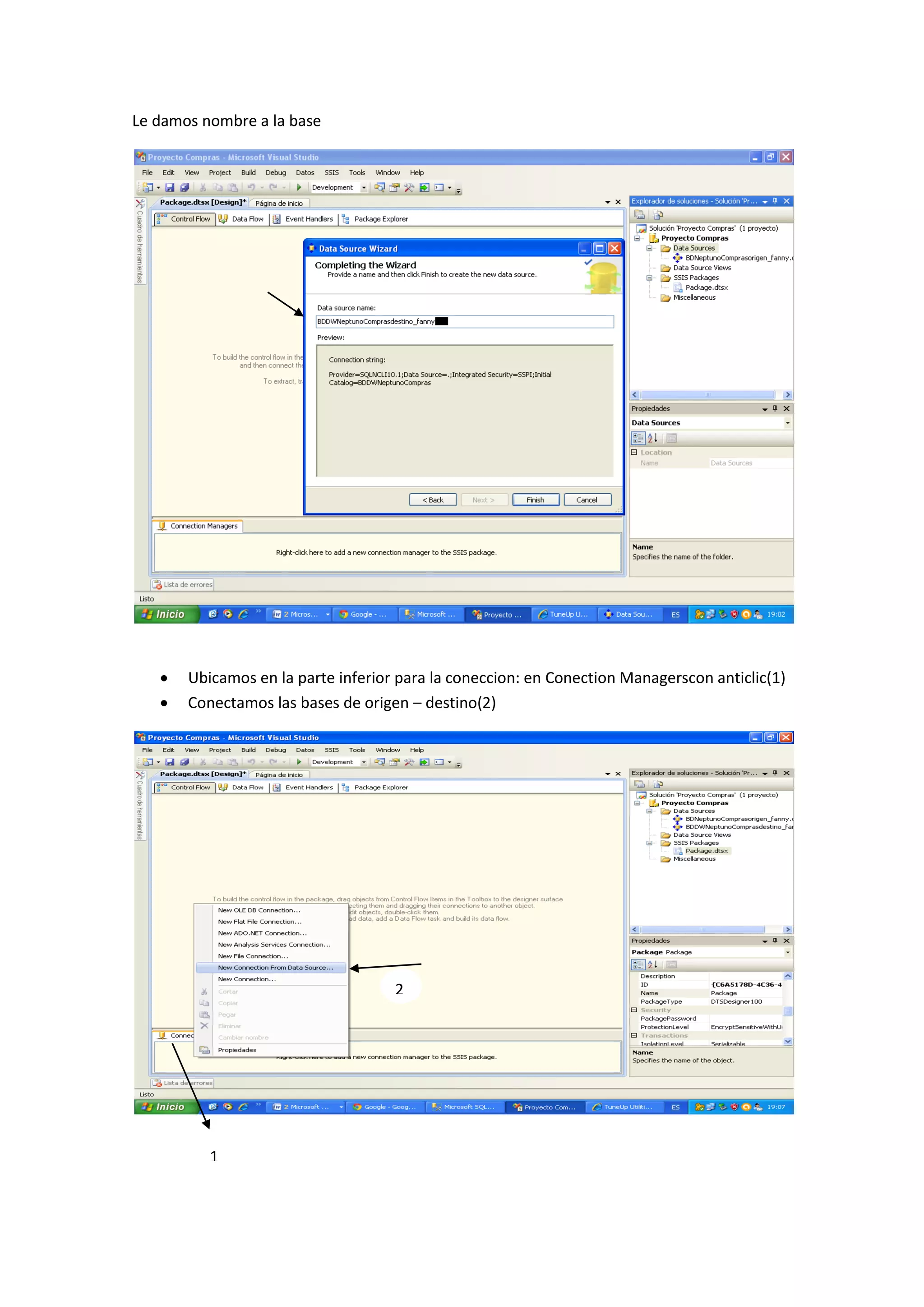

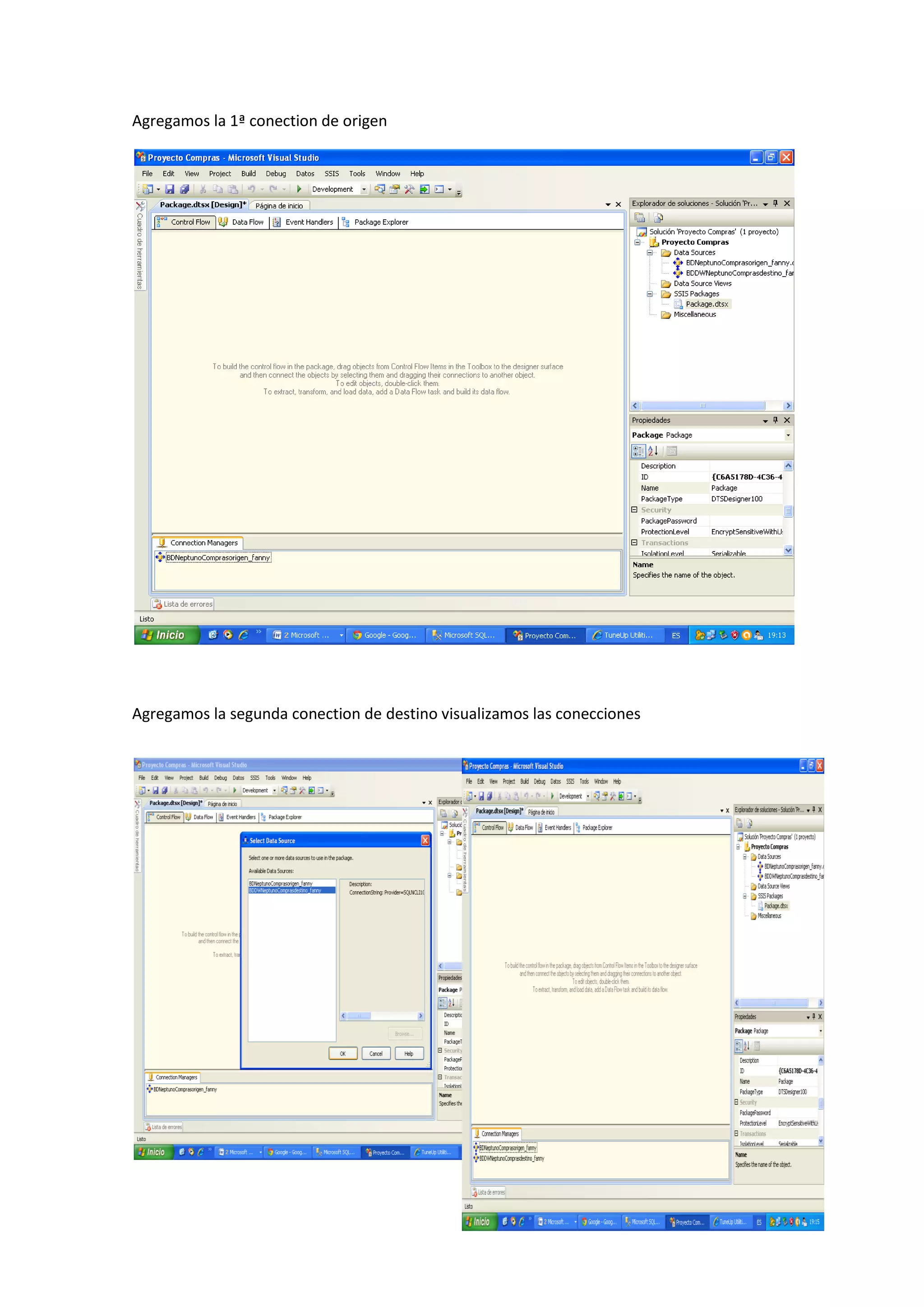

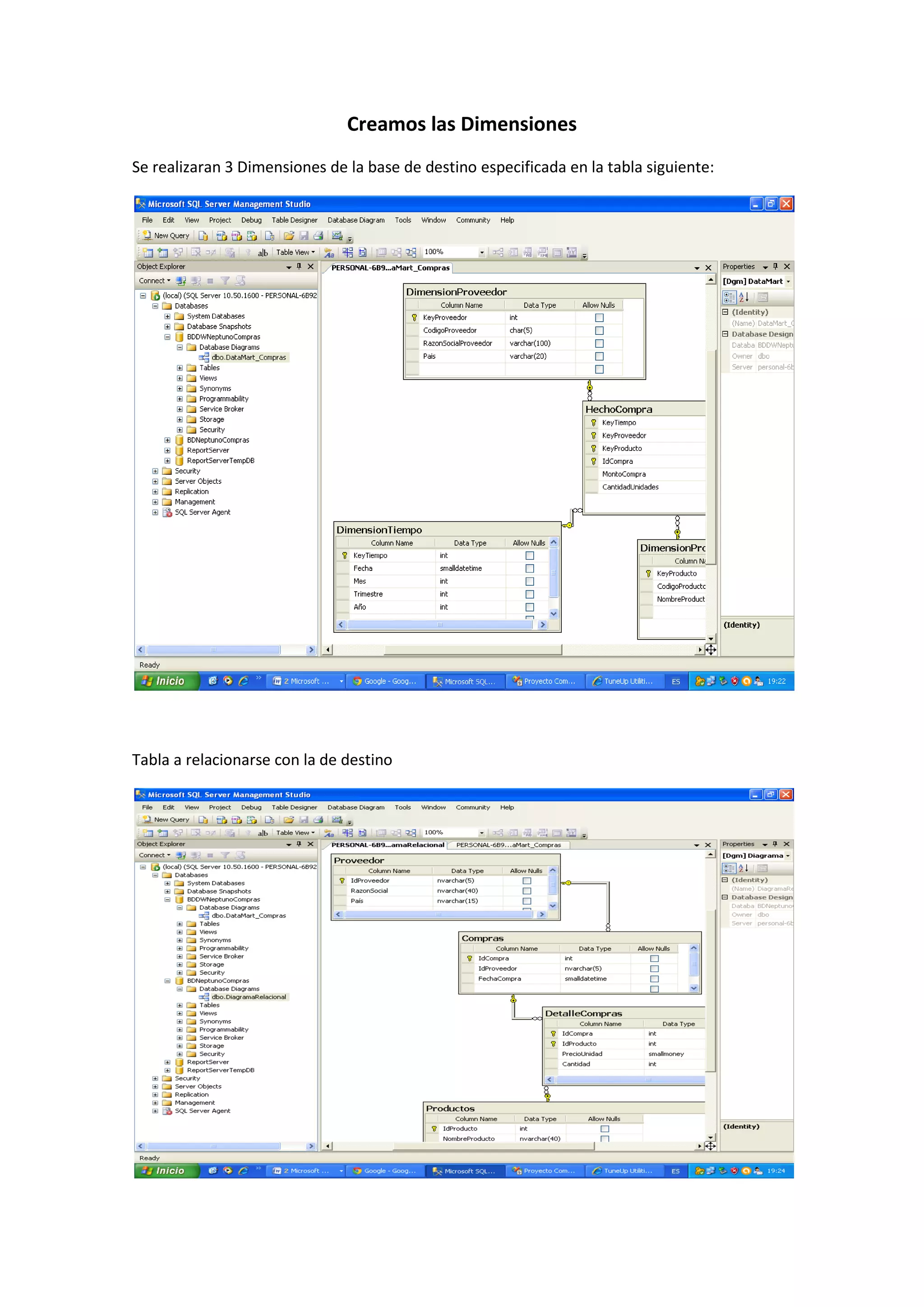

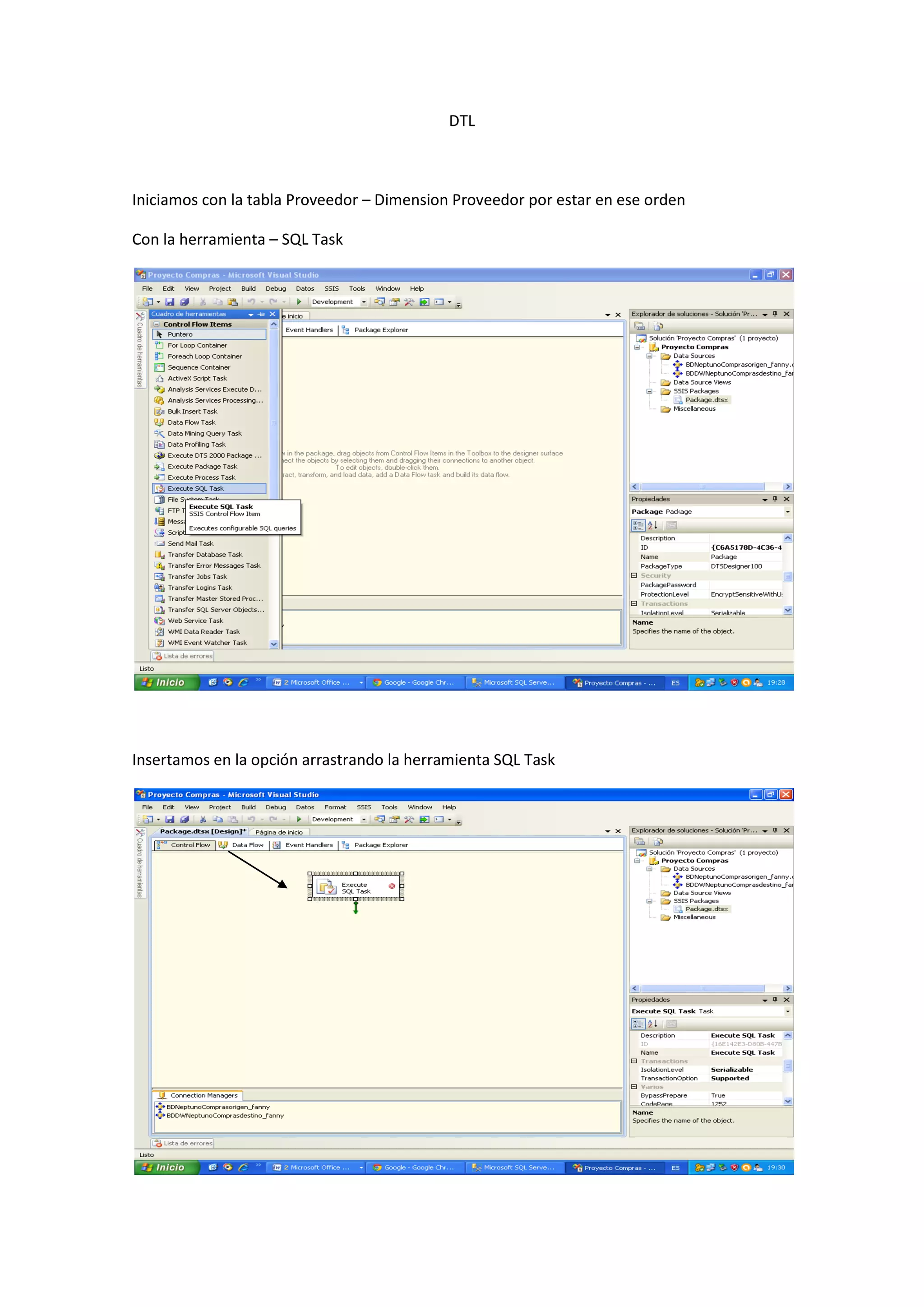

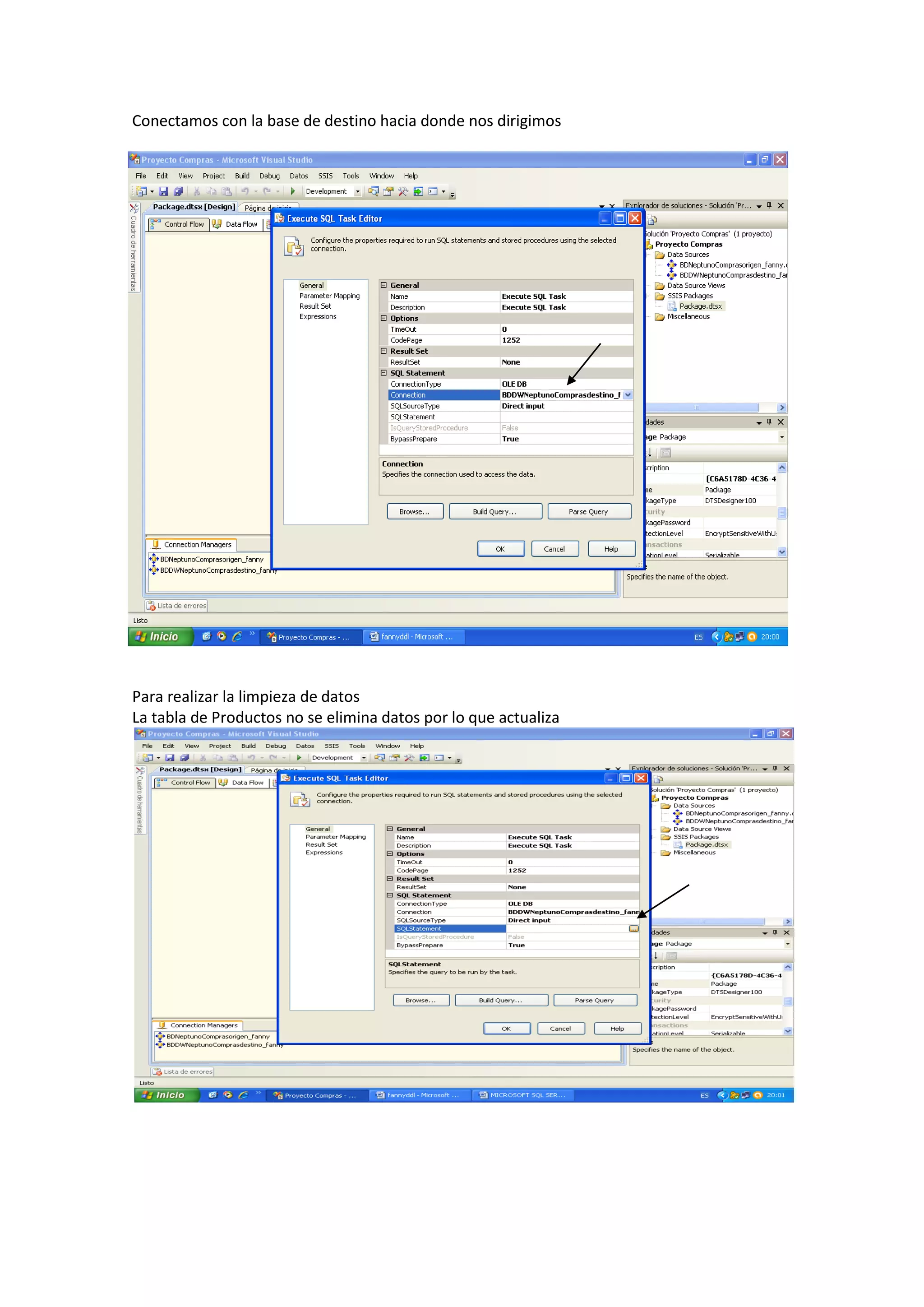

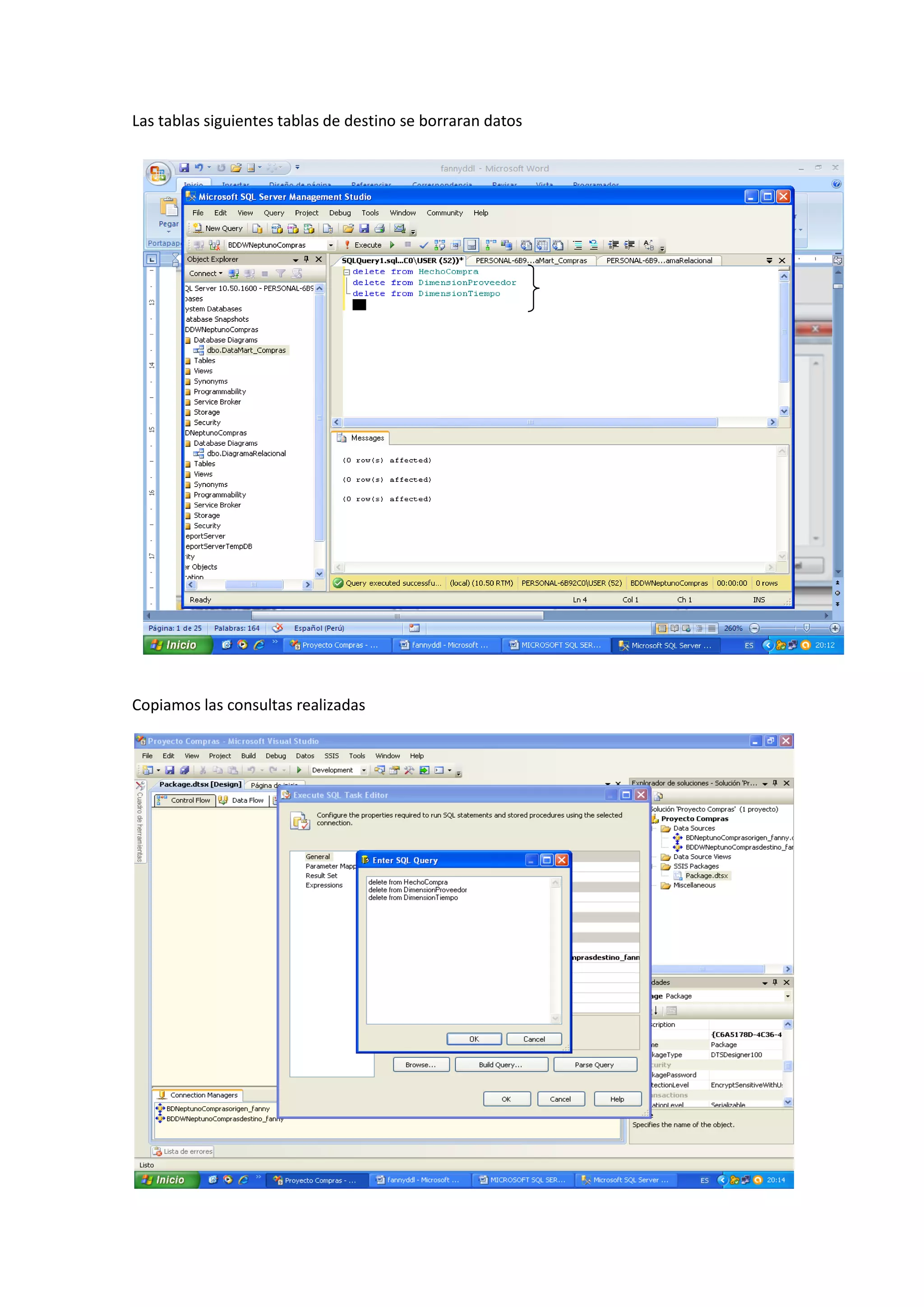

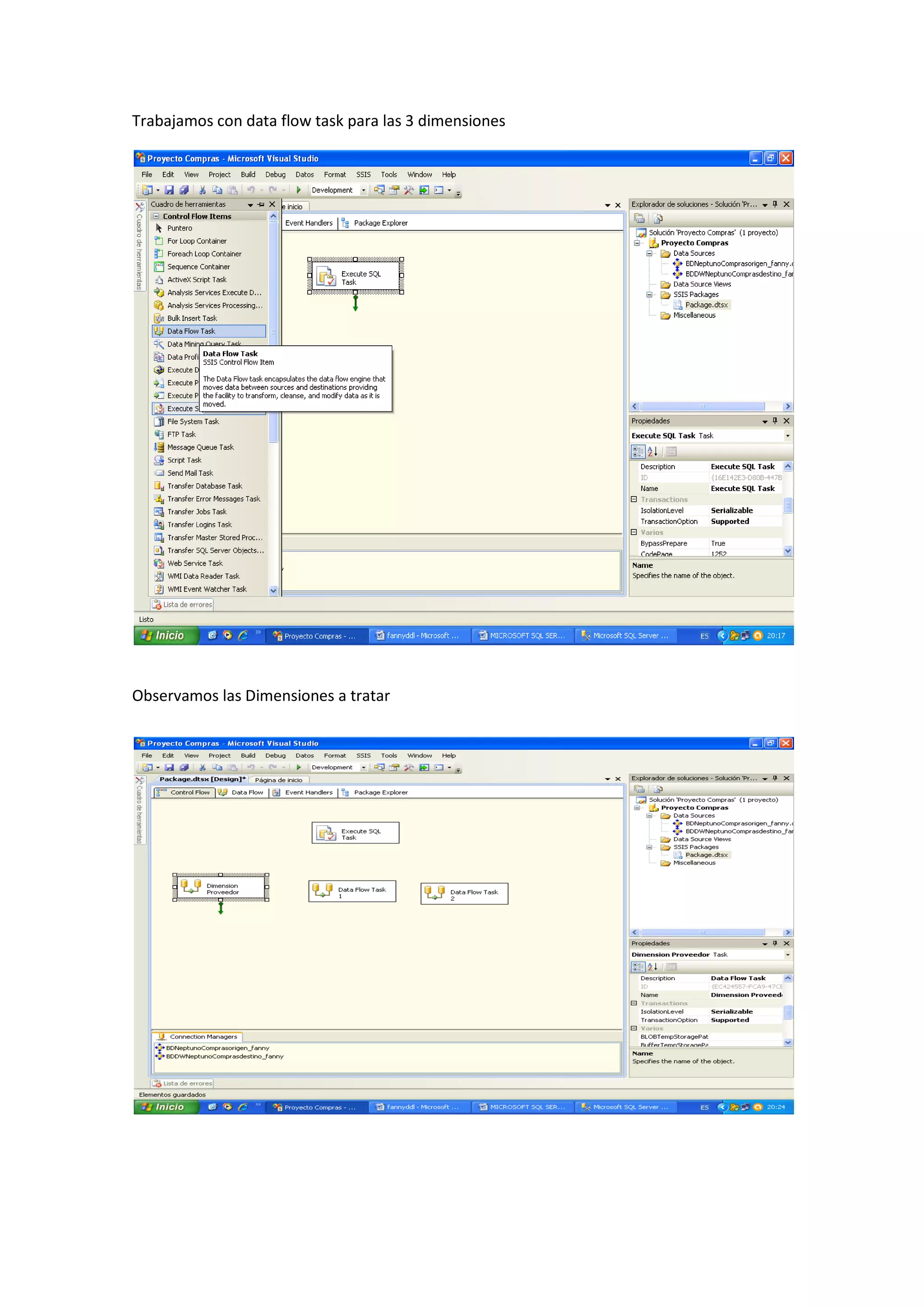

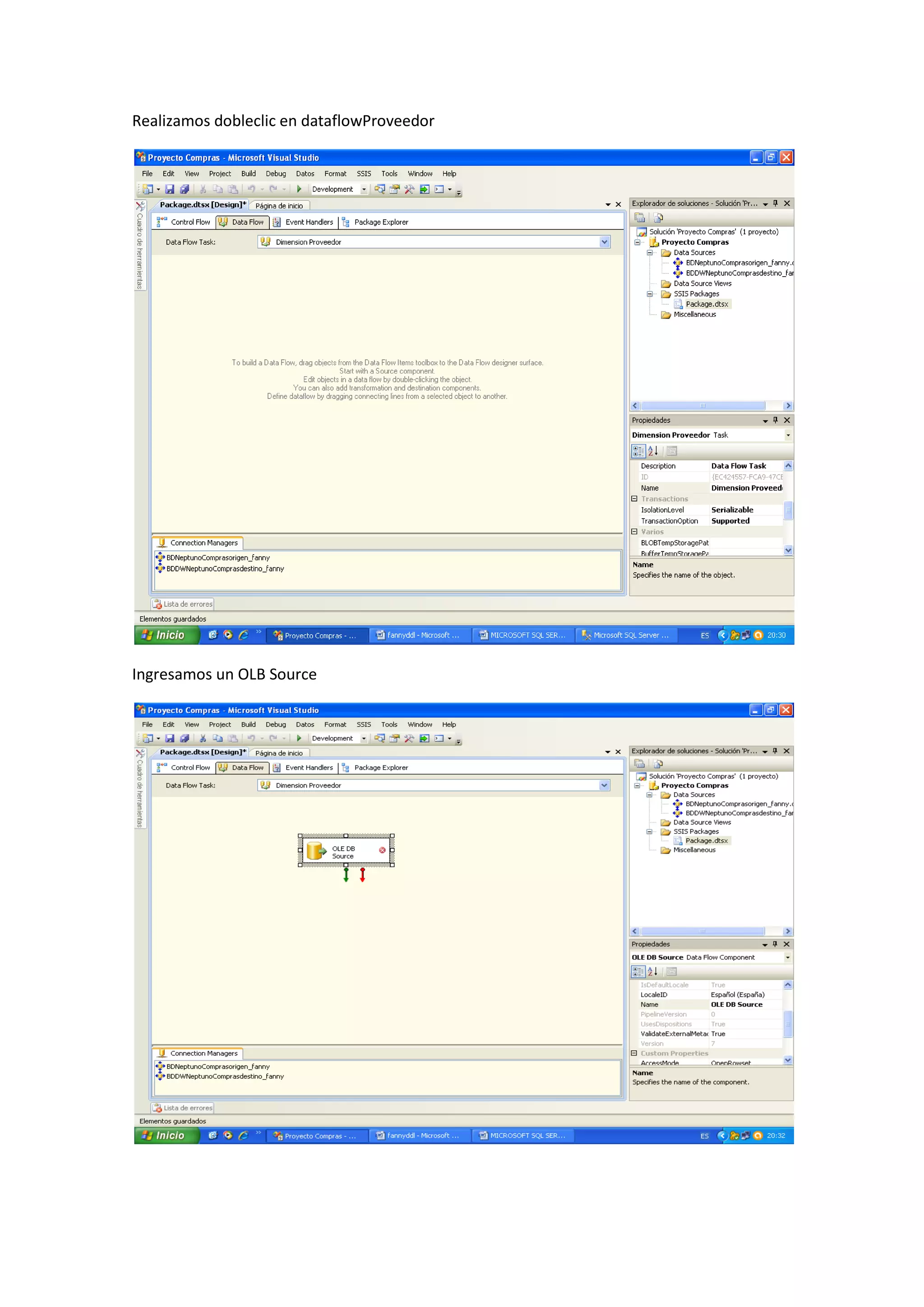

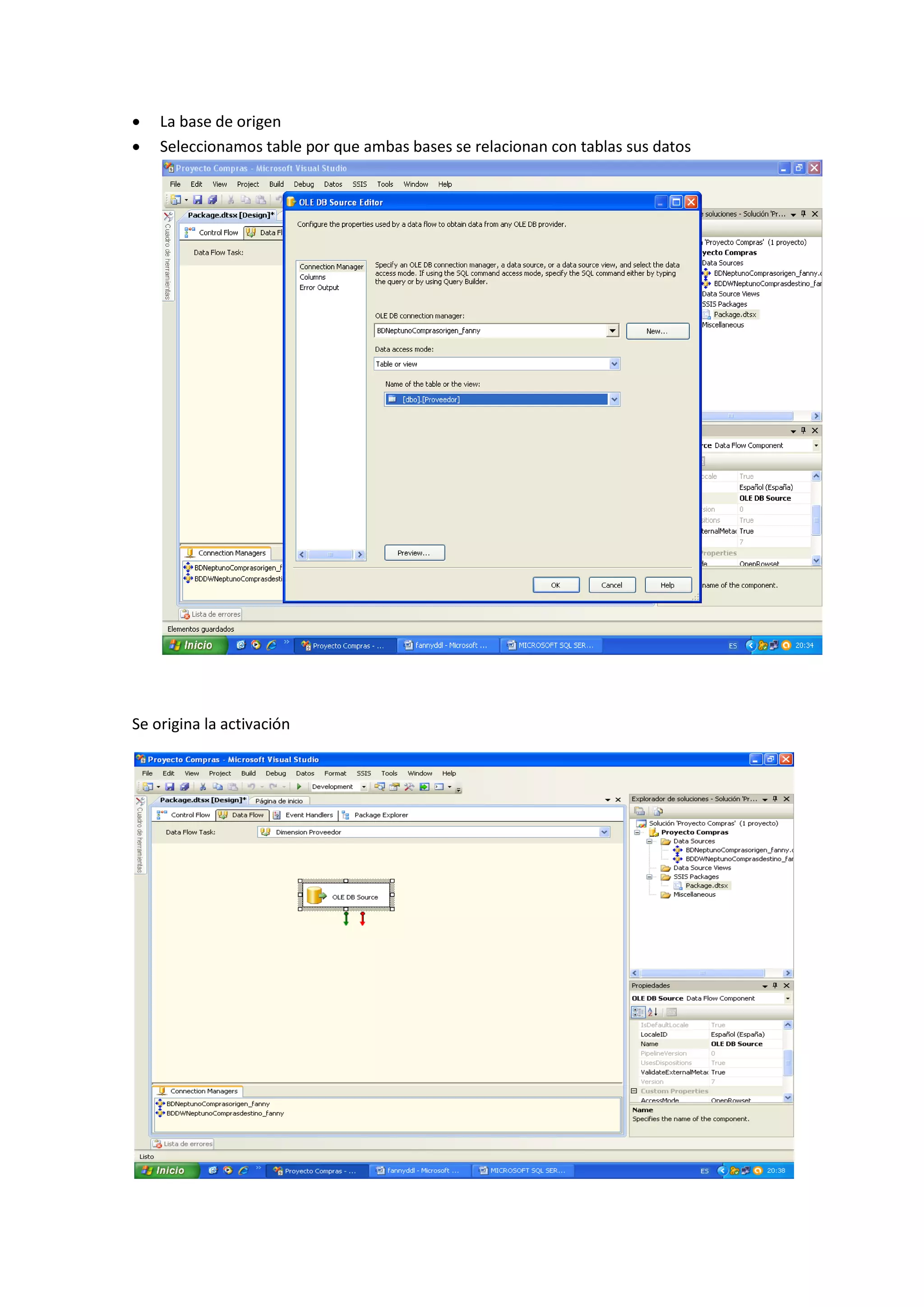

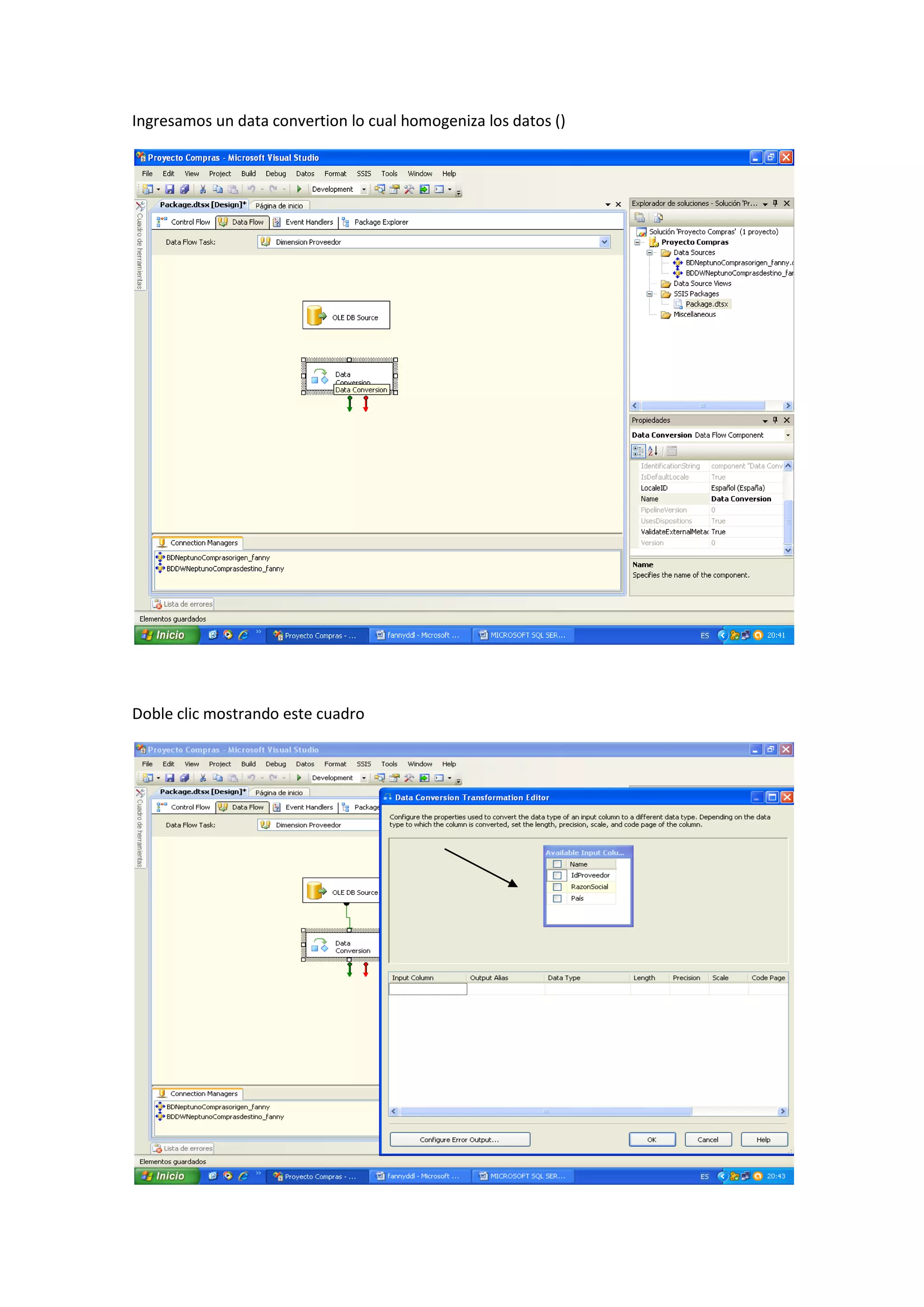

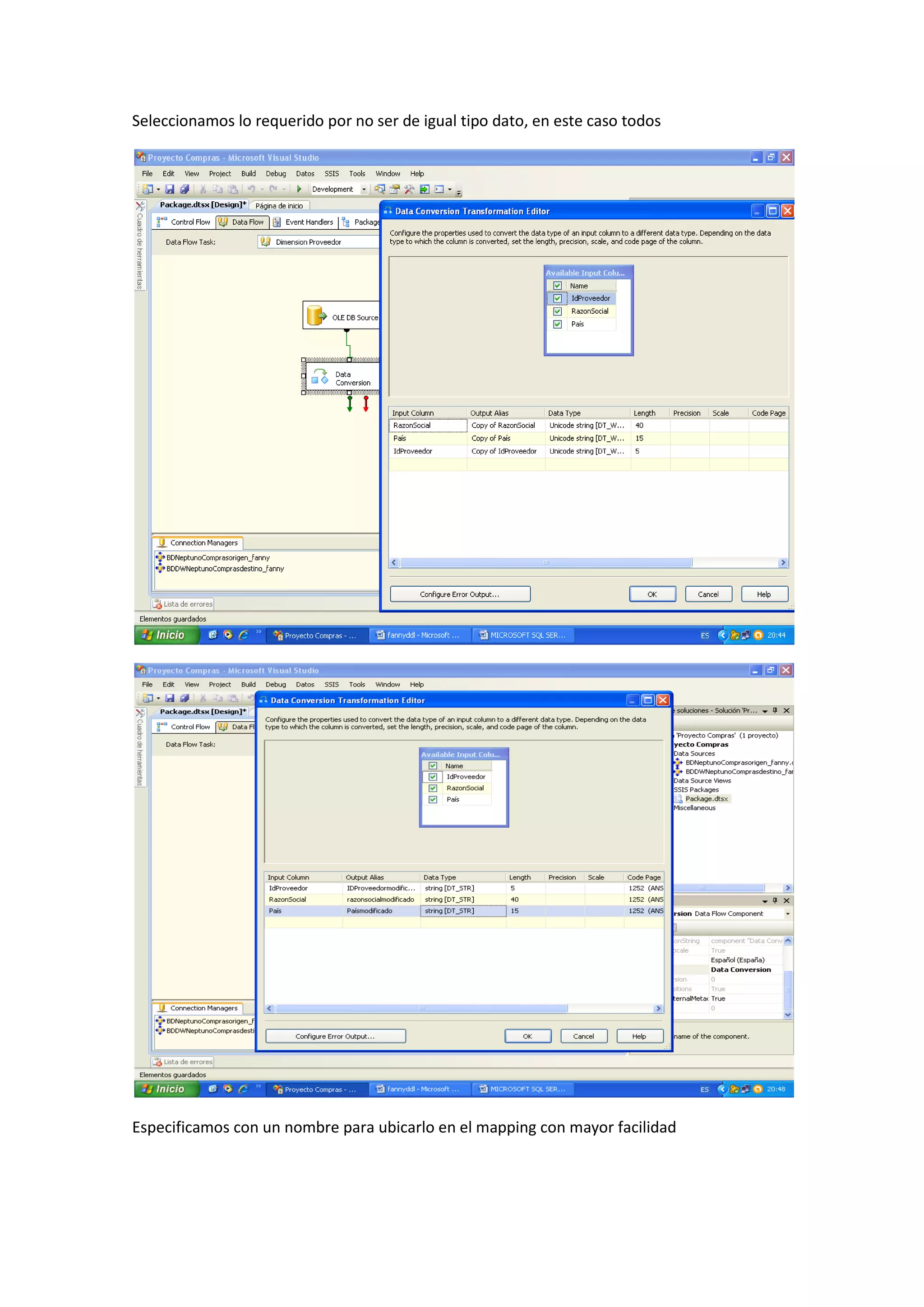

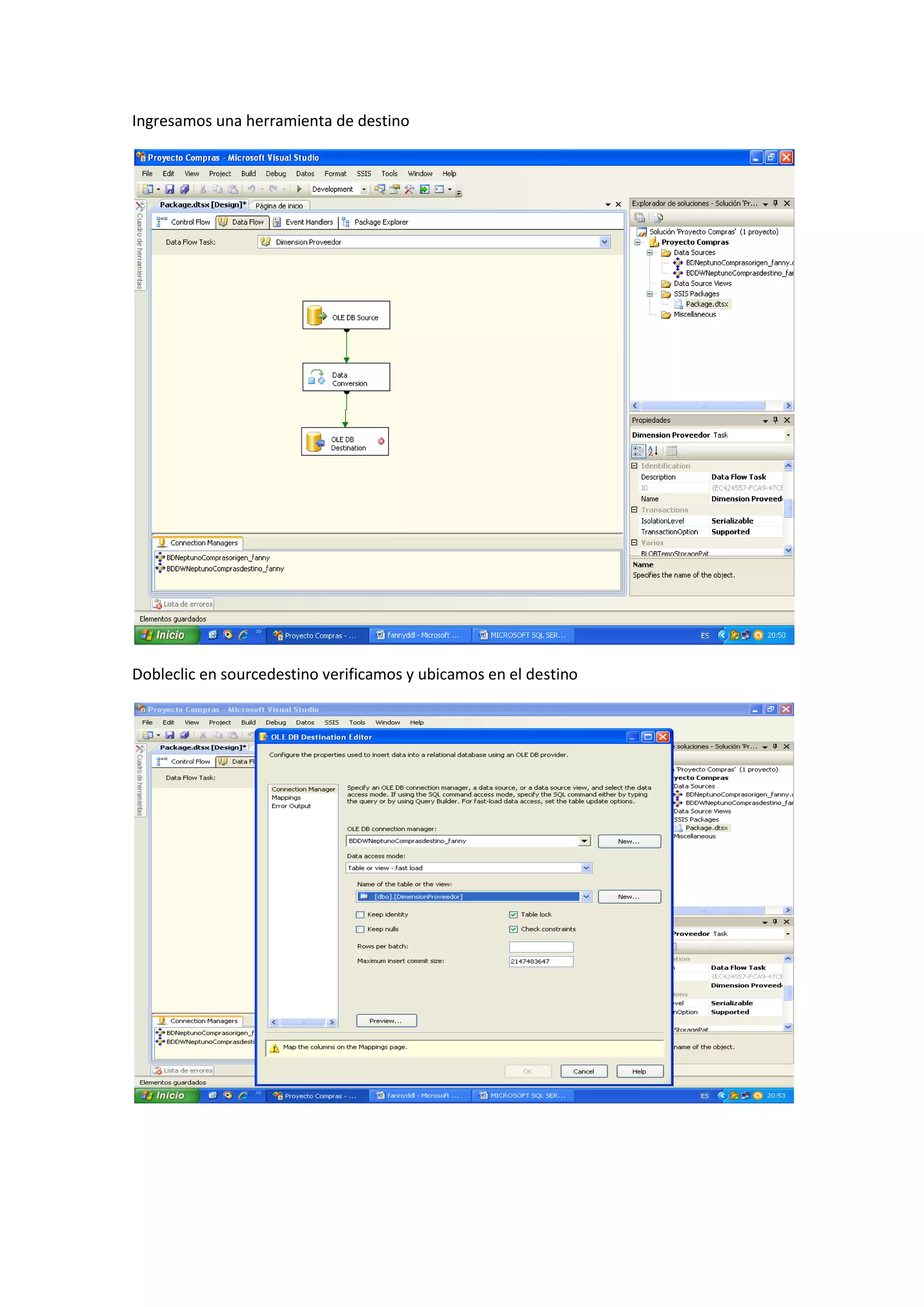

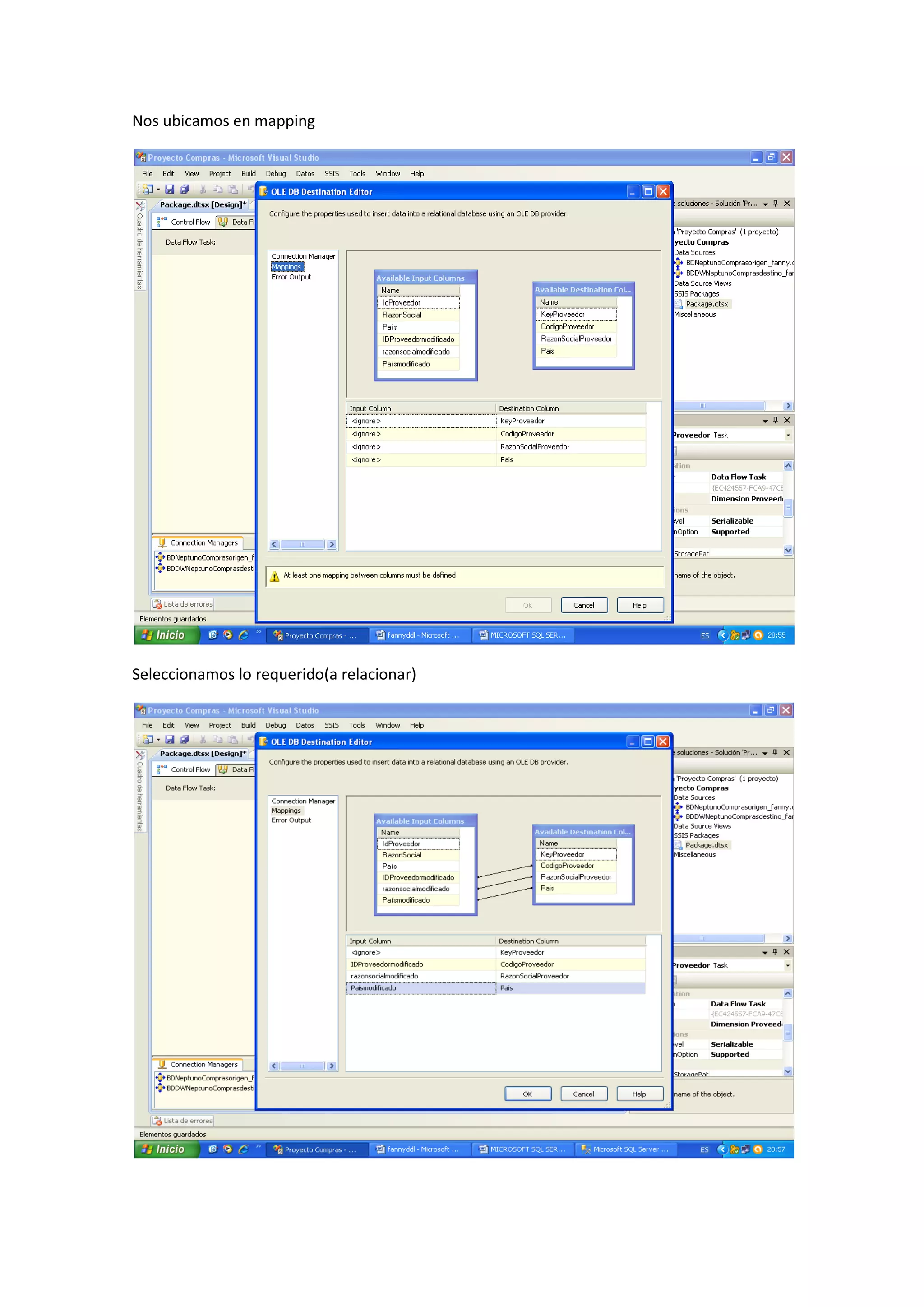

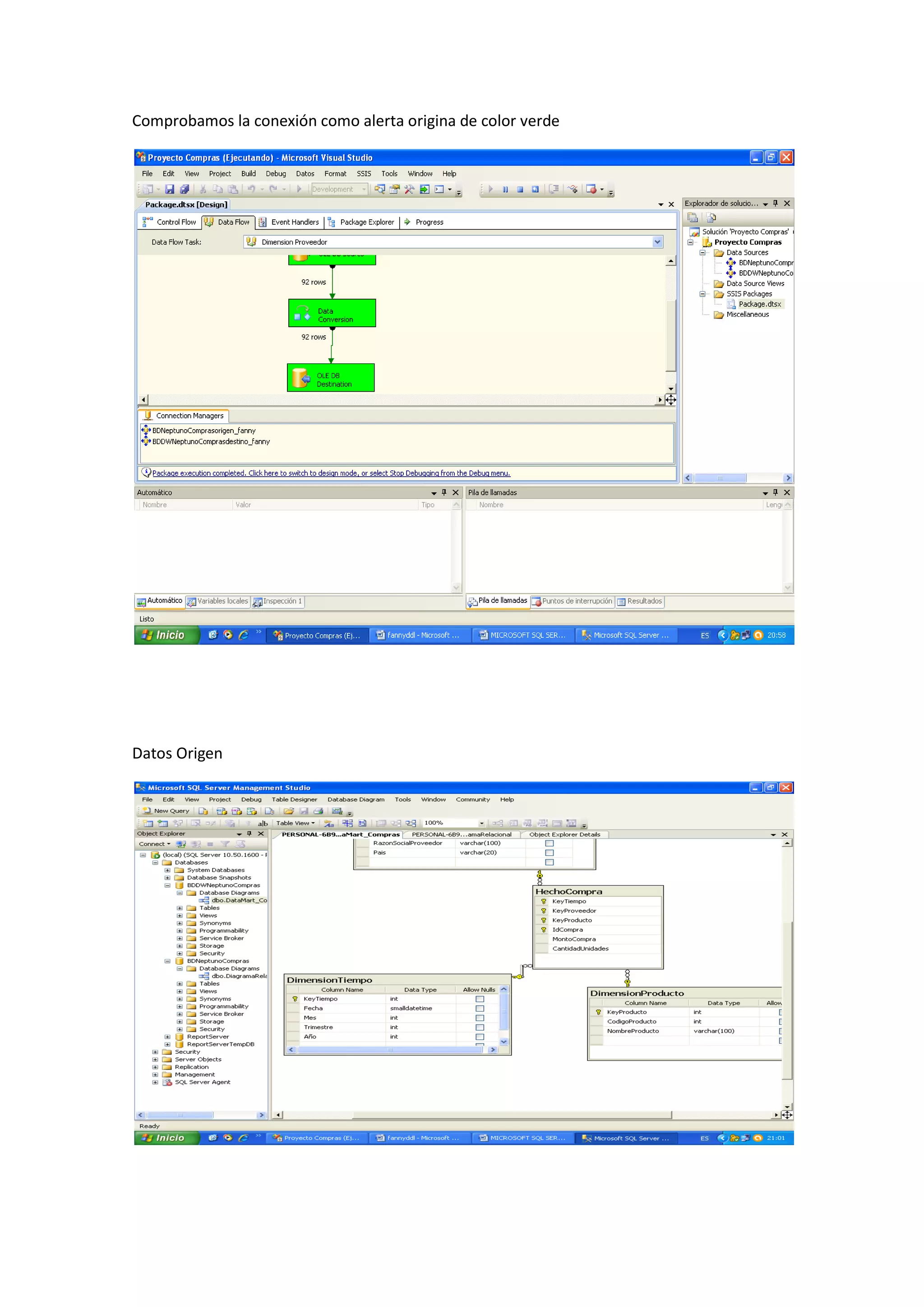

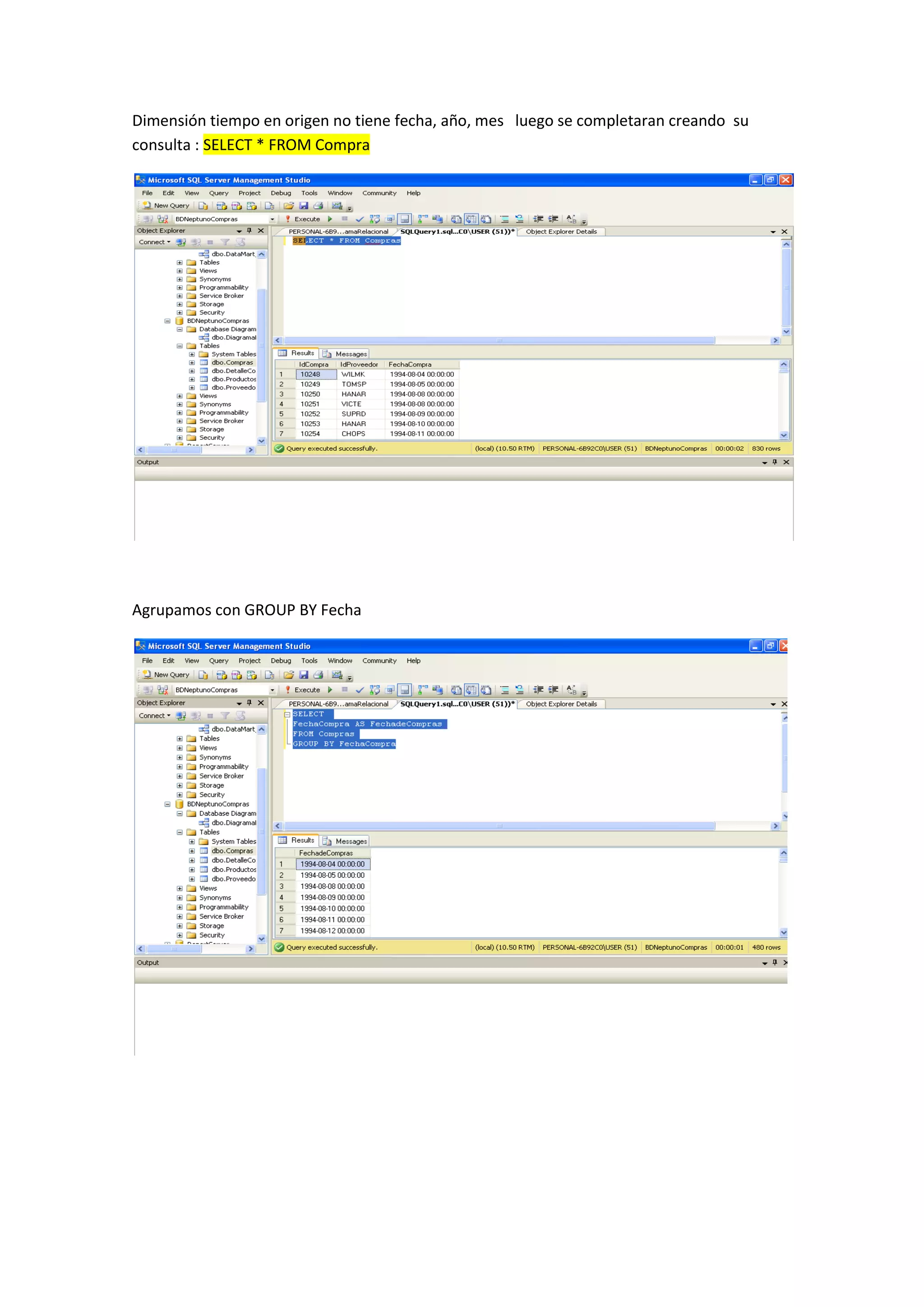

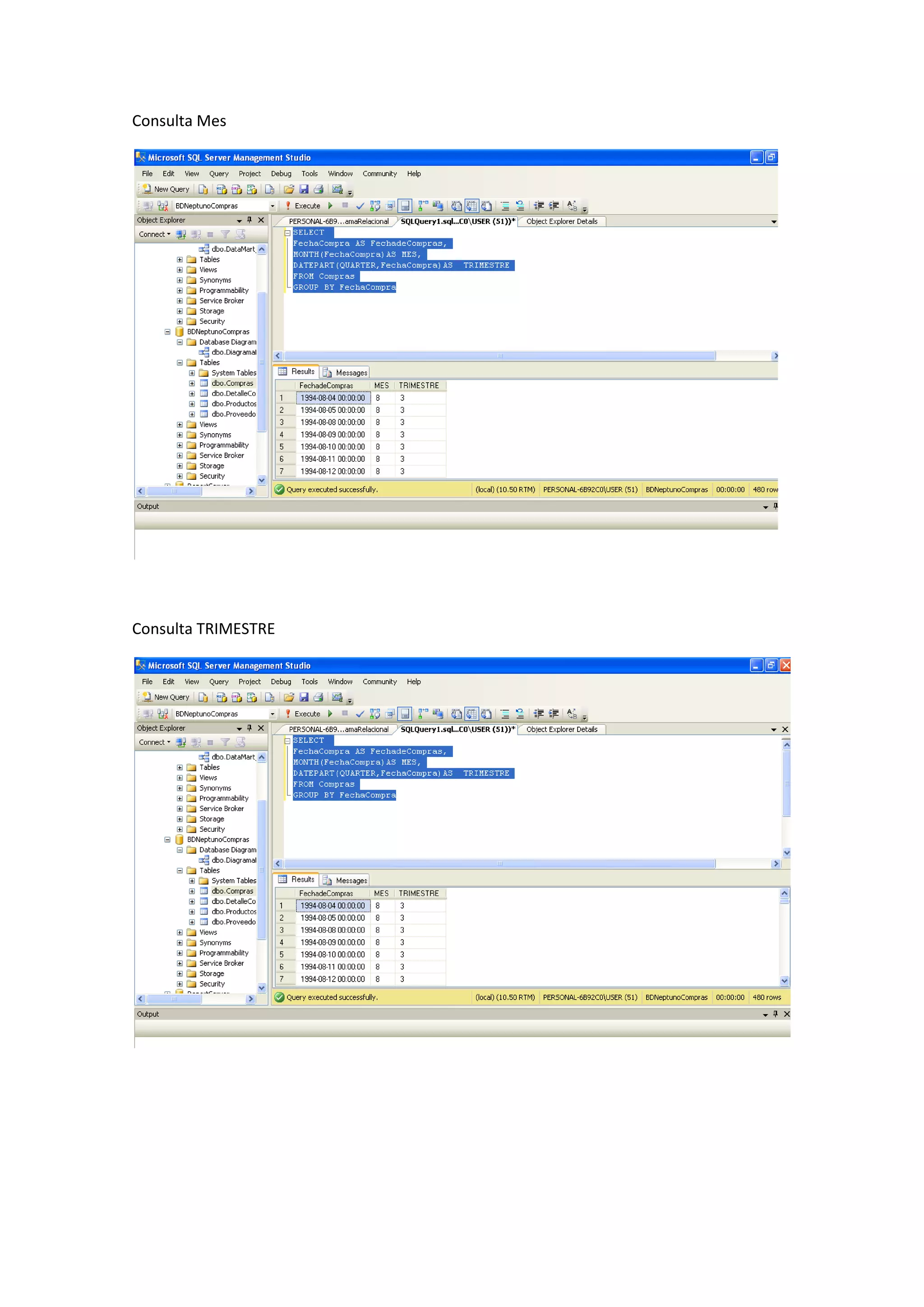

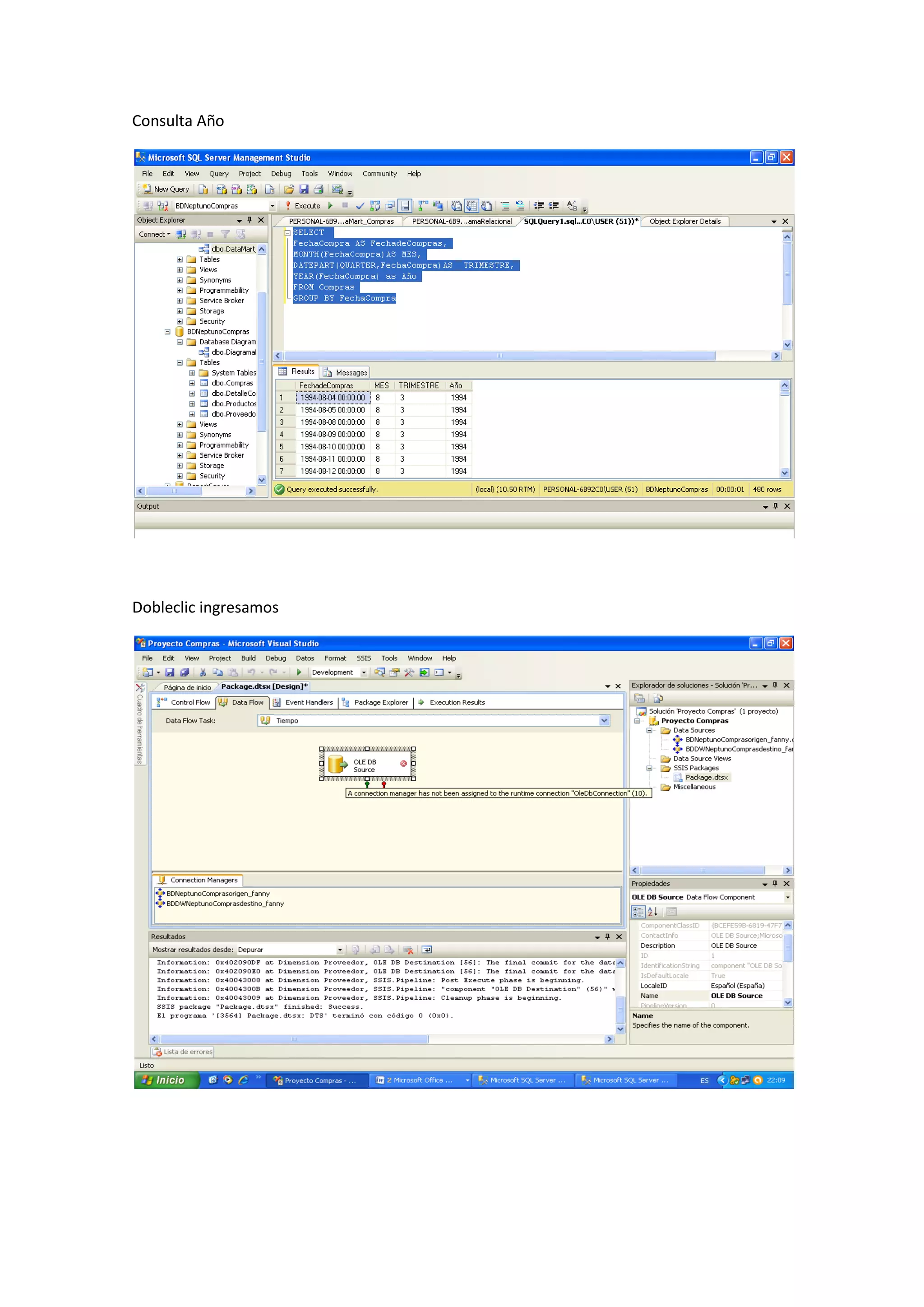

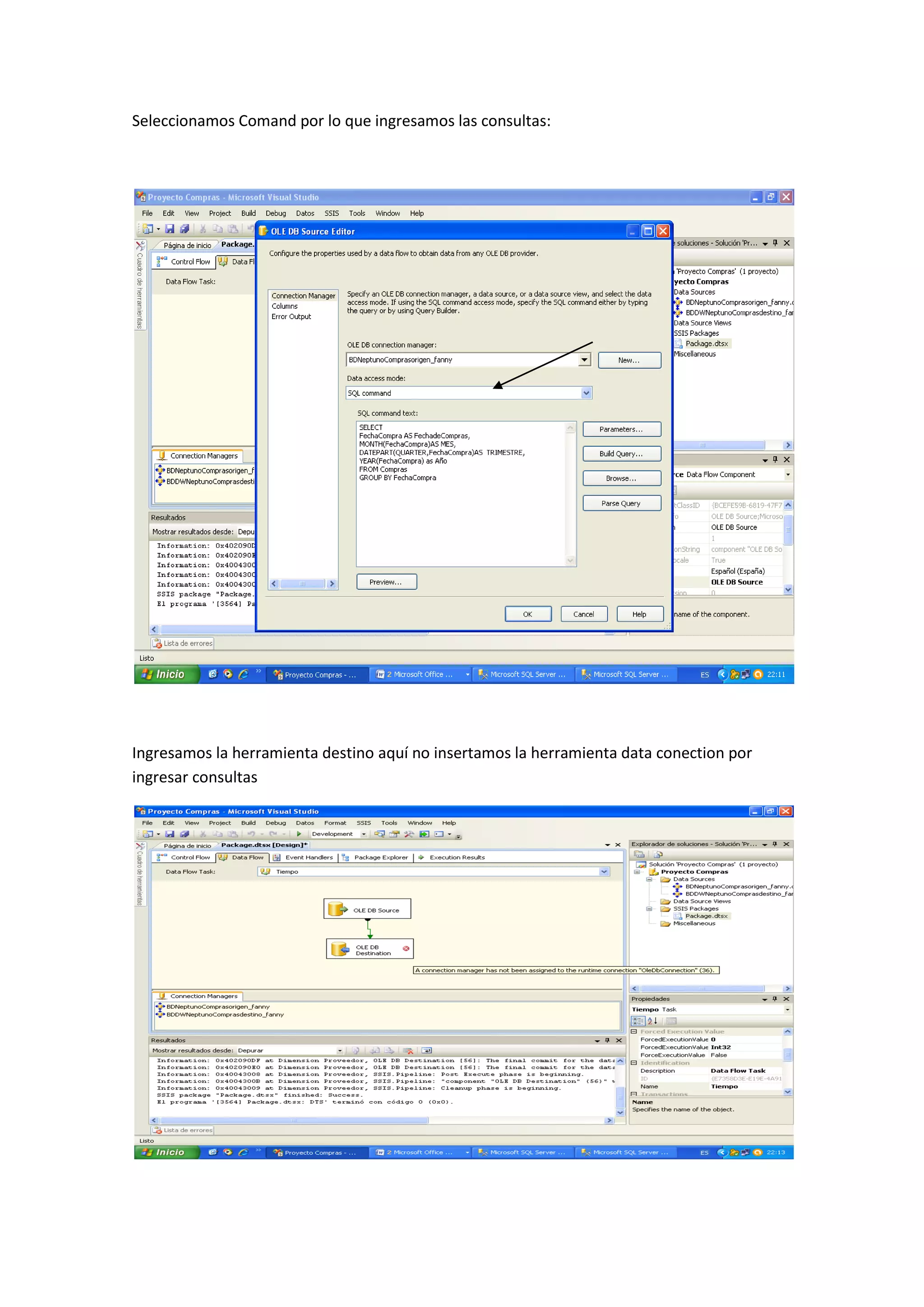

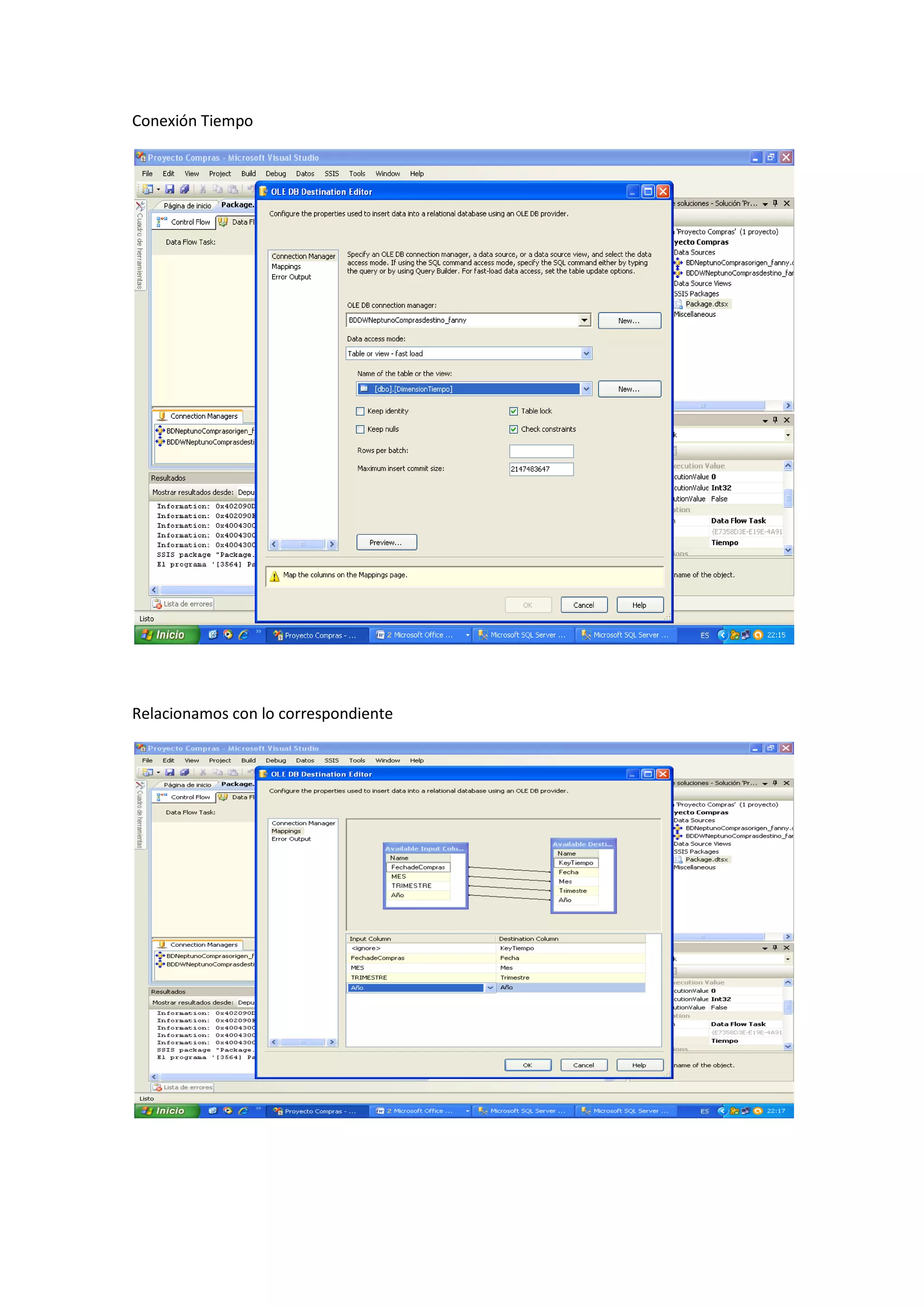

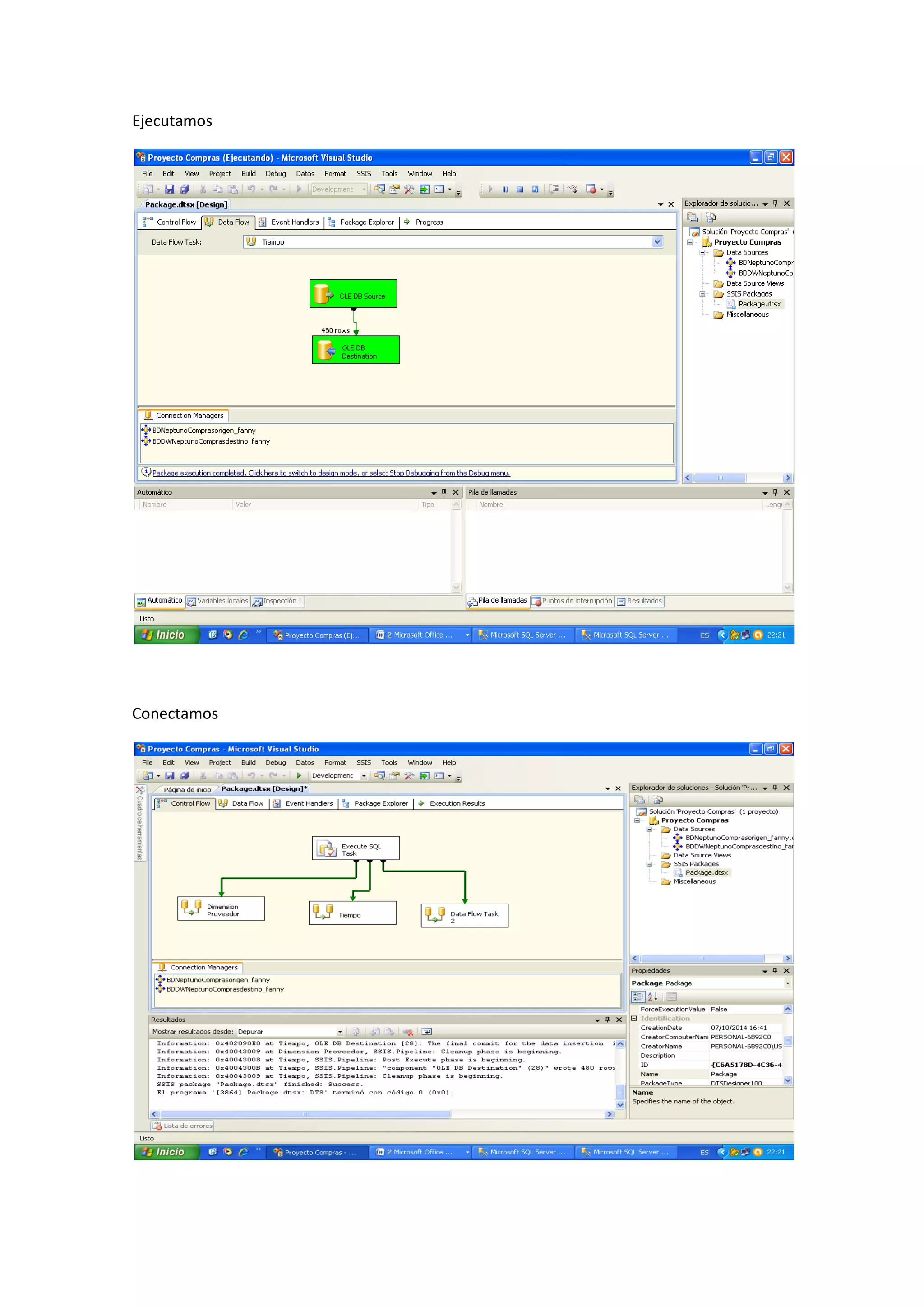

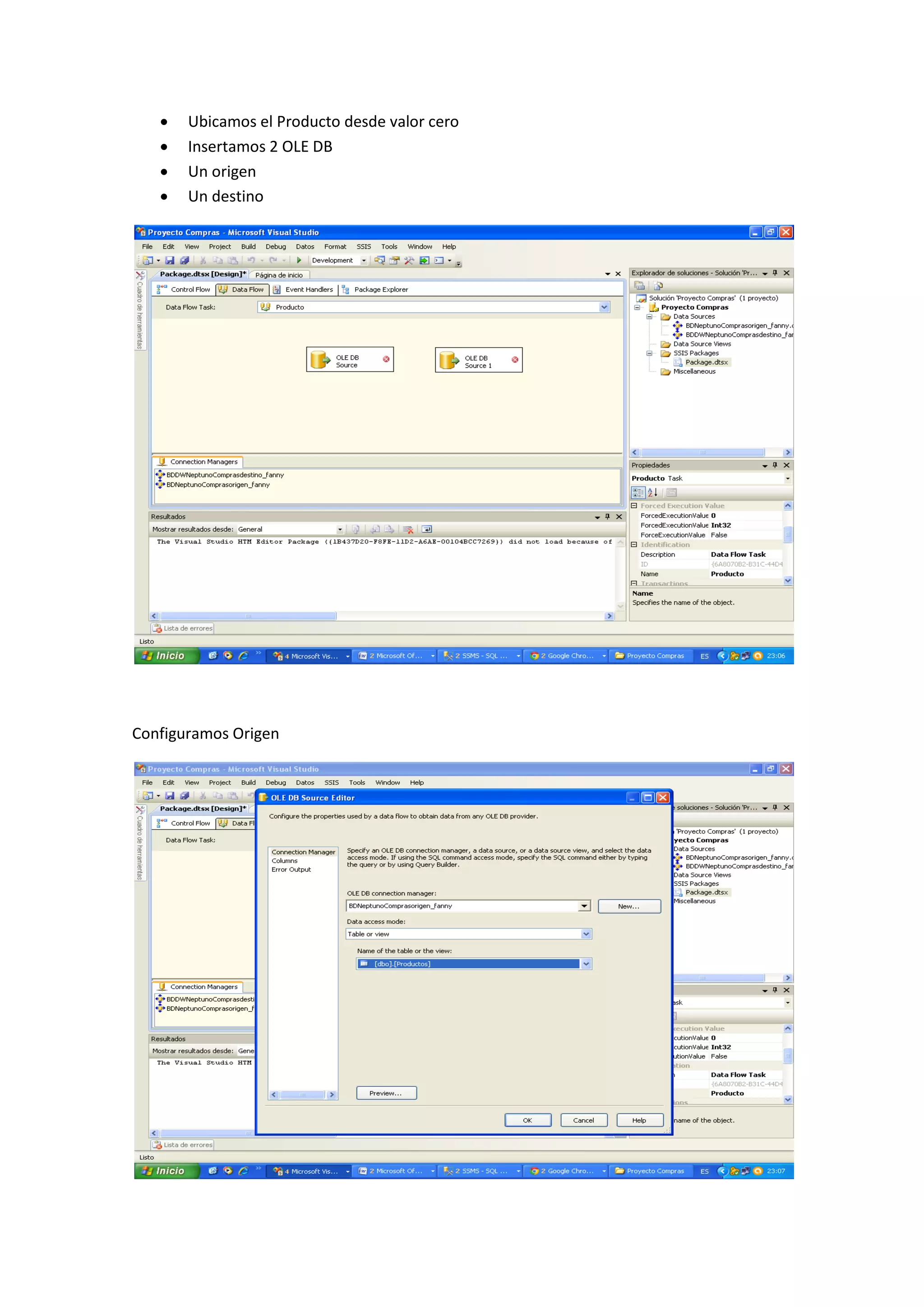

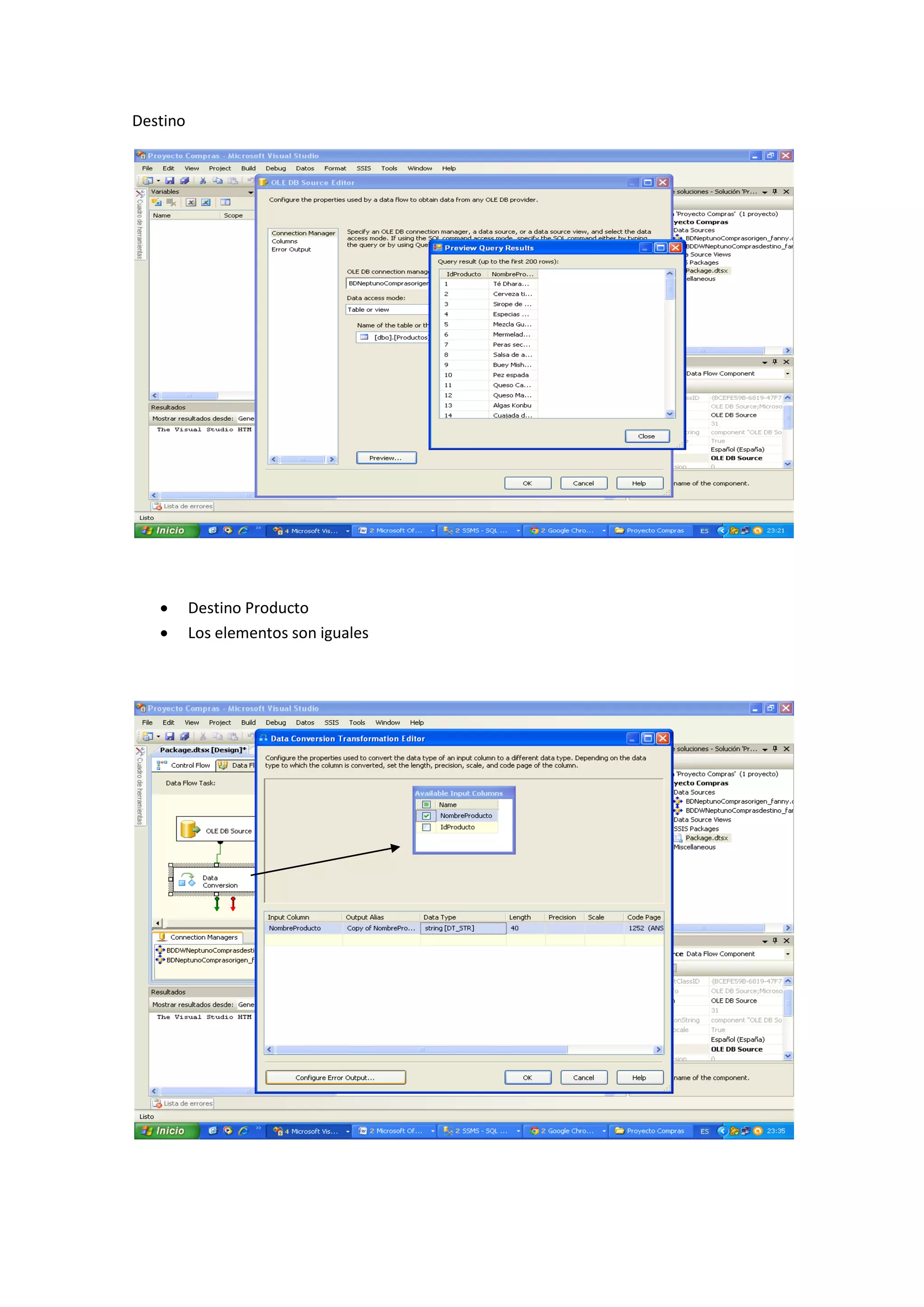

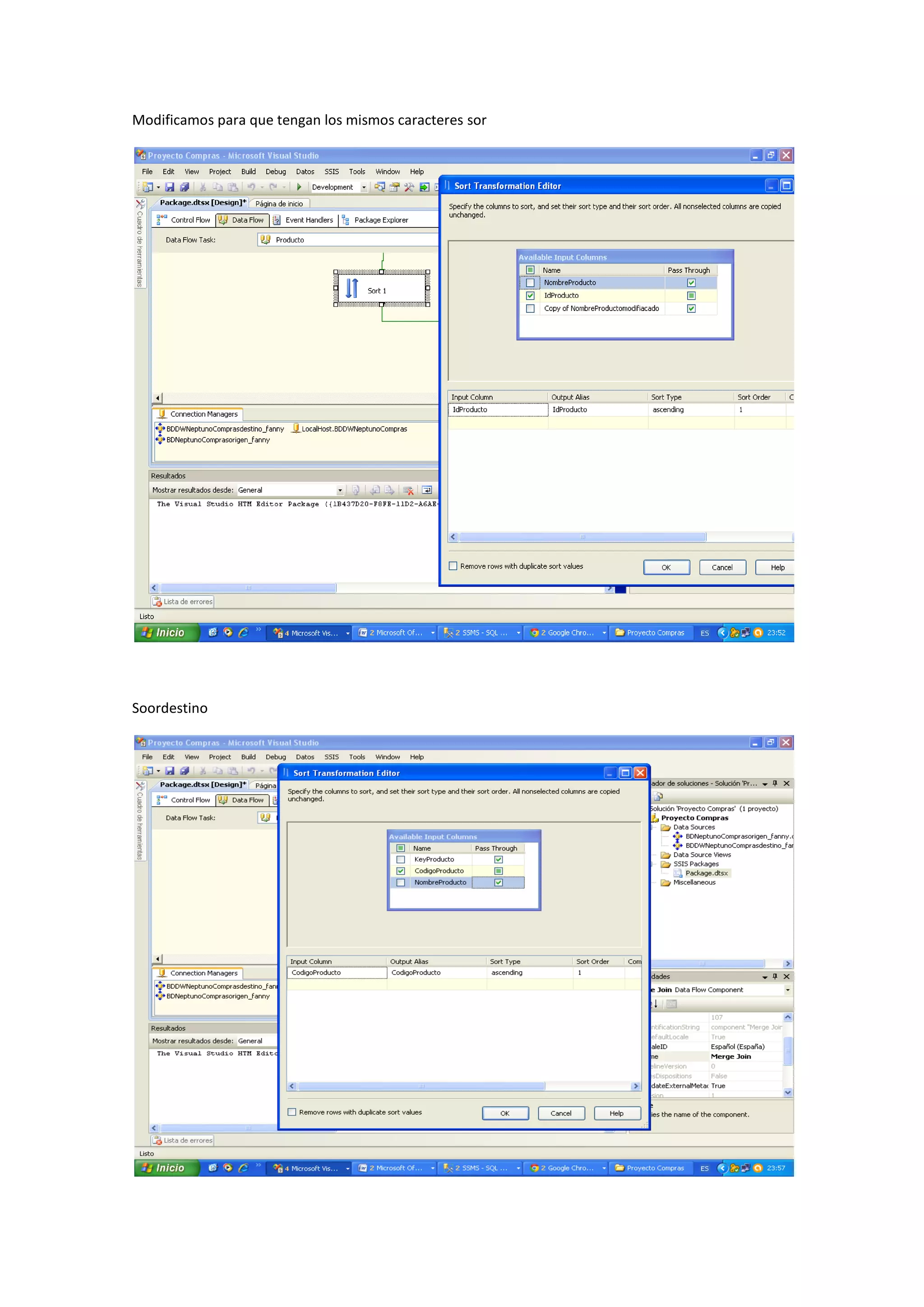

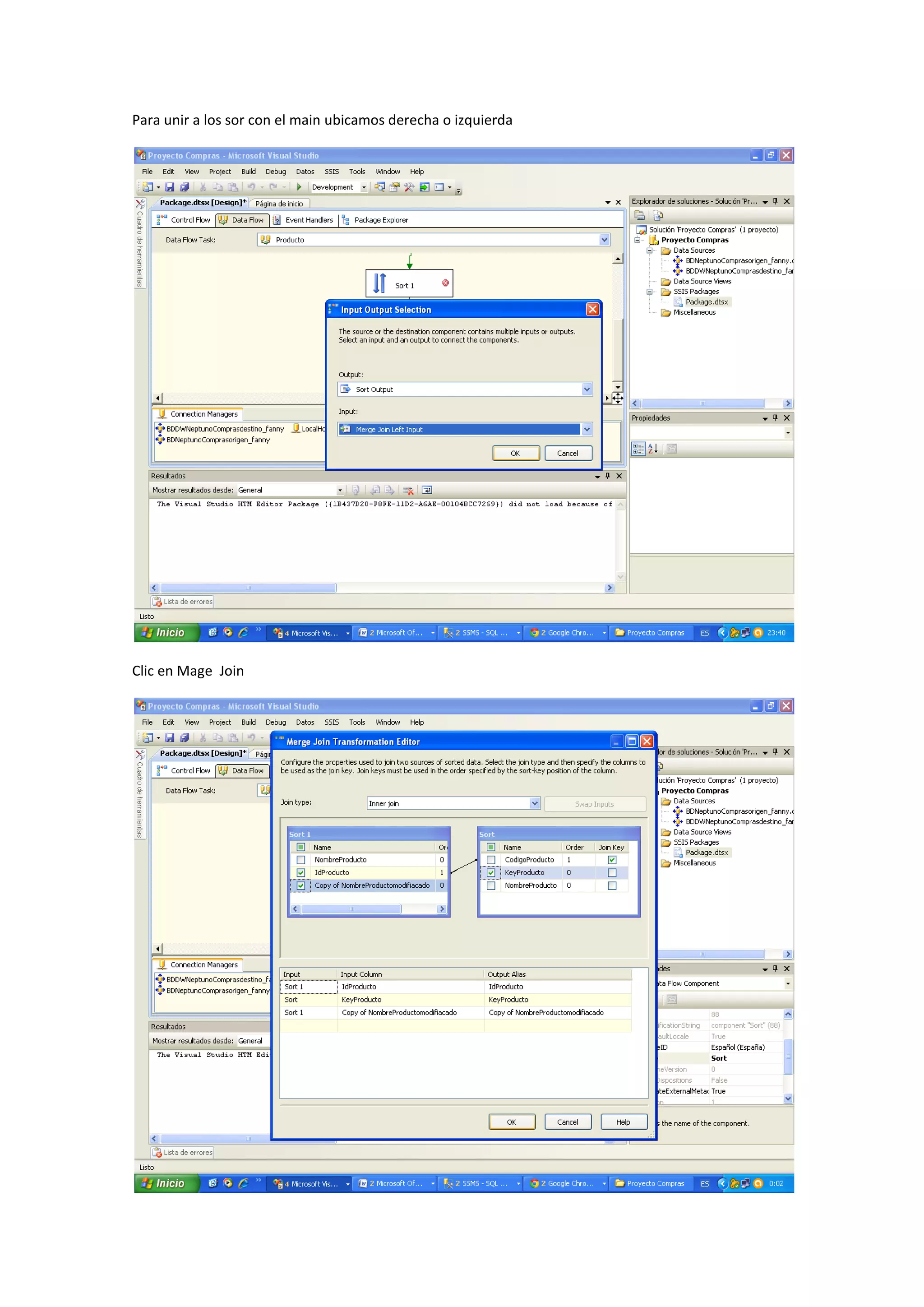

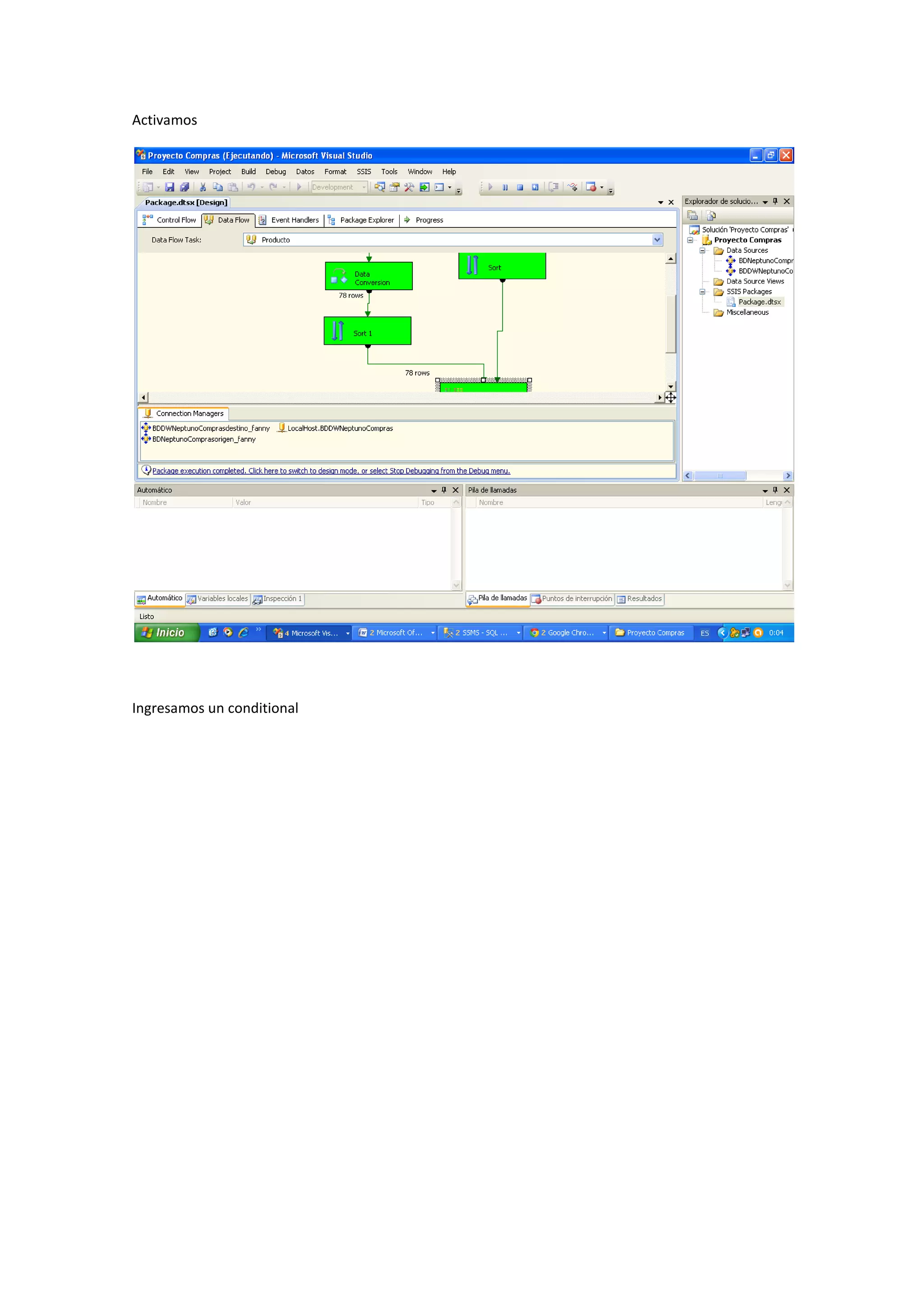

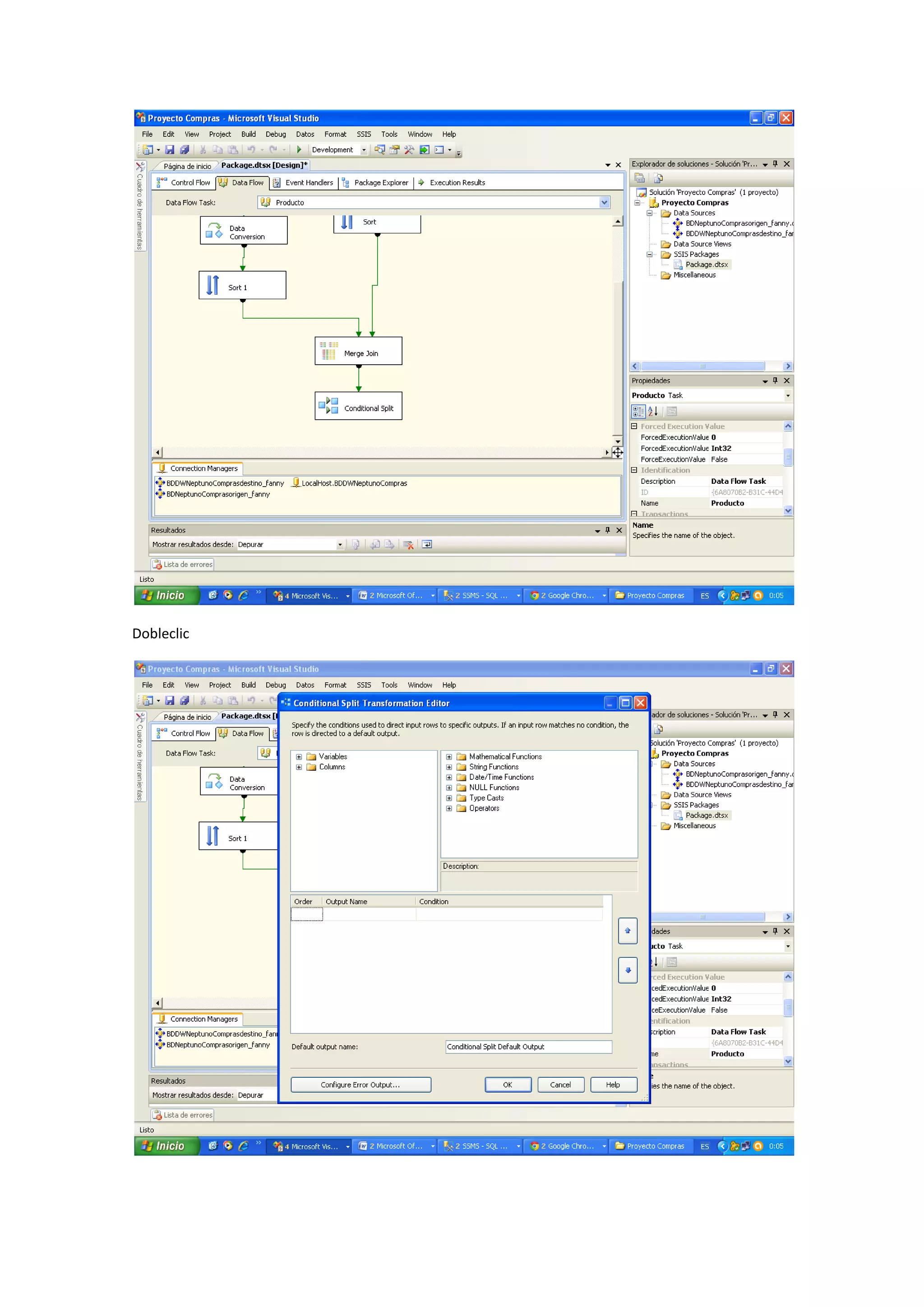

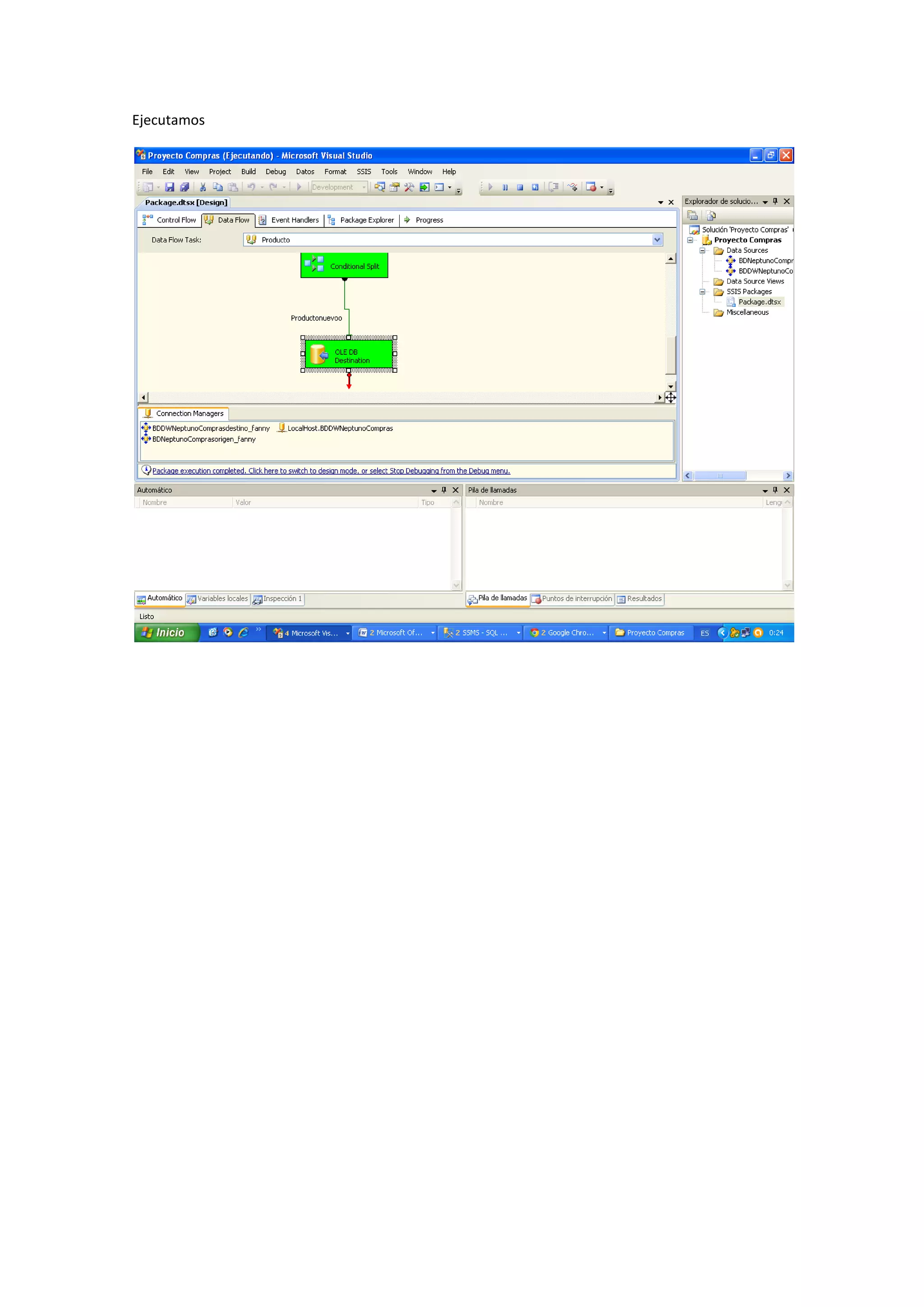

Este documento explica los procesos ETL (extracción, transformación y carga) involucrados en mover datos desde múltiples fuentes a un almacén de datos. Detalla las tres fases del proceso ETL y cómo se usan herramientas como Microsoft SQL Server y Visual Studio para extraer tablas de una base de datos origen, transformar los datos y cargarlos en tablas de una base de datos de destino. El documento también concluye resaltando la importancia de planificar y modelar correctamente el proceso ETL.