Principios Transmisión Información

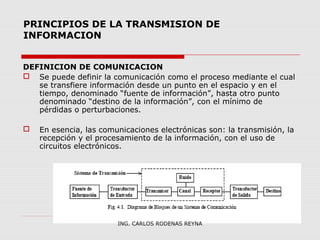

- 1. PRINCIPIOS DE LA TRANSMISION DE INFORMACION DEFINICION DE COMUNICACION Se puede definir la comunicación como el proceso mediante el cual se transfiere información desde un punto en el espacio y en el tiempo, denominado “fuente de información”, hasta otro punto denominado “destino de la información”, con el mínimo de pérdidas o perturbaciones. En esencia, las comunicaciones electrónicas son: la transmisión, la recepción y el procesamiento de la información, con el uso de circuitos electrónicos. ING. CARLOS RODENAS REYNA

- 2. Transmisión digital ING. CARLOS RODENAS REYNA

- 3. Radio digital El radio digital utiliza portadoras analógicas, al igual que los sistemas convencionales. Hay tres técnicas de modulación digital: ASK, FSK, PSK y QAM. ING. CARLOS RODENAS REYNA

- 4. Fuente de Información La información se define como conocimiento o datos comunicada o recibida. La información o inteligencia a transmitir se origina en la fuente de información. Esta información se materializa como un conjunto, que sin perder generalidad supondremos finito y discreto, de N símbolos o mensajes distintos e independientes cuyo significado es conocido en el destino del sistema. La fuente de información así definida se denomina “fuente discreta sin memoria”. Hay muchas clases de fuentes de información, incluyendo personas y máquinas, de manera que los símbolos o mensajes pueden tomar una gran variedad de formas: una secuencia de símbolos discretos o letras, una magnitud que varía en el tiempo, etc.; pero cualquiera que sea el mensaje, el propósito del sistema de comunicación es el de proporcionar una réplica más o menos exacta del mismo en el destino. ING. CARLOS RODENAS REYNA

- 5. Transductor de Entrada Como regla, el mensaje que produce la fuente no es de naturaleza eléctrica y, por lo tanto, es necesaria la presencia de un “transductor” o “codificador” que convierta el mensaje en una “señal”. Esta última es una magnitud eléctrica variable en el tiempo (corrientes o voltajes) compatible con el tipo particular de sistema de transmisión que se emplee. Nótese entonces la diferencia entre información, mensaje y señal: Información es la inteligencia o significado que se va a transmitir; es una entidad intangible. Mensaje es la materialización de la información en una cantidad mensurable: el mensaje es el soporte de la información. ING. CARLOS RODENAS REYNA

- 6. Señal es la magnitud eléctrica que resulta de la transformación de una magnitud no eléctrica portadora de información en una magnitud eléctrica variable en el tiempo. A este respecto, el número de elementos del conjunto de las señales de salida del transductor debe ser igual al número de elementos del conjunto de símbolos o mensajes de la fuente de información. La señal de salida del transductor se conoce también con el nombre de “señal mensaje”. El transductor de salida o “descodificador”, efectúa la operación inversa del transductor de entrada; es decir, reconvierte las señales eléctricas recibidas en los símbolos o mensajes correspondientes, los cuales son presentados al destinatario para su interpretación. ING. CARLOS RODENAS REYNA

- 7. Transmisor Aunque no deja de ser frecuente encontrar el transductor de entrada acoplado directamente al canal, como sucede, por ejemplo, en un sistema telefónico local, generalmente es necesario “modular” una señal sinusoidal con la señal del transductor de entrada, sobre todo para transmisión a gran distancia. La “modulación” es la variación sistemática de alguna característica de una señal, denominada “portadora”, en concordancia con la señal mensaje o “señal modulante”. Canal El canal de transmisión es el enlace eléctrico entre el transmisor y el receptor. Puede ser un par de conductores, un cable coaxial, una fibra óptica o sencillamente el espacio libre en el cual la señal se propaga en forma de una onda electromagnética. Al propagarse a través del canal, la señal transmitida se distorsiona debido a las no linealidades y/o las imperfecciones en la respuesta de frecuencia del canal. Otras fuentes de degradación son el “ruido” y la “interferencia” que recoge la señal a su paso por el canal. ING. CARLOS RODENAS REYNA

- 8. Receptor El objeto del receptor es el de extraer la señal deseada a partir de la señal degradada transmitida por el canal. Como las señales recibidas son en general débiles y plagadas de ruido, una primera operación del receptor es la amplificación y filtrado de dichas señales para poderlas procesar. Pero la operación fundamental del receptor es la “demodulación” o “detección”, que es el proceso inverso de la modulación en el transmisor. Debido a la degradación de la señal recibida, el receptor no puede reconstruir exactamente la señal original, aunque el tipo de degradación que resulta depende del sistema de modulación que se utilice. ING. CARLOS RODENAS REYNA

- 9. Ruido El término “ruido” se utiliza comúnmente para denominar aquellas señales que perturban la transmisión y procesamiento de señales en los sistemas de comunicación y sobre las cuales no se tiene un control completo. El ruido que afecta a un sistema de comunicación se clasifica en categorías dependiendo de su origen. Cuando el ruido proviene de los componentes del sistema tales como resistencias, tubos al vacío y dispositivos de estado sólido, se conoce como “ruido interno”. La segunda categoría de ruido resulta de fuentes externas al sistema de comunicación e incluye el ruido atmosférico, extraterrestre y el producido por el hombre; es el “ruido externo”. ING. CARLOS RODENAS REYNA

- 10. 1. Ruido Atmosférico. Producido por descargas eléctricas asociadas a las tormentas. Se conoce comúnmente como “estática”. Por debajo de los 100 MHz, la intensidad de campo es inversamente proporcional a la frecuencia. En el dominio del tiempo se caracteriza por impulsos de gran amplitud y poca duración; es un ruido de tipo impulsivo. Afecta más a la banda de frecuencias medias (radiodifusión) que a la banda de FM o TV. En la transmisión de datos es de particular importancia. 2. Ruido Extraterrestre. Incluye el debido al sol y otros cuerpos calientes del firmamento. Debido a su alta temperatura y proximidad a la tierra, el sol es una fuente intensa, pero afortunadamente localizada, de energía radiante en una amplia gama de frecuencias. Las estrellas son fuentes de energía radiante de banda ancha, que aunque más distantes y por ende menos intensas, por ser más numerosas son colectivamente importantes como fuentes de ruido. ING. CARLOS RODENAS REYNA

- 11. Radioestrellas, tales como quasares y pulsares, también contribuyen al ruido cósmico que en conjunto se extiende desde unos cuantos MHz hasta unos cuantos GHz. 3. Ruido producido por el hombre. Incluye las descargas por efecto corona en líneas de alta tensión, el producido por motores eléctricos, sistemas de diatermia, ruido de conmutación, etc. El ruido de conmutación y de sistemas de ignición es del tipo impulsivo tal como el ruido atmosférico. El debido al alumbrado fluorescente es un ruido muy frecuente en nuestro medio ambiente. ING. CARLOS RODENAS REYNA

- 12. Ancho de Banda y Potencia de Transmisión En los sistemas de transmisión existen dos parámetros de gran importancia: el ancho de banda del canal y la potencia transmitida. Los sistemas de comunicación deben diseñarse entonces para utilizar estos dos recursos en la forma más eficiente posible. En general, es difícil optimizar ambos recursos simultáneamente, pues en la mayoría de los canales de comunicación un recurso puede considerarse más importante o más escaso que otro. Se puede, por lo tanto, clasificar los canales como “limitados en potencia” o “limitados en ancho de banda”. ING. CARLOS RODENAS REYNA

- 13. Por ejemplo, los canales telefónicos son canales limitados en ancho de banda, mientras que un canal de microondas lo es en potencia. La meta ideal en el diseño de un sistema de comunicación es la de transmitir información a la máxima velocidad con el mínimo de potencia y ancho de banda. La utilización óptima y eficiente de estos recursos es el principal objetivo en el diseño de los sistemas de comunicación prácticos. ING. CARLOS RODENAS REYNA

- 14. CONCEPTO Y MEDIDA DE LA INFORMACION Consideremos un suceso A cualquiera. Cuanto menos se sepa de un suceso mayor será, digamos, nuestra sorpresa al conocer la realización del mismo. La ignorancia en cuanto al suceso es simplemente la incertidumbre que se tiene acerca de él. Al realizarse el suceso, la incertidumbre se convierte en certeza y hemos obtenido un conocimiento o recibido una información. Por consiguiente, podemos decir que: Cantidad de Incertidumbre = Cantidad de Información (1) Por otro lado, la magnitud de la incertidumbre depende del grado de probabilidad de ocurrencia del suceso A. Cuanto mayor sea la probabilidad de ocurrencia del suceso, menor será nuestra incertidumbre. ING. CARLOS RODENAS REYNA

- 15. En consecuencia, podemos decir que la incertidumbre acerca del suceso A es función de la probabilidad de que dicho suceso ocurra. Sea entonces U(A) = Incertidumbre acerca del suceso A I(A) = Información adquirida al realizarse el suceso A PA = Probabilidad de ocurrencia del suceso A Podemos escribir entonces de (1) que: U(A) = I(A) = f(PA) (2) En este sentido, la información es una medida de la incertidumbre. Por lo tanto, la información asociada con el conocimiento de que un suceso dado ha ocurrido, es una función de la probabilidad de ocurrencia de ese suceso. Se trata entonces de hallar la relación funcional f(PA). ING. CARLOS RODENAS REYNA

- 16. f(PA)≥ 0 donde 0 ≤ PA ≤ 1 Una condición esencial que la relación funcional f(PA) debe satisfacer, es la aditividad. En efecto, si se considera que el suceso A está formado por la intersección de dos sucesos independientes B y C cuyas probabilidades son PB y PC, respectivamente, entonces Si A = BC, f(PA)= f(PB)+f(PC) (3) La información es una magnitud positiva, de donde f(PA)≥ 0 donde 0 ≤ PA ≤ 1 (4) La probabilidad de un suceso cierto es 1, pero la información o incertidumbre será 0; de modo que podemos escribir: ING. CARLOS RODENAS REYNA

- 17. Por último, si la probabilidad de un suceso A es menor que la probabilidad de un suceso B, debe verificarse que: f(PA)> f(PB) para PA < PB (6) Hartley demostró que la única relación funcional que satisface las condiciones (3) a (6) es una función logarítmica de la forma La solución más sencilla es aquella cuando se selecciona uno de dos mensajes o símbolos, en cuyo caso b = 2. La unidad de información se denomina entonces “bit” (contracción inglesa de “binary digit”) I(A) es la cantidad de información, en bits, asociada con un suceso A cuya probabilidad de ocurrencia es PA. ING. CARLOS RODENAS REYNA

- 18. La cantidad de información definida en la ecuación I(A) ha sido obtenida para un solo mensaje y no es apropiada para describir una fuente que produce un conjunto de diferentes mensajes. La caracterización matemática de un sistema de comunicación generalizado ha producido un cierto número de aspectos importantes, entre los cuales se tiene: 1. La información promedio contenida en un mensaje dado. 2. La velocidad a la cual una fuente produce la información. 3. La capacidad de un canal para manejar o transportar esa información 4. La codificación de los mensajes para optimizar los tres aspectos anteriores. ING. CARLOS RODENAS REYNA

- 19. Entropía Consideremos una fuente discreta que produce N símbolos o mensajes {x1, x2, x3, ..., xN} distintos e independientes, con probabilidades de ocurrencia correspondientes {P1, P2, P3, ....,PN}, donde Pi ≠ Pj , i ≠ j. Desde un punto de vista probabilístico, el conjunto discreto de N símbolos o mensajes producidos por la fuente se puede considerar como un proceso aleatorio discreto; es entonces un conjunto de N variables aleatorias, cada una de las cuales toma valores en el conjunto {x1, x2, x3,..,xN} con probabilidades {P1 , P2 , ......., PN}. De la definición de la probabilidad, debe cumplirse que ING. CARLOS RODENAS REYNA

- 20. Cuando se transmite un mensaje cualquiera x j, la información asociada es Ij = log2(1/Pj) bits. Supongamos que se transmite una larga secuencia de L mensajes o símbolos, donde L >> 1. En esta secuencia, el símbolo j-ésimo ocurrirá aproximadamente LPj veces y la información asociada será LPjIj bits. La información total contenida en la secuencia será, aproximadamente, La información promedio, en bits por símbolo (bits/símb), será entonces la información total de la secuencia dividida por el número de símbolos de la misma. Esta información promedio normalmente se representa con la letra H. H: entropía de la fuente ING. CARLOS RODENAS REYNA

- 21. La entropía de la fuente, o información promedio asociada con la fuente, significa que aunque no se pueda decir con certeza qué mensaje se va a producir, se espera obtener en promedio H bits de información por mensaje, o LH bits en una secuencia de L mensajes, si L es grande. H es máxima cuando las probabilidades de ocurrencia de los símbolos son iguales, es decir, cuando P1 = P2 = P3 = ...... = PN = 1/N. En este caso, HMAX = log2 N En consecuencia, la entropía está acotada por 0 ≤ H ≤ log2 N donde N es el número de símbolos o mensajes producidos por la fuente. ING. CARLOS RODENAS REYNA

- 22. Ejemplo Entropía de una Fuente Binaria. Sea una fuente binaria (N = 2). Las probabilidades de los símbolos son p y (1−p), respectivamente. Por consiguiente, En la Fig. se grafica H vs p Nótese que si p = ½, entonces H = 1 bit, valor que corresponde al pico de la curva. ING. CARLOS RODENAS REYNA

- 23. EJEMPLO Una fuente produce cuatro símbolos A, B, C y D cuyas probabilidades son, respectivamente, 0,5; 0,25; 0,125 y 0,125. La entropía de la fuente será H=0,5log22+0,25log24+2x0,15log28=1,75 bits/símbolo Si los símbolos fueran equiprobables, esto es, si p = ¼, entonces H=log24=2 bits/símbolo Nótese que la entropía H es máxima cuando los símbolos son equiprobables. ING. CARLOS RODENAS REYNA

- 24. Ejemplo Consideremos la información producida por una máquina de escribir de 26 letras y el espacio entre letras; en otras palabras, la fuente produce 27 símbolos. Si todos los símbolos tuvieran la misma probabilidad, HMAX = log2 27 = 4.755 bits/letra. Esta es la máxima información que la máquina de escribir puede generar. Pero en el idioma español las letras tienen diferentes probabilidades de ocurrencia en un texto. Por ejemplo, la letra E es la que ocurre con más frecuencia. Se ha determinado experimentalmente que la información promedio asociada con una letra es de aproximadamente 4.2 bits. Asimismo, una palabra tiene, en promedio, 5 letras y un contenido de información de 9.3 bits. ING. CARLOS RODENAS REYNA