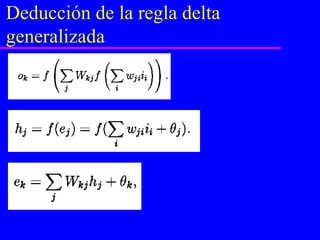

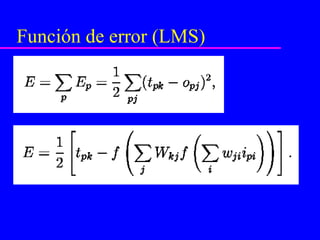

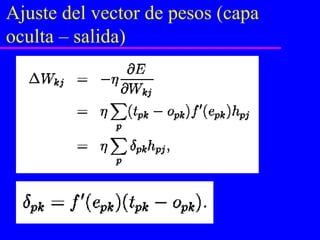

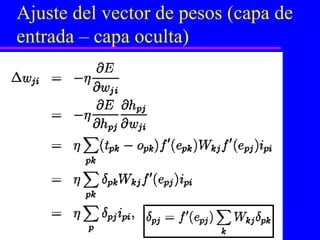

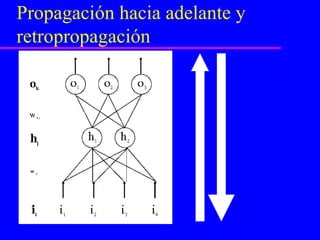

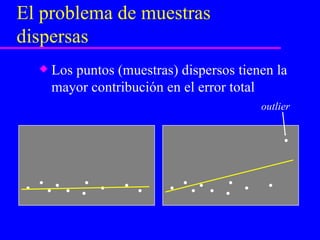

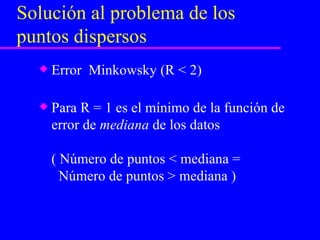

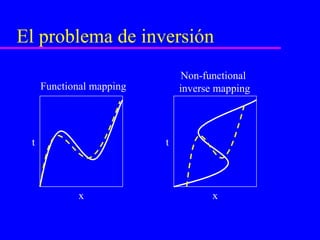

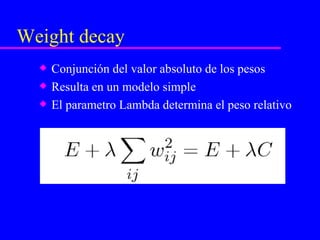

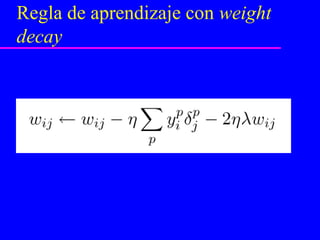

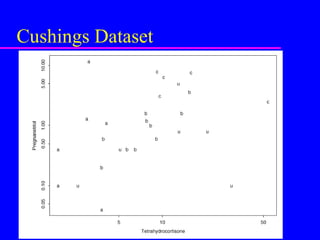

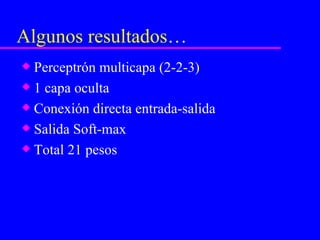

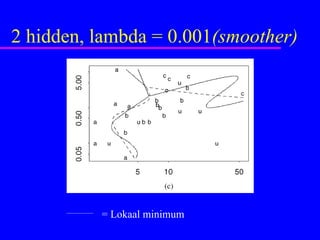

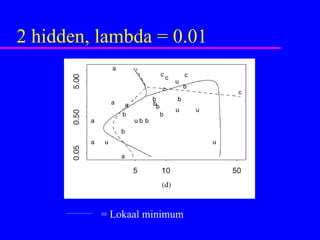

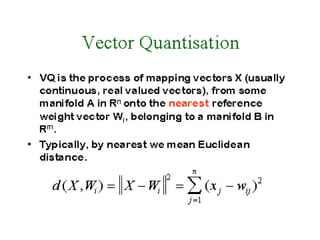

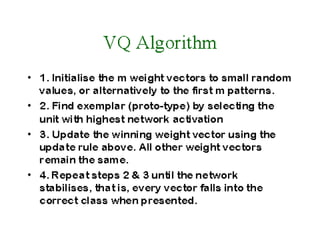

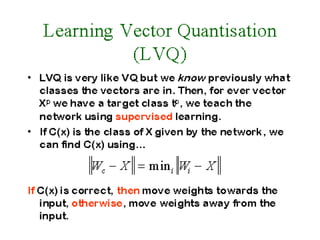

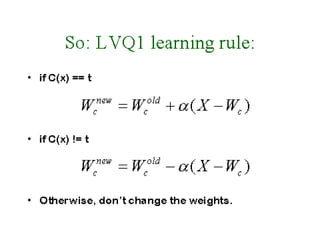

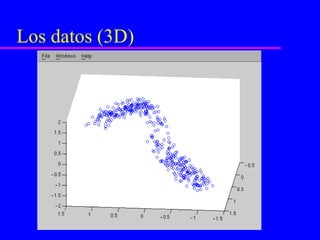

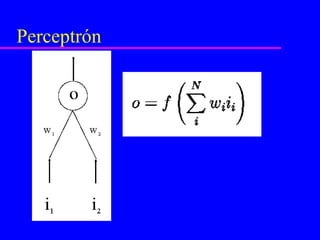

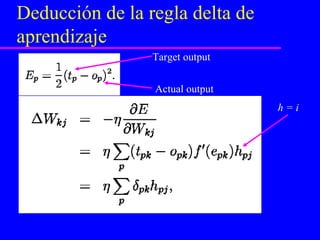

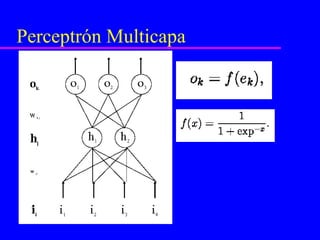

Este documento trata sobre diferentes técnicas de aprendizaje automático y redes neuronales como perceptrones, redes neuronales multicapa, Learning Vector Quantisation, Self-Organising Feature Maps y Multidimensional Scaling. Explica conceptos como la propagación hacia adelante y hacia atrás, el problema de muestras dispersas, weight decay y aplica estas técnicas a datos clínicos usando Matlab.

![Función sigmoidal Puede ser también tanh (<-1,+1> ipv <0,1>) Obteniendo f’(x) = f(x) [1 – f(x)]](https://image.slidesharecdn.com/2lvq-090922060017-phpapp01/85/Learning-Vector-Quantization-LVQ-6-320.jpg)