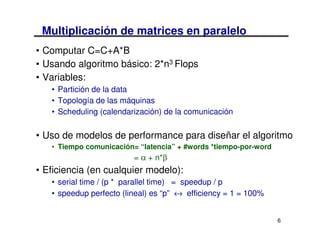

Este documento resume las operaciones paralelas con matrices densas y el algoritmo de Cannon para la multiplicación de matrices. En 3 oraciones o menos:

El documento describe diferentes particiones de datos para operaciones paralelas con matrices densas, incluidas particiones de bloques y cíclicas de filas y columnas. También explica el algoritmo de Cannon para la multiplicación paralela de matrices, el cual mueve bloques de las matrices A y B para alinear los datos y permitir la multiplicación en paralelo de todos los procesadores.