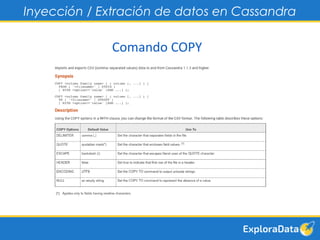

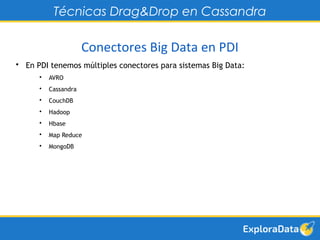

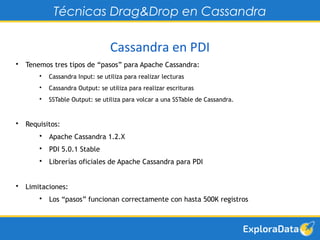

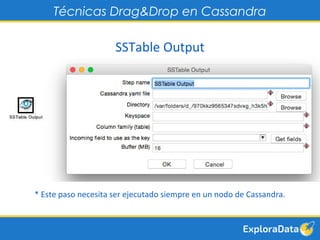

Este documento describe varias técnicas para la inyección y extracción de datos en sistemas de Big Data como Apache Cassandra, incluyendo el uso de herramientas como COPY, Sqoop, Flume, SSTableLoader y Pentaho Data Integration. También explica cómo Pentaho permite realizar ETL de manera gráfica mediante conectores para sistemas como Cassandra.