1. Tema Nº 2 (Apuntes).pptx simplex regresion

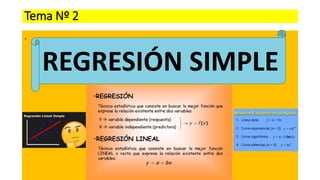

- 1. Tema Nº 2 . REGRESIÓN SIMPLE

- 2. Aprende y Verifica Tema: Regresión Lineal Es una técnica utilizada para estudiar la relación entre dos variables, adicional permite predecirlas. Y=AX+B +ε

- 8. Clases de regresión lineal: . Clases de regresión lineal: Regresión lineal simple Regresión lineal multiple

- 9. Regresión Lineal Simple Modelo de Regresión Lineal Simple: , = Parámetros Poblacionales (Intercepto, Pendiente) i =Término de Error (Término de Perturbación Aleatoria) 1 1 2 2 ( ,Y),( ,Y ),...,( ,Y ) n n X X X = Muestra n= Tamaño de la Muestra

- 10. Modelo de Regresión Lineal Simple Hipótesis básicas: 1. El término de error es una variable aleatoria con media cero: 2. Homoscedasticidad: La varianza del término de error es una constante: 3. Los errores se distribuyen normalmente: 4. Los errores son independientes entre sí. 5. No hay autocorrelación, ( ) 0 i E 2 2 ( ) ( ) i i V E 2 ~ 0, i N ( , ) 0, ( ) i j E i j

- 11. Hipótesis básicas Las hipótesis anteriores pueden formularse de manera equivalente en términos de la variable criterio:

- 12. MODELO LINEAL SIMPLE Supuestos del modelo lineal: Formalmente estos requisitos o supuestos se expresan así: Gráficamente algunos de estos supuestos en datos muy simples pueden ilustrarse de esta manera:

- 13. MODELO LINEAL SIMPLE Gráficamente algunos de estos supuestos en datos muy simples pueden ilustrarse de esta manera:

- 14. Regresión lineal simple • Gráfica tridimensional: Homoscedasticidad i X ( ) f

- 15. Estimación por Mínimos Cuadrados • La distribución normal de Y:

- 16. Estimación de Y por M.C.O. Como: El Método de M.C.O. consiste en minimizar la Suma de Residuos Cuadrados: Minimizar: 2 2 2 2 1 1 1 1 ˆ ˆ ˆ ˆ ˆ ( ) ( ( )) ( ) n n n n i i i i i i i i i i i e Y Y Y X Y X G

- 17. Recta de regresión y resíduos Gráfica en el plano: ˆ ˆ ˆ i i Y X ( ) i i E Y X ( ) i i i Y E Y X Y 0 ˆ i i i e Y Y X Y i X i Y

- 18. Estimación de Y por M.C.O. Condición Necesaria: Entonces: 1 1 ˆ ˆ 2 (Y )( 1) 0 ˆ ˆ ˆ 2 (Y )( ) 0 ˆ n i i i n i i i i G X G X X 1 1 2 1 1 1 ˆ ˆ ˆ ˆ n n i i i i n n n i i i i i i i Y n X Sistema de Ecuaciones Normales X Y X X Minimizar: 2 2 2 2 1 1 1 1 ˆ ˆ ˆ ˆ ˆ ( ) ( ( )) ( ) n n n n i i i i i i i i i i i e Y Y Y X Y X G

- 19. Estimación de Y por M.C.O. Resolviendo el SEN: Condición suficiente: Supuesto que se cumple la condición de 2º orden de Mín. G; por tanto, son los estimadores de M.C.O. de 1 1 1 2 2 1 1 ( )( ) ˆ . . . ( ) ˆ ˆ n n n i i i i i i i n n i i i i n X Y X Y Estimadores M C O n X X Y X ˆ ˆ ( , ) ( , )

- 20. Estimación de Y por M.C.O. Condición suficiente: Se define la matriz hessiana: , , Como, Por tanto, son estimadores mínimo cuadráticos ordinarios de ˆ ˆ ( , ) ( , ) 2 2 2 ˆ G n 2 2 2 1 2 ˆ n i i G X 2 2 1 2 ˆ ˆ ˆ ˆ n i i G G X 2 2 2 2 1 2 2 2 2 1 1 2 2 1 1 2 2 ˆ ˆ ˆ 4 4 4 2 2 ˆ ˆ ˆ n i n n i i i n n i i i i i i G G n X n X X nS G G X X 2 1 2 . ˆ ˆ 2 0 4 0 ( , ) Mín n y nS G para ˆ ˆ ˆ , 1,2,..., i i Y X i n

- 21. Estimadores de M.C.O. En términos de desvíos: Si: Entonces: , i i i i x X X y Y Y 2 2 2 2 1 1 1 2 2 2 2 1 1 1 1 1 1 ( ) (Y ) ( )(Y ) n n n i i i i i i n n n i i i i i i n n n i i i i i i i i i x X X X nX y Y Y nY x y X X Y X Y nXY

- 22. Estimadores de M.C.O. • Por tanto, los estimadores M.C.O. en términos de desvíos son: 1 2 1 ˆ ˆ ˆ n i i i n i i x y x Y X ˆ ˆ ˆ , 1,2,..., i i Y X i n

- 23. Interpretación de los coeficientes de regresión ¿Qué nos indican los valores de los coeficientes?: = ORDENADA AL ORIGEN (intercepto): Indica el valor promedio de la variable respuesta Y cuando X es cero. Si se tiene certeza de que la variable predictora X no puede asumir el valor cero, entonces la interpretación no tiene sentido. ̂ =PENDIENTE: Indica el cambio promedio en la variable respuesta Y cuando X se incrementa en una unidad. Si = 0 entonces = . La media de los datos es el estimador de mínimos cuadrados cuando no hay variables regresoras. ̂ ̂ Y

- 24. Interpretación de los coeficientes de regresión Valores que puede tomar β: Ejemplos que muestran el vínculo directo entre el valor de β y el tipo de relación existente entre las variables:

- 25. Interpretación de los coeficientes de regresión Covarianza y coeficiente de correlación:

- 26. Interpretación de los coeficientes de regresión Covarianza: La covarianza entre dos variables, nos indica si la posible relación entre dos variables es directa o inversa: • Directa o positiva: • Inversa o negativa: 2 ˆ XY X S S 2 2 1 1 n X i i S x n 1 1 n XY i i i S x y n Varianza Covarianza 0 XY S 0 XY S 0 XY S 0 XY S

- 27. Estimadores de M.C.O. • No hay relación lineal: 0 XY S

- 28. Estimadores de M.C.O. Correlación: El coeficiente de correlación lineal de Pearson es una medida adimensional de la variación conjunta de dos variables. Se define como: XY XY X Y S r S S 2 2 1 1 n X i i S x n 2 2 1 1 n Y i i S y n Varianza de X Varianza de Y 1 1 n XY i i i S x y n Covarianza

- 29. MODELO LINEAL SIMPLE El procedimiento usual para determinar la ecuación de regresión cuando se tiene una muestra es el siguiente: 1. Calcular la media aritmética de cada variable de la muestra. 2. Calcular las variaciones simples y cuadradas. 3. Calcular la desviación estándar de cada variable de la muestra. 4. Calcular el valor de la pendiente ( ) 5. Calcular el valor del intercepto ( ) 6. Construir la ecuación con los valores resultantes. 7. Trazar la recta sobre el diagrama de dispersión. ̂ ̂

- 30. MODELO LINEAL SIMPLE Ejemplo: Una cadena de Pizzerías toma una muestra de diez de sus sucursales para tratar de encontrar un modelo matemático que le permita predecir sus ventas y obtuvo los siguientes datos: Se pide: Determinar una regresión lineal simple para estimar las ventas de dos sucursales que tienen 14,000 y 30,000 personas como potenciales clientes respectivamente. Sucursal Población de personas Ventas trimestrales en miles en miles de pesos 1 2 58 2 6 105 3 8 88 4 8 118 5 12 117 6 16 137 7 20 157 8 20 169 9 22 149 10 26 202

- 31. MODELO LINEAL SIMPLE Resolución: Sea Donde: X: Población de personas en miles Y: Ventas trimestrales en miles de pesos n=10 sucursales Su estimador: Sucursal X Y X² Y² XY 1 2 58 4 3364 116 2 6 105 36 11025 630 3 8 88 64 7744 704 4 8 118 64 13924 944 5 12 117 144 13689 1404 6 16 137 256 18769 2192 7 20 157 400 24649 3140 8 20 169 400 28561 3380 9 22 149 484 22201 3278 10 26 202 676 40804 5252 Σ 140 1300 2528 184730 21040 Medias 14 130 1,2,..., i i i Y X i n ˆ ˆ 1,2,..., i i Y X i n

- 32. MODELO LINEAL SIMPLE Graficar los datos en un diagrama de dispersión y determinar la posible relación entre las variables X e Y.

- 33. MODELO LINEAL SIMPLE Calculo de la pendiente. Calculo de la ordenada al origen. Obtener la ecuación que mejor se ajuste. 1 1 1 2 2 2 1 1 10(21040) 140(1300) ˆ 5 10(2528) (140) ( ) n n n i i i i i i i n n i i i i n X Y X Y n X X ˆ ˆ 130 5(14) 60 Y X ˆ ˆ ˆ , 1,2,..., i i Y X i n ˆ 60 5 , 1,2,...,10 i i Y X i

- 34. MODELO LINEAL SIMPLE Para una X = 14,000: Para una X = 30,000: En términos de desvíos: ˆ 60 5(14) 130 i Y ˆ 60 5(30) 210 i Y ˆ 130,000 i Y pesos ˆ 210,000 i Y pesos 2 2 2 2 2 1 1 1 2 2 2 2 2 1 1 1 1 1 1 ( ) 2528 10(14) 568 (Y ) 184730 10(130) 15730 ( )(Y ) 21040 10(14)(130) 2840 n n n i i i i i i n n n i i i i i i n n n i i i i i i i i i x X X X nX y Y Y nY x y X X Y X Y nXY

- 35. MODELO LINEAL SIMPLE En términos de desvíos: Interpretación: Sugiere que, sin clientes la pizzería podría obtener en sus ventas 60 pesos. Indica que, en promedio, a cada incremento de una unidad de clientes (Xi) le corresponde un incremento en las ventas de 5 pesos (Yi) ˆ 60 5 , 1,2,...,10 i i Y X i 1 2 1 2840 ˆ 5 568 n i i i n i i x y x ˆ ˆ 130 5(14) 60 Y X ˆ 60 ˆ 5

- 36. MODELO LINEAL SIMPLE Trazar la línea estimada. ˆ 60 5 , 1,2,...,10 i i Y X

- 37. MODELO LINEAL SIMPLE RECAPITULEMOS: Hasta aquí: 1. Planteamos el Modelo de regresión lineal homoscedástico. 2. Presentamos estimadores de mínimos cuadrados ordinarios para la pendiente y la ordenada al origen. - ¿Cómo se obtienen los estimadores? →Método de Mínimos Cuadrados Ordinarios. En lo que sigue: 3. Estimaremos σ², la varianza común a las distintas poblaciones. 4. Obtendremos el error estándar de y el de para construir: • Test de hipótesis para y • Intervalos de confianza para y 5. Construiremos la Tabla de Análisis de Varianza [ANalysis Of VAriance(ANOVA)]. ̂ ̂

- 38. MODELO LINEAL SIMPLE Ecuación en directas, diferenciales y típicas: La ecuación de regresión puede expresarse de formas diferentes según el tipo de puntuaciones de las que partimos para estimarla. En la siguiente tabla se presentan las ecuaciones de la recta en sus diferentes modalidades según el tipo de puntuaciones de las que parten y la forma de calcular sus correspondientes parámetros. https://personal.us.es/avelarde/analisisdos/regresionsimple.pdf PUNT. DIRECTAS PUNT. DIFERENCIALES PUNT. TÍPICAS ˆ ˆ ˆ Y X ˆ ( ) ( ) i i i Y Y X X e iY XY iX i Z r Z e ˆ Y XY X S r S ˆ ˆ Y X 1 2 1 ˆ n i i i n i i x y x ˆ 0 1 1 n iX iY i r Z Z n i iX X X X Z S i iY Y Y Y Z S

- 39. MODELO LINEAL SIMPLE Ejemplo: Suponga que los resultados de medir a 8 sujetos en las variables horas de estudio empleadas en una asignatura (X) y su nota en la misma -de 0 a 10- (Y) han sido las siguientes: A continuación se tiene en el caso de que los datos Y se toman en la escala -de 0 a 20- (Y): Halle las ecuaciones de la recta en sus diferentes modalidades según el tipo de puntuaciones de las que parten y la forma de calcular sus correspondientes parámetros. Sujetos 1 2 3 4 5 6 7 8 X 4 5 7 12 10 9 8 3 Y 3 5 8 10 9 9 8 2 Sujetos 1 2 3 4 5 6 7 8 X 4 5 7 12 10 9 8 3 Y 6 10 16 20 18 20 16 4

- 40. MODELO LINEAL SIMPLE Solución: Totales en términos de desvíos: ESCALA DE 0 A 10 (Y) Sujetos X Y X² Y² XY 1 4 3 16 9 12 2 5 5 25 25 25 3 7 8 49 64 56 4 12 10 144 100 120 5 10 9 100 81 90 6 9 9 81 81 81 7 8 8 64 64 64 8 3 2 9 4 6 Σ 58 54 488 428 454 Medias 7.25 6.75 D.T. 3.11 3.01 ESCALA DE 0 A 20 (Y) Sujetos X Y X² Y² XY 1 4 6 16 36 24 2 5 10 25 100 50 3 7 16 49 256 112 4 12 20 144 400 240 5 10 18 100 324 180 6 9 20 81 400 180 7 8 16 64 256 128 8 3 4 9 16 12 Σ 58 110 488 1788 926 Medias 7.25 13.75 D.T. 3.11 6.27 Σx² = 67.5 Σy² = 63.5 Σxy = 62.5 Σx² = 67.5 Σy² = 275.5 Σxy = 128.5 2 1 1 1 (67.5) 3.105295017 1 7 n X í i S x n 2 1 1 1 (63.5) 3.011881235 1 7 n Y í i S y n 2 1 1 1 (67.5) 3.105295017 1 7 n X í i S x n 2 1 1 1 (275.5) 6.273527147 1 7 n Y í i S y n 62.5 8.928571429 1 7 XY xy S n 128.5 18.35714286 1 7 XY xy S n 8.928571429 0.9546436064 3.105295017(3.0118812359) XY X Y S r S S 18.35714286 0.9423027091 3.105295017(6.273527147) XY X Y S r S S

- 41. MODELO LINEAL SIMPLE . ESCALA DE 0 A 10 (Y) Sujetos X Y X² Y² XY Zx Zy ZxZy Σx² = 67.5 1 4 3 16 9 12 -3.25 10.5625 -3.75 14.0625 -1.04659943 -1.24506901 1.30308852 Σy² = 63.5 2 5 5 25 25 25 -2.25 5.0625 -1.75 3.0625 -0.72456884 -0.58103221 0.42099783 Σxy = 62.5 3 7 8 49 64 56 -0.25 0.0625 1.25 1.5625 -0.08050765 0.415023 -0.03341253 4 12 10 144 100 120 4.75 22.5625 3.25 10.5625 1.52964532 1.07905981 1.6505788 Sx = 3.105295017 5 10 9 100 81 90 2.75 7.5625 2.25 5.0625 0.88558413 0.74704141 0.66156802 Sy = 3.011881235 6 9 9 81 81 81 1.75 3.0625 2.25 5.0625 0.56355354 0.74704141 0.42099783 7 8 8 64 64 64 0.75 0.5625 1.25 1.5625 0.24152295 0.415023 0.10023758 0.925925926 8 3 2 9 4 6 -4.25 18.0625 -4.75 22.5625 -1.36863003 0.415023 -0.56801295 0.037037037 Σ 58 54 488 428 454 0 67.5 0 63.5 3.95604311 Medias 7.25 6.75 D.T. 3.11 3.01 X X 2 ( ) X X Y Y 2 ( ) Y Y ̂ ̂ ESCALA DE 0 A 20 (Y) Sujetos X Y X² Y² XY Zx Zy ZxZy Σx² = 67.5 1 4 6 16 36 24 -3.25 10.5625 -7.75 60.0625 -1.04659943 -1.23534972 1.29291631 Σy² = 275.5 2 5 10 25 100 50 -2.25 5.0625 -3.75 14.0625 -0.72456884 -0.59774986 0.43311092 Σxy = 128.5 3 7 16 49 256 112 -0.25 0.0625 2.25 5.0625 -0.08050765 0.35864992 -0.02887406 4 12 20 144 400 240 4.75 22.5625 6.25 39.0625 1.52964532 0.99624977 1.52390881 Sx = 3.105295017 5 10 18 100 324 180 2.75 7.5625 4.25 18.0625 0.88558413 0.67744985 0.59993884 Sy = 6.273527146 6 9 20 81 400 180 1.75 3.0625 6.25 39.0625 0.56355354 0.99624977 0.56144009 7 8 16 64 256 128 0.75 0.5625 2.25 5.0625 0.24152295 0.35864992 0.08662218 1.903703704 8 3 4 9 16 12 -4.25 18.0625 -9.75 95.0625 -1.36863003 -1.55414965 2.12705587 -0.051851852 Σ 58 110 488 1788 926 0 67.5 0 275.5 6.59611896 Medias 7.25 13.75 D.T. 3.11 6.27 X X 2 ( ) X X Y Y 2 ( ) Y Y ̂ ̂ ̂

- 42. MODELO LINEAL SIMPLE Solución: Se tiene las ecuaciones en diferenciales y típicas de los datos de la investigación que nos ocupa donde se correlaciona el número de horas invertidas en el estudio de una asignatura y la nota obtenida (en escala de 0 a 10 y en otra escala de 0 a 20). Observemos que el parámetro β de las rectas de regresión para el cambio de escala de la variable Y difiere cuando se estiman dichas rectas en puntuaciones directas y diferenciales (lo que podría apreciarse por sus diferentes inclinaciones si las representásemos gráficamente). El parámetro β es más grande cuando la escala tiene un rango mayor, es decir, se espera un cambio mayor en Y – notas- por cada hora más de estudio cuando la escala es de rango más amplio que cuando su rango es menor. La diferencia entre diferenciales y directas radica en el parámetro a (ordenada en el origen) que queda igualado a 0 en el caso de las diferenciales. Tipo de Puntuaciones Valores Y (Escala de 0 a 10) Valores Y (Escala de 0 a 20) Directas Diferenciales Típicas 0.037 0.926 i i Y X 0.052 1.904 i i Y X 0.926 i i y x 1.904 i i y x 0.955 iY iX Z Z 0.942 iY iX Z Z

- 43. MODELO LINEAL SIMPLE NOTAS: 1. La recta de regresión de X en Y; es decir, X variable dependiente de Y está dada por: * * ˆ ˆ X Y Siendo, * 2 ˆ XY Y S S y * ˆ ˆ * X Y Esta recta de regresión de X en Y se puede escribir también como: ˆ *( ) X X Y Y ó 1 ( ) ˆ * Y Y X X Observar que también pasa por el punto , X Y . 2 1 X ˆ Y X S r S

- 44. MODELO LINEAL SIMPLE NOTAS: Los coeficientes de regresión ˆ y ˆ * verifican: 2 2 2 ˆ ˆ* XY XY XY XY X Y X Y X Y S S S S rr r S S S S S S El número 2 r es denominado coeficiente de determinación. Comparando las rectas de regresión: 1 ˆ : ( ) L Y Y X X de Y en X, 2 1 : ( ) ˆ * L Y Y X X de X en Y resulta que, son coincidentes si ˆ ˆ* 1 ó si 2 1 r . Por otra parte, 0 r , significa que 1 2 ( ) L ó L es paralela al eje X, 2 1 ( ) L ó L es paralela al eje Y y perpendiculares entre sí en el punto común ( , ) X Y . En consecuencia, si 0 r , las rectas 1 L y 2 L tienen a ser perpendiculares y si 1 r ó 1 r , las rectas 1 L y 2 L tienden a ser coincidentes. 4 3 tienden

- 45. PROPIEDADES DE LOS E.M.C.O. . PROPIEDADES DE LOS E.M.C.O. son Linealidad Insesgadez Consistencia Eficiencia ˆ ˆ, Suficiencia

- 46. Propiedades de los E.M.C.O. 1) LINEALIDAD es un estimador lineal de . Es decir, es un estimador lineal de . Es decir, ,donde: ̂ 1 ˆ n i i i k Y 2 1 i i n i i x k x Ponderación 1 2 2 1 1 1 1 , . 0 1 1 i i n i i n i n i i i n n i i i i i i Como las X no son estocásticas las k tampoco lo son k k x k x k X Donde Propiedades: ̂ 1 ˆ n i i i wY 1 i i w X k n

- 47. Propiedades de los E.M.C.O. 2) INSESGADEZ: es un estimador insesgado de . Es decir, es un estimador insesgado de . Es decir, Nota: Algunas relaciones de fórmulas: ̂ ̂ ˆ ( ) E ˆ ( ) E 1 ˆ n i i i k 1 ˆ n i i i w

- 48. Propiedades de los E.M.C.O. 3) Varianza – Covarianza de los estimadores M.C.O.: La varianza de es: La varianza de es: La covarianza de es: ̂ 2 2 1 ˆ ( ) n i i V x ̂ 2 2 1 2 1 ˆ ( ) n i i n i i X V n x ˆ ˆ, 2 2 1 ˆ ˆ ( , ) n i i X Cov x 2 ˆ ˆ ˆ ( ) ( ) V E E 2 ˆ ˆ ˆ ( ) ( ) V E E ˆ ˆ ˆ ˆ ˆ ˆ ( , ) ( ( ))( ( )) Cov E E E Definición de varianza – covarianza:

- 49. Distribución de los E.M.C.O. Para efecto de hacer inferencia en regresión, se requiere asumir que . En consecuencia, también las Se puede establecer que: 2 ~ (0, ) i N 2 ~ ( ), i i Y N X 2 2 1 ˆ ~ , n i i N x 2 2 1 2 1 ˆ ~ , n i i n i i X N n x y y 2 2 1 ˆ ~ (0,1) n i i Z N x 2 2 1 2 1 ˆ ~ (0,1) n i i n i i Z N X n x

- 50. Propiedades de los residuales Los residuales son las desviaciones de los valores observados de la variable respuesta con respecto a la línea de regresión. a) La suma de los residuales es 0. Es decir, b) c) 1 0 n i i e 1 0 n i i i e x 1 ˆ 0 n i i i eY ˆ i i i e Y Y Residuo:

- 51. Estimación de la varianza de los residuos Teorema: El estimador insesgado de es: es también llamado el Cuadrado medio del Error (MSE). Para fines de cálculo: 2 2 2 1 1 ˆ 2 n i i e n 2 2 ˆ ( ) S 2 2 1 1 1 ˆ ˆ 2 n n i i i i i y x y n 2 2 2 2 1 1 1 ˆ ˆ 2 n n i i i i y x n 2 2 1 1 ˆ ˆ ( ) 2 n i i i Y Y n

- 52. Error Estándar de Estimación . Mide la variabilidad o dispersión de los valores observados alrededor de la línea de regresión. CME n SCE n Y Y S i i e 2 2 ˆ 2 e S Mayor es la dispersión e S Si

- 53. Estimadores de la varianza – covarianza de los estimadores M.C.O. • Estimador de la varianza de : • Estimador de la varianza de : • Estimador de la covarianza de : ̂ 2 2 ˆ 2 1 ˆ ˆ ˆ( ) n i i S V x ̂ 2 2 2 1 ˆ 2 1 ˆ ˆ ˆ ( ) n i i n i i X S V n x 2 2 1 ˆ ˆ ˆ ˆ Cov( , ) n i i X x ˆ ( 2) ( ) 2 2 1 ˆ ~ ˆ n n i i T t x ˆ ( 2) ( ) 2 2 1 2 1 ˆ ~ ˆ n n i i n i i T t X x ˆ ˆ, Error estándar 2 ˆ 2 1 ˆ n i i S x 2 2 1 ˆ 2 1 ˆ n i i n i i X S x

- 54. Propiedades de los E.M.C.O. 4) Eficiencia Teorema(Teorema de GAUS-MARKOV):Dentro de la clase de estimadores lineales insesgados de α y β, los estimadores M.C.O. ( ) tienen Mínima Varianza. Dem. : Para ejercicio Por lo mismo, los estimadores M.C.O. son: M.E.L.I.: “Mejores Estimadores Lineales Insesgados” E.L.I.O.: “Estimadores Lineales Insesgados Óptimos” o ˆ ˆ,

- 55. Propiedades de los E.M.C.O. 5) CONSISTENCIA: A mayor tamaño muestral, menos probabilidad de que el estimador se aleje del valor poblacional (propiedad asintótica). Esto es, ˆ n P Lím ˆ n P Lím

- 56. MEDIDAS DE LA BONDAD DE AJUSTE Obtener medidas que nos indiquen la confiabilidad de la recta de regresión Medidas de la Bondad de Ajuste Mide la bondad Con la cual La línea de regresión Se ajusta

- 57. MEDIDAS DE LA BONDAD DE AJUSTE Obtener medidas que nos indiquen la confiabilidad de la recta de regresión Medidas de la Bondad de Ajuste Mide la bondad Con la cual La línea de regresión Se ajusta

- 58. . e S Medidas de la Bondad Del Ajuste Ajuste Absoluto Ajuste Relativo Error Estándar de la Estimación Coeficiente de determinación 2 r Esquema de las Medidas de la Bondad del Ajuste

- 59. (X1,Y1) (X2,Y2) (X3,Y3) ) ( 2 Y Y ) ˆ ( 2 Y Y Y DESVIACION TOTAL DESVIACION NO EXPLICADA DESVIACION EXPLICADA ˆ ˆ ˆ Y X X Y 0 ˆ ( ) Y Y

- 60. Para obtener las fórmulas de las medidas de la Bondad de Ajuste 2 ,r Se Medidas de Variabilidad ANALISIS DE REGRESION Obtener medidas que nos indiquen la confiabilidad de la recta de regresión

- 62. Variación total = Variación no explicada + Variación Explicada 2 2 ˆ ˆ 2 Y Y Y Y Y Y i i i i Suma De Cuadrados Total SCT Suma De Cuadrados Del Error SCE Suma De Cuadrados De La Regresión SCR

- 63. SCR SCT Y Y SCE X n X Y Y SCR Y n Y Y Y SCT i i i i i i 2 2 2 2 1 2 2 2 2 ˆ ˆ ˆ El error estándar de la estimación se basa en el valor de SCE Coeficiente de determinación se basa en la magnitud relativa de SCR e S 2 r

- 64. Coeficiente de Determinación 2 r SCT SCR r2 Obtiene la cantidad relativa de la variación de la variable dependiente Y explicada por la variable independiente X. SCT SCE SCT SCR 1 Interpretación de R²: R² indica qué porcentaje de la variabilidad de la variable respuesta Y es explicada por su relación lineal con X.

- 65. Características de • El coeficiente de determinación es un cociente de dos sumas de cuadrados entonces no puede ser negativa. • SCR es menor o igual a SCT, el coeficiente de determinación está dado entre los intervalos 0 y 1: • Si el coeficiente es cero indica que no existe relación lineal entre las variables X e Y, lo cual significa que ninguna parte de la variación de Y, está explicada por X, el valor de r2 va a ser = 0 cuando SCR = 0 y SCE=SCT. • Un r2=1 indica una relación lineal perfecta entre las variables X e Y, y todos los puntos observados están sobre la recta de regresión muestral, SCE= 0 y SCR=SCT, el ajuste perfecto. 2 0 1 r 2 r

- 66. EJEMPLO La empresa paraíso analiza la relación entre el consumo de energía (en miles de KWH) y el número de habitaciones en una residencia privada unifamiliar. En una muestra aleatoria de 10 casas se obtuvo la siguiente información: Se pide: a) Elaborar el diagrama de dispersión. Nº Nº HAB (X) CONS EN (Y) 1 12 9 2 9 7 3 14 10 4 6 5 5 10 8 6 8 6 7 10 8 8 10 10 9 5 4 10 7 7 TOTAL 91 74

- 67. EJEMPLO . 12; 9 9; 7 14; 10 6; 5 10; 8 8; 6 10; 8 10; 10 5; 4 7; 7 0 2 4 6 8 10 12 0 2 4 6 8 10 12 14 16 Consumo de Energía Número de habitaciones DIAGRAMA DE DISPERSIÓN Series1

- 68. EJEMPLO b) Suponiendo que existe una relación lineal, determine los estimadores M.C.O. de la recta de regresión e interprete su significado. Nº Nº HAB(X) CONS EN(Y) X² Y² XY x x² y y² xy 1 12 9 144 81 108 2,9 8,41 1,6 2,56 4,64 2 9 7 81 49 63 -0,1 0,01 -0,4 0,16 0,04 3 14 10 196 100 140 4,9 24,01 2,6 6,76 12,74 4 6 5 36 25 30 -3,1 9,61 -2,4 5,76 7,44 5 10 8 100 64 80 0,9 0,81 0,6 0,36 0,54 6 8 6 64 36 48 -1,1 1,21 -1,4 1,96 1,54 7 10 8 100 64 80 0,9 0,81 0,6 0,36 0,54 8 10 10 100 100 100 0,9 0,81 2,6 6,76 2,34 9 5 4 25 16 20 -4,1 16,81 -3,4 11,56 13,94 10 7 7 49 49 49 -2,1 4,41 -0,4 0,16 0,84 TOTAL 91 74 895 584 718 3,55271E-15 66,9 -3,55271E-15 36,4 44,6 Media 9,1 7,4 10 n 10 1 91 i i X 10 1 74 i i Y 10 2 1 895 i i X 10 2 1 584 i i Y Datos originales: Datos en términos de desvíos: 10 1 718 i i i X Y 10 10 10 2 2 2 2 1 1 1 ( ) 36.4 i i i i i i y Y Y Y nY 10 10 10 2 2 2 2 1 1 1 (X ) 66.9 i i i i i i x X X nX 10 10 10 1 1 1 (X )(Y ) 44.6 i i i i i i i i i x y X Y X Y nXY 9.1 X 7.4 Y

- 69. EJEMPLO • Estimación con datos originales: 1 1 1 2 2 2 1 1 ( )( ) 10(718) 91(74) 446 2 ˆ 0.66666... 0.6 10(895) 91 669 3 ( ) n n n i i i i i i i n n i i i i n X Y X Y n X X 4 ˆ ˆ 7.4 0.6(9.1) 1.33333... 1.3 3 Y X 2 ˆ 0.6 3 4 ˆ 1.3 3 ˆ ˆ ˆ 1.3 0.6 1,2,...,10 i i i Y X X i ˆ 1.3 0.6 1,2,...,10 i i Y X i

- 70. EJEMPLO • Interpretación de los coeficientes: De los cuales se puede interpretar que nos representa que cuando no hay consumo en las habitaciones del edifico el consumo de energía por otros factores es 1.3333 kwh; es decir, sólo encendido de luces de calle. Y nos indica que tanto crece el consumo de energía conforme aumenta el número de habitaciones por edificio. • Estimación con datos en términos de desvíos: ˆ " " ˆ " " 10 1 10 2 1 44.6 2 ˆ 0.66666... 66.9 3 i i i i i x y x 2 ˆ 0.66666... 3

- 71. EJEMPLO • Gráfica del modelo lineal de consumo de energía: 0 2 4 6 8 10 12 0 2 4 6 8 10 12 14 16 Consumo de Energía Número de habitaciones Series1 Linear (Series1) 4 2 ˆ 3 3 Y X

- 72. EJEMPLO • Estimación de la varianza residual: • Estimación del error estándar residual: 2 1 1 2 2 1 2 2 2 2 1 1 1 1 1 5 ˆ 36.4 0.6(44.6) (6.6) 2 8 8 6 1 ˆ 2 1 1 1 5 ˆ 36.4 0.6 (66.9) (6.6) 2 8 8 6 n n i i i n i i i n n i i i i i y x y n e n y x n 2 5 ˆ ˆ 0.9128709292 6 ˆ 0.91287 2 5 ˆ 0.83 6

- 73. EJEMPLOS • Estimación de la varianza – covarianza de los EMCO: 2 2 ˆ 2 1 ˆ 0.83 0.01245640259 66.9 n i i S x 2 2 2 1 ˆ 2 1 ˆ 0.83(895) 1.114848032 10(66.9) n i i n i i X S n x 2 ˆ ˆ, 2 1 ˆ 0.83(9.1) 0.01133532636 66.9 n i i X S x 2 ˆ 0.01246 S 2 ˆ 1.11485 S ˆ ˆ, 0.01134 S

- 74. EJEMPLOS • Estimación del error estándar de los EMCO: • Resumen de la estimación del Modelo Lineal Simple: ˆ 0.01245640258 0.111608255 S ˆ 1.114848033 1.055863643 S ˆ 0.11161 S ˆ 1.05586 S ˆ ˆ ˆ ˆ ˆ 1,2,..., . . ( ) ( ) i i Y X i n e e S S ˆ 1.3 0.6 1,2,...,10 . . (1.056) (0.112) i i Y X i e e

- 75. EJEMPLOS Matriz de varianzas-covarianzas: 2 1 2 2 2 1 1 2 2 1 1 ˆ ˆ ˆ ˆ ˆ ( ) ( , ) ˆ ˆ ˆ ˆ ( , ) ˆ ˆ ˆ ˆ ˆ( , ) ( ) 1 n i i n n i i i i n n i i i i X X n x x V Cov V Cov V X x x

- 76. DESCOMPOSICIÓN DE LA VARINZA: COEFICIENTE DE DETERMINACIÓN .

- 79. DESCOMPOSICIÓN DE LA VARIANZA Suma de Cuadrados: En términos de desvíos: 2 2 2 1 1 1 ˆ ˆ (Y ) (Y ) (Y ) n n n i i i i i i i Y Y Y 2 2 2 1 1 1 ˆ n n n i ï i i i i y y e 2 1 2 1 2 1 ˆ n i i n ï i n i i y SCT y SCE e SCR SCT=SCE+SCR ÷ n/mm 2 2 ˆ 2 Re ( ) (P , Re ) y y e S Varianza Total S Varianza debida a la gresión Explicada S Varianza de los errores erturbaciones sidual 2 2 2 ˆ y y e S S S

- 80. COEFICIENTE DE DETERMINACIÓN La Varianza Total se descompone en: Varianza de los errores(perturbaciones): 2 e S VR Varianza debida a la regresión (explicada): 2 2 2 ŷ y e S S S VE 2 y S VT VT=VE+VR ÷ VT/mm 2 2 2 2 ˆ 2 2 2 2 1 1 y e y e y y y S S S S VR VE R VT VT S S S 2 2 2 ˆ y y e S S S Sirve para determinar si el ajuste hecho es bueno ; es decir, si la variable X explica las variaciones de la variable Y, deberá ser: R²> 0.75 residual R²: Tanto por uno de la Y que viene explicado para la X

- 81. COEFICIENTE DE DETERMINACIÓN Componentes de variabilidad y bondad de ajuste 2 2 1 (1 ) STC SEC SRC STC STC STC R R Bondad de ajuste o Coeficiente de determinación 2 2 2 2 2 2 2 1 1 2 2 2 1 1 ˆ ˆ ˆ n n i i i i x xy n n y i i i i Y Y X X S SEC R r STC S Y Y Y Y

- 82. COEFICIENTE DE DETERMINACIÓN Componentes de variabilidad y bondad de ajuste Representación en diagramas de Venn r2 xy= 0 Y X X Y Y X r2 xy r2 xy= 1

- 83. COEFICIENTE DE DETERMINACIÓN Interpretación del coeficiente de determinación: El coeficiente de determinación, se define como la proporción de la varianza total de la variable explicada por la regresión. El coeficiente de determinación, refleja la bondad del ajuste de un modelo a la variable que pretende explicar. El coeficiente de determinación (R²) es igual a la proporción de la Varianza explicada ( ) respeto de la Varianza total ( ). 2 ŷ S 2 y S 2 2 ˆ 2 2 2 2 1 ; 0 1 y e y y S S R R S S 2 2 2 2 0 0 modelo no explica nada de Y a partir de X. 1 : . 0 exp . 1 exp . Si R SCE El Si R SCE SCT Ajuste perfecto Y depende funcionalmente de X Si R Baja capacidad licativa de la recta Si R Alta capacidad licativa de la recta

- 84. COEFICIENTE DE CORRELACIÓN LINEAL La correlación, también conocida como coeficiente de correlación lineal (de Pearson), es una medida de regresión que pretende cuantificar el grado de variación conjunta entre dos variables. De una forma menos coloquial, la podemos definir como el número que mide el grado de intensidad (o fuerza) y el sentido de la relación entre dos variables. Valores que puede tomar la correlación: ρ = -1 Correlación perfecta negativa ρ = 0 No existe correlación ρ = +1 Correlación perfecta positiva XY XY X Y Donde: : covarianza entre el valor X e Y : desviación típica de X : desviación típica de Y XY X Y

- 85. COEFICIENTE DE CORRELACIÓN ¿Para qué sirve el coeficiente de correlación ?: • Podemos observar que en un diagrama B los puntos se acercan más a la recta, caso contrario en el diagrama A, los puntos están más alejados. Entonces, podemos decir que la relación lineal del diagrama A es mas débil en comparación a la relación que existe en el diagrama B. • Un diagrama dispersión no nos da certeza de que tan débil o fuerte es la relación lineal, necesitamos una medida que nos dé la fuerza de la asociación y la dirección que toma esta relación. Para esto sirve el coeficiente de correlación. XY XY X Y

- 86. COEFICIENTE DE CORRELACIÓN El coeficiente de correlación (ρ) mide la fuerza y el sentido de la relación lineal entre dos variables cuantitativas. XY X Y 1 1 1 0 1 0.96, 1.0 0.85, 0.95 0.70, 0.84 0.50, 0.69 0.20, 0.49 0.10, 0.19 0.09, 0.00 CORRELACIÓN PERFECTA CORRELACIÓN FUERTE CORRELACIÓN SIGNIFICATIVA CORRELACIÓN MODERADA CORRELACIÓN DÉBIL CORRELACIÓN MUY DÉBIL COR RELACIÓN NULA

- 87. COEFICIENTE DE CORRELACIÓN A continuación se presentan algunos ejemplos de diagramas de dispersión con diferentes valores del coeficiente de correlación de Pearson (poblacional).

- 88. COEFICIENTE DE CORRELACIÓN POBLACIONAL El coeficiente de correlación poblacional es: Rango: MUESTRAL Mientras que, el coeficiente de correlación muestral es: ( )( ) X Y XY X Y X Y E X Y ( , ) ( ) ( ) XY X Y S Cov X Y r S S V X V Y : cov ( , ) XY es la arianza de X Y : X es la desviación estándar de X : Y es la desviación estándar de Y 1 1 0 1 1 0 0 1 1 Correlación negativa perfecta Correlación negativa No hay relación lineal Correlación positiva Correlación positiva perfecta 1 1 r 1 1 1 2 2 2 2 1 1 1 1 ( )( ) ( ) ( ) n n n i i i i i i i n n n n i i i i i i i i n X Y X Y r n X X n Y Y 1 2 2 2 2 1 1 n i i i i i i i x y r x y

- 89. COEFICIENTE DE CORRELACIÓN Interpretación del índice de correlación: Este varía en el intervalo [-1,1], estableciendo el signo el sentido de la relación, y la interpretación de cada resultado es el siguiente: La correlación refleja la medida de asociación entre variables. Si se aplica en probabilidad y estadística, la correlación permite conocer la fuerza y dirección de la relación lineal que se dé entre dos variables aleatorias. Si r = 1: Correlación positiva perfecta. El índice refleja la dependencia total entre ambas dos variables, la que se denomina relación directa: cuando una de las variables aumenta, la otra variable aumenta en proporción constante. Si 0 < r < 1: Refleja que se da una correlación positiva. Si r = 0: En este caso no hay una relación lineal. Aunque no significa que las variables sean independientes, ya que puede haber relaciones no lineales entre ambas variables. Si -1 < r < 0: Indica que existe una correlación negativa. Si r = -1: Indica una correlación negativa perfecta y una dependencia total entre ambas variables lo que se conoce como "relación inversa", que es cuando una de las variables aumenta, la otra variable en cambio disminuye en proporción constante.

- 90. COEFICIENTE DE CORRELACIÓN Interpretación gráfica del coeficiente de correlación: 0 1 r 1 0 r

- 91. Coef. de Determinación y Coef. de Correlación Correlación de Pearson vs. Coef. de determinación: vs Coeficiente de correlación lineal de Pearson Coeficiente de Determinación xy x y S r S S 2 2 ˆ 2 2 2 1 y e y y S S R S S Cómo de fuerte es la relación lineal entre dos variables Cuánta varianza explica un modelo cualquiera (no necesariamente lineal, no necesariamente una variable explicativa) R²=r² sólo para modelos lineales entre dos variables

- 92. EJEMPLOS DE APLICACIÓN Ejemplo: , 1,2,...,n : ( ./ ) i i i i i Sea Y X i Donde Y Consumo de energía m kwh X Número de habitaciones 2 2 10, 91, 895, 74, 584, 718, 9.1, 7.4 i i i i i i n X X Y Y X Y X Y 2 2 66.9, 36.4, 44.6 i i i i x y x y Sabiendo que 9.1 X , 7.4 Y , 2 6.69 X S , 2 3.64 Y S y que 0.9037974424 XY r , obtener: a) La ecuación del modelo de regresión lineal de Y sobre X; b) Los valores predichos por la ecuación de regresión para cada sujeto ( ˆ i Y ); c) Los errores de predicción o residuales para cada sujeto ( i e ); d) La varianza de los errores ( 2 e S ); e) La varianza de Y ( 2 y S ); f) La varianza de las puntuaciones predichas ( 2 ŷ S ); g) Comprobar que es cierta la igualdad de la descomposición de la varianza ( 2 2 2 ˆ y y e S S S ); h) El coeficiente de determinación [de dos formas: h.1) a partir de las varianzas; h.2) a partir del coeficiente de correlación entre X e Y]; h.3) interpretar el valor del coeficiente de determinación; i) Interpretar los coeficientes de la recta de regresión obtenidos (̂ y ˆ ); j) Estimar cuál será el consumo de energía obtenida, si hay 15 habitaciones en la residencia.

- 93. MÉTODOS DE ESTIMACIÓN DEL MODELO MÉTODO DE MÁXIMA VEROSIMILITUD: Dado el modelo lineal simple: Ahora, asumamos que: La función de distribución normal de Y viene dada por: La función de verosimilitud es: El logaritmo de la función de verosimilitud: CONCLUSIÓN: Bajo el supuesto de normalidad los estimadores MV son iguales a los estimadores MCO. 2 , 1,2,..., ~ (0, ) i i i i Y X i n Supuesto que N 2 ~ ( ), i i Y N X i 2 2 1 ( ) 2 1 ( ) 2 Y Y f Y e 2 2 1 1 ( ( ) 2 1 1 ( ) ( 2 ) n i i i n Y X i n n i L f Y e 2 2 2 1 1 2 ( ) 2 2 2 n i i i n n l Ln Ln Y X 2 2 . . 0, 0, 0 . . : ( , , ) Máx l l l Cond nec Al Max l Cond suf Por hessiano l % % % 1 1 1 2 2 1 1 1 1 2 2 1 ( , ) , 1 n n n i i i i i i i n n n n i i i i i i i i i n i i Y n X x y Y X x X Y X X e n % % % % % % % % % %

- 94. MÉTODOS DE ESTIMACIÓN DEL MODELO MÉTODO DE MÁXIMA VEROSIMILITUD: CONCLUSIÓN: Bajo el supuesto de normalidad los estimadores MV son iguales a los estimadores MCO: ˆ ˆ, , MV MCO % % 2 2 ˆ MCO MV % 2 1 1 2 n i i e n 2 1 1 n i i e n 1) 2) Insesgado Sesgado

- 95. INFERENCIA EN REGRESIÓN LINEAL SIMPLE ESTIMACIÓN INTERVÁLICA: , 2 0 0 0 0 ( / ), / E Y X Y X INTERVALO DE CONFIANZA Coeficientes del modelo Varianza Coeficiente de correlación PREDICCIÓN: Media e Individual ( , ) 1 P L U

- 96. ESTIMACIÓN INTERVÁLICA Inferencia Estadística: i i i Y X 2 2 ~ (0, ) Y ~ ( ), i i i N N X 2 2 2 2 1 ( 2) 2 ˆ 1 ˆ ˆ ˆ ~ , , ( ) ~ n i i n n i i X N si Est T t S n x 2 2 2 ( 2) 2 ˆ 1 ˆ ˆ ˆ ~ , , ( ) ~ n n i i N si Est T t S x Hipótesis Básicas Modelo lineal: Distribución muestral de los EMCO:

- 97. ESTIMACIÓN INTERVÁLICA I.C. PARA : , Se trata de hallar L y U; tal que, ( , ) P L U ( , ) P L U ˆ ( ) 0 ˆ I t S ˆ ( ) 0 ˆ I t S Donde: Donde: 0 1 ( 2) 2 n Dado t t 0 1 ( 2) 2 n Dado t t 2 ˆ 2 1 ˆ n i i S x 2 2 1 ˆ 2 1 ˆ n i i n i i X S n x ( ) P L U ( ) P L U

- 98. ESTIMACIÓN INTERVÁLICA I.C. PARA : 2 2 ( , ) P L U 2 2 1 ( 2) 2 ˆ ( 2) n n L 2 2 1 ( 2) 2 ˆ ( 2) n n U 2 ( ) P L U 2 ( ) , I L U

- 99. ESTIMACIÓN INTERVÁLICA I.C. PARA : Se trata de hallar L y U; tal que: ( , ) P L U ( ) 0 I Z 2 2 1 1 2 1 ( , ) 1 3 (0,1) Ln N n Z N 1 1 2 1 r Ln r Con un cambio de variable se puede pasar de r a ω: Luego, debe hacerse la transformación de ω a r, con la Tabla K ( ) P L U ( ) P L U 1 2 2 1 1 n i i i XY n n X Y i i i i x y S r S S x y Donde:

- 100. ESTIMACIÓN INTERVÁLICA PROBLEMA DE PREDICCIÓN: . . Pr . . Media I C de la Media condicional edicción Individual I C de un valor Individual Predicción media: 0 0 0 0 0 0 1,2,..., ( / ) ˆ ˆ ˆ i i i i Supuesto que Y X i n Dado X X E Y X X Se predice Y X Valor futuro 2 2 0 0 ( 2) 2 2 0 2 1 Ŷ ( ) ˆ ( ) ~ ( ) 1 ˆ n n i i X Como Est T t X X n x Se trata de hallar L y U; tal que, 0 0 ( ( / ) , ) P E Y X L U 0 0 0 ˆ ( ( / )) 0 0 ˆ E Y X Y I Y t S 0 0 0 0 ˆ 0 1 ( 2) 2 ˆ ˆ ˆ i Y n Dado X X Y X t t y S 0 0 ( ( / ) ) P L E Y X U 2 2 0 0 0 2 1 ( ) 1 ˆ ~ ( ), n i i X X Y N X n x

- 101. ESTIMACIÓN INTERVÁLICA Predicción individual: 0 0 0 0 0 0 0 0 0 0 0 1,2,..., / ˆ ˆ ˆ ˆ ˆ ˆ : ( ) ( ) i i i i Supuesto que Y X i n Dado X X Y X X Se predice Y X Error de predicción Y Y X 2 2 0 0 0 2 1 ( ) 1 ˆ ~ 0, 1 n i i X X Y Y N n x 2 2 0 ( 2) 2 2 0 2 1 Ŷ 0 ˆ ( ) ~ ( ) 1 ˆ 1 n n i i Como Est T t X X n x Se trata de hallar L y U; tal que, 0 0 0 0 ˆ ( / ) 0 0 ˆ Y X Y Y I Y t S 0 0 0 0 0 ˆ 0 1 ( 2) 2 ˆ ˆ ˆ i Y Y n Dado X X Y X t t y S 0 0 ( / ) P L Y X U

- 102. ESTIMACIÓN INTERVÁLICA Bandas de confianza: Intervalo de predicción para un Y particular, dado Xo. Xо Y ˆ ˆ ˆ Y X Y Xо Y X0i Li Ui Ui - Li X01 L1 U1 U1 – L1 X02 L2 U2 U2 – L2 … … … … X0n Ln Un Un - Ln 0 Eje X: X0i Eje Y: Li, Ui 0i Xi Li Ui i U L 01 X02 X0n X 1 L2 Ln L1 U2 Un U1 1 U L 2 2 U L n n U L

- 103. PRUEBA DE HIPÓTESIS EN LA REGRESIÓN LINEAL SIMPLE Formulacion de las hipotesis: Para docimar , se cuentan con dos Métodos Básicos: Intervalos de Confianza Pruebas de Significancia Es aplicable en hipótesis de doble cola y se contrasta solamente observando si el intervalo de confianza contiene o no aquella hipótesis. Fueron desarrolladas por Fisher, Neyman y Pearson. Decimos que una prueba de significancia es un procedimiento para verificar, a través de la muestra, la verdad o falsedad de la hipótesis nula. Es necesario evaluar qué tan bien el modelo explica la relación entre X e Y.

- 104. PRUEBA DE HIPÓTESIS Enfoque de los intervalos de confianza: Docimar: 0 0 1 0 : : H H 0 ( ) 0 ' Si I se rechaza H a Se dice que el hallazgo es estadísticamente significativo (o altamente significativo desde un punto de vista estadístico) Docimar: Docimar: Docimar: 0 0 1 0 : : H H 2 2 0 0 2 2 1 0 : : H H 0 0 1 0 : : H H También se puede docimar para:

- 105. PRUEBA DE HIPÓTESIS Enfoque de la prueba de significancia: De los coeficientes de regresión. Prueba “t” Docimar: 0 0 1 0 : : H H Nivel de significancia: ' Zona crítica: Rechazar Ho, si 0 ' (1 )(n 2) 2 T t t Estadística: 0 ˆ ˆ T S Decisión: 0 0 ' Si T t se rechaza H a Conclusión: Rechazar Hₒ, significa que el modelo explica una parte significativa de la variación en Y en función de las variaciones en X. No existe una regresión lineal entre X e Y Existe una regresión lineal de Y en función de X

- 106. PRUEBA DE HIPÓTESIS Enfoque de la prueba de significancia: De los coeficientes de regresión. Prueba “t” Docimar: 0 0 1 0 : : H H Nivel de significancia: ' Zona crítica: Rechazar Ho, si 0 ' (1 )(n 2) 2 T t t Estadística: 0 ˆ ˆ T S Decisión: 0 0 ' Si T t se rechaza H a Conclusión: Rechazar Hₒ, significa que aún cuando existan variaciones nulas en la variable explicativa, la variable explicada obtendría de otras fuentes.

- 107. PRUEBA DE HIPÓTESIS Enfoque de la prueba de significancia: De la varianza. Prueba “ ” Docimar: Nivel de significancia: ' Zona crítica: Rechazar Ho, si 2 2 2 2 0 ' 1 ' ( )(n 2) (1 )(n 2) 2 2 ó Estadística: 2 2 2 0 ˆ ( 2) n Decisión: 2 2 2 2 0 1 0 ' Si ó se rechaza H a Conclusión: Significa que al rechazar Hₒ, se acepta la H₁. 2 2 2 0 0 2 2 1 0 : : H H

- 108. PRUEBA DE HIPÓTESIS Enfoque de la prueba de significancia: Del coeficiente de correlación. Docimar: Nivel de significancia: ' Zona crítica: Rechazar Ho, si Estadística: 0 2 2 2 1 1 2 r r r n T r S r r n Decisión: Conclusión: Significa que no existe correlación entre X e Y. 0 0 1 0 : : H H Caso : Prueba “ t ” 0 0 0 ' (1 )(n 2) 2 T t t 0 0 ' Si T t se rechaza H a

- 109. PRUEBA DE HIPÓTESIS Enfoque de la prueba de significancia: Del coeficiente de correlación. Docimar: Nivel de significancia: ' Zona crítica: Rechazar Ho, si Estadística: 0 0 (1 )(1 ) 3 2 (1 )(1 ) r n Z Ln r Decisión: Conclusión: Significa que no existe correlación entre X e Y. 0 0 1 0 : : H H Caso : Prueba “ Z ” 0 0 ' (1 ) 2 Z Z Z 0 0 ' Si Z Z se rechaza H a

- 110. PRUEBA DE HIPÓTESIS Análisis de varianza en regresión: Del coeficiente de regresión . Prueba “F” Docimar: Nivel de significancia: ' Zona crítica: Rechazar Ho, si 0 (1 ')(1, 2) n F F F Estadística: 2 2 /1 /1 / ( 2) (1 ) / ( 2) SEC R F SRC n R n Decisión: 0 0 ' Si F F se rechaza H a Conclusión: El contraste “t” y “F” son equivalentes. 0 0 1 0 : : H H Fuente de variación Suma de cuadrados Grados de libertad Cuadrados medios “F” Debido a la regresión SEC 1 SEC/1 Debido residuos (error) SRC n-2 SRC/(n-2) TOTAL STC n-1 /1 / ( 2) SEC F SRC n

- 111. PRUEBA DE HIPÓTESIS . FUENTE DE VARIACIÓN SUMA DE CUADRADOS GRADOS DE LIBERTAD CUADRADOS MEDIOS “F” Debido a la regresión X 1 SEC/1 Debido a los residuos (o error) n-2 SRC/(n-2) TOTAL n-1 2 2 2 1 1 2 2 1 1 ˆ ˆ ˆ n n í í i i n n i i í i i SEC y x x y R y 2 2 2 1 1 (1 ) n n i i i i SRC e R y 2 1 n i i STC y /1 / ( 2) SEC F SRC n Tabla ANOVA

- 112. MODELOS DE REGRESIÓN NO LINEALES MODELO LINEAL: ˆ 1,2,..., i i Y a bX i n Estimadores M.C.O.: 1 1 1 2 2 1 1 ( )( ) ( ) n n n i i i i i i i n n i i i i n X Y X Y b n X X a Y bX Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 ( )( ) ( ) ( ) n n n i i i i i i i n n n n i i i i i i i i n X Y X Y R n X X n Y Y 1 1 2 1 1 1 n n i i i i n n n i i i i i i i Y na b X X Y a X b X

- 113. MODELOS DE REGRESIÓN NO LINEALES MODELO PARABÓLICO: 2 ˆ 1,2,..., i i i Y a bX cX i n Sistema de ecuaciones 2 1 1 1 2 3 1 1 1 1 2 2 3 4 1 1 1 1 n n n i i i i i i n n n n i i i i i i i i i n n n n i i i i i i i i i Y na b X c X X Y a X b X c X X Y a X b X c X 2 2 1 1 1 1 1 1 2 2 2 1 1 ( )( ) ( )( ) ( ) n n n n n n i i i i i i i i i i i i i i n n i i i i b n X Y X Y c n X Y X Y R n Y Y Mediante la regla nemotécnica: Resolver el sistema de ecuaciones por: Método de sustitución Método de igualación Método de sumas y restas Método de Regla de Cramer Si 2 ˆ 1,2,..., i i i Y aX bX c i n 2 2 1 1 1 1 1 1 2 2 2 1 1 ( )( ) ( )( ) ( ) n n n n n n i i i i i i i i i i i i i i n n i i i i b n X Y X Y a n X Y X Y R n Y Y

- 114. MODELOS DE REGRESIÓN NO LINEALES MODELO POTENCIAL: ˆ 1,2,..., b i i Y aX i n Estimadores M.C.O.: 1 1 1 2 2 1 1 ( U)( V) ( U) n n n i i i n n i i n UV B n U A V BU Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 ( U)( V) ( U) ( V) n n n i i i n n n n i i i i n UV R n U n V Linealizando: i i Ln Y Ln a b Ln X Donde: , , , i i U Ln X V Ln Y A Ln a B b V A BU 2 V nA B U UV A U B U

- 115. MODELOS DE REGRESIÓN NO LINEALES MODELO POTENCIAL: ˆ 1,2,..., b i i Y aX i n 1 1 1 2 2 1 1 ( )( ) ( )( ) ( ) ( ) n n n i i i n n i i n Ln X Ln Y Ln X Ln Y b n Ln X Ln X Ln a Ln Y b Ln X Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 ( )( ) ( )( ) ( ) ( ) ( ) ( ) n n n i i i n n n n i i i i n Ln X Ln Y Ln X Ln Y R n Ln X Ln X n Ln Y Ln Y Linealizando: i i Ln Y Ln a b Ln X 2 ( )( ) ( ) ( ) Ln Y n Ln a b Ln X Ln X Ln Y Lna Ln X b Ln X Donde: log Ln a a Anti a Por la regla nemotécnica: S.E.N. Estimadores mínimo cuadrático ordinarios:

- 116. MODELOS DE REGRESIÓN NO LINEALES MODELO EXPONENCIAL: ˆ . 1,2,..., i X i Y a b i n Estimadores M.C.O.: 1 1 1 2 2 1 1 * ( U*)( V) * * ( U*) * * n n n i i i n n i i n U V B n U A V B U Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 * ( U*)( V) * ( U*) ( V) n n n i i i n n n n i i i i n U V R n U n V Linealizando: ( ) i i Ln Y Ln a X Ln b Donde: * , , , * i i U X V Ln Y A Ln a B Ln b * * V A B U 2 * * * * * * V nA B U U V A U B U

- 117. MODELOS DE REGRESIÓN NO LINEALES MODELO EXPONENCIAL: ˆ . 1,2,..., i X i Y a b i n 1 1 1 2 2 1 1 ( ) ( )( Ln ) ( X) * * n n n i i i n n i i n X Ln Y X Y Ln b n X A V B U Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 ( ) ( )( Ln ) ( X) ( ) ( ) n n n i i i n n n n i i i i n X Ln Y X Y R n X n Ln Y Ln Y Linealizando: ( ) i i Ln Y Ln a X Ln b 2 ( ) ( ) ( ) ( ) ( ) Ln Y n Ln a Ln b X X Ln Y Ln a X Ln b X Donde: log , log Ln a a Anti a Ln b b Anti b Por la regla nemotécnica: S.E.N. Estimadores mínimo cuadráticos ordinarios:

- 118. MODELOS DE REGRESIÓN NO LINEALES MODELO EXPONENCIAL: ˆ .e 1,2,..., i bX i Y a i n Estimadores M.C.O.: 1 1 1 2 2 1 1 * ( U*)( V) * ( U*) * n n n i i i n n i i n U V B n U A V BU Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 * ( U*)( V) * ( U*) ( V) n n n i i i n n n n i i i i n U V R n U n V Linealizando: i i Ln Y Ln a bX Donde: * , , , i i U X V Ln Y A Ln a B b * V A BU 2 * * * * V nA B U U V A U B U

- 119. MODELOS DE REGRESIÓN NO LINEALES MODELO EXPONENCIAL: ˆ .e 1,2,..., i bX i Y a i n 1 1 1 2 2 1 1 ( ) ( )( ) ( ) n n n i i i n n i i n X Ln Y X Ln Y b n X X Lna Ln Y bX Coeficiente de determinación: 2 1 1 1 2 2 2 2 2 1 1 1 1 ( ) ( )( ) ( ) ( ) ( ) n n n i i i n n n n i i i i n X Ln Y X Ln Y R n X X n Ln Y Ln Y Linealizando: i i Ln Y Ln a bX 2 ( ) ( ) ( ) Ln Y n Ln a b X X Ln Y Ln a X b X Donde: log Ln a a Anti a Por la regla nemotécnica: S.E.N. Estimadores mínimo cuadráticos ordinarios:

- 120. MODELOS DE REGRESIÓN NO LINEALES Ejemplo de regresión no lineal: La empresa paraíso analiza la relación entre el consumo de energía (en miles de KWH) y el número de habitaciones en una residencia privada unifamiliar. En una muestra aleatoria de 10 casas se obtuvo la siguiente información: Se ajustarán una serie de modelos y se escogerá el que dé "mejor ajuste" en base al criterio del R - Cuadrado (R²). Se pide ajustar los modelos siguientes: a) Lineal b) Parabólica c) Potencial d) Exponencial Solución: N º Nº HAB (x) CONS EN (y) 1 12 9 2 9 7 3 14 10 4 6 5 5 10 8 6 8 6 7 10 8 8 10 10 9 5 4 10 7 7

- 121. MODELOS DE REGRESIÓN NO LINEALES Totales de datos originales: Nº HABIT. CONS.ENER. X Y X² Y² XY X³ X⁴ X²Y U = LnX V = LnY UV=LnX.LnY U²=(LnX)² V²=(LnY)² U*V=X.LnY 12 9 144 81 108 1728 20736 1296 2.48490665 2.19722458 5.45989796 6.17476106 4.82779584 26.3666949 9 7 81 49 63 729 6561 567 2.19722458 1.94591015 4.2756016 4.82779584 3.78656631 17.5131913 14 10 196 100 140 2744 38416 1960 2.63905733 2.30258509 6.07665407 6.96462359 5.30189811 32.2361913 6 5 36 25 30 216 1296 180 1.79175947 1.60943791 2.88372562 3.210402 2.59029039 9.65662747 10 8 100 64 80 1000 10000 800 2.30258509 2.07944154 4.7880911 5.30189811 4.32407713 20.7944154 8 6 64 36 48 512 4096 384 2.07944154 1.79175947 3.72585907 4.32407713 3.210402 14.3340758 10 8 100 64 80 1000 10000 800 2.30258509 2.07944154 4.7880911 5.30189811 4.32407713 20.7944154 10 10 100 100 100 1000 10000 1000 2.30258509 2.30258509 5.30189811 5.30189811 5.30189811 23.0258509 5 4 25 16 20 125 625 100 1.60943791 1.38629436 2.2311547 2.59029039 1.92181206 6.93147181 7 7 49 49 49 343 2401 343 1.94591015 1.94591015 3.78656631 3.78656631 3.78656631 13.621371 Σ 91 74 895 584 718 9397 104131 7430 21.6554929 19.6405899 43.3175396 47.7842106 39.3753834 185.274305 Media 9.1 7.4 2.16554929 1.96405899

- 122. MODELOS DE REGRESIÓN SIMPLE TEMA Nº 2 ˆ 1,2,..., i i Y a bX i n ˆ . 1,2,..., i X i Y a b i n