Incrustar presentación

Descargado 10 veces

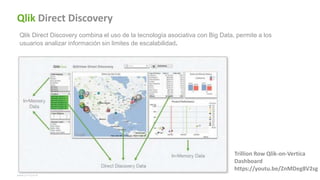

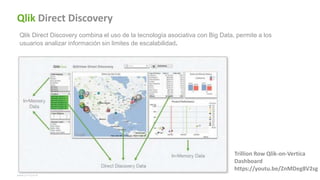

Qlik® Sense es una plataforma avanzada de análisis visuales que permite la exploración de datos y la creación de dashboards, ofreciendo auto-servicio y gobernanza para empresas. Su tecnología in-memory facilita la carga y análisis de grandes volúmenes de datos, además de permitir análisis sin límites a través de Qlik Direct Discovery. La integración con HPE Vertica fortalece su capacidad para manejar billones de registros.