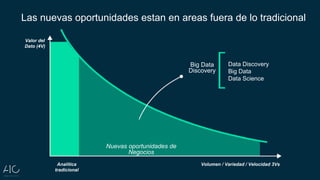

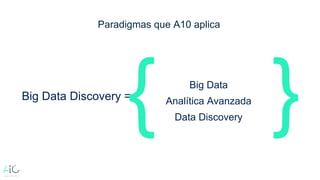

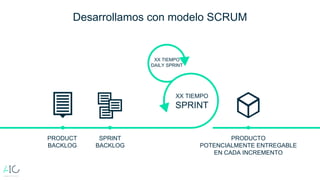

El documento aborda las fuentes y la importancia de los datos en la inteligencia de negocios, destacando que las empresas más exitosas utilizan variadas fuentes de datos más allá de las tradicionales. Se discuten enfoques como Big Data y Data Discovery, y se enfatiza en la analítica avanzada y su aplicación en distintos niveles de madurez organizacional. Finalmente, Analytics10 se presenta como un facilitador en la implementación de soluciones analíticas eficaces para empresas, buscando simplificar la analítica para maximizar sus beneficios.