Tema8.2ºbachillerato.física

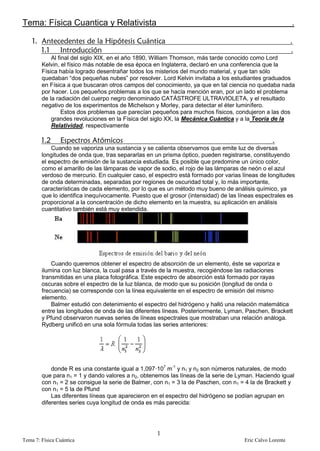

- 1. Tema: Física Cuantica y Relativista . Al final del siglo XIX, en el año 1890, William Thomson, más tarde conocido como Lord Kelvin, el físico más notable de esa época en Inglaterra, declaró en una conferencia que la Física había logrado desentrañar todos los misterios del mundo material, y que tan sólo quedaban “dos pequeñas nubes” por resolver. Lord Kelvin invitaba a los estudiantes graduados en Física a que buscaran otros campos del conocimiento, ya que en tal ciencia no quedaba nada por hacer. Los pequeños problemas a los que se hacía mención eran, por un lado el problema de la radiación del cuerpo negro denominado CATÁSTROFE ULTRAVIOLETA, y el resultado negativo de los experimentos de Michelson y Morley, para detectar el éter luminífero. Estos dos problemas que parecían pequeños para muchos físicos, condujeron a las dos grandes revoluciones en la Física del siglo XX, la Mecánica Cuántica y a la Teoría de la Relatividad, respectivamente Cuando se vaporiza una sustancia y se calienta observamos que emite luz de diversas longitudes de onda que, tras separarlas en un prisma óptico, pueden registrarse, constituyendo el espectro de emisión de la sustancia estudiada. Es posible que predomine un único color, como el amarillo de las lámparas de vapor de sodio, el rojo de las lámparas de neón o el azul verdoso de mercurio. En cualquier caso, el espectro está formado por varias líneas de longitudes de onda determinadas, separadas por regiones de oscuridad total y, lo más importante, características de cada elemento, por lo que es un método muy bueno de análisis químico, ya que lo identifica inequívocamente. Puesto que el grosor (intensidad) de las líneas espectrales es proporcional a la concentración de dicho elemento en la muestra, su aplicación en análisis cuantitativo también está muy extendida. Cuando queremos obtener el espectro de absorción de un elemento, éste se vaporiza e ilumina con luz blanca, la cual pasa a través de la muestra, recogiéndose las radiaciones transmitidas en una placa fotográfica. Este espectro de absorción está formado por rayas oscuras sobre el espectro de la luz blanca, de modo que su posición (longitud de onda o frecuencia) se corresponde con la línea equivalente en el espectro de emisión del mismo elemento. Balmer estudió con detenimiento el espectro del hidrógeno y halló una relación matemática entre las longitudes de onda de las diferentes líneas. Posteriormente, Lyman, Paschen, Brackett y Pfund observaron nuevas series de líneas espectrales que mostraban una relación análoga. Rydberg unificó en una sola fórmula todas las series anteriores: donde R es una constante igual a 1,097·107 m-1 y n1 y n2 son números naturales, de modo que para n1 = 1 y dando valores a n2, obtenemos las líneas de la serie de Lyman. Haciendo igual con n1 = 2 se consigue la serie de Balmer, con n1 = 3 la de Paschen, con n1 = 4 la de Brackett y con n1 = 5 la de Pfund Las diferentes líneas que aparecieron en el espectro del hidrógeno se podían agrupan en diferentes series cuya longitud de onda es más parecida: 1 Tema 7: Física Cuántica Eric Calvo Lorente

- 2. Serie Lyman: zona ultravioleta del espectro. Serie Balmer: zona visible del espectro. Serie Paschen zona infrarroja del espectro. Serie Bracket: zona infrarroja del espectro. Serie Pfund: zona infrarroja del espectro. sodio El término radiación se refiere a la emisión continua de energía desde la superficie de cualquier cuerpo, esta energía se denomina radiante y es transportada por las ondas electromagnéticas que viajan en el vacío a la velocidad de 3·108 m/s. Las ondas de radio, las radiaciones infrarrojas, la luz visible, la luz ultravioleta, los rayos X y los rayos gamma, constituyen las distintas regiones del espectro electromagnético. Sobre la superficie de un cuerpo incide constantemente energía radiante, tanto desde el interior como desde el exterior, la que incide desde el exterior procede de los objetos que rodean al cuerpo. Cuando la energía radiante incide sobre la superficie una parte se refleja y la otra parte se transmite. 2 Tema 7: Física Cuántica Eric Calvo Lorente

- 3. Consideremos la energía radiante que incide desde el exterior sobre la superficie del cuerpo. Si la superficie es lisa y pulimentada, como la de un espejo, la mayor parte de la energía incidente se refleja, el resto atraviesa la superficie del cuerpo y es absorbido por sus átomos o moléculas. Si r es la proporción de energía radiante que se refleja, y a la proporción que se absorbe, se debe de cumplir que r+a=1. La misma proporción r de la energía radiante que incide desde el interior se refleja hacia dentro, y se transmite la proporción a=1-r que se propaga hacia afuera y se denomina por tanto, energía radiante emitida por la superficie. En la figura, se muestra el comportamiento de la superficie de un cuerpo que refleja una pequeña parte de la energía incidente. Las anchuras de las distintas bandas corresponden a cantidades relativas de energía radiante incidente, reflejada y transmitida a través de la superficie. Comparando ambas figuras, vemos que un buen absorbedor de radiación es un buen emisor, y un mal absorbedor es un mal emisor. También podemos decir, que un buen reflector es un mal emisor, y un mal reflector es un buen emisor. Una aplicación práctica está en los termos utilizados para mantener la temperatura de los líquidos como el café. Un termo tiene dobles paredes de vidrio, habiéndose vaciado de aire el espacio entre dichas paredes para evitar las pérdidas por conducción y convección. Para reducir las pérdidas por radiación, se cubren las paredes con una lámina de plata que es altamente reflectante y por tanto, mal emisor y mal absorbedor de radiación. Comparando ambas figuras, vemos que un buen absorbedor de radiación es un buen emisor, y un mal absorbedor es un mal emisor. También podemos decir, que un buen reflector es un mal emisor, y un mal reflector es un buen emisor. Una aplicación práctica está en los termos utilizados para mantener la temperatura de los líquidos como el café. Un termo tiene dobles paredes de vidrio, habiéndose vaciado de aire el espacio entre dichas paredes para evitar las pérdidas por conducción y convección. Para reducir las pérdidas por radiación, se cubren las paredes con una lámina de plata que es altamente reflectante y por tanto, mal emisor y mal absorbedor de radiación. La superficie de un cuerpo negro es un caso límite, en el que toda la energía incidente desde el exterior es absorbida, y toda la energía incidente desde el interior es emitida. No existe en la naturaleza un cuerpo negro, incluso el negro de humo refleja el 1% de la energía incidente. Sin embargo, un cuerpo negro se puede sustituir con gran aproximación por una cavidad con una pequeña abertura. La energía radiante incidente a través de la abertura, es absorbida por las paredes en múltiples reflexiones y solamente una mínima proporción escapa (se refleja) a través de la abertura. Podemos por tanto decir, que toda la energía incidente es absorbida 3 Tema 7: Física Cuántica Eric Calvo Lorente

- 4. Consideremos una cavidad cuyas paredes están a una cierta temperatura. Los átomos que componen las paredes están emitiendo radiación electromagnética y al mismo tiempo absorben la radiación emitida por otros átomos de las paredes. Cuando la radiación encerrada dentro de la cavidad alcanza el equilibrio con los átomos de las paredes, la cantidad de energía que emiten los átomos en la unidad de tiempo es igual a la que absorben. En consecuencia, la densidad de energía del campo electromagnético existente en la cavidad es constante. A cada frecuencia corresponde una densidad de energía que depende solamente de la temperatura de las paredes y es independiente del material del que están hechas. Si se abre un pequeño agujero en el recipiente, parte de la radiación se escapa y se puede analizar. El agujero se ve muy brillante cuando el cuerpo está a alta temperatura, y se ve completamente negro a bajas temperaturas. La radiación del cuerpo negro representa el valor máximo de radiación que una sustancia real puede emitir a una temperatura dada. Los trabajos que elaboró Wilhelm Wien (1864 – 1928) influyeron en el desarrollo de la teoría cuántica introducida por Max Planck. Wien centró su actividad científica, a partir del año 1890, en los campos teórico y experimental, en la investigación referida a las leyes de la irradiación de calor y en la realización de investigaciones encaminadas a la medición de temperaturas muy bajas y extremadamente altas. Su principal descubrimiento es la ley del desplazamiento «Ley de Wien», descubierta en 1894. Se trata de una ley que permite expresar cuantitativamente los cambios que se producen, con las variaciones de la temperatura, en el espectro de un cuerpo. Esos cambios cuantificados se expresan como sigue: ´ ( ) ( ) : . ´ . ´ ( ) ( ) La ley de Wien nos dice cómo cambia el color de la radiación cuando varía la temperatura de la fuente emisora, y ayuda a entender cómo varían los colores aparentes de los cuerpos negros: Los objetos con una mayor temperatura emiten la mayoría de su radiación en longitudes de onda más cortas; por lo tanto aparecerán ser más azules. 4 Tema 7: Física Cuántica Eric Calvo Lorente

- 5. Los objetos con menor temperatura emiten la mayoría de su radiación en longitudes de onda más largas; por lo tanto aparecerán ser más rojos. Además, en cualquiera de las longitudes de onda, el objeto más caliente irradia más (es más luminoso) que el de menor temperatura. Ejemplo: El wolframio es el metal que tiene a la vez la temperatura más alta de fusión 3680 K y el menor grado de evaporación. El carbono soporta temperaturas más elevadas antes de fundirse pero se evapora rápidamente. En la práctica, la temperatura más alta que soporta una lámpara incandescente ordinaria fabricada con filamento de volframio es de 2900 K. A estas temperaturas solamente, una pequeña fracción de de la energía emitida está en la región visible, menos del 11%, la mayor parte es radiación infrarroja. Por lo que las lámparas incandescentes son poco eficientes en la emisión de luz visible. Por otro lado, se conocía la relación teórica (matemática) que relacionaba la intensidad irradiada (es decir, la energía irradiada por unidad de superficie y de tiempo) por el cuerpo negro, con la temperatura absoluta del cuerpo. Es la expresión conocida como Ley de Stefan- Boltzmann, según la que: . , donde: A principios de siglo se hicieron cálculos de la densidad de energía de la radiación de un cuerpo negro (es decir, se realizaron intentos para deducir la ley que explicase la forma de las gráficas de la radiación del cuerpo negro, como ya hemos dicho, independiente de la naturaleza del cuerpo); pero los resultados señalaron un serio conflicto entre la física clásica y los resultados experimentales. Lord Rayleigh y James Jeans dedujeron una ley capaz de explicar los resultados de longitudes de onda largas, pero predecía que el cuerpo debería tener una emisión masiva de energía a longitudes de onda cortas. Un sinsentido conocido como ''catástrofe ultravioleta''. El problema surge porque al estudiar la radiación electromagnética de un cuerpo negro, que no es otra cosa que una cavidad con ondas electromagnéticas dentro y a la cual se ha hecho un agujerito por donde pueda escapar la radiación. Si para estudiar este problema, se unen la mecánica a la teoría electromagnética y a la mecánica estadística clásicas, resulta que, cuanto mayor sea la frecuencia de las ondas mayor es la energía emitida por el cuerpo negro. Esto no concuerda con lo observado experimentalmente y repugna desde el punto de vista teórico. Por eso constituye una catástrofe. Como además, ocurre a frecuencias altas, como la de la luz 5 Tema 7: Física Cuántica Eric Calvo Lorente

- 6. ultravioleta, tal desastre de la física decimonónica recibió el sugerente apelativo de catástrofe ultravioleta. En 1887, Hertz, y más tarde Hallwachs, realizaron el siguiente experimento. Colocaron una placa de cinc en un electroscopio al que iluminaban con la luz procedente de la chispa que saltaba en un arco voltaico y observaron lo siguiente: Si el electroscopio y la lámina de cinc estaban cargados negativamente, se descargaban al iluminarlos (se juntaban las láminas del electroscopio). Si el electroscopio y la lámina de cinc estaban cargados positivamente, no se descargaba al iluminarlo. Si estaban cargados negativamente y se interpone un cristal entre el arco y la lámina de cinc, no se produce descarga aunque se aumente la intensidad de la luz. Aplicando la teoría de la mecánica clásica sobre las ondas luminosas estos hechos no tienen explicación. Una posible explicación-resumen, en aquel momento (finales del siglo XIX, conociendo ya la existencia de los electrones -1899 J.J. Thomson-), sería: "El cátodo debe tener electrones" "La luz es capaz de extraer los electrones cuando hay exceso de ellos sobre el metal (cargado negativamente). Si el electroscopio tiene cargas positivas puede que la luz extraiga algunos electrones pero no logra arrancarlos y alejarlos. Vuelven a las láminas del electroscopio y por lo tanto su carga no varía. " "El cristal absorbe la luz ultravioleta y al interponerlo entre la luz y la lámina del electroscopio la componente más energética de la radiación es eliminada y por ello la radiación que pasa no es capaz extraer electrones". La explicación según la teoría de la mecánica clásica sería: La energía de una onda está repartida sobre el frente de onda y es proporcional al cuadrado de la amplitud y a la frecuencia. dE=½ dm V2 =½ ·4 r2v·dt· w2A2=½ ·4 r2v·dt· (2 )2· A2 La intensidad . también mantiene la misma proporcionalidad. La luz incidente aporta una cantidad de energía sobre la superficie de de la placa tanto mayor cuanto más potente sea el foco o mayor el número de focos, pero aunque esta energía aumente mucho, si no es de la calidad adecuada (frecuencia adecuada), no es capaz de arrancar electrones. Además el cristal interpuesto no evita que llegue una gran cantidad de energía, ya que sólo retiene alguna (el cristal no se calienta hasta fundirse, como sucedería si absorbiera toda). A más tiempo de exposición a la radiación más energía incidente sobre la placa y al final se produciría la extracción repentina de todos los electrones. Pero esto no sucede. 6 Tema 7: Física Cuántica Eric Calvo Lorente

- 7. La teoría clásica no encuentra explicación y lo más que puede decir es que la extracción no depende "sólo" de la intensidad (I) de la luz incidente. Si el campo eléctrico ( ) de la onda electromagnética (E equivale a amplitud) fuera responsable de la extracción, tendríamos que pensar que al incrementar la intensidad de la radiación la energía cinética de los electrones extraídos también se incrementaría (I |E|2). Como no es así, hay que buscar otra teoría que explique el fenómeno. En 1902, Lenard realizó una experiencia similar a la realizada por Thomson y observó que hay un potencial de corte de emisión que es independiente de la intensidad de la luz que incide. Duplicando la intensidad, solo se duplica el número de electrones extraídos, pero no su energía. Einstein rompe con la mecánica clásica y en 1905 explica que la luz privada de las radiaciones de mayor frecuencia (las más energéticas) al ser absorbidas por el cristal interpuesto (ver el primer ejemplo) no es capaz de arrancar los electrones. No es tan importante la cantidad de energía que llega a la superficie del metal, como la calidad de esa energía. El estudio cuantitativo del fenómeno fotoeléctrico se realizó a través de un montaje semejante al esquema de la figura, La ventana se construyó de cuarzo y se tomaron las siguientes precauciones: El tubo de vacío fue cocido previamente para que desprendiese la mayor cantidad de gas. Este gas luego podría ser ionizado por la luz e interferir en el proceso. El ánodo se recubrió de óxido de cobre (II) de color negro, para que no desprendiese electrones al ser iluminado, de este modo todos procederían de la extracción efectuada sobre el cátodo. Las superficies del cátodo debían estar limpias, bien orientadas, etc. Al realizar primero la conexión que se observa en la figura superior, colocando el potenciómetro de manera que la parte negativa (cátodo) se halle conectada a placa iluminada. De esta manera un aumento de potencial hará que los electrones arrancados sean encaminados por un campo eléctrico hacia la otra placa (ánodo). Cuanto mayor sea el potencial aplicado más cantidad de electrones llegarán al ánodo (atraviesan el tubo). Si se hace variar el voltaje que suministrado por el potenciómetro y se registra la intensidad de corriente ( ) para una intensidad de radiación luminosa fija ( ) y para luz de una determinada frecuencia de radiación (utilizamos luz monocromática, de un solo color cada vez), se obtiene una tabla de valores que representados originan la grafica que está arriba en la gráfica la derecha. Incluso para V=0 , algunos de los electrones arrancados del metal son capaces de atravesar el tubo y puede detectarse una intensidad de corriente . Al aumentar el potencial, el número de electrones que atraviesan el tubo aumenta, pero alcanza un momento en que todos los electrones arrancados del metal son captados por el ánodo y, a partir de ese punto, aunque se aumente el potencial, la corriente eléctrica no aumenta. 7 Tema 7: Física Cuántica Eric Calvo Lorente

- 8. Los fotones con energía insuficiente (frecuencia inferior a la umbral), no consiguen arrancar electrones, reflejándose o transformándose en otras formas de energía. No generan corriente eléctrica. Si se mantiene la polaridad y el tipo de luz (la misma frecuencia) pero se utiliza mayor potencia de iluminación (bombilla más potente o varias bombillas) el nº de electrones extraído es mayor y llegan más al amperímetro. Mayor intensidad de luz ( ) significará mayor flujo de fotones y la corriente en el circuito externo ( ) aumenta. Si se invierten las conexiones del potenciómetro (figura 3), se conseguirá hacer que el metal del cual la luz arranca electrones sea ahora positivo y muchos electrones arrancados retornarán a él. Los más rápidos llegan al otro lado y el amperímetro indica conducción. Al aumentar el potencial con esta conexión invertida llegará un momento en que todos los electrones arrancados retornen, y no cruce ninguno, con lo que =0. El valor del potencial en ese punto se conoce como POTENCIAL DE CORTE (Vo). Al repetir la experiencia con el mismo tipo de luz pero con de doble intensidad, lo que supone tener luz de la mismas características pero mayor número de fotones, se logra arrancar más electrones. Se observa que, a mayor intensidad de luz ( ) mayor número de electrones ( ), pero no electrones más rápidos. Y, al invertir la polaridad se obtiene el mismo potencial de corte (Vo) para todas las intensidades de luz. Como ya hemos dicho, para ese potencial de corte la intensidad de corriente es cero ( =0). (ver figura derecha anterior). Si ahora se realiza la misma experiencia pero cambiando el tipo de luz (variando su frecuencia), aunque manteniendo siempre la misma intensidad, el gráfico obtenido es parecido a los anteriores pero ahora el potencial de corte es distinto, mayor (más a la izquierda), cuánto mayor sea la frecuencia de la luz. Figura 5. 8 Tema 7: Física Cuántica Eric Calvo Lorente

- 9. La distribución espectral del cuerpo negro fue determinada por el físico alemán Max Planck (1858-1947) en el año 1900, según la ecuación conocida como ley de distribución de Planck: 2.π.π.h 2 P(λ( T) λ5 hc λkT En esta ley aparecen la constante de Boltzmann, k = 1,38066 · 10-23 J K-1, muy conocida en termodinámica, y una constante nueva h = 6,62618 · 10-34 J s, que pasó a denominarse constante de Planck. Para asegurar la coherencia de su ley, Planck se vio obligado a introducir una hipótesis revolucionaria, según la cual la energía asociada a la radiación de una frecuencia dada tomaba sólo valores múltiplos de un cuanto elemental que era proporcional a la frecuencia de la radiación. La constante de proporcionalidad entre la energía de este cuanto y la frecuencia era precisamente h. Esta hipótesis de Planck permitió deducir leyes clásicas de la termodinámica que sólo habían podido establecerse por medios experimentales, y dio origen a una nueva concepción de la física: la mecánica cuántica. Pero, qué¿Qué aportaba la ley de Planck que no se hallase ya implícito en las leyes de Wien y de Rayleigh-Jeans? Un ingrediente tan importante como novedoso. Tanto que es el responsable de la primera gran crisis provocada por la Teoría Cuántica sobre el marco conceptual de la Física Clásica. Ésta suponía que el intercambio de energía entre la radiación y la materia ocurría a través de un proceso continuo, es decir, una radiación de frecuencia f podía ceder cualquier cantidad de energía al ser absorbida por la materia. Lo que postuló Planck al introducir su ley es que la única manera de obtener una fórmula experimentalmente correcta exigía la novedosa y atrevida suposición de que dicho intercambio de energía debía suceder de una manera discontinua, es decir, a través de la emisión y absorción de cantidades discretas de energía, que hoy denominamos “quantums” de radiación. La cantidad de energía E propia de un quantum de radiación de frecuencia f se obtiene mediante la relación de Planck: ,siendo h la constante universal de Planck = 6´62 .10 34 J.sg (unidades de “acción”). Puede entenderse la relación de Planck diciendo que cualquier radiación de frecuencia υ se comporta como una corriente de partículas, los quantums, cada una de ellas transportando una energía E = h υ, que pueden ser emitidas o absorbidas por la materia. La hipótesis de Planck otorga un carácter corpuscular, material, a un fenómeno tradicionalmente ondulatorio, como la radiación. Pero lo que será más importante, supone el paso de una concepción continuista de la Naturaleza a una discontinuista, que se pone especialmente de manifiesto en el estudio de la estructura de los átomos, en los que los electrones sólo pueden tener un conjunto discreto y discontinuo de valores de energía. La hipótesis de Planck quedó confirmada experimentalmente, no sólo en el proceso de radiación del cuerpo negro, a raíz de cuya explicación surgió, sino también en las explicaciones del efecto fotoeléctrico, debida a Einstein (1905), y del efecto Compton, debida a Arthur Compton (1923), como veremos más adelante. A partir de los resultados obtenidos en la experiencia detallada del fenómeno fotoeléctrico, se desprende que: 1.- La intensidad de la corriente fotoeléctrica ( , amperios, reflejo del número de electrones liberados) que origina una radiación de una determinada longitud de onda que incide sobre una superficie metálica, aumenta si aumentamos la intensidad de radiación ( ) (watios/m2). 2.- La emisión es prácticamente instantánea y no depende de la Intensidad de la luz incidente. El tiempo es del orden de 10 –9 s (1ns ). 3.- Cada metal requiere, para que se produzca la extracción, una radiación con una frecuencia mínima ( 0 ). Cualquier otra radiación de menor frecuencia, no será capaz de 9 Tema 7: Física Cuántica Eric Calvo Lorente

- 10. arrancar electrones. Por debajo de la frecuencia mínima la intensidad de corriente será cero. No hay efecto fotoeléctrico. Einstein, en 1905, explicó este fenómeno afirmando que la energía no se transmite repartida en toda la onda (como se suponía en la teoría clásica), sino agrupada en unos paquetes de energía que llamó fotones (partícula sin masa en reposo, pero con una cantidad de movimiento y energía) que se mueven con la onda. O mejor aún, que al moverse son guiados por una onda que es la que se detecta en determinadas experiencias. Cuando la luz llega a la superficie del metal la energía no se reparte equitativamente entre los átomos que componen las primeras capas en las que el haz puede penetrar, sino que por el contrario sólo algunos átomos son impactados por el fotón que lleva la energía y, si esa energía es suficiente para extraer los electrones de la atracción de los núcleos, los arranca del metal. 4.- La energía cinética de los electrones emitidos depende de la frecuencia de la radiación incidente y de la posición que ocupa ese electrón en el metal. 1 hν hν 0 mv 2 . 2 (La energía incidente menos el trabajo de extracción es igual a la energía cinética del electrón extraído). Ecuación de Einstein. 5.- Existe un potencial de corte (Vo) o potencial de frenado para el que =0. Este potencial de corte es independiente de la intensidad de la radiación ( ), pero depende de su frecuencia. El producto del potencial por la carga es trabajo (por la definición de potencial V=W/q). El trabajo de frenado ( 0 . ) debe ser suficiente para frenar a los electrones más rápidos, que son los que estaban menos ligados al metal. 1 0. mv 2 2 Por lo que: hν hν 0 h hν hν 0 0. 0 0 .ν ν0 Según la teoría de conducción metálica de Sommerfeld los electrones de conducción tienen diferentes energías de unión al metal. Se puede establecer la 0 distribución de electrones por energías aplicando la teoría estadística de Fermi-Dirac. En el gráfico vemos varios electrones (bolas rojas). El electrón ligado al metal con una energía Em (máxima) al ser extraído alcanza 10 Tema 7: Física Cuántica Eric Calvo Lorente

- 11. una energía cinética máxima entre la de todos los electrones. Otro electrón más ligado, situado en Ei requerirá más energía de extracción y por lo tanto alcanza una energía cinética menor. Un electrón muy ligado no puede ser extraído, quizá pueda sólo ser promocionado a un nivel superior. La explicación de Einstein coincide con los hechos experimentales. Si se repartiese la energía de la onda entre los trillones de átomos en los que incide la radiación, tardarían años en acumular la energía necesaria para ser extraídos y todos los electrones superficiales de los átomos de la superficie abandonarían de golpe el metal, al cabo de ese tiempo. Por el contrario, se comprueba experimentalmente, que desde que incide la radiación hasta la extracción de los electrones transcurren solamente algunos nanosegundos y sólo son extraídos unos pocos electrones de los millones que componen las capas superficiales. La energía emitida es discontinua, va en paquetes, tal como había enunciado Plank (que sin embargo creía que se propagaba repartida en la onda, como lo suponía la teoría clásica). La aportación original de Einstein es que la energía se transmite e impacta de manera discontinua o discreta, en paquetes. La emisión de electrones es casi instantánea. . Los experimentos desde Faraday hasta Rutherford condujeron al establecimiento de un modelo atómico nuclear constituido por: 11 Tema 7: Física Cuántica Eric Calvo Lorente

- 12. un núcleo de carga positiva en el que se concentraba además la masa del átomo y cuyo radio es aproximadamente 10-14 cm. En el núcleo se encuentran los protones ( mp = 1.672.10-27 kg y qp = +1,602.10-19 C) Una envoltura extra nuclear difusa constituida por los electrones que giran alrededor del núcleo como los planetas alrededor del Sol. Sin embargo, el modelo propuesto por Ernest Rutherford poseía serias, puesto que: De acuerdo con los principios de la física conocidos en aquella época, el átomo de Rutherford debía ser inestable, ya que una partícula cargada moviéndose en una trayectoria cerrada (como estaba planteado para el electrón) se acelera constantemente y debe ceder energía de manera continua debiendo describir una espiral hasta caer sobre el núcleo. El modelo no explicaba algunas propiedades de los átomos como sus espectros. De acuerdo con lo planteado en el párrafo anterior, los espectros atómicos debían ser continuos. Sin embargo, se ha comprobado que los espectros atómicos son discretos, presentándose como una serie de líneas o rayas de frecuencias definidas. Se hacía necesaria la elaboración de un modelo que solucionara tales problemas, a saber: ¿Cómo explicar la estabilidad del átomo? ¿Cómo explicar los espectros de líneas de los átomos? El encargado de continuar profundizando en estas interrogantes fue el danés Niels Bohr. Böhr propuso un nuevo modelo atómico, que respondiese a las cuestiones anteriormente planteadas. Su modelo se basaba en tres postulados. Estos postulados de Bohr aparecen como una forma de explicar las evidencias experimentales de los espectros atómicos a la luz de los conocimientos que se tenían después de la aceptación de la cuantización en el micromundo pero antes de la formalización de la mecánica cuántica. Veámoslos: 1. Primer Postulado: Los electrones giran alrededor del núcleo en órbitas estacionarias sin emitir energía. 2. Segundo Postulado:Los electrones solo pueden girar alrededor del núcleo en aquellas órbitas para las cuales el momento angular del electrón es un múltiplo entero de h/2p. ,siendo "h" la constante de Planck, m la masa del electrón, v su velocidad, r el radio de la órbita y n un número entero (n=1, 2, 3, ...) llamado número cuántico principal, que vale 1 para la primera órbita, 2 para la segunda, etc. 3. Tercer postulado:Cuando un electrón pasa de una órbita externa a una más interna, la diferencia de energía entre ambas órbitas se emite en forma de radiación electromagnética. Mientras el electrón se mueve en cualquiera de esas órbitas no radia energía, sólo lo hace cuando cambia de órbita. Si pasa de una órbita externa (de mayor energía) a otra más interna (de menor energía) emite energía, y la absorbe cuando pasa de una órbita interna a otra más externa. Por tanto, la energía absorbida o emitida será: En resumen podemos decir que los electrones se disponen en diversas órbitas circulares que determinan diferentes niveles de energía. 12 Tema 7: Física Cuántica Eric Calvo Lorente

- 13. Cada órbita se corresponde con un nivel energético que recibe el nombre de número cuántico principal, se representa con la letra " n " y toma valores desde 1 hasta 7 . La teoría de Bohr predice los radios de las órbitas permitidas en un átomo de hidrógeno. 2 . 0, donde n= 1, 2, 3, ... y 0 =0.53 Å (53 pm) La teoría también nos permite calcular las velocidades del electrón en estas órbitas, y la energía. Por convenio, cuando el electrón está separado del núcleo se dice que está en el cero de energía. Cuando un electrón libre es atraído por el núcleo y confinado en una órbita n, la energía del electrón se hace negativa, y su valor desciende a RH es una constante que depende de la masa y la carga del electrón y cuyo valor es 2´179 · 10-18 J. Normalmente el electrón en un átomo de hidrógeno se encuentra en la órbita más próxima al núcleo (n=1). Esta es la energía permitida más baja, o el estado fundamental. Cuando el electrón adquiere un cuanto de energía pasa a un nivel más alto (n=2,3, ...) se dice entonces que el átomo se encuentra en un estado excitado. En este estado excitado el átomo no es estable y cuando el electrón regresa a un estado más bajo de energía emite una cantidad determinada de energía, que es la diferencia de energía entre los dos niveles. La energía de un fotón, bien sea absorbido o emitido, se calcula de acuerdo con la ecuación de Planck. Representación de las órbitas n distancia 1 0,53 Å 2 2,12 Å 3 4,76 Å 4 8,46 Å 5 13,22 Å 6 19,05 Å 7 25,93 Å El electrón puede acceder a un nivel de energía superior pero para ello necesita "absorber" energía. Cuando vuelve a su nivel de energía original, el electrón necesita emitir la energía absorbida (por ejemplo en forma de radiación). 13 Tema 7: Física Cuántica Eric Calvo Lorente

- 14. Un átomo tiene una dimensión del orden de 10-9 m. Está compuesto por un núcleo relativamente pesado (cuyas dimensiones son del orden de 10-14 m) alrededor del cual se mueven los electrones, cada uno de carga –e (1.6 10-19 C), y de masa me (9.1·10-31 kg). El núcleo está compuesto por protones y neutrones. El número Z de protones coincide con el número de electrones en un átomo neutro. La masa de un protón o de un neutrón es aproximadamente 1850 veces la de un electrón. En consecuencia, la masa de un átomo es prácticamente igual a la del núcleo. Sin embargo, los electrones de un átomo son los responsables de la mayoría de las propiedades atómicas que se reflejan en las propiedades macroscópicas de la materia. El movimiento de los electrones alrededor del núcleo se explica, considerando solamente las interacciones entre el núcleo y los electrones (la interacción gravitatoria es completamente despreciable). Consideremos dos electrones separados una distancia d, y comparemos la fuerza de repulsión eléctrica con fuerza de atracción entre sus masas. La intensidad de la interacción gravitatoria es despreciable frente a la interacción electromagnética. El modelo de Bohr es muy simple y recuerda al modelo planetario de Copérnico, los planetas describiendo órbitas circulares alrededor del Sol. El electrón de un átomo o ión hidrogenoide describe también órbitas circulares, pero los radios de estas órbitas no pueden tener cualquier valor. Consideremos un átomo o ión con un solo electrón. El núcleo de carga Ze es suficientemente pesado para considerarlo inmóvil, Si el electrón describe una órbita circular de radio r, por la dinámica del movimiento circular uniforme En el modelo de Bohr, solamente están permitidas aquellas órbitas cuyo momento angular está cuantizado: , donde n es un número entero que se denomina número cuántico, y h es la constante de Planck 6.6256·10 -34 J.s Los radios de las órbitas permitidas son ,donde a0 se denomina radio de Bohr. a0 es el radio de la órbita del electrón del átomo de Hidrógeno Z=1 en su estado fundamental n=1. La energía total es En una órbita circular, la energía total E es la mitad de la energía potencial La energía del electrón aumenta con el número cuántico n. La primera energía de excitación es la que lleva a un átomo de su estado fundamental a su primer (o más bajo) estado excitado. La energía del estado fundamental se obtiene con n=1, E1= -13.6 eV y la del primer estado excitado con n=2, E2=-3.4 eV. Las energías se suelen expresar en electrón-voltios (1eV=1.6 10-19 J) La frecuencia f de la radiación emitida cuando el electrón pasa del estado excitado E 2 al fundamental E1 es 14 Tema 7: Física Cuántica Eric Calvo Lorente

- 15. El efecto Compton es un fenómeno por el cual la radiación electromagnética que incide sobre ciertas superficies sale con una longitud de onda mayor que la de entrada. Se trata de una demostración más directa de los fotones actuando como partículas. Este fenómeno, observado en 1923 por el físico estadounidense Arthur Holly Compton (1892-1962) en el curso de investigaciones realizadas sobre la difusión de los rayos X, sólo puede explicarse a partir de los principios de la mecánica cuántica. El fenómeno, en pocas palabras, era el siguiente: los rayos X cuando rebotaban en superficies de cristales, salían irradiados con una longitud de onda mayor, lo cual es lo mismo que una frecuencia menor. Lo que se había observado es que cuando con los rayos X (que son una radiación electromagnética de alta frecuencia), se bombardean ciertos cristales, estos rayos cambiaban su longitud de onda, dependiendo del ángulo de reflexión, medido entre la dirección cuando chocan contra el cristal y la dirección cuando salen rebotados del mismo. Cuando se analiza la radiación electromagnética que ha pasado por una región en la que hay electrones libres, se observa que además de la radiación incidente, hay otra de frecuencia menor. La frecuencia o la longitud de onda de la radiación dispersada depende de la dirección de la dispersión. Se explica el efecto Compton en términos de la interacción de la radiación electromagnética con electrones libres, que suponemos inicialmente en reposo en el sistema de referencia del observador. Compton concluyó que este fenómeno se podía entender si se piensa a los rayos X como fotones individuales, es decir como pequeñas bolas de billar que golpean contra otras como ser los núcleos y los electrones del elemento que compone al cristal. Así, si se considera que la radiación electromagnética está constituida por cuantos de energía llamados fotones, en su interacción con la materia puede absorberse parte de estos fotones. En tal caso, la energía global de la radiación disminuiría, y también su frecuencia, con lo que aumentaría la longitud de onda. Este cambio es fácilmente medido y corrobora la idea de que la energía es proporcional a la frecuencia. Con la teoría ondulatoria de la luz, no existían razones que pudieran explicar porqué hay un cambio de frecuencia en la interacción entre ciertas radiaciones electromagnéticas y la materia (los electrones que la componen). Por este trabajo Compton también recibió el premio Nobel en 1927. El efecto Compton puede cuantificarse dentro del marco teórico ofrecido por Planck y Einstein acerca de la energía electromagnética. Considerando que la masa de los cuantos de 15 Tema 7: Física Cuántica Eric Calvo Lorente

- 16. esta radiación (fotones) es Ef = h , que también se puede escribir como , siendo 2 , el momento lineal de cada fotón viene definido por: Mediante las leyes de conservación del momento lineal y de la energía se obtiene que la diferencia entre las longitudes de onda de entrada y salida del fotón en la interacción viene dada por: 2 1 (1 cos ) ,siendo θ el ángulo de desviación de la trayectoria del fotón y λC una constante llamada longitud de onda de Compton del electrón, cuyo valor viene dado por: El efecto fotoeléctrico se aprovecha en numerosos campos de la ciencia y la técnica. Los dispositivos llamados fotodiodos y fotomultiplicadores que se basan en este principio, intervienen en procesos como el control de productos industriales, las transmisiones por fax, los tubos de televisión o los amplificadores de imágenes. Entre las más conocidas aplicaciones de este efecto cabe citar, las células fotoeléctricas usadas para la detección de presencia y los equipos fotovoltaicos de los paneles de energía solar. La explicación que del efecto Compton proporciona la mecánica cuántica ofrece una de las pruebas experimentales más convincentes de la validez de sus postulados teóricos. Este fenómeno suministra una ilustración determinante de las propiedades de onda y partícula de la radiación electromagnética. Arthur Compton (1892- 1962), físico estadounidense, obtuvo el premio Nobel de física de 1927 por su descripción y explicación del fenómeno de cambio en la longitud de onda de los rayos X cuando colisionan con los electrones de la materia, conocido en la ciencia con el nombre de efecto Compton. El hecho de que a la luz presente tanto propiedades ondulatorias como de partícula sugirió a Louis De Broglie que una partícula pequeña como un electrón puede tener propiedades de onda en circunstancias adecuadas. En 1924, el físico francés hizo el siguiente razonamiento: 1. La naturaleza es sorprendentemente simétrica de muchas maneras. 2. Nuestro universo observable está compuesto totalmente de luz y de materia. 3. Teniendo en cuenta la dualidad onda-corpúsculo de la luz (Young-Einstein), quizás también la materia goce de esta cualidad. La sugerencia de de Broglie quizás no hubiera recibido seria atención si no hubiera predicho cuál debía ser la longitud de onda asociada a las llamadas ondas de materia. Recordemos que en 1680, Huygens propuso una teoría ondulatoria de la luz que no recibió aceptación general, en parte porque Huygens no pudo precisar cuál era la longitud de onda de la luz. Cuando Thomas Young rectificó este defecto en 1800, comenzó a aceptarse la teoría ondulatoria. De Broglie supuso que la longitud de onda de las ondas de materia predichas debía estar dada por la misma relación aplicable a la luz, o sea: h h λ p m.v , que relaciona la longitud de onda de una onda luminosa con la cantidad de movimiento de los fotones asociados con ella. La doble naturaleza de la luz se muestra de una manera sorprendente en esta ecuación y también en la de Planck (E=hυ ). Ambas expresiones contiene en su estructura tanto el concepto de onda (λ,υ) como un concepto de partícula (E,p). De Broglie predijo que las longitudes de ondas de las materias también debían estar dadas por la ecuación anterior, en la cual "p" tendría que ser la cantidad de movimiento de la partícula de materia. Esta conclusión se extendió y generalizó para toda la materia de manera que no solo los fotones llevan asociada una onda sino que toda la materia presenta esta dualidad, para 16 Tema 7: Física Cuántica Eric Calvo Lorente

- 17. cualquier tipo de materia. Esta teoría fue confirmada experimentalmente cuando se consiguió realizar la difracción de electrones. Todos los objetos de la vida cotidiana presentan un comportamiento ondulatorio aunque no lo observamos. Esto es debido a que la masa es muy grande y por tanto λ es muy pequeña. Sin embargo las partículas atómicas tienen masas comparables a la cte de Planck y por tanto sus longitudes de onda son apreciables. , era un aristócrata francés que ganó el premio Nobel de Física de 1929 por una tesis doctoral que elucidaba las propiedades ondulatorias de los orbitantes electrones. Se trató de un trabajo que ayudó a resolver una antigua paradoja al mostrar que los electrones pueden ser descritos ya sea como partículas o como ondas, según las circunstancias. El punto de partida que tuvo de De Broglie para desarrollar su tesis fue la inquietante dualidad en el comportamiento de la luz, que en ciertos fenómenos se manifiesta como onda, en otros como partícula. Este desconcertante aspecto doble de la luz, estrechamente vinculado con la existencia misma de los cuantos, le sugirió la pregunta de si no podía esperarse hallar una dualidad del mismo orden en los movimientos del electrón, en el átomo regido por el cuanto. Cuando de Broglie publicó sus ideas, en 1923, jamás –al menos hasta entonces– el electrón había manifestado características ondulatorias análogas a las de la luz; no obstante, a pesar de ello, había dos indicios que parecían apoyar, en los razonamientos de De Broglie, la idea de ese paralelismo. Hay una analogía, conocida desde Jacobi y Hamilton, entre las trayectorias posibles de las partículas, concebida según la dinámica clásica, y los rayos de propagación de ondas, estudiados por la geometría óptica. Y esta profunda analogía se establece por intermedio de la «acción», es decir, precisamente por la magnitud física cuyas dimensiones son las del cuanto de Planck. Parecía que en esta conexión había un indicio de que el cuanto forma el vínculo, enigmático y oculto, entre los dos aspectos complementarios: la naturaleza granular y ondulatoria de las partículas de la materia. Ese paralelismo fue el que motivó a de Broglie a embrionar los inicios que dieron paso a la mecánica ondulatoria. Pero también había algo más que influyó en ese embrionage. En efecto, las órbitas estables del electrón, en el átomo, están caracterizadas por números enteros. Ahora bien, la intervención de números enteros es insólita en la dinámica clásica de las partículas, mientras es intrínseca a la teoría de los fenómenos ondulatorios: un motivo más que sugería admitir una estrecha conexión, ajena a la antigua mecánica newtoniana, entre partículas y ondas, e hizo sospechar que al movimiento de las partículas subyace tal vez una propagación ondulatoria. Esas reveladoras analogías y algunas otras sencillas consideraciones propuestas por la teoría de la relatividad, llevaron a de Broglie a considerar que, como las pústulas de luz –los fotones– también los de la materia –electrones y protones– deberían estar acompañados en sus movimientos por ondas. Ligadas inseparablemente a las partículas de la materia, serían estas ondas las que guían y gobiernan –por lo menos estadísticamente– sus movimientos. La longitud de onda que de Broglie atribuye a las «ondas piloto», asociada a la partícula, es igual al cociente de la constante de Planck por el impulso del corpúsculo; es, pues, la misma que Einstein adjudicara a la onda luminosa del fotón. De Broglie escribió al respecto: “Son como dos ríos que por largo espacio corrieron separados terminan por mezclar sus aguas, dos grandes doctrinas (mecánica de los corpúsculos y teoría de las ondas) han llegado a su confluencia". 17 Tema 7: Física Cuántica Eric Calvo Lorente

- 18. Pero no obstante, existe una importante diferencia entre la onda adjunta a los fotones y aquellas asociadas a las partículas materiales. Mientras las pústulas de luz y sus correspondientes ondas tienen la misma velocidad, esta identidad no se asocia a las partículas materiales y sus correspondientes ondas asociadas. Pero aunque partículas y ondas tienen velocidades disímiles, éstas no son independientes una de la otra; su producto tiene un valor constante. Sin entrar en detalles aquí, ya que lo haremos en nuestra descripción matemática de la hipótesis de De Broglie, agreguemos que los corpúsculos y sus sistemas de ondas, como quedará demostrado, son inseparables y forman una estructura permanente. La idea de ligar lo continuo de la onda con lo discontinuo del corpúsculo otorgó una importante prueba sobre su posible viabilidad, cuando de Broglie, al aplicarla a los movimientos de los electrones en el interior de un átomo, consiguió hallar la razón de las órbitas cuantificadas de Bohr. Éste, en su modelo del átomo, todo ocurre como si estuviera regido por las prescripciones de un enigmático gobierno microcósmico, que permitía a los electrones trayectorias cuantificadas, y les prohibía las demás. Era obvio que ello correspondía a una cuestión que quedaba abierta por su carencia de precisión, pese a que era un postulado. Pero entonces la humanidad contaba con una brillante mente como la de Broglie, ya que éste con su ponencia logró aclarar la curiosa selección de las imprecisas órbitas de Bohr. Siendo la órbita del electrón estable, su onda asociada también lo será: será una onda estacionaria, comparable a las ondas sonoras de un tubo o las de las cuerdas de una guitarra. Pero para que se pueda dar el hecho de que las ondas puedan continuar estacionarias, es necesario que ellas se cierren, volviéndose sobre sí mismas. En consecuencia, la trayectoria de una onda es invariable, si su perímetro es igual a un múltiplo entero de la longitud de onda, permitiendo a la onda asociada al electrón encontrarse después de cada recorrido en la misma fase. Sobre todas las otras trayectorias la onda no podría subsistir, sus fases discordantes la destruirían. Ahora bien, las únicas trayectorias que responden a la condición de la onda estacionaria, las únicas en las cuales las ondas pueden conservarse, son exactamente las órbitas, permitidas del modelo atómico de Bohr. Así la mecánica ondulatoria proporciona la llave de la curiosa selección de las órbitas en el átomo. El postulado de Bohr deja de ser arbitrario y se convierte, con de Broglie, en una exigencia lógica, impuesta al electrón por el carácter estacionario de su onda asociada. Ahora bien, según esa idea imperativa de De Broglie, la razón por la cual la materia permite la coexistencia de esos dos aparentemente irreductibles fenómenos es precisamente la condición estacionaria de las ondas de la materia: lo estático de la partícula y lo vibratorio de la onda. Con esta interpretación que hace de Broglie para el átomo, es obvio que se aleja más que Bohr, de la la mini descripción planetaria de la idea atómica de Rutherford. Todo ocurre como si el electrón se encontrara, no en un punto determinado de su trayectoria, sino simultáneamente sobre toda la circunferencia de su órbita. Su circulación en tomo del núcleo deja de asimilarse a la traslación de un planeta en torno al Sol, asemejándose más bien a la rotación de un anillo simétrico que, a pesar de su movimiento, continúa ocupando el mismo lugar en el espacio. En otro aspecto, las ondas electrónicas se comportan como minúsculos circuitos oscilantes, acordados sobre longitudes de ondas determinadas. Por otra parte, al igual que el electrón, otros constituyentes de la materia, protones y neutrones, están también acompañados en sus movimientos por ondas. La onda integra –según el pensamiento de De Broglie –cada partícula material. La estructura particulada es el atributo evidentemente manifiesto de la materia; junto a él cohabita su otro carácter no menos fundamental, poco más escondido: su ser ondulatorio, que sólo se revela en ciertos momentos. Siempre que el movimiento se asocia a la materia, la onda lo hace también. Puesto que no existe en el universo un punto material en reposo, en todas las partes donde hay materia hay ondas. Los dos aspectos, particulados y vibratorios, son indispensables, siendo su ligamento el cuanto elemental de Planck; no obstante, no es posible hallarlos juntos. Si la naturaleza exhibe en un fenómeno dado uno de sus aspectos, esconde rigurosamente el otro. Tales son las ideas principales de la hipótesis de Louis de Broglie. Con ellas, se demuestra que es posible establecer una correspondencia entre las ondas y los corpúsculos, tal que las leyes de la mecánica correspondan a las leyes de la óptica geométrica. Sin embargo, como es sabido, en la teoría ondulatoria la óptica geométrica es solamente una aproximación; ésta tiene sus límites de validez y, en particular, cuando están implicados los fenómenos de interferencia y de difracción, resulta ser enteramente inadecuada cuando se trata de partículas clásicas. No obstante lo anterior, Existen pruebas directas y significativas del comportamiento ondulatorio de las partículas del microcosmos como el electrón. Se basan en el fenómeno de interferencia característico de las ondas y ausente en las partículas clásicas. Uno de los experimentos más directos y conclusivos fue el de Davisson y Germer en el año 1927. 18 Tema 7: Física Cuántica Eric Calvo Lorente

- 19. Aunque realizado después de la creación de la mecánica cuántica, permanece hasta hoy día como el indicador más claro y profundo de las manifestaciones cuánticas en el movimiento de las partículas. . Esquema del experimento de Davisson y Germer. Davisson y Germer estudiaron la reflexión de un haz de electrones incidente sobre un monocristal, siguiendo una idea usada anteriormente para la investigación de la naturaleza de los rayos X. Un haz de electrones procedente de un filamento calentado se acelera en un potencial electrostático e incide sobre el monocristal bajo cierto ángulo. Se observan los electrones reflejados mediante un detector cuya posición puede ser variada. También se puede variar el potencial acelerador y cambiar así la velocidad de los electrones. Los electrones experimentan reflexiones en los diversos planos paralelos de la red cristalina. La figura que insertamos a continuación del párrafo explica lo que ocurre al considerar sólo dos de estos planos. El haz que sale del monocristal se compone de dos haces reflejados por los dos planos diferentes (en realidad serían muchos). Los electrones recorren caminos distintos en los dos haces y la diferencia de camino es L=L1+L2 (véase la figura de abajo). De la geometría de la figura hallamos 2 cos , 1 . cos 2 , donde d es la distancia entre los planos y de ahí 2 . cos . Si los haces fueran dos ondas planas, como sucede con los rayos X, habría interferencia entre ellas con un máximo de intensidad correspondiente a una diferencia de fase múltiplo de 2π, o sea, para [07] donde λ es la longitud de onda y n es un entero. La ecuación [07] es la condición de Bragg para los máximos de rayos X reflejados por un monocristal. Cambiando el ángulo α se puede pasar de un máximo a otro y así medir la longitud de onda a partir de la diferencia en ángulo y d. Por otra parte, con partículas no se esperaría ver interferencia alguna ni, por lo tanto, máximos ni mínimos. La interferencia de dos haces reflejados en dos planos de una red cristalina. El experimento realizado por Davisson y Germer produjo resultados inequívocos: los electrones produjeron una interferencia clara con máximos según la fórmula de Bragg [07]. La longitud de onda de electrones con velocidades diferentes se mostró también de acuerdo con el postulado de De Broglie. 19 Tema 7: Física Cuántica Eric Calvo Lorente

- 20. Louis de Broglie propuso que todas las partículas, incluyendo al electrón, en su movimiento poseen asociada una onda, cuya longitud de onda es: h λ mv (h es la constante de Planck; m, la masa y v, la velocidad de la partícula). En ello consiste la hipótesis de la dualidad onda-corpúsculo, admitiendo que toda partícula subatómica, como el electrón, presenta una doble naturaleza, de onda y de materia, ofreciendo en cada circunstancia experimental una de ambas y nunca las dos al mismo tiempo (principio de complemetariedad). Pues bien, si suponemos que el electrón en su movimiento alrededor del núcleo del átomo de hidrógeno no cambia de órbita –y no pierde energía–, se le puede asociar una onda estacionaria de manera que su longitud de onda debe cumplir la condición: 2 (n=1,2,3,…) ya que la longitud de la trayectoria del electrón tiene que ser un múltiplo de la longitud de onda de la onda asociada. Si en la fórmula anterior sustituimos la longitud de onda dada por la ecuación de De Broglie, tendremos: h 2 mv Y, moviendo términos, llegamos fácilmente a la expresión del primer postulado: Por otra parte, si partimos de la ecuación del segundo postulado, , y recordamos la equivalencia masa-energía dada por Einstein, llegamos a: c h mc 2 hν ν mc Y puesto que la frecuencia se relaciona con la longitud de onda por: Tendremos: , es decir, , que es la ecuación de De Broglie aplicada a un fotón, donde p es su cantidad de movimiento. Como vemos, mediante unos sencillos cálculos algebraicos hemos establecido unas interesantes relaciones entre las ecuaciones de Böhr y la de De Broglie. Con esto se pretende mostrar no sólo la permanente interrelación entre los conceptos cuánticos sino la importancia de los postulados del físico sueco, que consciente o inconscientemente, llevaban implícita la idea de la naturaleza dual de la materia. La exigencia matemática, por decirlo de un modo gráfico, de la hipótesis onda-partícula, nos consuela, en cierto modo, de la dificultad conceptual que supone imaginar este fenómeno, idea central en el desarrollo de la mecánica cuántica y clave en el estudio de las interacciones que afectan a las partículas fundamentales. 20 Tema 7: Física Cuántica Eric Calvo Lorente

- 21. Los fenómenos descritos anteriormente obligaron a la comunidad científica a plantearse que algo fallaba en la concepción del Universo, en lo que había sido considerado válido hasta esos primeros años del Siglo XX. Se hacía necesario enfocar las cosas de una manera diferente, de una forma en la que se tuviera en cuenta la nueva luz que se había arrojado sobre la esencia de la naturaleza. Se trataba de encontrar unas leyes diferentes; pero antes de entrar en ello, vamos a ver cómo eran las imperantes hasta ese momento, las que se incluían dentro de la llamada mecánica clásica: La mecánica es el estudio matemático del movimiento. Dicho de otra manera, su función consiste en comprobar la velocidad y la posición de un objeto, o conjunto de objetos, con el fin de predecir su comportamiento futuro a partir de ciertas leyes. Ya desde los griegos hubo intentos de aproximarse al problema, pero la falta en aquella época de un buen método experimental provocó que los resultados fueran escasos. Hubo que esperar hasta la aparición de gigantes de la talla de Galileo Galilei o Johanes Kepler, pero sobre todo hasta que su sucesor, Isaac Newton, publicó en 1687 la obra “Principios Matemáticos de Filosofía Natural”, conocida corrientemente como “Principia”. Este libro es considerado por muchos el más decisivo de la historia de la ciencia, y en sus páginas se exponían los tres principios de la mecánica: 1. Todo cuerpo permanece en reposo o continúa su movimiento en línea recta con velocidad constante si no está sometido a una fuerza exterior. 2. La fuerza que mueve un cuerpo es igual a la masa de dicho cuerpo por su aceleración 3. A toda acción se opone una reacción, igual en módulo y dirección, pero de sentido contrario A partir de estos tres preceptos, durante los Siglos XVIII y XIX, varios grandes matemáticos (Laplace, Lagrange, Hamilton, etc.) elaboraron toda una doctrina para describir y predecir el movimiento de los objetos, la cual, hoy en día, se conoce como mecánica clásica o mecánica de Newton. Llegados a este momento, se creía que ya se sabía lo suficiente como para estar en disposición de, a partir de las posiciones y velocidades de los objetos de un sistema, y del conocimiento de fuerzas como la gravedad, calcular las posiciones y velocidades en cualquier momento futuro. El propio Universo es un sistema, el mayor de todos, y por tanto se pensaba que la física se hallaba cerca de explicarlo todo. Pero las cosas no serían tan fáciles. Aunque todo esto sigue siendo válido en nuestros días si observamos los sucesos que se dan en nuestra vida cotidiana, los avances del Siglo XX indicaron que esta mecánica no funcionaba en tres casos: 1. En el mundo de lo muy pequeño (átomos, moléculas, partículas fundamentales, etc.). Hubo que sustituirla por la mecánica cuántica 2. Cuando los objetos se mueven a velocidad cercana a la de la luz, hay que tener en cuenta la relatividad especial. 3. En presencia de grandes masas gravitatorias, como estrellas, hay que aplicar la relatividad general. Es a la primera frontera, a la de lo muy pequeño, a la que se dedica la mecánica cuántica. Varios descubrimientos de principios del Siglo XX, entre los cuales ya hemos visto los más importantes (los cuantos, el efecto fotoeléctrico, las órbitas del electrón y la dualidad onda- partícula) revelaron que en el mundo de las moléculas, de los átomos y de los objetos aún más pequeños, la mecánica clásica no es más que una aproximación. El alemán Werner Heisenberg y el austriaco Erwin Schrödinger fueron los ilustres físicos que, de manera independiente, tomaron estos hallazgos y los integraron en una nueva teoría para crear una mecánica distinta. 21 Tema 7: Física Cuántica Eric Calvo Lorente

- 22. Heisenberg y Schrödinger En las décadas iniciales del siglo XX, cada uno de ellos utilizó unas herramientas matemáticas diferentes para elaborar la nueva teoría. El primero se basó en lo que se llaman matrices, y el segundo en un sistema que se conoce como función de onda. Poco después Schrödinger demostró que ambos métodos eran equivalentes, de forma que cualquiera de ellos se puede deducir a partir del otro. Resulta extremadamente curioso el camino que utilizó Heisenberg. Tomó las energías posibles de los electrones en el átomo y elaboró algo a lo que llamó tablas, compuestas por unas operaciones matemáticas que daban resultados acerca de la posición o la velocidad del electrón. Después se percató de que este método de “tablas” ya era utilizado ampliamente por los matemáticos, quienes llamaban matrices a dichas tablas. Este es uno de los ejemplos de abstracciones matemáticas que con el tiempo encuentran aplicación en el mundo real. Sin embargo, es el procedimiento basado en la función de onda de Schrödinger el que se estudia principalmente hoy en día en las universidades, así como el que utilizan físicos y químicos en sus trabajos, por tratarse de un método más manejable. De hecho, el premio Nobel de física Steven Weinberg, confiesa que él mismo no consigue entender las motivaciones qué llevaron a Heisenberg a dar los pasos mentales con los que desarrolló su entramado matemático. Schrödinger y Heisenberg, a partir de los descubrimientos de otros, pusieron los ladrillos de la mecánica cuántica, cada uno de ellos mediante una herramienta matemática distinta, pero ambas equivalentes entre sí. Profundicemos en la que se utiliza comúnmente por ser la más cómoda, la FUNCIÓN DE ONDA DE SCHRÖDINGER. Los descubrimientos de principios del Siglo XX habían culminado con la sorprendente conclusión, por parte de Louis de Broglie, de que la materia se comporta a la vez como cuerpo y como onda, y esto es especialmente decisivo cuando nos referimos a partículas subatómicas. Esta doble condición de las partículas tenía que ser utilizada para profundizar en el estudio del mundo de lo muy pequeño. Así las cosas, Schrödinger, entre los años 1925 y 1926, introdujo la función de onda, también llamada ecuación de Schrödinger, que no es otra cosa que una ecuación que describe la forma en que una partícula cambia con el paso del tiempo. Por tanto, se trata de estudiar las partículas del mismo modo en que se estudian las demás ondas que sentimos a nuestro alrededor, como las sonoras o las producidas en el agua cuando se lanza una piedra a un charco. Típica onda sobre el agua Cualquier tipo de onda queda descrita en cualquier instante mediante una lista de números, un número por cada punto del espacio por el que viaja la onda. Por ejemplo, en el caso de la onda sonora, lo números nos darán la presión del aire en cada punto del espacio (porque es el aire quien transmite el sonido). Otro caso cotidiano es la onda que produce un músico sobre la cuerda de una guitarra cuando la hace sonar, la cual estaría descrita por números que nos darían la tensión de dicha cuerda en cada uno de sus puntos. 22 Tema 7: Física Cuántica Eric Calvo Lorente

- 23. Y del mismo modo, la función de onda de las partículas nos da números concernientes a estas partículas. La peculiaridad de estos números es que son probabilidades, es decir, el valor de la función de onda en cualquier punto nos da la probabilidad de que la partícula se halle en ese punto. A estas alturas, se empezó a entrever que la naturaleza no era tan simple como se creía hasta poco tiempo atrás. Hasta entonces cualquier resultado en física había consistido en un dato preciso, pero a partir de ahora intervenía el azar. Esta concepción que se vislumbraba del Universo no convencía a casi nadie, pero al año siguiente Heisenberg aportó un nuevo argumento decisivo: EL PRINCIPIO DE INCERTIDUMBRE DE HEISENBERG. Heisenberg consideró la dificultad que había en medir la posición y la trayectoria de un electrón. El problema consistía en que para obtener una medida precisa era necesario utilizar luz para ver el electrón. Lo que ocurre es que la luz, al igual que la materia, tiene una doble naturaleza de onda y partícula. Entonces, un electrón al ser iluminado sería golpeado por los fotones (las partículas de la luz), de forma que si su posición era claramente establecida, poco o nada se podría saber sobre su trayectoria, puesto que habría sido desviada por la acción de la luz. A partir de estos argumentos, Heisenberg enunció su principio, que viene a decir que “no es posible conocer a la vez la posición y la trayectoria de una partícula”. Esto parecía lógico visto el problema del fotón golpeando al electrón, pero no lo fue tanto cuando varios físicos, entre los que destacó Niels Bohr, llegaron a la conclusión de que el principio de incertidumbre se cumplía independientemente de si la partícula era iluminada o no. Este principio es una característica intrínseca de la materia, de la cual el caso expuesto por Heisenberg sólo es un ejemplo. Partiendo de la función de onda y de los resultados que nos da en forma de probabilidades, se concluye que no es posible conocer en cada observación más que un número limitado de características de las partículas, dado que la medición de algunas propiedades nos oculta lo referente a las demás. Matemáticamente, el principio queda descrito por la ecuación: . (Cuanto mayor es la precisión en la determinación de la posición, mayor será la incertidumbre o error producido en la determinación de su velocidad (y viceversa) Esta idea nos conduce a otro concepto clave en mecánica cuántica, y aún más insólito si cabe:La SUPERPOSICIÓN Niels Bohr dirigía el Instituto Universitario de Física Teórica de Copenhague, y fue allí donde se dieron algunos de los avances más significativos en esta nueva concepción del mundo que era la mecánica cuántica. Hacia 1930, en esa ciudad danesa ya se manejaban funciones de ondas mucho más complejas que las que describían partículas individuales, de forma que se analizaban y se realizaban predicciones sobre sistemas de numerosas partículas. La interpretación que se llevó a cabo en aquel instituto se basaba en una estricta separación entre el sistema estudiado y el propio estudio que se hacía sobre él, es decir, un sistema tiene unas características definidas, pero estas no se manifiestan hasta que no son observadas. Para entender esto vamos a ver un pequeño ejemplo. Supongamos un sistema formado por una sola partícula que cuenta como característica única con su posición. Esta partícula puede encontrarse en dos posiciones posibles, la posición Cerca y la posición Lejos, entonces su función de onda nos dará la probabilidad de que se halle en la posición Cerca o por el contrario en la posición Lejos. Todo esto, que suena a Barrio Sésamo, es tremendamente simple desde el punto de vista de la mecánica clásica. La partícula estará Cerca o Lejos y si está en un lugar o en otro dependerá de alguna ley física concreta. Sin embargo, la cosa es más complicada en mecánica cuántica. Cuando miramos si está Cerca o Lejos veremos que, efectivamente, estará posicionada en uno de los dos sitios. Pero lo realmente extraordinario ocurre cuando nadie está mirando, en esos momentos la partícula puede estar Cerca, Lejos o, más habitualmente, a la vez Cerca y Lejos. Es aquí cuando se dice que hay una superposición entre los estados Cerca y Lejos y, de hecho, es esa la situación en la que se hallan todos los posibles estados de las partículas que forman los átomos y en definitiva la materia del Universo cuando nadie la está mirando. Entonces, la realidad es que los electrones no se encuentran en órbitas como los planetas alrededor del Sol. Se dice que ocupan orbitales, los cuales son esferas que rodean al núcleo y que se componen de los puntos donde es más probable encontrar al electrón, y cuando nadie los está buscando se hallan difuminados por todo el orbital. Como conclusiones, podemos, en las condiciones en las que nos hallamos, que: 23 Tema 7: Física Cuántica Eric Calvo Lorente

- 24. La mecánica cuántica nos presenta una concepción de la naturaleza que se puede resumir en unos pocos puntos: 1. De todos los estados posibles de las partículas (posición, trayectoria, etc.) sólo se pueden conocer algunos de ellos en cada observación, y nunca todos a la vez, es decir, que la esencia última de la materia no se puede conocer más que en pequeñas “porciones” . 2. Estos estados solamente se manifiestan cuando alguien está observando las partículas, cuando no hay nadie realizando mediciones, se están dando todos los estados posibles a la vez, es decir, nosotros al observar las partículas provocamos que se manifiesten esos estados. Lo cual quiere decir que: 3. Para describir los componentes de la materia no es apropiado referirse a magnitudes como velocidad o posición, lo que describe a un electrón o a cualquier otra partícula en un momento dado es una función de onda. Hay un ejemplo que es todo un clásico y que propuso Schrödinger en 1935, con el fin de ilustrar el enorme embrollo en que la mecánica cuántica había convertido a la física; es la llamada PARADOJA DEL GATO DE SCHRÖDINGER: Imaginemos una caja con un átomo radiactivo en su interior, cuya función de onda predice que tiene un cincuenta por ciento de probabilidades de desintegrarse al cabo de una hora. En esa caja también se encuentra un detector que capta el momento de la desintegración y que está conectado a un circuito eléctrico que acciona un martillo. Además, dentro de la caja también hay un gato y un frasco cerrado lleno de gas venenoso. Cuando el átomo se desintegre, se accionará el circuito y el martilló romperá el frasco y liberará el gas. Nos preguntamos si, transcurrida una hora, el gato sigue vivo o ha muerto. Si alguien abre la caja podrá comprobarlo por si mismo, pero si nadie lo hace, el estado del átomo se hallará en una situación de superposición entre los estados “desintegrado y “no desintegrado”, es decir, estará desintegrado y sin desintegrar a la vez. Entonces sólo podemos concluir que el gato está vivo y muerto a la vez. Nadie ha visto un gato vivo y muerto a la vez, pero siendo estrictos, esto es porque al efectuar la observación, el sistema manifiesta uno de los dos posibles estados: “vivo” o “muerto”. Lógicamente, esto no tiene sentido, y ahí es a donde quería llegar Schrödinger. Ni el mismo creía las consecuencias a las que había llevaba su propia función de onda. Lo que es indudable es que la mecánica cuántica no ha dejado de cosechar éxitos a la hora de describir el funcionamiento de la materia. La función de onda puede utilizarse para estudiar todos los átomos, moléculas o metales, y encuentra numerosas aplicaciones, de forma que puede predecir el color de un cierto tinte, la energía liberada en una combustión, el magnetismo de un nuevo material o incluso la velocidad a la que se descompone el ozono en la atmósfera. Tanto es así que un 20 por ciento del Producto Interior Bruto de los Estados Unidos se debe a aplicaciones de la mecánica cuántica. Mientras algunos científicos se dedican simplemente a aplicar la física cuántica, obteniendo grandes logros, otros no pueden evitar filosofar sobre lo que supone todo esto. Stephen Hawking opina que lo de menos es comprender el funcionamiento íntimo de la naturaleza, que lo realmente importante es contar con una herramienta que nos permita hacer predicciones, y la mecánica cuántica nos sirve a la perfección. Otros anteriores, como Richard Feynman argumentaron de la misma manera. Albert Einstein nunca pudo digerir esta interpretación de la naturaleza y pronunció su famosa frase “Dios no juega a los dados”, no aceptaba que la teoría que describía el mundo subatómico se basara en probabilidades. Sin embargo Hawking opina que “no sólo juega a los dados sino que además los arroja donde nadie puede verlos”. Aunque a Einstein la física cuántica le quedó grande, a pesar de que fue uno de sus padres con la descripción del efecto fotoeléctrico, él solito elaboró el otro gran pilar de la Física moderna: la Teoría de la Relatividad. ) 24 Tema 7: Física Cuántica Eric Calvo Lorente

- 25. El método científico, apoyado en hipótesis, es el instrumento mediante el cual se desarrolla y adquiere nuevo conocimiento en las ciencias naturales. La homogeneidad e isotropía del espacio y la homogeneidad del tiempo son otras hipótesis de trabajo no empíricas que se establecen en la física clásica. La homogeneidad del tiempo se refiere a la equivalencia entre cualesquier dos instantes de tiempo, independientemente de en que momento se tomen. El concepto de homogeneidad del tiempo se introduce en forma práctica al utilizar marcos de referencia donde el origen de coordenadas puede seleccionarse arbitrariamente. Una forma equivalente de expresar la homogeneidad del tiempo es plantear que las leyes de la física son las mismas ahora que hace mil años. La aplicabilidad de este principio se lleva a cabo al observar los fenómenos que ocurren en estrellas o galaxias lejanas y usamos los conocimientos de física actuales para interpretarlos. La información que nos llega del espacio exterior, es radiación electromagnética (luz visible, ondas de radio, microondas, rayos X, etc.), la cual fue emitida hace miles o millones de años, dependiendo de la distancia de la estrella o galaxia que estemos observando. Las conclusiones que obtenemos se realizan basadas en nuestro conocimiento actual de la física, y esto lleva implícito la suposición de que las leyes de la física hace miles o millones de años, cuando se emitió la radiación, son las mismas que las de ahora. La homogeneidad del tiempo, está implícita en el hecho de que el origen del tiempo es completamente arbitrario Similarmente, la hipótesis de isotropía del espacio aparece en el hecho de que la orientación de los ejes de coordenadas, los cuales nos sirven de marco de referencia para analizar un fenómeno físico, es arbitraria. Por su parte, el concepto de homogeneidad del espacio significa que las leyes de la física tienen validez en todos los lugares del Universo. La isotropía del espacio nos dice que si un experimento es efectuado en un laboratorio donde el equipo experimental tenga una cierta orientación espacial, los resultados obtenidos serán los mismos si la orientación de todos los instrumentos, el sistema que se va a analizar y el medio ambiente se modifica. Las hipótesis de homogeneidad del tiempo y del espacio, así como la de isotropía del espacio, son utilizadas permanentemente en toda la física y la ingeniería. En el diseño de una construcción no se piensa que dentro de 10 años se pueda colapsar debido a que los principios físicos y ecuaciones utilizadas en los cálculos vayan a cambiar. La homogeneidad e isotropía del espacio así como la homogeneidad del tiempo, son hipótesis de trabajo para iniciar la construcción de un cuerpo de doctrina que permita explicar los fenómenos de la naturaleza. Estas hipótesis conducen a las leyes de conservación sobre los que se apoya toda la física: conservación del momento lineal, del momento angular y de la energía. Estos resultados tienen hasta el momento validez universal, no se ha encontrado hasta hoy ningún hecho experimental que los ponga en duda. Por otra parte, existen hipótesis en la física prerelativista acerca del espacio y el tiempo donde se considera a estos como absolutos, es decir con propiedades que no dependen ni de la presencia de materia ni de los observadores que midan estas propiedades. Para Newton, el espacio es absoluto, es el escenario donde ocurren los fenómenos naturales y permanece siempre idéntico e inmóvil, sin relación a las cosas externas, y el tiempo es algo que fluye sin relación con nada, independientemente de la materia y su movimiento. Estas ideas permitieron el desarrollo de la física clásica. Sin embargo, con el advenimiento de la teoría de la relatividad desarrollada por Einstein, estos conceptos sufrieron modificaciones no sin provocar gran desconcierto entre los físicos debido a que estos conllevan un cambio que está más allá de nuestra experiencia inmediata. Un principio de la física clásica conocido como Relatividad Galileana, establece la forma como dos observadores que se encuentran en movimiento relativo a velocidad constante, relacionan sus observaciones de los fenómenos físicos. Este principio nos lleva a que las leyes de la mecánica son las mismas para todos los observadores, y está apoyado en los conceptos de espacio y tiempo absolutos. 25 Tema 7: Física Cuántica Eric Calvo Lorente

- 26. Cualquier método o mecanismo de medida necesita un sistema de referencia, un punto origen sobre el que basar las diferentes mediciones. Podríamos decir que es la consecuencia del principio tautológico de que todo movimiento es relativo. Bajo el marco de la Mecánica Clásica, los fenómenos fisicos pueden explicarse bajo el marco dado por el Principio de Relatividad de Galileo, del siglo XVII, que dice que “CUALQUIER EXPERIMENTO MECÁNICO TENDRÁ LAS MISMAS CARACTERÍSTICAS EN UN SISTEMA EN REPOSO QUE EN UNO CON VELOCIDAD CONSTANTE RESPECTO AL PRIMERO”. En un sistema espacial, un punto se puede determinar fácilmente dentro de su sistema de referencias o cambiar de sistema mediante un ajuste del origen del nuevo sistema respecto del primero en cada instante o momento. Las magnitudes correspondientes de un sistema a otro se pueden obtener con sencillez a partir de las transformaciones de Galileo. Estudiaremos, a la luz de lo anteriormente expuesto, la descripción de un mismo fenómeno físico que harán dos observadores en movimiento rectilíneo uniforme uno respecto a otro. Si se prefiere, puede pensarse que el sistema S (O,X,Y,Z) está "fijo" y el sistema S' (O',X',Y',Z,) se mueve respecto al anterior con una velocidad constante u. Escogiendo el eje de las X en la dirección del movimiento, y suponiendo que el origen de ambos sistemas es común inicialmente, podemos escribir, mirando simplemente la figura, que las coordenadas de un punto P descritas por el observador fijo en el sistema S y las descritas por un observador que acompaña al sistema móvil S' están relacionadas por las ecuaciones siguientes: x´ x ut y´ y z´ z Pero, además de estas tres ecuaciones que relacionan las coordenadas espaciales, y que son evidentes, los dos observadores deben tomar medidas de tiempos, en cuanto quieran hacer comparaciones entre sus resultados de posición, velocidad, etc. Dado que el tiempo es una variable independiente, no podemos extraer conclusiones válidas sobre los valores que puedan medir los dos observadores a partir de razonamientos basados en otras variables. Newton mismo aborda posteriormente esta dificultad, y escribe: "El tiempo matemático, verdadero, absoluto, transcurre en sí y por su propia naturaleza de modo uniforme sin estar referido a ningún otro objeto externo". Es decir, se supone que: t´ Esta hipótesis es compatible con nuestra experiencia cotidiana, pero más adelante veremos que es sólo una aproximación válida en el marco galileano de velocidades pequeñas, pero que se deberá cambiar en el marco de la Teoría de la Relatividad restringida de Einstein. Las cuatro ecuaciones anteriores forman lo que se ha dado en llamar Transformación de Galileo entre dos sistemas de referencia inerciales. Y, de acuerdo con el Principio de Relatividad de Galileo, podemos afirmar que las leyes físicas son invariantes bajo una transformación de Galileo. Este último enunciado no es equivalente al Principio de Relatividad de Galileo, ya que la hipótesis t'=t restringe su validez general. Podemos pensar que el Principio de Invarianza de las 26 Tema 7: Física Cuántica Eric Calvo Lorente