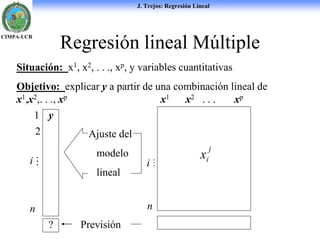

Regresión Lineal Múltiple

- 1. J. Trejos: Regresión Lineal CIMPA-UCR Regresión lineal Múltiple Situación: x1, x2, . . ., xp, y variables cuantitativas Objetivo: explicar y a partir de una combinación lineal de x1,x2,. . ., xp ? Previsión Ajuste del modelo lineal n i n i 1 2 y x1 x2 . . . xp j i x

- 2. J. Trejos: Regresión Lineal CIMPA-UCR

- 3. J. Trejos: Regresión Lineal CIMPA-UCR i p i p i i i e x b x b x b b y + + + + + = 2 2 1 1 0 = n e e e 1 vector de residuos o errores Estimación: = + = p j j i j i x b b y 1 0 ˆ Modelo Lineal

- 4. J. Trejos: Regresión Lineal CIMPA-UCR Forma Matricial y yi n 1 = 1 1 1 1 2 1 i i x x . . . p i x n (p+1) x b0 b1 b2 bp + b e ei (p+1) 1 n 1 y = Xb + e

- 5. J. Trejos: Regresión Lineal CIMPA-UCR Problema: escoger b = p b b b 1 0 tal que los residuos sean mínimos Criterio: Mín = Mín = Mín 2 ŷ y − 2 e = n i i e 1 2 Criterio de Mínimos Cuadrados

- 6. J. Trejos: Regresión Lineal CIMPA-UCR Formulación Geométrica En Rn: (centradas) e 2 2 1 1 ˆ x b x b y + = x2 x1 Por teorema de Pitágoras y 2 2 2 ˆ e y y + = Varianza explicada Varianza residual ) ˆ var( ) ˆ var( ) var( y y y y − + =

- 7. J. Trejos: Regresión Lineal CIMPA-UCR Calidad: R2 = cos2 = 2(y, ) ŷ ŷ es la proyección de y sobre el espacio generado por 1, x1,x2,...,xp total varianza explicada varianza ) var( ) ˆ var( ˆ cos 2 2 2 = = = y y y y

- 8. J. Trejos: Regresión Lineal CIMPA-UCR Problema a Minimizar Si D = I n 1 ( ) ( ) Xb y Xb y e e e t t − − = = 2 Xb X b y X b y y t t t t t + − = 2 2 e tiene mínimo si ( ) 0 = e e b t (1+p) 1

- 9. J. Trejos: Regresión Lineal CIMPA-UCR Xb X y X e e b t t t 2 2 ) ( + − = Hay mínimo si Xt Xb = Xt y Si Xt X es invertible entonces la solución es : b = (Xt X)-1 Xt y Si n > p+1 y rang (x) = p+1 (poca correlación), entonces Xt X es invertible. Solución de la Regresión Lineal

- 10. J. Trejos: Regresión Lineal CIMPA-UCR Regresión Lineal: Solución Geométrica Sean W: espacio generado por x1, . . . , xp,1n = P D = n p p D 0 0 1 métrica de pesos en Rn A: Rn → Rn proyector ortogonal sobre W y y ˆ A cumple: ( ) 0 ˆ ˆ = − y D y y t ortogonalidad

- 11. J. Trejos: Regresión Lineal CIMPA-UCR a W y ˆ ˆ tal que a X y ˆ ˆ = Ecuaciones normales: 0 ˆ , = − D j y y x para j p ,..., 1 (xj)t D ( ) ( ) a DX x Dy x y y t j t j ˆ ) ( 0 ˆ = = − a DX X y D X t t ˆ = Si rang (X)= p+1 • Xt DX es invertible • Dy X DX X a t t 1 ) ( ˆ − = Obs: si I n D 1 = entonces ( ) y X X X a t t 1 ˆ − = Luego, ( ) Dy X DX X X a X y t t 1 ˆ ˆ − = = • A = X(Xt DX)-1 Xt D proyector ortogonal

- 12. J. Trejos: Regresión Lineal CIMPA-UCR W y ˆ hace ángulo mínimo con y ( ) 2 2 2 2 ˆ ˆ ˆ y y y y y y y + − = + − = (Teorema de Pitágoras) Como 2 y es constante: 2 2 ˆ max ˆ min y y y − ( ) 2 2 2 2 max ˆ , cos max ˆ max R y y y y Expresiones del Criterio

- 13. J. Trejos: Regresión Lineal CIMPA-UCR Calidad de Regresión R2: coeficiente de determinación • Coseno: R2 = cos2 = cos2 (y, ) • Correlación: R2 = r2 (y, ) • Varianza: R2= ŷ ŷ ( ) = y y var ) ˆ var( varianza explicada varianza total

- 14. J. Trejos: Regresión Lineal CIMPA-UCR R2 (y, ) = ŷ ( ) ( ) ( ) 2 2 2 2 ˆ ˆ , ˆ var var ˆ , cov y y y y y y y y = ( ) ( ) 2 2 ˆ var ˆ var y y y y = Hay igualdad ( ) y X b y X X X X X b Xb Xb Xb y Xb y y y y y t t t t t t t t t = = = = = = −1 2 2 ) ( ˆ ˆ ˆ , 2 ˆ ˆ , y y y =

- 15. J. Trejos: Regresión Lineal CIMPA-UCR Número de l‘ observation y x1 x2 x3 x4 1 40 8 32 51 104 2 50 12 40 11 74 3 50 11 38 18 96 4 70 12 60 99 97 5 90 14 70 50 89 6 95 15 70 64 86 7 100 18 85 68 73 8 105 17 90 24 64 9 110 20 90 96 64 10 105 21 80 97 74 11 120 21 100 65 59 12 125 22 110 97 57 13 130 23 105 23 41 14 140 23 120 73 44 15 155 24 130 94 38 16 160 25 135 90 22 17 175 25 130 93 31 18 180 26 160 96 24 19 195 29 170 99 11 20 205 30 175 105 18

- 16. J. Trejos: Regresión Lineal CIMPA-UCR Ejemplo 016 . 0 018 . 0 862 . 0 742 . 1 629 . 0 ˆ 4 3 2 1 0 4 4 3 3 2 2 1 1 0 − = = = = − = + + + + = B B B B B X B X B X B X B B y 985 . 0 ) , ( 2 2 2 = = y y R 98.5% de la variación de y puede ser explicada por x1,x2,x3,x4

- 17. J. Trejos: Regresión Lineal CIMPA-UCR Variable y x1 x2 x3 x4 Media 120.0 19.80 99.50 70.65 58.30 Desv. Est. 48.12 6.21 42.28 31.25 28.57 Correl. y x1 x2 x3 x4 1,00 0,97 0,99 0,63 -0,95 1,00 0,97 0,61 -0,95 1,000 0,63 - 0,95 1,00 -0,47 1,00

- 18. J. Trejos: Regresión Lineal CIMPA-UCR 3 2 1 0 -2 50 100 150 200 250 17 6 5 1 3 13 -1 2 4 15 16 20 10 8 11 9 7 14 18 19 12 ŷ e est.

- 19. J. Trejos: Regresión Lineal CIMPA-UCR 3 2 1 0 -2 10 15 20 25 17 6 5 1 3 13 -1 2 4 15 16 20 10 8 11 9 7 14 18 19 12 30 x1 e est.

- 20. J. Trejos: Regresión Lineal CIMPA-UCR Regresión Regularizada ¿Qué pasa si XtX no es invertible? ¿Qué hacer si hay problemas numéricos al invertir XtX? Solución: 1) Hacer un A.C.P sobre X se obtienen componentes principales ortogonales tabla Z Zt Z si es invertible 2) Hacer regresión de y sobre Z

- 21. J. Trejos: Regresión Lineal CIMPA-UCR Ventajas: * el ACP de X permite detectar posibles errores y puntos atípicos de la tabla de datos. * hay estabilidad en la regresión

- 22. J. Trejos: Regresión Lineal CIMPA-UCR Regresión Paso a Paso • Si hay muchas variables explicativas • Si hay correlación entre las x1, . . ., xp 1. Se hace una regresión simple de y sobre cada xj se escoge “el mejor”: x1 con mayor R2 2. Se hace una regresión “doble” de y sobre x1 y cada xj que queda se escoge “el mejor”: x2 con mayor R2 3. Y así sucesivamente, hasta xq (q < p)

- 23. J. Trejos: Regresión Lineal CIMPA-UCR Queda q q x b x b x b b y + + + + = ... ˆ 2 2 1 1 0 Detenerse cuando , donde: F F ~ 1 ~ 2 1 2 − − = = q n e e F i n i i F: distribución de Fisher con (n – q – 1, 1) grados de libertad

- 24. J. Trejos: Regresión Lineal CIMPA-UCR Ejemplo: Regresión Lineal Química (ind. cemento) y: cantidad de calor emanada x1,x2,x3,x4: dosis químicas n= 13 Paso 1: correlaciones y 0.731 0.816 -0.535 -0.821 Se escoge x4 x1 x2 x3 x4 4 738 . 0 57 . 117 ˆ x y − = 8 . 22 ~ = F

- 25. J. Trejos: Regresión Lineal CIMPA-UCR Paso 2: se escoge x1 1 . 103 ˆ = y 1 4 44 . 1 614 . 0 x x + − F ~ 159.3 108.2 R = 0.986 Paso 3: se escoge x2 55 . 71 ˆ = y 2 1 4 416 . 0 452 . 1 237 . 0 x x x + + − F ~ 1.86 154.01 5.02 R= 0.991 r(x2 , x4 ) = -0.973

- 26. J. Trejos: Regresión Lineal CIMPA-UCR si se quita x4: 58 . 52 ˆ = y 2 1 662 . 0 468 . 1 x x + + F ~ 146.5 208.6 R= 0.989

- 27. J. Trejos: Regresión Lineal CIMPA-UCR Análisis de la varianza: Regresión sobre variables nominales Sean x1,x2, . . .,xp con m1,m2, . . .,mp modalidades Tabla explicativa con indicatrices (codificación disyuntiva completa) Obs: Xt X no es invertible Suprimir una columna a cada variable explicativa p X X X X 2 1 = ( ) = − = p k k m x rang 1 1 ) (

- 28. J. Trejos: Regresión Lineal CIMPA-UCR 1 0 0 0 1 0 0 0 0 1 0 0 X1 0 0 0 1 0 0 01 0 0 1 1 0 0 1 0 0 X2 0 0 1 0 1 0 X= 1 0 0 1 0 0 0 1 0 -1 -1 –1 -1 -1 -1 -1 -1 1 0 1 0 -1 -1 0 1 = X̂ 1 X̂ 2 X̂ Tabla disyuntiva completa inicial Tabla de rango pleno asociado •Se hace la regresión de y sobre •Puede ser con interacción o sin ella, etc... X̂