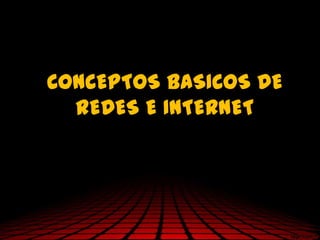

Este documento describe los conceptos básicos de las redes de computadoras e Internet. Explica qué son las redes LAN y WAN, la topología de las redes, el modelo cliente-servidor, e Internet. También resume brevemente la historia del desarrollo de Internet y los elementos de hardware y software que componen una red.

![Hypertext Transfer Protocol Secure ( HTTPS ) es ampliamente utilizado un protocolo de

comunicaciones para el seguro de comunicación a través de una red informática , con el despliegue

especialmente ancha en el Internet . Técnicamente, no es un protocolo en sí mismo, sino que es

simplemente el resultado de estratificación el Hypertext Transfer Protocol (HTTP) en la parte superior

de la SSL / TLS protocolo, añadiendo así las capacidades de seguridad de SSL / TLS estándar para

las comunicaciones HTTP.

En su despliegue popular en Internet, HTTPS proporciona autenticación del sitio web y asociadas

servidor web que se está comunicando, que protege contra el Man-in-the-middle .

Además, proporciona bidireccional cifrado de las comunicaciones entre un cliente y un servidor, que

protege contra las escuchas y la manipulación y / o forjado del contenido de la comunicación. [ 1 ] En

la práctica, esto proporciona una garantía razonable de que se está comunicando con precisión la

web sitio que uno destinado a comunicar con (en oposición a un impostor), así como para asegurar

que el contenido de las comunicaciones entre el usuario y el sitio no puede ser leído o falsificado por

terceros.

Debido HTTPS piggybacks HTTP enteramente en la parte superior de TLS, la totalidad de la

subyacente protocolo HTTP se pueden cifrar. Esto incluye la URL de la solicitud (que determinada

página web se solicita), parámetros de consulta, encabezados y galletas (que a menudo contienen

información acerca de la identidad del usuario). Sin embargo, dado acogida (sitio web) direcciones y

números de puerto son necesariamente parte del subyacente TCP / IP protocolos HTTPS no puede

proteger a su divulgación. En la práctica esto significa que, incluso en un servidor correctamente

configurado espías web todavía se puede inferir la dirección IP y número de puerto del servidor web

(incluso a veces el nombre de dominio www.example.org por ejemplo, pero no el resto de la URL) que

uno es comunicarse con, así como la cantidad (datos transferidos) y la duración (duración de la

sesión) de la comunicación, pero no el contenido de la comunicación.](https://image.slidesharecdn.com/conceptosbasicosderedeseinternet-121021110517-phpapp01/85/Conceptos-basicos-de-redes-e-internet-57-320.jpg)

![Se llama spam, correo basura o mensaje basura a los mensajes no solicitados, no deseados o de

remitente no conocido (correo anónimo), habitualmente de tipo publicitario, generalmente enviados en

grandes cantidades (incluso masivas) que perjudican de alguna o varias maneras al receptor. La

acción de enviar dichos mensajes se denomina spamming. La palabra spam proviene de la segunda

guerra mundial, cuando los familiares de los soldados en guerra les enviaban comida enlatada, entre

estas comidas enlatadas, estaba una carne enlatada llamada spam, que en los Estados Unidos era y

sigue siendo muy común.[cita requerida]

Aunque se puede hacer spam por distintas vías, la más utilizada entre el público en general es la

basada en el correo electrónico. Otras tecnologías de Internet que han sido objeto de correo basura

incluyen grupos de noticias, usenet, motores de búsqueda, redes sociales, páginas web wiki, foros,

web logs (blogs), a través de ventanas emergentes y todo tipo de imágenes y textos en la web.

El correo basura también puede tener como objetivo los teléfonos móviles (a través de mensajes de

texto) y los sistemas de mensajería instantánea como por ejemplo Outlook, Lotus Notes,Windows live

,etc.

También se llama correo no deseado a los virus sueltos en la red y páginas filtradas (casino, sorteos,

premios, viajes, drogas, software y pornografía), se activa mediante el ingreso a páginas de

comunidades o grupos o acceder a enlaces en diversas páginas o inclusive sin antes acceder a

ningún tipo de páginas de publicidad.](https://image.slidesharecdn.com/conceptosbasicosderedeseinternet-121021110517-phpapp01/85/Conceptos-basicos-de-redes-e-internet-61-320.jpg)