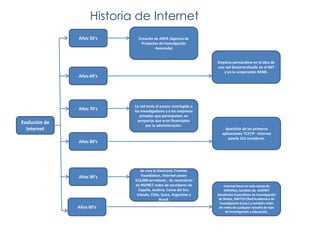

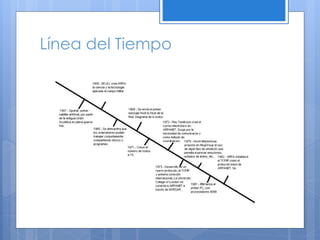

El documento describe brevemente la historia de Internet. Se creó en la década de 1950 por la Agencia de Proyectos de Investigación Avanzada (ARPA) del Departamento de Defensa de EE. UU. para fines de investigación, y en las décadas siguientes se expandió su uso a universidades y empresas privadas. En la actualidad, Internet conecta miles de redes de todo tipo y tamaño de todo el mundo.