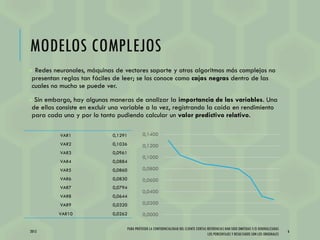

El documento describe el proceso de knowledge discovery (descubrimiento de conocimiento) realizado para una empresa de marketing directo. Se utilizó un árbol de decisión para identificar las variables predictivas clave y sus relaciones con la probabilidad de compra. Adicionalmente, se evaluó la importancia relativa de las variables y se examinaron gráficos de correlación para analizar las relaciones con la tasa de respuesta. El proceso permitió a la empresa comprender mejor qué tipo de clientes estaban respondiendo a sus campañas de marketing.