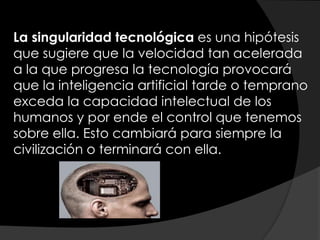

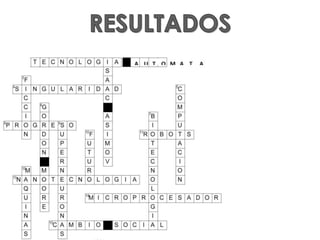

La singularidad tecnológica se refiere a un futuro evento en el que la inteligencia artificial superará la inteligencia humana y cambiará drásticamente la civilización. Se prevé que esto ocurra a medida que la tecnología como la computación y la robótica continúen avanzando a un ritmo acelerado, posiblemente llevando a la creación de superinteligencia a través de computadoras, redes de computadoras, mejoras biológicas o interfaces humano-máquina. Existe el riesgo de que un