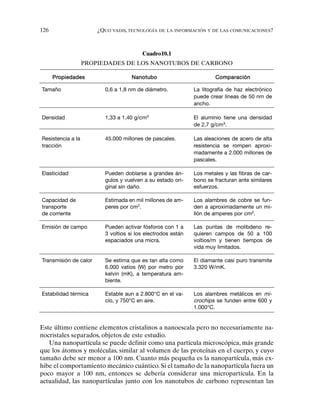

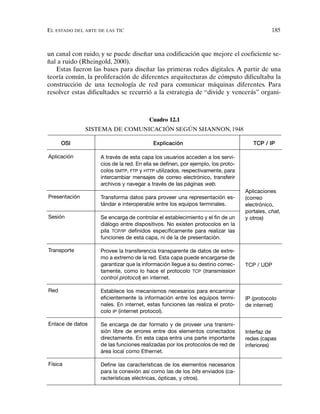

Este documento presenta una introducción a la tercera parte del libro, la cual describe el estado actual de las TIC. La tercera parte examinará campos emergentes como la nanotecnología y la biotecnología, que se están fusionando con las TIC. También analiza temas como sensores, interfaces, redes, computación, almacenamiento y TIC biológicas. El documento explica que estas nuevas tecnologías ofrecen soluciones a las necesidades de procesar, almacenar e intercambiar información de manera más