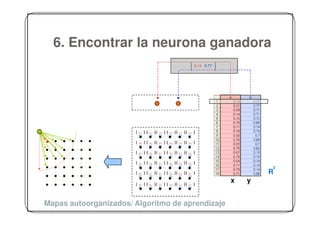

Este documento describe los conceptos fundamentales de las redes neuronales competitivas y los mapas autoorganizados de Kohonen. Explica cómo estas redes se inspiran en procesos biológicos como la autoorganización neuronal y cómo aprenden mediante competición entre neuronas para clasificar datos de entrada de forma no supervisada. Finalmente, detalla los pasos para crear un modelo de mapa autoorganizado, incluyendo la inicialización de pesos y la determinación de la topología y el tamaño de la red.