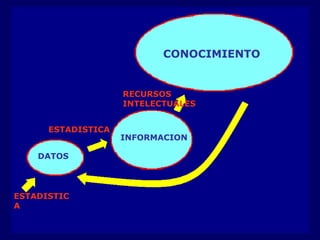

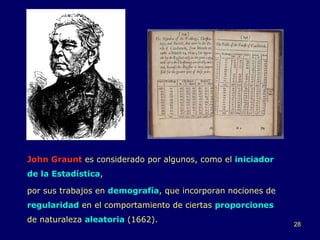

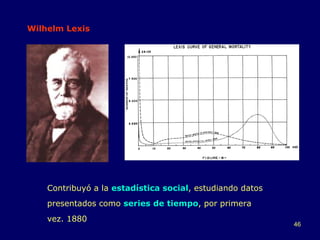

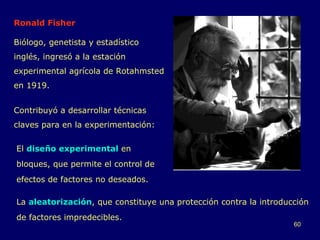

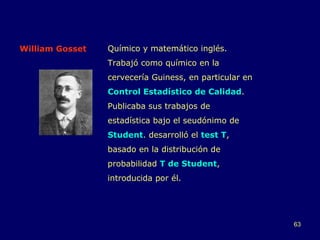

Este documento resume la historia del desarrollo de la estadística desde sus orígenes remotos en el registro de datos por civilizaciones antiguas como Egipto y Babilonia, hasta su evolución como ciencia independiente en los siglos XVIII y XIX con contribuciones de figuras como Gauss, Quetelet y Galton. Destaca hitos como el surgimiento de la teoría de probabilidad en los trabajos de Pascal, Fermat y Huygens, y el desarrollo de métodos estadísticos modernos por parte de Pearson, Neyman y Fisher en el sig