El documento presenta una introducción a las máquinas de soporte vectorial (SVM), modelos de machine learning utilizados para clasificación y regresión, inicialmente desarrollados para clasificación binaria y luego extendidos a múltiples clases. Se explica la noción geométrica del hiperplano óptimo de separación y el problema de optimización convexa necesario para obtener este hiperplano, así como la generalización para casos no linealmente separables y el uso del truco del kernel para transformar espacios. Además, se abordan los fundamentos matemáticos detrás de las SVM, incluidos espacios de Hilbert y funciones kernel.

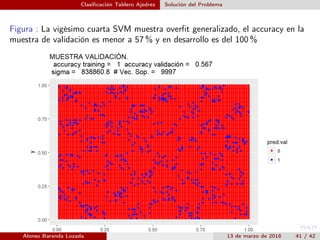

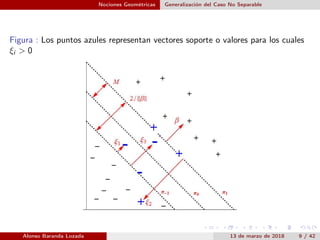

![Fundamentos Matemáticos Espacios RKHS

Las SVM son un caso particular del siguiente teorema, el cual afirma

que las soluciones de una minimización de una funcional de riesgo en

un RKHS son combinaciones lineales de la muestra de entrenamiento

Teorema

(Teorema de Representación) Sea k : X × X → R un KSPD y H el

RKHS asociado a k. Sean S = (x1, y1) , . . . , (xm, ym) ⊆ X × R, una

muestra de entrenamiento, c : X × R2 m

→ R ∪ {∞} una función de

penalización, g : [0, ∞) → R una función no decreciente, el problema de

regularización

ínfh∈Hc [(x1, y1, h(x1)) , . . . , (xm, ym, h(xm)))] + g ( h H) ,

puede ser resuelto considerando únicamente funciones f con la siguiente

representación

f (·) =

m

i=1

αi k(·, xi )

Alonso Baranda Lozada 13 de marzo de 2018 22 / 42](https://image.slidesharecdn.com/1830-rkhsalonsobaranda-180321223811/85/RKHS-teoria-y-aplicaciones-con-machine-learning-37-320.jpg)

![Fundamentos Matemáticos Espacios RKHS

El Lema de Equivalencia, expresa el problema de optimización de SVM

(caso no separable), como un método de penalización

Lema

(Equivalencia de SVM) El problema de optimización

ínfβ∈Rp,b∈R

N

i=1

[1 − yi (β · xi + b)]+ +

λ

2

β 2

(18)

con λ = 1

C , es equivalente al problema de optimización de SVM (caso no

separable)

1

C

ínfβ∈Rp,b∈R,ξ∈RN C

N

i=1

ξi +

1

2

β 2

sujeto a

ξi ≥ 0, ξi ≥ 1 − yi (β · xi + b) , 1 ≤ i ≤ N

Alonso Baranda Lozada 13 de marzo de 2018 23 / 42](https://image.slidesharecdn.com/1830-rkhsalonsobaranda-180321223811/85/RKHS-teoria-y-aplicaciones-con-machine-learning-39-320.jpg)

![Clasificación Tablero Ajedrez Planteamiento Problema

Problema de Clasificación en un Tablero de Ajedrez.

N observaciones son simuladas, distribuidas uniformemente en el cuadrado

C = [0, 1] × [0, 1].

El cuadrado C tiene una cuadrícula con cuadros blancos y negros, como un

tablero de ajedrez, y cada observación simulada en C pertenece al color

{blanco, negro} del cuadrado donde se encuentra. Formalmente, sea

1 < k ∈ N, para 1 ≤ l ≤ N, sea Xl = (xl,1, xl,2) las coordenadas del l-ésimo

dato simulado en C, definimos al , bl ∈ {1, . . . , k} como los enteros que

satisfacen

(al − 1)/k ≤ xl,1 < al /k, (bl − 1)/k ≤ xl,2 < bl /k,

la clase yl de Xl es -1 si

al + bl ≡ 0 m«od 2,

y 1 si

al + bl ≡ 1 m«od 2,

en este caso tenemos una cuadricula con c = k2

cuadrados.

Alonso Baranda Lozada 13 de marzo de 2018 32 / 42](https://image.slidesharecdn.com/1830-rkhsalonsobaranda-180321223811/85/RKHS-teoria-y-aplicaciones-con-machine-learning-61-320.jpg)