Curlineales

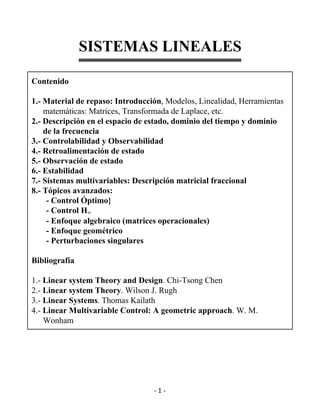

- 1. SISTEMAS LINEALES Contenido 1.- Material de repaso: Introducción, Modelos, Linealidad, Herramientas matemáticas: Matrices, Transformada de Laplace, etc. 2.- Descripción en el espacio de estado, dominio del tiempo y dominio de la frecuencia 3.- Controlabilidad y Observabilidad 4.- Retroalimentación de estado 5.- Observación de estado 6.- Estabilidad 7.- Sistemas multivariables: Descripción matricial fraccional 8.- Tópicos avanzados: - Control Óptimo} - Control Hº - Enfoque algebraico (matrices operacionales) - Enfoque geométrico - Perturbaciones singulares Bibliografía 1.- Linear system Theory and Design. Chi-Tsong Chen 2.- Linear system Theory. Wilson J. Rugh 3.- Linear Systems. Thomas Kailath 4.- Linear Multivariable Control: A geometric approach. W. M. Wonham -1-

- 2. 1.- INTRODUCCIÓN Objetivo: Estas notas presentan el material introductorio básico encaminado a soportar un curso de Sistemas Lineales Avanzados. Prerrequisitos: Es recomendable tener antecedentes básicos en el área de circuitos eléctricos, además de los cursos básicos de álgebra, cálculo diferencial e integral, números complejos y ecuaciones diferenciales. Glosario Se propone iniciar con la elaboración de un glosario, en donde se incluyan los términos que se habrán de aclarar a lo largo del curso, entre ellos, se proponen los siguientes: Sistema lineal convolución respuesta impulsiva alcanzabilidad observabilidad estabilidad asintótica espacio lineal controlabilidad independencia lineal valores propios estabilidad exponencial estabilidad según Lyapunov matriz de transición de estados función transferencia formas canónicas forma de Smith - Mc Millan Teorema de Cayley - Hamilton descripción matricial fraccional valores singulares transformaciones de similaridad robustez observación de estado ... -2-

- 3. ¿Porqué los Sistemas Lineales? La interpretación de la realidad en términos cuantificables y con propósitos no sólo de explicarla, sino también de alterarla o incidir en ella para lograr algún fin nos ha llevado a partir de la física (que es el la interpretación detallada de algunos aspectos de la realidad) al concepto más manejable y pragmático de sistema. El poder sintético de este concepto se ha probado en diversos campos, no sólo de la ingeniería, sino últimamente inclusive en ciencias sociales, tales como algunos enfoques en administración y manejo de recursos humanos. El término sistema es utilizado en una gran diversidad de maneras, es difícil dar una definición que abarque todos los usos que se le da a este término y que a la vez sea suficientemente concisa para resultar útil. La siguiente pretende ser una definición de sistema que reúne estos requisitos O Un sistema es un conjunto de objetos que interactúan entre sí o que son interdependientes entre sí. El concepto de sistema permite plantear la comprensión de la realidad en dos grandes etapas: þ identificando sistemas físicos þ estableciendo las reglas o leyes que los describen Esta descripción de los sistemas no es necesariamente completa ni precisa, sino adecuada a nuestra finalidad. A un sistema que hemos identificado para interpretar parte de la realidad la llamamos modelo, de hecho, en ocasiones los términos modelo y sistema se usan indistintamente. Sencillez Vs. Exactitud Un modelo nunca es una representación completa de la realidad y de ahí vienen sus ventajas y sus desventajas: - es ventajoso porque implica sencillez -3-

- 4. - es desventajoso porque implica inexactitud Sencillez y exactitud son dos características deseables en un modelo, sin embargo, conforme se gana en una se pierde en la otra y esto ha dado lugar a toda una gama de modelos diferentes para representar un mismo sistema o una misma situación. En este contexto, los modelos lineales son para muchos, los modelos que sin ser demasiado complejos proporcionan una buena dosis de exactitud en la representación de una gran variedad de sistemas físicos. Clasificación de modelos Los modelos se pueden clasificar desde diversos puntos de vista: - Por su manera de considerar el tiempo: continuos y discretos - Por su naturaleza: físicos, matemáticos, lógicos - Por su predictibilidad: determinísticos, estocásticos Una clasificación más detallada se muestra en la siguiente figura SISTEMA FÍSICO MODELO LÓGICO FÍSICO MATEMÁTICO ESTÁTICO DINÁMICO NUMÉRICO ANALÍTICO NUMÉRICO SIMULACIÓN Figura 1. Clasificación de modelos. -4-

- 5. Modelos matemáticos Los modelos matemáticos son especialmente útiles por su bajo costo, su formalidad, su gran flexibilidad y su conversión directa a modelos numéricos que pueden ser simulados en una computadora. Sin embargo, los modelos matemáticos, al igual que otros modelos heredan el conflicto entre sencillez y exactitud, de manera que a través del desarrollo de esta área se han buscado diferentes puntos medios entre estos dos extremos. Equilibrio Exactitud (?) Sencillez S. lineales S. no lineales S. estáticos p. concentrados p. distribuídos p. invariantes en el tiempo estocásticos determinísticos variantes en el tiempo orden infinito implícitos singulares con retardo, etc... Los diversos grados de complejidad y exactitud se ilustran en la figura 2 Figura 2. Grados de complejidad de los modelos Una de las consideraciones impuestas tradicionalmente a los modelos en ingeniería ha sido la linealidad, sin embargo, no es la única que permite un tratamiento sencillo sin perder demasiada exactitud en un gran número de casos prácticos. en la siguiente tabla se muestran las consideraciones más usuales -5-

- 6. Consideración Significado Linealidad Es válido el principio de superposición entre cualquier par entrada - salida (en estado estacionario) Parámetros Las dimensiones de los componentes del sistema concentrados son pequeñas comparadas con las longitudes de onda de las frecuencias de las señales involucradas Invariancia en el tiempo Ningún componente del sistema contiene parámetros que cambian con el tiempo Causalidad El sistema no responde antes de que se le aplique alguna entrada En estas notas la única consideración que se cambiará en ocasiones es la de invariancia en el tiempo, así, se tratarán los SLIT (Sistemas Lineales Invariantes en el Tiempo) y ocasionalmente los SLVT (Sistemas Lineales Variantes en el Tiempo). Problemas fundamentales Una motivación fundamental para plantear modelos, es resolver algún problema, o simplemente dar una explicación adecuada a una situación real o ficticia. El problema fundamental que plantea un sistema es la descripción concisa de su comportamiento entrada - salida y su comportamiento interno. De aquí se desprenden diversos problemas que dependen de lo que deseamos hacer con el sistema: El problema de análisis consiste en determinar el comportamiento interno y entrada - salida de un sistema El problema de realización o diseño consiste en construir un sistema que reproduzca el comportamiento de otro sistema dado. -6-

- 7. El problema de control consiste en elegir adecuadamente la entrada para obtener una salida deseada El problema de observación (estimación de estados) consiste en la determinación del estado interno del sistema a partir de la medición de entradas y salidas. El problema de identificación (estimación de parámetros) consiste en determinar los valores de los parámetros del sistema a partir de mediciones de entrada y salida SEÑALES Y SISTEMAS Mientras que las señales son funciones de una o más variables independientes y contienen información acerca de la naturaleza o comportamiento de algún fenómeno, los sistemas reciben señales como entrada y responden a ellas produciendo otras señales a la salida. Esta relación entre señales y sistemas puede ser representada de manera general en un bloque como en la figura 3 Señales Señales SISTEMA de salida ... de entrada ... Figura 3. Diagrama de bloques de un sistema en general Estos conceptos son muy generales y abarcan situaciones de muy diversa índole; por ejemplo: Los voltajes y corrientes como funciones del tiempo aplicados a un circuito son ejemplos de señales y el circuito en sí es ejemplo de un -7-

- 8. sistema, el cual responderá a su vez con voltajes y corrientes dependiendo de los que le son aplicados. Cuando el conductor de un automóvil presiona el acelerador, el automóvil responde incrementando su velocidad, en este caso, el automóvil es el sistema, la presión sobre el acelerador es una señal de entrada y la velocidad del automóvil es una señal de salida. Un programa de computadora para el diagnóstico de electrocardiogramas puede ser considerado como un sistema que recibe como entrada la señal digitalizada de un electrocardiograma y produce como salida estimaciones sobre parámetros tales como ritmo cardiaco, etc. Tiempo continuo y tiempo discreto En una señal continua o señal de tiempo continuo x(t), la variable independiente (tiempo) es una variable continua y por ello estas señales están definidas para cualquier par de instantes de tiempo y para cualquier instante comprendido entre este par. Para este tipo de señales usaremos t para denotar a la variable independiente de tiempo continuo. Por otro lado, una señal discreta o señal de tiempo discreto xk solamente está definida en ciertos instantes discretos de tiempo, de manera que entre cada instante y el siguiente no está definida dicha señal. Una señal de tiempo discreto también se puede por lo tanto representar como una lista o secuencia de valores {x1, x2, x3,...}. En este tipo de señales usaremos k para denotar la variable independiente. Son ejemplos típicos de una señal de tiempo discreto: el valor de una variable en un programa de computadora, el índice Dow-Jones semanal del mercado de valores, el censo de población anual, el índice de desempleo, o bien (ver figura 4), la relación especie-abundancia de una comunidad ecológica. -8-

- 9. Especies 80 60 40 20 0 0 5 10 15 20 25 30 35 Número de individuos por especie Figura 4 Señal que representa la relación especie-abundancia de una comunidad ecológica (Adaptada de E.C. Pielou, An introduction to Mathematical Ecology, N. Y. 1969) Sistemas O Otra manera de ver un sistema es como cualquier proceso que produce una transformación de señales. Todo sistema debe tener al menos una entrada x y una salida y, la señal de salida está relacionada con la entrada mediante una relación de transformación y = f(x). De manera similar a como lo hicimos con las señales, los sistemas pueden ser sistemas de tiempo continuo si transforman señales de entrada de tiempo continuo, en señales de salida de tiempo continuo y serán llamados sistemas de tiempo discreto si transforman señales de entrada de tiempo discreto en señales de salida de tiempo discreto. Interconexión de sistemas. Los diagramas de bloques (ver figura 5) nos permiten representar las operaciones básicas entre sistemas, esto es, su interconexión, la cual puede ser -9-

- 10. de tres tipos: interconexión en serie o cascada, en paralelo y de retroalimentación. x y1 y2 = f2(y1) A) f1(x) f2(y1) =f2(f1(x)) y1 f1(x) x + B) y1+y2 y2 + f2(x) x + z y C) f1(z) y=f1(z) - f2(y) Figura 5 Interconexión de sistemas. A) Cascada. B) paralelo. C) Retroalimentación Propiedades de los sistemas. A continuación se describen algunas de las propiedades más importantes de los sistemas. Estas propiedades tienen interpretaciones tanto físicas como matemáticas y son propiedades muy generales, es decir no atienden a la naturaleza física del sistema en sí, el cual puede ser eléctrico, químico, mecánico, etc. sino más bien al tipo de transformación que realiza el sistema sobre las señales de entrada: Sistemas con y sin memoria Un sistema se dice sin memoria si su salida en un instante dado depende de su entrada solamente en ese instante, (un sistema de este tipo en ocasiones es llamado sistema estático). Por ejemplo, un circuito que contiene una resistencia R alimentada con una fuente de voltaje x(t) responderá con una corriente y(t) de acuerdo a la ley de Ohm, y(t) = x(t) / R. Un sistema cuya salida puede depender de entradas en instantes anteriores al actual se denomina sistema con memoria. Este tipo de sistemas también - 10 -

- 11. suele llamarse sistema dinámico. El ejemplo más sencillo de un sistema con memoria es el sistema retardo unitario que produce la salida y(k) como una copia de la entrada x(k) en el instante anterior al actual, es decir y(k) = x(k-1), este sistema suele representarse por el operador retardo q-1 de la siguiente manera y(k) = q-1 x(k) = x(k-1) Un segundo ejemplo es el algoritmo computacional que se encarga de acumular en una sumatoria todos los valores de la entrada x(k) desde que empezó a contar el tiempo hasta el instante actual k y(k) = S x(k − j) j =0 Es fácil ver que este algoritmo puede ser visto como la implementación de la ecuación de diferencias y(k) = y(k-1) + x(k), con la condición inicial y(0) = 0. Un ejemplo de un sistema analógico con memoria es un simple capacitor C alimentado por una fuente de corriente x(t), el cual producirá un voltaje en sus terminales y(t) dado por t y(t) = ° x(t)dt 1 C 0 el cual nuevamente puede verse como la implementación de la ecuación diferencial dy(t) /dt = x(t) /C con la condición inicial y(0) =0. Causalidad. Un sistema es causal si su salida en cualquier instante depende sólo de los valores de la entrada en el instante actual o en instantes anteriores. A este tipo de sistemas también se le llama no anticipativo, ya que la salida del sistema no anticipa valores futuros de la entrada. - 11 -

- 12. Una consecuencia fundamental de que un sistema sea causal es el hecho de que si se prueban dos entradas a un sistema causal idénticas desde las condiciones iniciales hasta un instante to las salidas correspondientes también serán iguales hasta ese mismo instante. Un automóvil es un sistema causal, ya que no puede anticipar acciones futuras del conductor, de hecho todos los sistemas físicos que evolucionan con el tiempo son causales, ya que no pueden anticipar acciones de la entrada antes de que esta ocurra. Sin embargo, cuando los valores de la evolución de un sistema se tienen almacenados, como suele ocurrir en señales de voz, señales meteorológicas, indicadores económicos, etc. de ninguna manera se está obligado a procesar estos datos en forma causal (es decir, en el orden estricto en que fueron ocurriendo) ya que se tiene la información de todos los instantes de interés en un intervalo dado. Otro tipo de sistemas que normalmente no son causales son los sistemas en que la variable independiente no es el tiempo, tales como las imágenes, así, el procesamiento de ellas no tiene porque ser causal. Estabilidad. Intuitivamente, un sistema estable es aquel en que entradas pequeñas producen salidas que no divergen, es decir, salidas acotadas. Una de las mejores maneras de ilustrar la diferencia entre sistemas estables e inestables es considerando la figura 6. En dicha figura se muestra una pelota descansando sobre dos tipos diferentes de terreno. Si se considera que la entrada es un pequeño empujón (fuerza impulsiva) horizontal y la salida es la posición vertical de la pelota se puede intuir fácilmente que la figura 6(a) representa un sistema inestable, mientras que 6(b) es estable. - 12 -

- 13. Impulso Impulso (a) (b) Figura 6 a) Sistema inestable. b) sistema estable Estabilidad entrada acotada - salida acotada o estabilidad en el sentido BIBO (Bounded Input - Bounded Output) define un sistema estable como aquel sistema cuya salida esta acotada siempre y cuando su entrada esté acotada. La manera de definir el acotamiento de una señal depende del tipo de análisis que se quiera realizar, de esta manera, se puede usar el concepto de norma para introducir diferentes tipos de cotas. Invariancia en el tiempo. Un sistema se dice invariante en el tiempo si un retardo en la señal de entrada produce una señal de salida retardada en la misma cantidad de tiempo, es decir, si y(k) es la salida correspondiente a la entrada x(k) en un sistema invariante en el tiempo, la entrada x(k-d) producirá la salida y(k-d). Así, por ejemplo, el sistema dado por la ecuación y(k) = sen[x(k)] es invariante en el tiempo, mientras que el sistema y(k) = kx(k) es variante en el tiempo para verificarlo calcule la salida para x1(k) = x(k-xo) y compare con y(k-ko). Cuando un sistema invariante en el tiempo se describe por ecuaciones diferenciales, o de diferencias, se obtienen coeficientes constantes, en dichos coeficientes normalmente aparecen los parámetros físicos del sistema, tales como resistencias, capacitancias, masas, coeficientes caloríficos, etc. Linealidad. - 13 -

- 14. Un sistema lineal es aquel que posee la propiedad de superposición. Dicha propiedad se refiere a que si una entrada es la combinación lineal (suma ponderada) de varias señales, entonces la salida correspondiente es la combinación lineal de las salidas correspondientes a cada una de dichas entradas, cuando éstas entradas se aplican individualmente. Es decir, si y1(k) es la salida de un sistema lineal cuando la entrada es x1(k) y y2(k) es la salida correspondiente a la entrada x2(k) entonces la salida correspondiente a la combinación lineal [a x1(k) + b x2(k)] será [a y1(k) + b y2(k)], donde a y b son constantes. F Observación. El sistema definido como y(k) = ax(k) + b, donde a, b son constantes NO es un sistema lineal, sin embargo, se dice que es un sistema incrementalmente lineal o afín, ya que los incrementos de la salida responden de manera lineal a incrementos de la entrada, en efecto, es fácil ver que si Dy(k) = y(k) - y(ko) y Dx(k) = x(k) - x(ko) entonces Dy(k) = aDx(k), el cual es un sistema lineal. - 14 -

- 15. HERRAMIENTAS MATEMÁTICAS Ö A continuación se presenta un compendio de herramientas matemáticas comúnmente usadas en Sistemas Lineales. No se pretende un repaso exhaustivo, pero se trata de rescatar lo más usual. Vectores O Dos vectores nx1 x e y se dicen linealmente independientes (L.I.), si alguna combinación lineal no trivial de ellos produce el vector cero. Es decir, x e y son L.I., si ax+by=0 implica que a=b=0. La definición se extiende a cualquier cantidad de vectores. O El conjunto de todas las combinaciones lineales de un conjunto dado de vectores es un espacio vectorial denominado el span de dicho conjunto de vectores. Por ejemplo, span{x,y,z}es un subespacio tridimensional del espacio n - dimensional Rn si x, y, z son tres vectores nx1 L. I. O Un conjunto de n vectores L. I. nx1 forman una base del espacio de todos los vectores nx1. - 15 -

- 16. O La Norma Euclideana de un vector x nx1, se denota por yxy y se define como n T ÈxÈ= x x = S x2 i=1 i La siguiente es una lista de propiedades generales de normas. Para vectores x, y arbitrarios nx1 y cualquier escalar a: ÈxÈ m 0 ÈxÈ = 0 sii x=0 ÈaxÈ = x a x ÈxÈ Èx + yÈ [ ÈxÈ + ÈyÈ (desigualdad del triangulo) ´ Èx T yÈ [ ÈxÈÈyÈ (desigualdad de Schwarz) Si los elementos de x son complejos, xT se remplaza por el conjugado traspuesto, o traspuesto Hermitiano, denotado x*, o bien, xH Matrices O Para una matriz A cuadrada, de dimensión nxn, cuyos elementos son aij, la traza de la matriz A se define como el escalar n tr A = S a ii i=1 Una propiedad fundamental de la traza es que si ambos productos de las matrices A, B están definidos, entonces tr (AB) = tr (BA) - 16 -

- 17. El determinante de una matriz A nxn (denotado det A, o simplemente |A|) es una conocida función escalar de una matriz. Éste puede ser calculado mediante la Expansión de Laplace que se describe a continuación: O Si cij denota el cofactor correspondente a la posición aij de la matriz A (es decir, cij es (-1)i+j por el determinante de la submatriz (n-1)x(n-1) que resulta de eliminar el renglón i-ésimo y la columna j-ésima de la matriz A) n Entonces, para cualquier 1[i [n, det A = S a ij c ij . j=1 Esta es la expansión del determinante a lo largo del renglón i-ésimo. En forma similar se puede obtener una expansión a lo largo de una columna. La expansión anterior permite el cálculo del determinante en forma recursiva, tomando en cuenta que el determinante de un escalar es el escalar mismo. Si B es también una matriz nxn, entonces det(AB) = det (BA). O El conjugado de una matriz A nxn (denotado adj A), es la matriz cuyos elementos en la posición i,j son los cofactores cji de A, es decir, es la matriz traspuesta de cofactores de A. Una matriz A nxn tiene inversa (denotada A-1), si y sólo si det Ag0. Una fórmula para calcular A-1 se basa en el conjugado de A, como sigue adj A A -1 = det A Si B es otra matriz nxn, entonces (AB)-1 = B-1A-1. Valores y vectores propios O Para una matriz A nxn, y un vector x no nulo nx1, cualquier escalar k que cumpla con la ecuación Ax = kx se denomina valor propio de la matriz A, y al vector x se le llama vector propio correspondiente al valor propio k. - 17 -

- 18. De la definición se desprende que para un valor propio dado puede haber muchos vectores propios, de hecho, si x es un vector propio, cualquier múltiplo k x (k escalar) es también vector propio, en general, el conjunto de los vectores propios para un valor propio dado forma un espacio vectorial denominado el espacio propio correspondiente al valor propio dado. No hay que olvidar que una matriz con elementos reales puede tener valores propios complejos, sin embargo, éstos siempre se dan en pares conjugados, ademas, si k es un valor propio del vector x, entonces k (el conjugado de k) es valor propio de x (conjugado de x), es decir, A x =k x. ¯ ¯ ¯ O El polinomio característico de la matriz A se define como det (sIn - A), donde In es la matriz identidad nxn. Las n raíces del polinomio característico de la matriz A, son precisamente sus n valores propios. Teorema de Cayley - Hamilton.- Si el polinomio característico de la matriz A tiene la forma det (sIn - A) = p(s) = sn + an-1 sn-1 + ... + a1s + a0 Entonces p(A) = An + an-1 An-1 + ... + a1A + a0In = 0n Es decir, una matriz cualquiera A es raíz de su polinomio característico. La principal aplicación del Teorema de Cayley - Hamilton es el hecho de que An+k con km0 se puede expresar como una combinación lineal de y, A, ..., An-1. O Dada una matriz A nxn, una transformación de similaridad de A se define como T-1AT, donde T es una matriz invertible. O Si B se obtiene de A mediante una transformación de similaridad, es decir, si B=T-1AT, se dice que B es similar a A. - 18 -

- 19. La similaridad es una relación de equivalencia, es decir, cumple con las propiedades: reflexiva, simétrica y transitiva. Por lo tanto, dada una matriz A se pueden definir clases de equivalencia como el conjunto de todas las matrices similares a A. La matriz T-1AT tiene los mismos valores propios que A, es decir, todas las matrices de una misma clase de equivalencia tienen el mismo conjunto de valores propios. Si la matriz A tiene todos sus n valores propios distintos y T tiene como columnas los correspondientes n vectores propios (L.I. por supuesto), entonces T-1AT es una matriz diagonal y los elementos de su diagonal son precisamente los valores propios de A. @Ejemplo 0 -2 Para la matriz A = , el polinomio característico es 2 -2 S 2 p(s) = det(sI-A) = det = (s+1+j√3)(s+1-j√3) -2 S+2 Por lo tanto, los valores propios de A, son: s1 = -1 + j√3, s2 = -1 -j√3. Sustituyendo ésto en Ap=s1p para encontrar un vector propio correspondiente a s1, obtenemos una solución no trivial, con p1T = [2 1-j√3], en forma similar para s2, obtenemos también una solución no trivial p2T = [2 1+j√3]. formamos la matriz T usando estos dos vectores columnas, de manera que 2 2 T= 1-j 3 1+j 3 con lo cual - 19 -

- 20. 1 - 1 j 1 j 4 4 3 4 3 T -1 = 1 + 1 j - 1 j 4 4 3 4 3 finalmente, -1 + j 3 0 T -1 AT= 0 -1 - j 3 r Sistemas de Ecuaciones Lineales Un sistema de m ecuaciones lineales con n incógnitas puede escribirse como Ax=b donde A es una matriz conocida mxn, b es un vector conocido mx1 y x es el vector de incógnitas nx1. O El espacio rango o imagen de la matriz A es el espacio vectorial que contiene los vectores mx1 de la forma y=Ax, es decir, el espacio vectorial span(columnas de A) por ello también se le llama espacio columna de A. O El espacio nulo o Kernel de la matriz A es el espacio vectorial de los vectores nx1 x tales que Ax=0. En términos de los conceptos anteriores se pueden expresar las condiciones necesarias y suficientes para que el sistema Ax=b tenga solución: - 20 -

- 21. El sistema Ax=b tiene una solución sii b está en la imagen de A. en forma equivalente, la tendrá sii bTy=0 para todo vector y en el espacio nulo de AT. Por supuesto, si A es invertible, hay una solución única y ésta es x=A-1b. O El rango (rank) de una matriz A mxn es la dimensión de la imagen de A El rango de una matriz es igual al número de columnas L.I. = número de renglones L.I. Una relación importante que involucra los rangos de dos matrices A y B de dimensiones mxn y nxp respectivamente y de su producto es la siguiente rank A + rank B - n ≤ rank (AB) ≤ min {rank A, rank B} O La norma inducida de una matriz A mxn puede ser definida en términos del siguiente problema de minimización con restricciones yAy= max yAxy yxy=1 en donde las normas que aparecen del lado derecho de la expresión son la norma euclideana definida anteriormente para vectores y en este caso, también se le llama la norma espectral. Puede ser probado que la norma inducida de una matriz A es igual a la raíz cuadrada no negativa del máximo valor propio de ATA o de AAT (estas matrices son simétricas y por lo tanto sus valores propios son reales y no pueden ser negativos), es decir yAy=max k i (A T A) 1[i[n donde λi(A) es el valor propio i-ésimo de ATA. O Al radical que aparece en la expresión anterior se le denota por σi y se denomina el i-ésimo valor singular de la matriz A Es decir, la norma espectral de la matriz A es el máximo valor singular de dicha matriz. - 21 -

- 22. @Ejemplo Calcular la norma espectral para la matriz A siguiente 12 A= 34 De acuerdo a la definición, la norma espectral se obtiene de resolver el problema de maximización siguiente y A y= max (x 1 + 2x 2 ) 2 + (3x 1 + 4x 2 ) 2 x 2 +x 2 1 2 =1 En lugar de abordar el problema de maximización, podemos calcular los valores propios de ATA, cuyo polinomio característico es s-10 -14 det(sI-A T A)=det =s 2 -30s+4 -14 s-20 Y las raíces de este polinomio son s=15! 221 Eligiendo el signo + se tiene el valor propio máximo, por lo tanto y A y= 15 + 221 =5.465 r @Ejemplo Calcular la norma espectral de la matriz A con valores propios reales siguiente - 22 -

- 23. k1 1 A= 0 k2 De acuerdo a la definición, la norma espectral se obtiene de resolver el problema de maximización siguiente y A y= max (k 1 x 1 + x 2 ) 2 + k 2 x 2 2 2 x 2 +x 2 =1 1 2 En lugar de abordar el problema de maximización, podemos calcular los valores propios de ATA, cuyo polinomio característico es s-k 2 -k 1 1 T det(sI-A A)=det 2 =s 2 -(1+k 2 +k 2 )s+k 2 k 2 1 2 1 2 -k 1 s-k 2 -1 Y las raíces de este polinomio son (1 + k 2 + k 2 ) ! (1 + k 2 + k 2 ) 2 − 4k 2 k 2 1 2 1 2 1 2 s= 2 Se puede ver que el radical es siempre positivo, por lo tanto, el máximo valor propio se obtiene eligiendo el signo +, obteniéndose 1 y A y= 2 (k 1 + k 2 ) 2 + 1 + (k 1 − k 2 ) 2 + 1 r La norma inducida cumple todos los axiomas generales de las normas en Rmxn y algunas propiedades adicionales, por ejemplo: ÈATÈ=ÈAÈ una consecuencia inmediata es el hecho de que para cualquier vector x nx1, ÈxTÈ=ÈxÈes la raiz cuadrada del máximo valor propio de xTx o de xxT eligiendo el caso escalar se ve que el resultado coincide con la norma euclideana ÈxÈ. De aquí también se desprende que ÈAxÈ ≤ÈAÈ ÈxÈ para cualquier vector x nx1. - 23 -

- 24. En caso de matrices complejas, las traspuestas en la discusión anterior deberán cambiarse por traspuestas Hermitianas. Formas cuadráticas O Para cualquier matriz Q nxn y cualquier vector x nx1, ambos con elementos reales, la expresión xTQx es denominada una forma cuadrática. No se pierde generalidad al suponer en una forma cuadrática que Q es una matriz simétrica, ya que para cualquier matriz Q se cumple que T T Q + QT x Qx=x x 2 entonces Q puede ser reemplazada por (Q+QT)/2, la cual siempre es una matriz simétrica. O Una matriz simétrica Q se dice positiva semidefinida si xTQx ≥ 0 para todo x. Q se dice positiva definida si es positiva semidefinida y xTQx = 0 solo cuando x=0. O En forma abreviada: Q≥0 indica que Q es positiva semidefinida. Q>0 indica que Q es positiva definida Q≤0 indica que Q es negativa semidefinida, es decir, que -Q≥0 Q<0 indica que Q es negativa definida, es decir, -Q>0 Q>P indica que Q-P es positiva definida (Q-P > 0), etc... Todos los valores propios de una matriz simétrica son reales, de aquí se sigue que Q>0 es equivalente a que todos los valores propios de Q sean positivos. y el que Q≥0 es equivalente a que todos los valores propios de Q sean no negativos. - 24 -

- 25. Una desigualdad importante para una matriz simétrica Q es la desigualdad de Rayleigh - Ritz, la cual establece que para cualquier vector real x nx1 λmin xTx ≤ xTQx ≤λmax xTx donde λmin y λmax son los valores propios mínimo y máximo de Q, respectivamente. La norma espectral de una matriz Q positiva semidefinida, está dada por ÈQÈ=λmax y su traza está acotada por ÈQÈ ≤ tr Q ≤ nÈQÈ La Prueba de Sylvester nos permite averiguar si una matriz es o no definida positiva. Sea Q una matriz real y simétrica nxn con elementos qij. Para enteros p=1,...,n y 1≤ i1<i2<i3<...<ip≤ n, los escalares q i1i1 qi1i2 ... qi1ip q i2i1 qi2i1 ... qi2ip Q(i1,i2,...,ip) = det ... ... ... ... q ipi1 q ipi2 ... q ipip son llamados menores principales de Q. Además, los escalares Q(1,2,...,p), p=1,2,...,n, los cuales son simplemente los determinantes de las submatrices pxp superiores izquierdas de Q: q 11 q 12 q 13 q 11 q 12 Q(1)=q11, Q(1,2) = det , Q(1,2,3)= q 21 q 22 q 23 ,... q 21 q 22 q 31 q 32 q 33 son llamados los “primeros” menores principales La prueba de Sylvester establece lo siguiente: La matriz simétrica Q es positiva definida, si y sólo si Q(1,2,...,p) >0 para p=0,1,...,n - 25 -

- 26. y es negativa definida si y sólo si (-1)p Q(1,2,...,p) >0 para p=0,1,...,n Por otro lado, Q es semidefinida positiva si y sólo si Q(i1,i2,...,ip) ≥0 para 1≤ i1<i2<i3<...<ip≤ n y p=0,1,...,n y es negativa semidefinida definida si y sólo si (-1)p Q(i1,i2,...,ip) ≥0 para 1≤ i1<i2<i3<...<ip≤ n y p=0,1,...,n *En el caso de que Q tenga elementos complejos, pero sea Hermitiana, es decir Q=QH, entonces la forma cuadrática es xHQx. con esta variante se siguen aplicando las definiciones anteriores. 12 Ejemplo averiguar si la matriz A= es o no positiva definida 25 Usando el Criterio de Sylvester, tenemos que A(1)= 1>0, A(1,2)= 1>0 por lo tanto, A es positiva definida. q Más sobre normas O Para un vector x nx1 se puede definir la familia de Normas p, definidas para números reales p≥1 como sigue n 1/p y x yp = S |x| p i=1 La norma Euclideana viene siendo el caso particular en que p=2. O También se define la norma uniforme de un vector x nx1, denotada por yxy∞, como sigue - 26 -

- 27. y x y º =max |x i | 1[i[n O Las normas anteriores están definidas en espacios vectoriales de dimensión finita, sin embargo en otro tipo de espacios, por ejemplo, para el espacio de las funciones de valor real en el intervalo [0,T], la norma uniforme de una función f(t) toma la forma y f(t) y º =max |f(t)| 0[t[T O Así, una generalización de la norma p para una función real f(t) se define como T 1/p y f(t) y p = ° |f(t)| p 0 Normas inducidas O Para cuaquier función lineal f de un espacio vectorial V en un espacio vectorial W, es decir, f:VàW, y normas y.yV, y.yW definidas en V y W respectivamente, la norma inducida de f toma la forma y f y= max y f(x) y W yxy V =1 Como puede verse, en el caso en que una matriz A mxn es vista como función lineal de Rn en Rm, es decir, la función f(x)=Ax con x en Rn, entonces la norma inducida por la norma Euclideana en estos espacios coincide con la norma inducida o norma espectral definida anteriormente. En forma similar, la norma inducida por la norma uniforme para una matriz A es el máximo de la suma de los valores absolutos de los renglones de A n y A y º =max S |a ij | 1[i[n j=1 - 27 -

- 28. Mientras que la norma inducida por la norma 1 para una matriz A es el máximo de la suma de las columnas de A: n y A y 1 =max S |a ij | 1[j[n j=1 Producto interno y ortogonalidad El concepto de ángulo entre dos vectores x1, x2 en un espacio Euclideano es comúnmente expresado en términos del producto punto: x1Ÿx2=x1Tx2, ya que en R2 y R3 el ángulo θ entre estos dos vectores satisface xTx2 1 cos(h) = y x 1 yy x 2 y Donde las normas que aparecen en el denominador son euclideanas. Lo anterior motiva una generalización del producto punto para expresar el “ángulo” entre dos vectores en Rn como < x1, x2 > cos(h) = y x 1 yy x 2 y O donde el escalar <x1,x2> = x1Tx2 es el producto interno de x1, x2 en Rn Además, de acuerdo a la desigualdad de Schwarz |<x1,x2>| ≤ yx1y yx2y, con lo cual 0 ≤ cosθ ≤ 1y por lo tanto, cosθ está bien definido. Así con está noción generalizada de ángulo, podemos generalizar la noción de ortogonalidad como sigue: O Dos vectores x, y se dicen ortogonales si su producto interno es cero, es decir, si <x,y>=0 O En forma similar se puede definir también el producto interno para dos funciones reales f(t), g(t) en un intervalo [0,T] como sigue - 28 -

- 29. T < f(t), g(t) > =° f(t)g(t)dt 0 Obsérvese además que la norma euclideana es compatible con el producto interno, es decir, yxy2= <x,x> Producto interno y ecuaciones lineales Sea la matriz A m×n, con m>n que define el sistema de m ecuaciones con n incógnitas x = Ay, si premultiplicamos el sistema por AT, obtenemos el sistema ATAx =ATy, denominado ecuaciones normales. De este nuevo sistema podemos encontrar una solución para x si y sólo si la matriz ATA denominada matriz de Gram asociada con A, tiene inversa, lo cual ocurre si y sólo si A tiene sus n columnas L.I., es decir, si tiene rango n. La matriz de Gram ATA tiene como elemento ij-ésimo el producto interno del renglón i-ésimo y la columna j-ésima de A. Si el determinante de esta matriz es diferente de cero, la solución única de las ecuaciones normales es: x = (ATA)-1ATy donde el vector ATy tiene como elementos, los productos internos de cada renglón de A con el vector y. FEs clásico el hecho de que las ecuaciones normales conllevan un mal condicionamiento numérico. Un método que permite resolver las ecuaciones normales de una manera más exacta numéricamente consiste en factorizar A usando una factorización QR (Triangular - ortogonal), es decir, descomponer A=WU, donde W es una matriz unitaria (WTW=I) y U es una matriz triangular superior. Con esto premultiplicamos ambos lados del sistema original, produciendo el sistema Ux=WTy que puede ser resuelto fácilmente por ser triangular. - 29 -

- 30. Condicionamiento numérico de ecuaciones lineales Consideremos el sistema de ecuaciones Ax=y, donde A es n×n, suponiendo que y sufre un incremento ∆y, el efecto en x estará dado por (x+∆x)=A(y+∆y), en donde ∆x = A-1∆y. Usando normas, podemos expresar el cambio relativo en x en términos del cambio relativo en y de acuerdo a y Dx y y Dy y [ k(A) yxy yyy O En donde k(A) se conoce como el número de condición de la matriz A y está definido como k(A) = yAyyA-1y y como yAyyA-1y ≥ yAA-1y = 1, cuando k(A) ≈ 1 la matriz A está bien condicionada, ya que k(A) actúa como un factor de escala de el errores relativos en A a los errores relativos en x. Como puede verse, el número de condición se puede calcular también en términos de los valores singulares (σ) de la matriz A, como sigue k(A) = σmax(A)/σmin(A) Soluciones aproximadas y la Pseudoinversa Si las m ecuaciones originales Ax=y con n incógnitas son consistentes (tienen solución única), la solución de las ecuaciones de Gram correspondientes coincide con la solución del sistema original Sin embargo, cuando las ecuaciones no son consistentes, el problema de hallar x tal que Ax=y se puede remplazar por el problema más general de hallar x tal que la norma del error e = A x - y sea mínima. este problema ^ ^ siempre tiene una solución única y está dada por x = A@ y - 30 -

- 31. O Donde A@ es llamada la matriz pseudo inversa de A, ya que esta coincide con A-1 cuando A es cuadrad y no singular. Si A tiene columnas L. I. entonces la matriz de Gram (ATA) tiene inversa y entonces A@ = (ATA)-1AT. Si AT tiene columnas L.I., entonces (AAT) tiene inversa y A@ = AT(AAT)-1. En el caso en queni A, ni AT tengan columnas L. I. A@ no tiene una expresión sencilla, sin embargo siempre se cumplen las siguientes propiedades de A@: A A@A = A A@AA@=A@ (AA@) y (A@A) son simétricas Ayuda de MATLAB sobre NORMAS help norm NORM Matrix or vector norm. For matrices.. NORM(X) is the largest singular value of X, max(svd(X)). NORM(X,2) is the same as NORM(X). NORM(X,1) is the 1-norm of X, the largest column sum, = max(sum(abs((X)))). NORM(X,inf) is the infinity norm of X, the largest row sum, = max(sum(abs((X')))). NORM(X,'inf') is same as NORM(X,inf). NORM(X,'fro') is the F-norm, sqrt(sum(diag(X'*X))). NORM(X,P) is available for matrix X only if P is 1, 2, inf or 'fro'. For vectors.. NORM(V,P) = sum(abs(V)^P)^(1/P). NORM(V) = norm(V,2). NORM(V,inf) = max(abs(V)). NORM(V,-inf) = min(abs(V)). - 31 -

- 32. In MATLAB 4.0, if X has complex components, z, then abs(z) = sqrt(z*conj(z)), not abs(real(z)) + abs(imag(z)), which was used in some earlier versions of MATLAB. See also COND, RCOND, CONDEST, NORMEST. Ejemplo: a = 1 2 3 4 » norm(a) ans = 5.4650 - 32 -