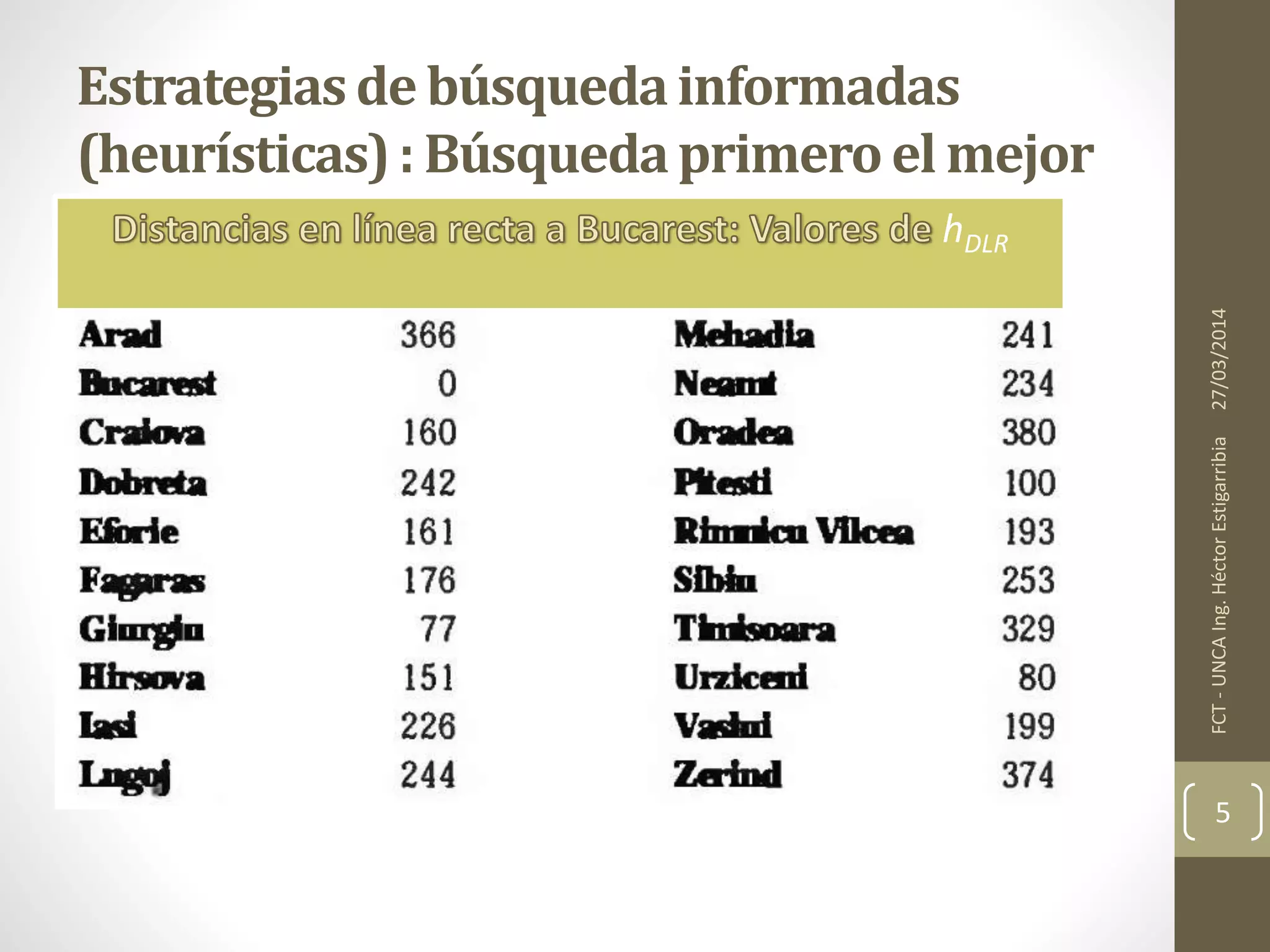

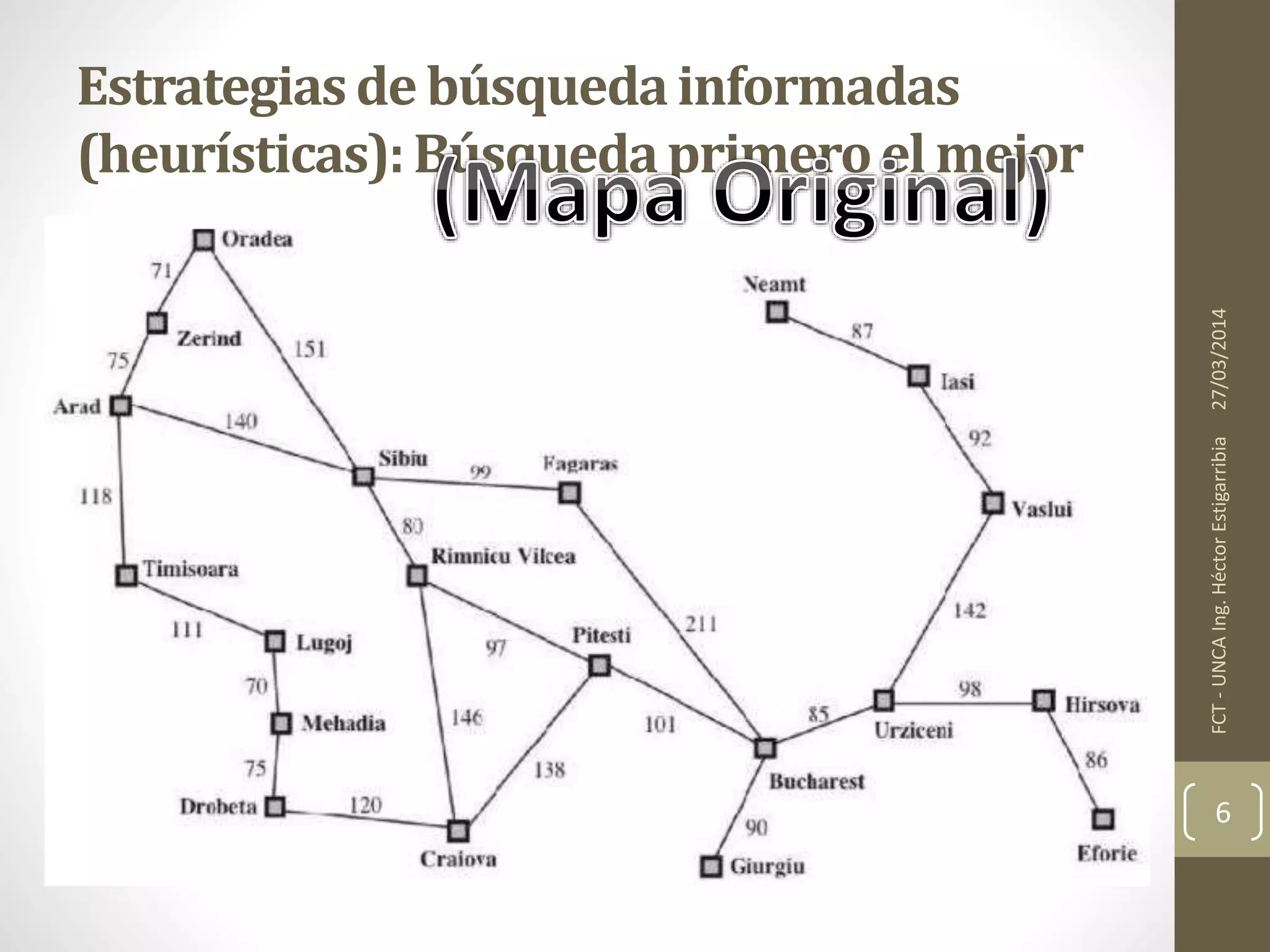

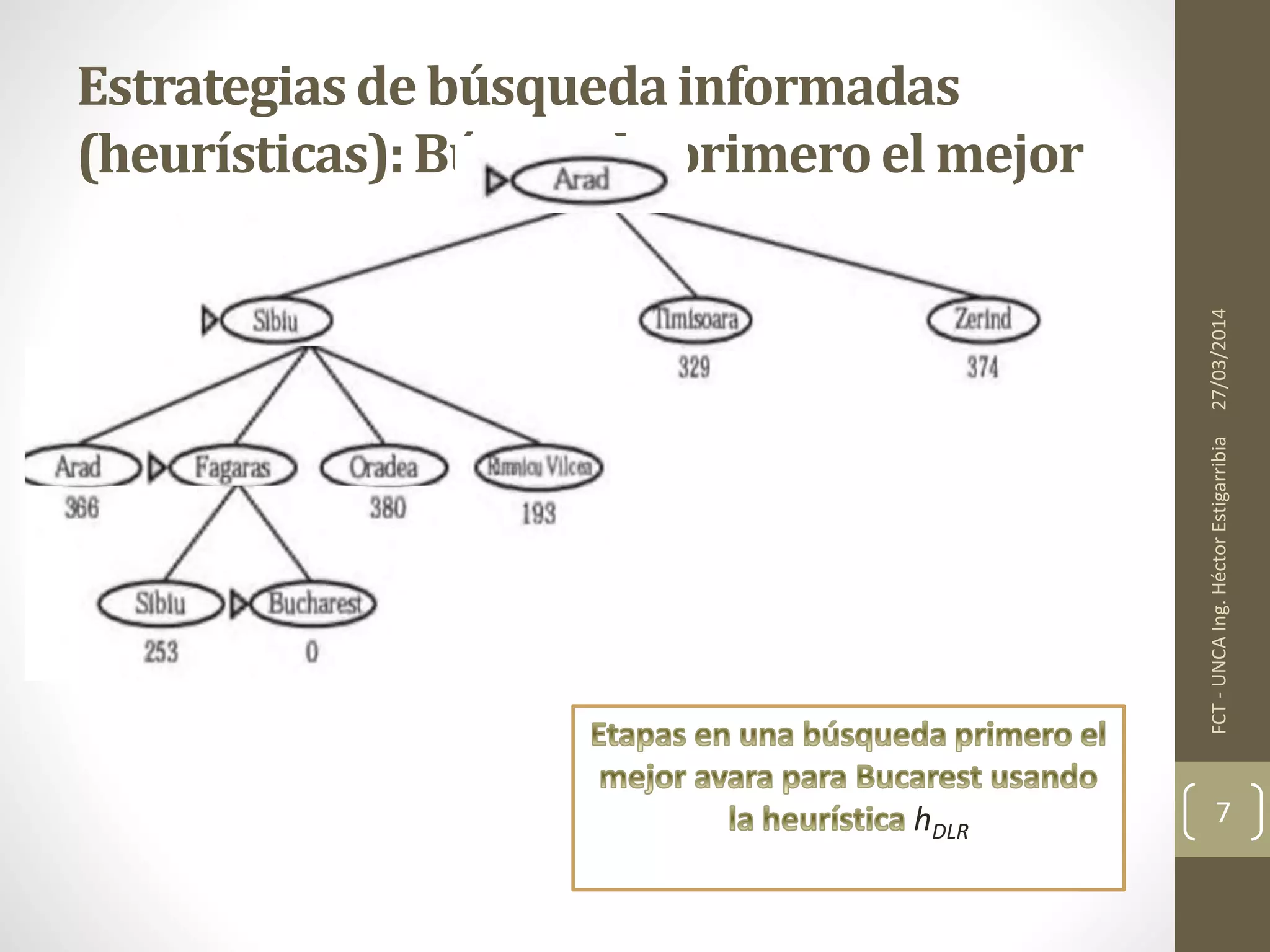

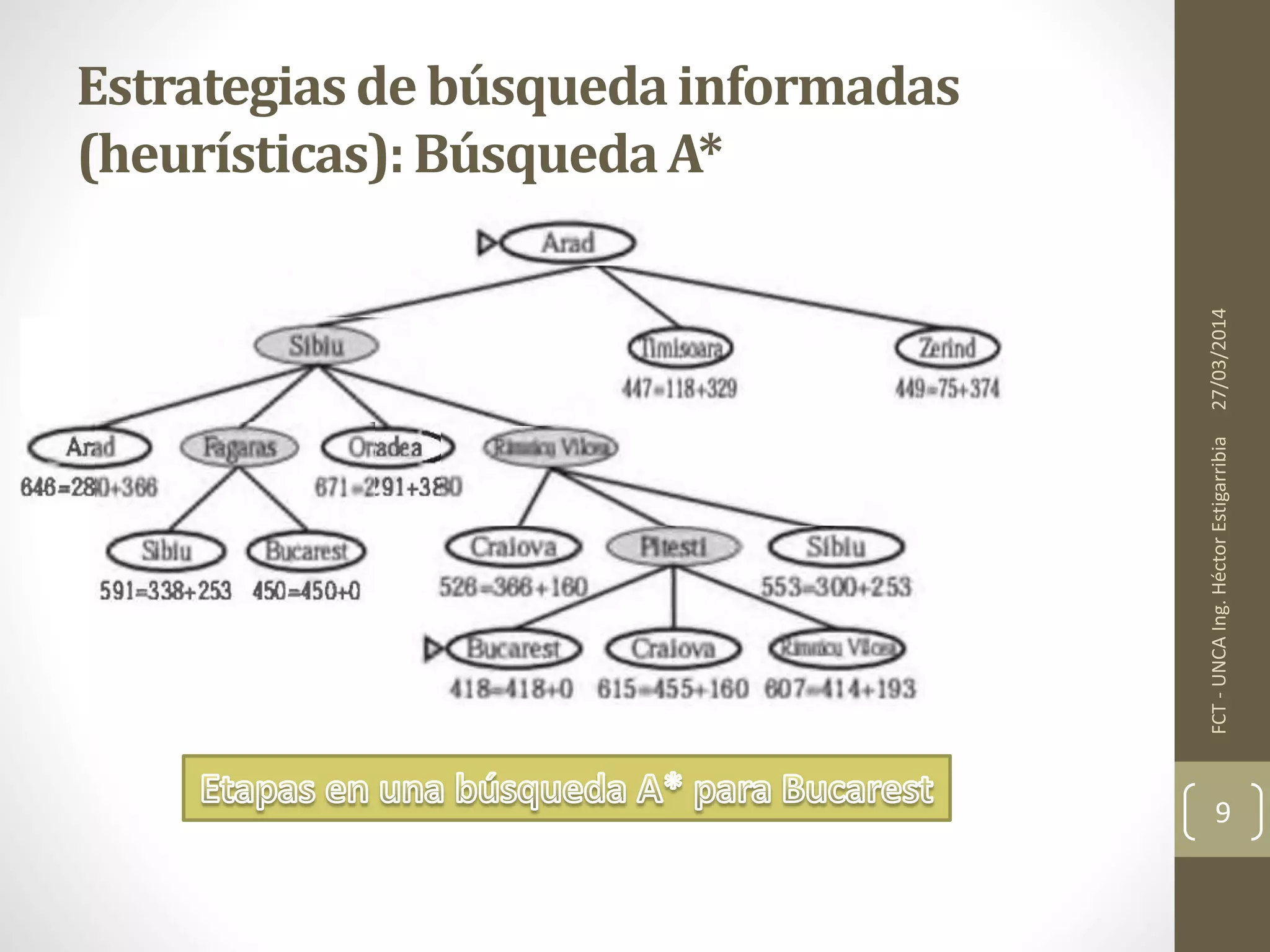

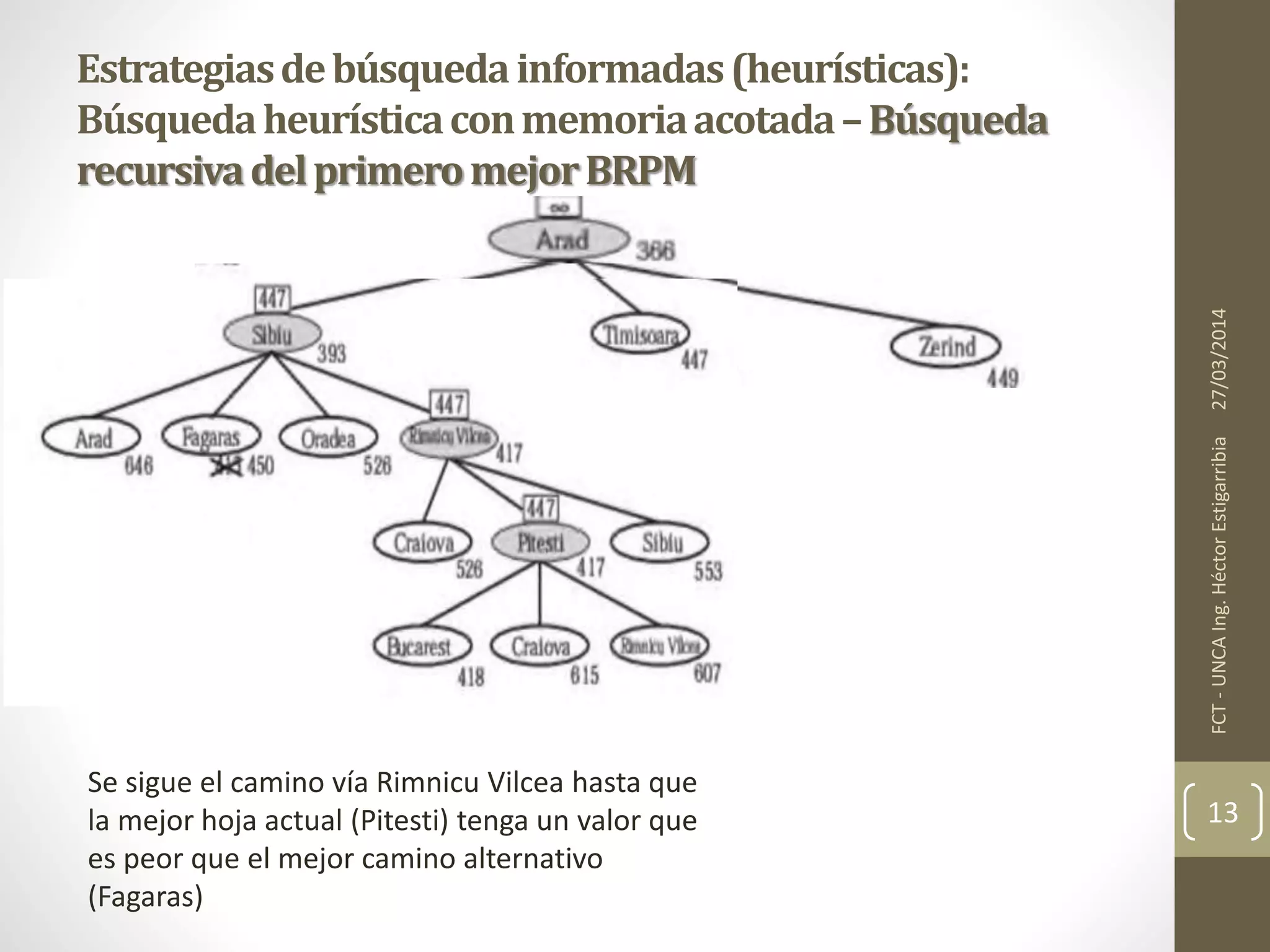

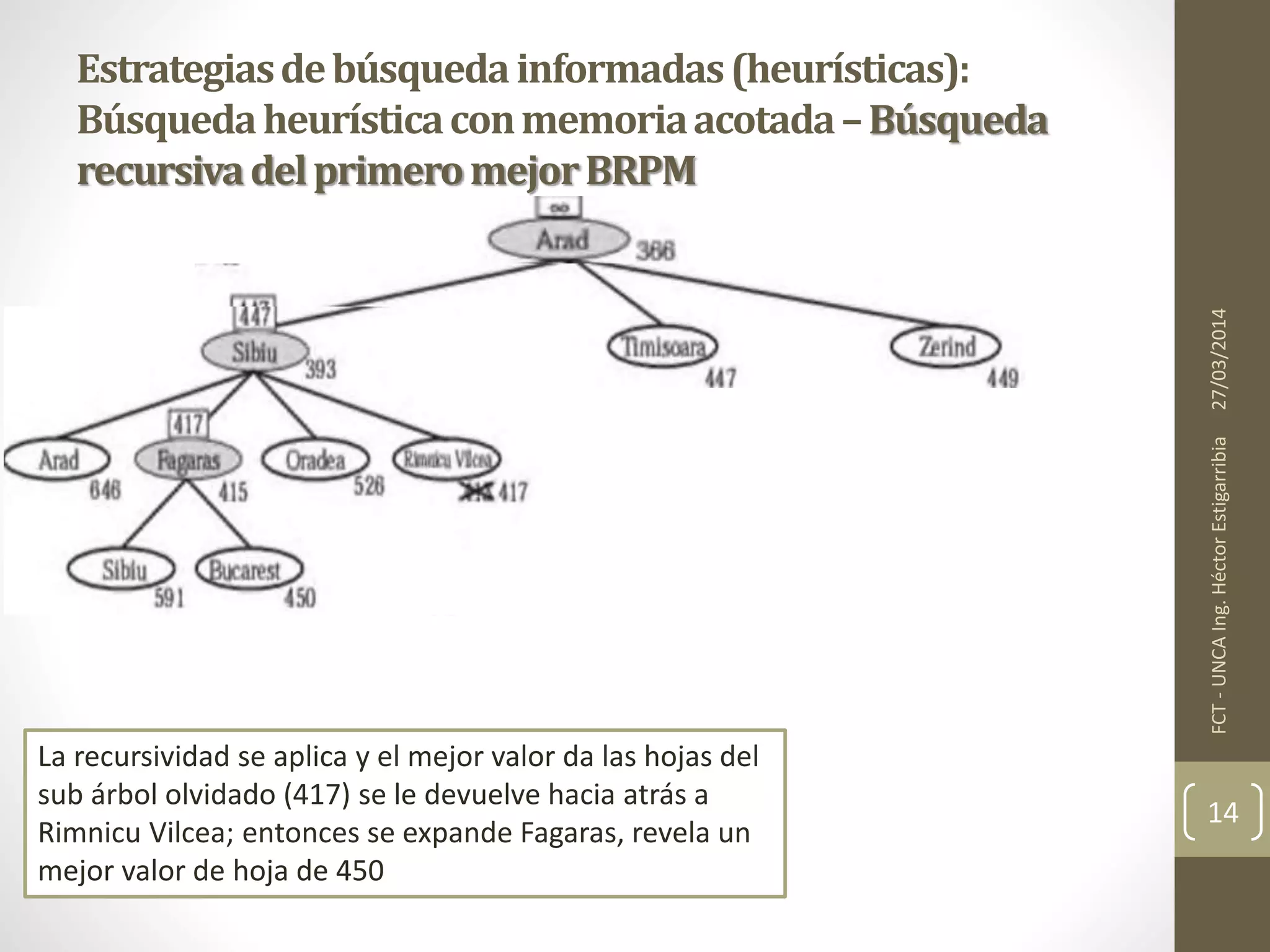

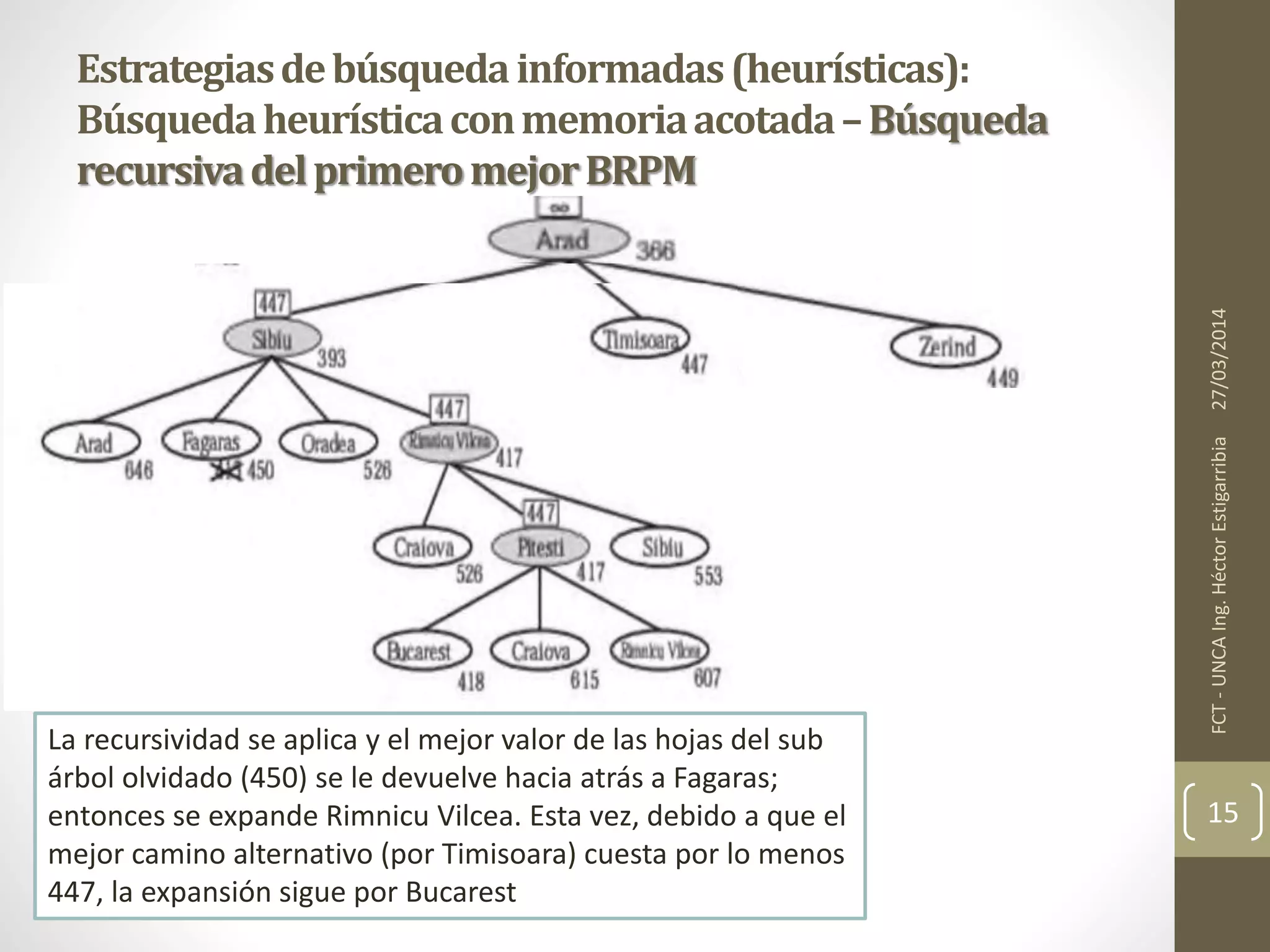

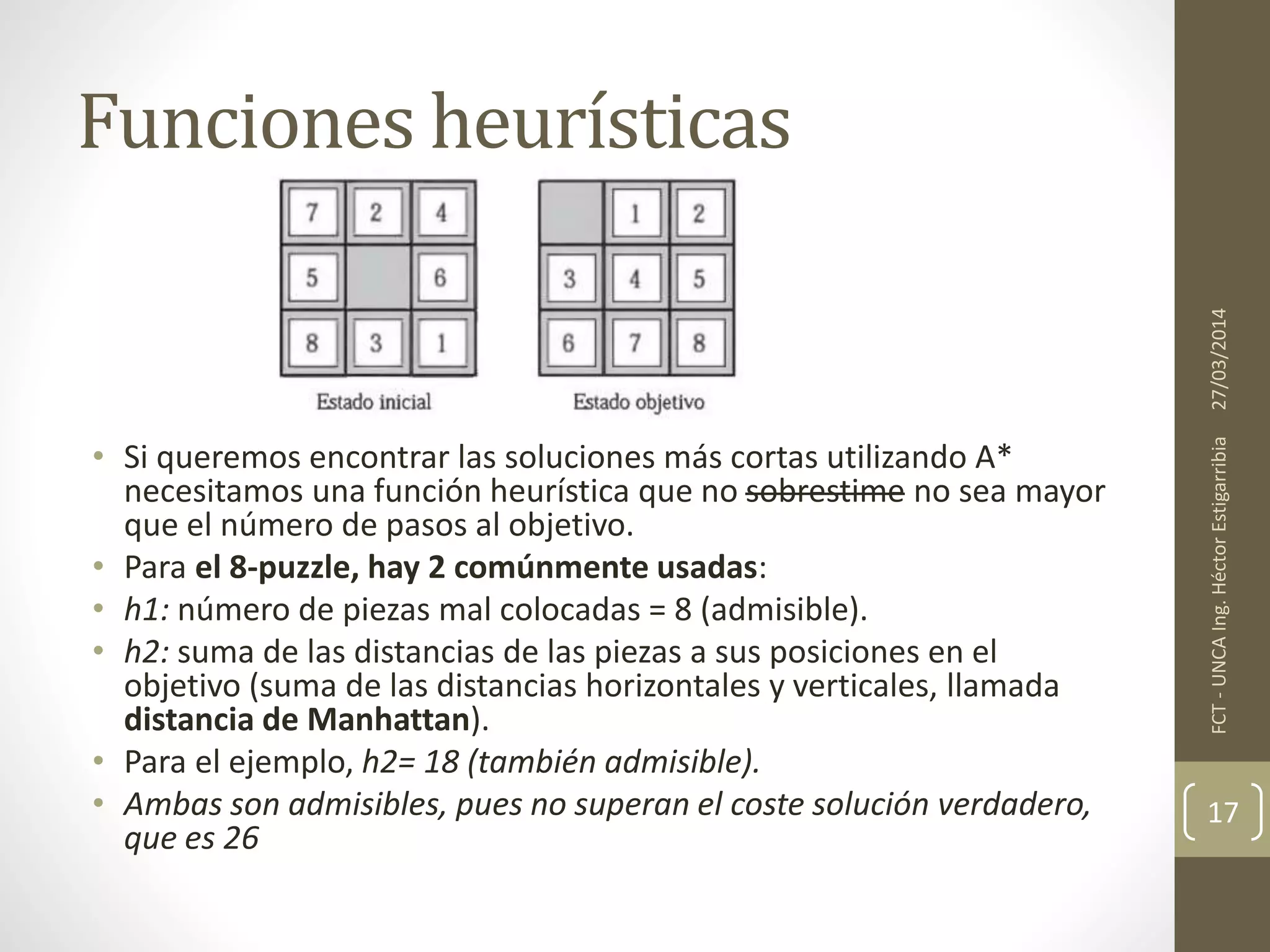

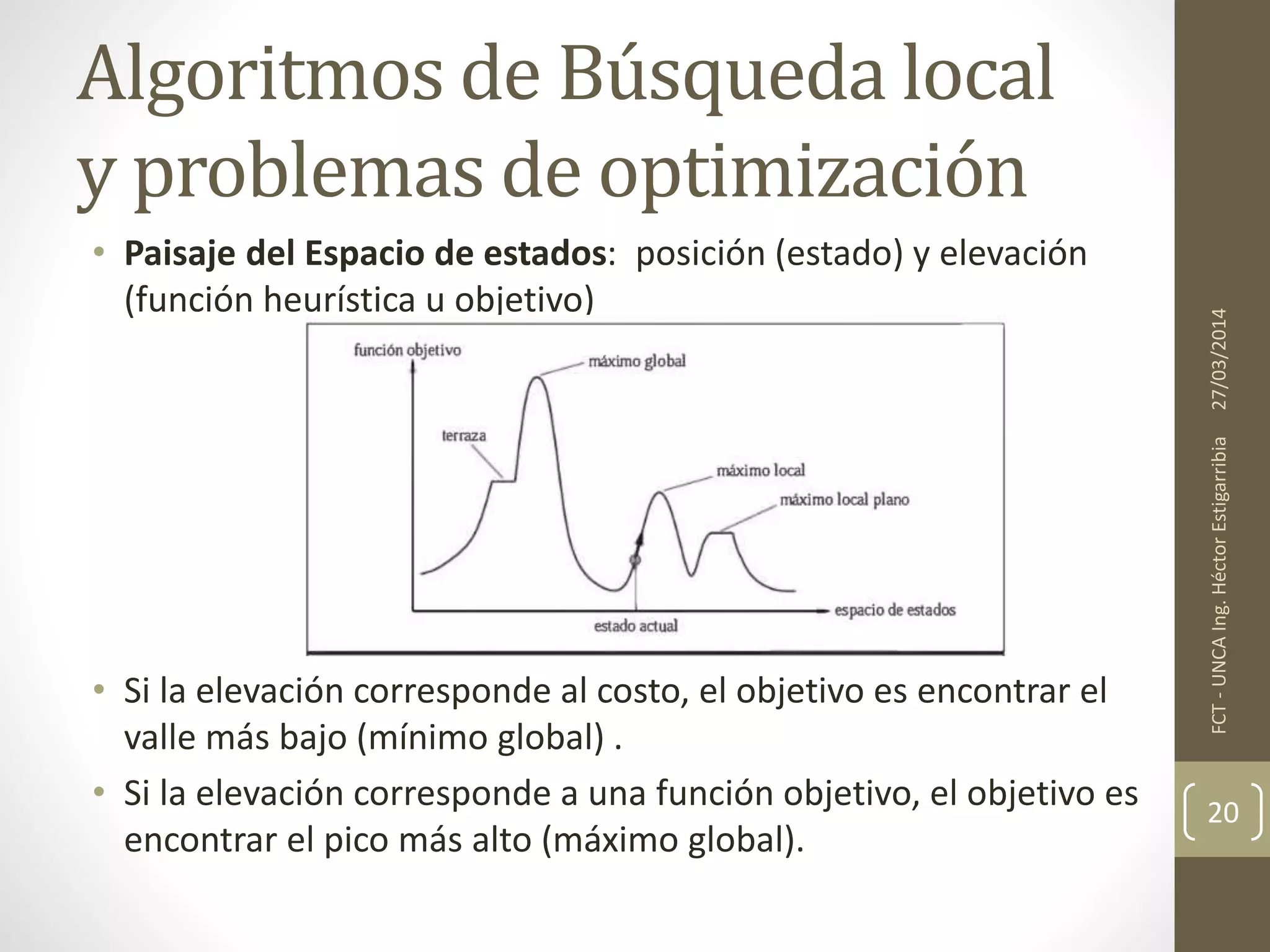

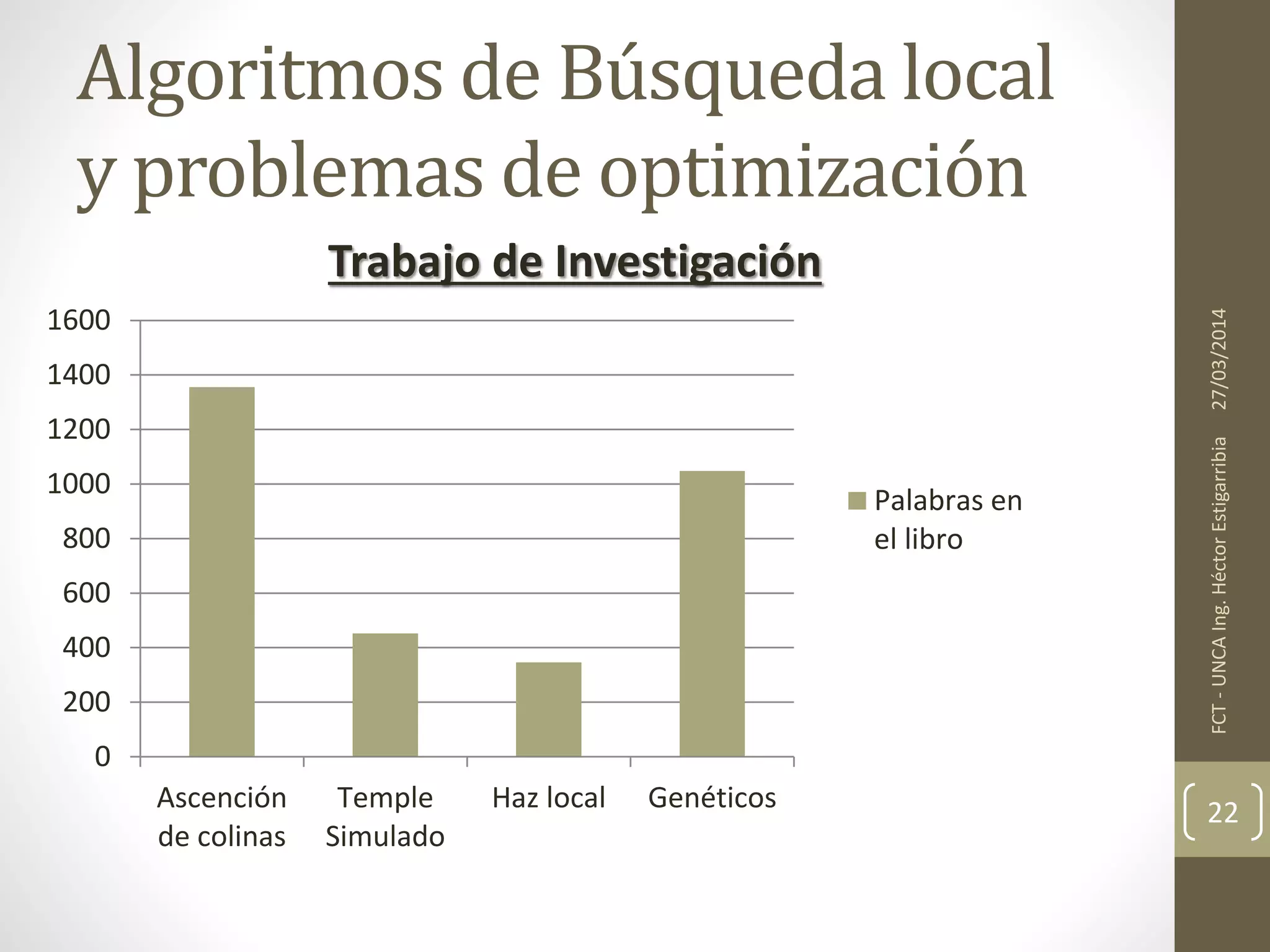

Este documento resume diferentes estrategias de búsqueda informada como la búsqueda primero el mejor, búsqueda A*, búsqueda heurística con memoria acotada, y algoritmos de búsqueda local para problemas de optimización. También discute el uso de funciones heurísticas para guiar la búsqueda de manera más eficiente.