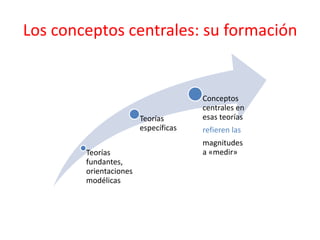

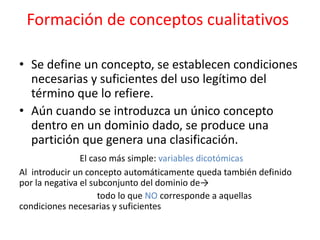

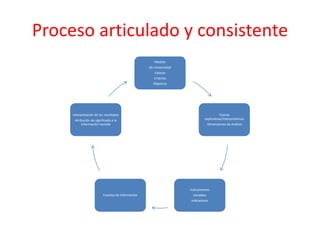

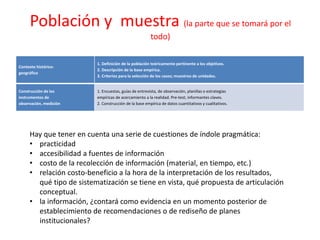

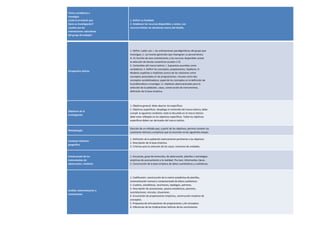

Este documento presenta los conceptos y métodos fundamentales de la medición en evaluación educativa. Explica que la definición precisa de conceptos a través de condiciones necesarias y suficientes permite clasificar y medir magnitudes empíricamente. Luego describe los métodos cualitativos como taxonomías y cuantitativos mediante métricas. Finalmente, enfatiza que un diseño de evaluación debe articular coherentemente los valores, teorías, objetivos, indicadores y fuentes de información.