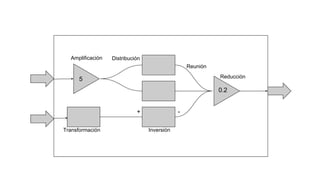

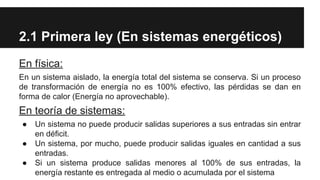

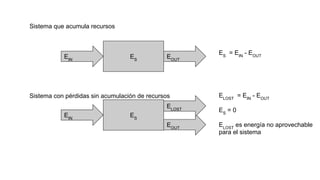

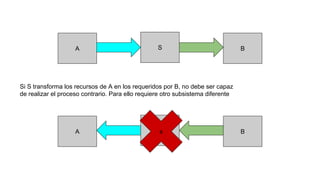

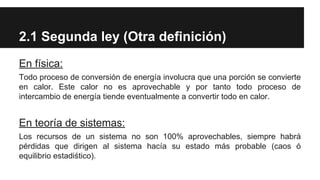

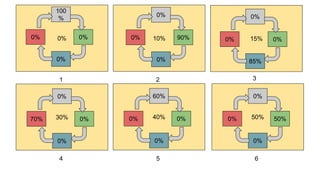

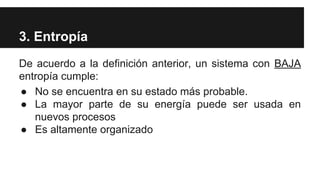

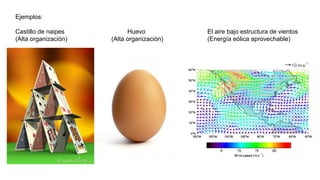

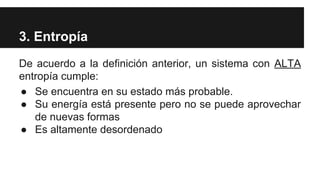

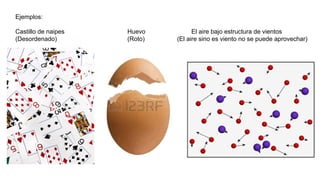

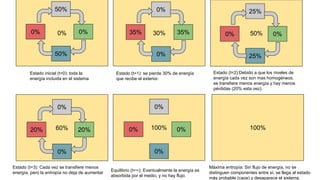

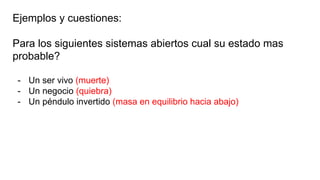

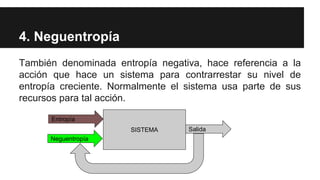

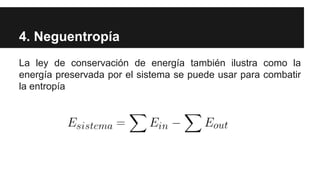

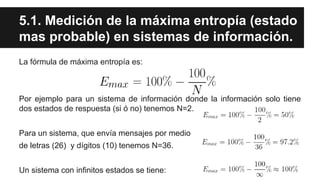

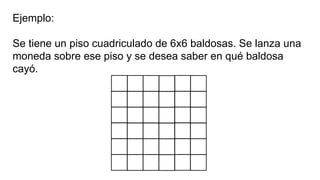

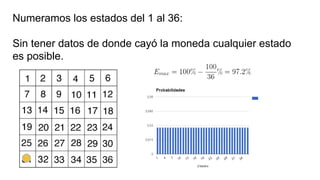

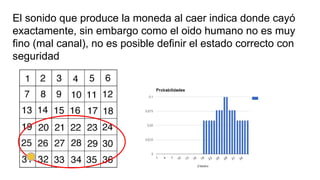

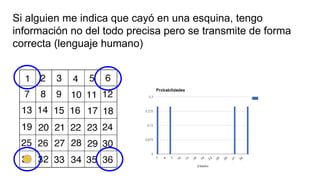

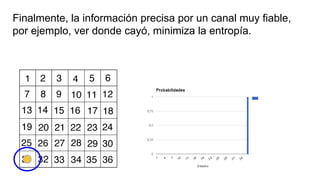

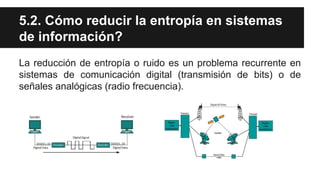

El documento explora la teoría de sistemas a través de los conceptos de entropía y neguentropía, analizando cómo el flujo de recursos permite la transformación y distribución dentro de un sistema. Describe las leyes de la termodinámica en el contexto de sistemas, enfatizando que todos los sistemas tienden a aumentar su entropía, alcanzando eventualmente un estado de caos. También se discute la importancia de la neguentropía en la preservación de la organización en sistemas abiertos y la relación entre entropía y la comunicación en sistemas de información.