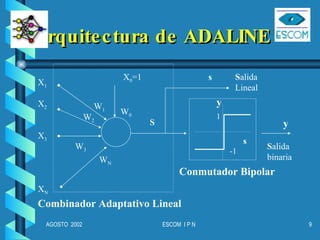

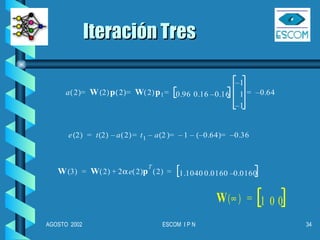

Las redes ADALINE y MADALINE fueron desarrolladas en 1960 por Bernie Widrow y Marcian Hoff en la Universidad de Stanford para realizar clasificación lineal. ADALINE consiste en una única neurona de salida, mientras que MADALINE tiene varias neuronas de salida. Ambas redes aprenden mediante el algoritmo LMS (regla del mínimo error cuadrático medio), el cual minimiza el error cuadrático medio para ajustar los pesos y mejorar la clasificación.

![Bernard Widrow Professor Adaptive Systems. Widrow concentrates on adaptive signal processing, adaptive control systems, and adaptive neural networks. Adaptive systems have the ability to learn and improve their behavior through contact with their environments. Applications include signal processing, control systems, and pattern recognition. Sc.D. MIT 1956 Department of Electrical Engineering Durand Bldg., Rm. 139 723-4949 [email_address]](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-3-320.jpg)

![[W,b]=initlin(P,T) crea un conjunto de pesos y umbrales aleatorios iniciales positivos y negativos para una red Adaline. Toma una matriz de de vectores de entrada P, y de salida TS , regresando los valores de W y b correspondientes a las dimensiones de la red.](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-38-320.jpg)

![[W,b]=solvelin(P,T); W=solvelin(P,T); Diseña redes Adaline directamente si se conocen sus vectores de entrada y objetivo, calculando los valores de los pesos y el bias sin necesidad de entrenamiento.](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-39-320.jpg)

![[W,b,ep,tr]= trainwh(W,b,P,T,tp) tp=[disp_freq max-epoch err-goal lr] Entrena una red Adaline, hasta alcanzar el minimo error eepecificado en sus parametros iniciales.](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-40-320.jpg)

![Entrenamiento Paso a Paso A = simulin (P,W,b) E = T - A [dW,db] = learnwh (P,E,lr) W = W + dW b = b + dW](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-42-320.jpg)

![E = T - A; [ dW, db ] = learnwh( P, E, lr ) lr es la tasa de aprendizaje. Si es grande, el aprendizaje es rápido, pero si es demasiado grande, el aprendizaje es inestable y puede incrementarse el error. lr = maxlinlr( P ); % si se utiliza bias lr = maxlinlr( P, ‘bias’ ); %si no se utiliza bias W = W + dW; b = b + db;](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-43-320.jpg)

![Ejemplo de Codificación P = [ 1 1; 1 -1 ]; T= [ 1 0]; [W,b] = initlin ( P,T ) [W,b] = solvelin ( P,T ) plotpv ( P,T ) plotpc ( W,b )](https://image.slidesharecdn.com/1adaline-090922005604-phpapp01/85/REDES-NEURONALES-ADALINE-44-320.jpg)