TRABAJO 2 DE COMPUTACIONAL II.pptx

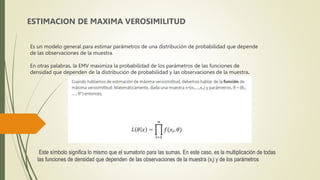

- 1. Es un modelo general para estimar parámetros de una distribución de probabilidad que depende de las observaciones de la muestra. En otras palabras, la EMV maximiza la probabilidad de los parámetros de las funciones de densidad que dependen de la distribución de probabilidad y las observaciones de la muestra. ESTIMACION DE MAXIMA VEROSIMILITUD Este símbolo significa lo mismo que el sumatorio para las sumas. En este caso, es la multiplicación de todas las funciones de densidad que dependen de las observaciones de la muestra (xi) y de los parámetros

- 2. Función logarítmica de EMV Para encontrar las estimaciones de máxima verosimilitud tenemos que diferenciar (derivar) los productos de funciones de densidad y no es la manera más cómoda de hacerlo. Cuando nos encontramos con funciones complicadas, lo que podemos hacer es una transformación monótona.

- 7. PROPIEDADES DE LOS EMV INVARIANZA APROXIMACIÓN NORMAL En muchos casos, el estimador obtenido por máxima verosimilitud posee un conjunto de propiedades asintóticas atractivas: Consistencia Normalidad asintótica Eficiencia Incluso eficiencia de segundo orden tras corregir el sesgo.

- 8. CONSISTENCIA Bajo ciertas condiciones bastante habituales, el estimador de máxima verosimilitud es consistente: si el número de observaciones n tiende a infinito, el estimador θ ̂ converge en probabilidad a su valor verdadero: Bajo condiciones algo más fuertes,2 la convergencia es casi segura:

- 9. Normalidad asintótica 2 Si las condiciones para la consistencia se cumplen tenemos: entonces el estimador de máxima verosimilitud tiene una distribución asintótica normal:

- 10. Invariancia funcional Es una transformación de θ, entonces el EMV de α = g(θ) es Además, el EMV es invariante frente a ciertas transformaciones de los datos. En efecto, una aplicación biyectiva que no depende de los parámetros que se estiman, entonces la función de densidad de Y es Es decir, las funciones de densidad de X e Y difieren únicamente en un término que no depende de los parámetros. Así, por ejemplo, el EMV para los parámetros de una distribución lognormal son los mismos que los de una distribución normal ajustada sobre el logaritmo de los datos de entrada.

- 11. EJERCICIO Números de renovales por metro cuadrado de muestreo en un bosque: y=1,0,2,1,0,0,1,1,2,2y=1,0,2,1,0,0,1,1,2,2. Si suponemos que estos datos se pueden describir como el resultado de un proceso aleatorio de tipo Poisson, y que además las observaciones son independientes, podemos calcular la probabilidad del conjunto de datos como el producto de las probabilidades de cada una de las observaciones >y <- c(1, 0, 2, 1, 0, 0, 1, 1, 2, 2) >lambda <- 1 >p.y <- dpois(y, lambda = lambda) >p.y [1] 0.3678794 0.3678794 0.1839397 0.3678794 0.3678794 0.3678794 0.3678794 ## [8] 0.3678794 0.1839397 0.1839397 >prod(p.y) [1] 5.674991e-06

- 12. Como las probabilidades son números que van entre 00 y 11, el producto de varias probabilidades resulta en números muy pequeños. Vemos en este caso que la probabilidad del conjunto de datos es muy baja (5.6749912×10−65.6749912×10−6). Esto no debería sorprendernos porque esa es la probabilidad de encontrar exactamente esos datos en particular (sin importar el orden). Entonces, para evitar problemas numéricos que pueden aparecer cuando la computadora trabaja con números muy chicos, preferimos trabajar con la suma de los logaritmos de las probabilidades, es decir con el logaritmo del likelihood. En R, podemos usar la opción log = TRUE dentro de las funciones de densidad. >y <- c(1, 0, 2, 1, 0, 0, 1, 1, 2, 2) >lambda <- 1 >ll <- dpois(y, lambda = lambda, log = TRUE) >sum(ll) [1] -12.07944 Una vez que logramos hacer estas cuentas, podemos preguntarnos cómo cambia la probabilidad de observar el set de datos si cambiamos el valor de λλ. Probemos por ejemplo con λ=2

- 13. >y <- c(1, 0, 2, 1, 0, 0, 1, 1, 2, 2) >lambda <- 2 >sum(dpois(y, lambda = lambda, log = TRUE)) [1] -15.14797 Con un λλ de 22 el log likelihood de los datos empeora (es más chico), de manera que nos hace pensar que los datos son más consistentes con λ=1λ=1 que con λ=2λ=2. Siguiendo este razonamiento, podemos continuar probando distintos valores de λλ hasta encontrar el que hace más probable al set de datos. Esta es la idea detrás de los análisis de máxima verosimilitud (a falta de mejor nombre) o de máximum likelihood (si estamos dispuestos a usar palabras en inglés). Veamos gráficamente cómo cambia el log-likelihood a medida que cambia λλ: >y <- c(1, 0, 2, 1, 0, 0, 1, 1, 2, 2) >lambda <- seq(0, 3, by = 0.1) >ll <- numeric(length(lambda)) >for (i in 1:length(lambda)) { >ll[i] <- sum(dpois(y, lambda = lambda[i], log = TRUE)) } >op <- par(cex.lab = 1.5, font.lab = 2, cex.axis = 1.3, bty = "n", las = 1) plot(lambda, ll, pch = 21, bg = "grey")

- 14. >par(op) Podemos ver que la curva de logL llega a un máximo cuando λ=1λ=1. Podemos decir entonces que λ=1λ=1 maximiza la probabilidad de observar nuestro set de datos. Normalmente tenemos más de un parámetro en nuestro modelo de datos, y usamos algún algoritmo de búsqueda para encontrar la combinación de parámetros que hace más probables a nuestros datos (por tradición, los algoritmos buscan minimizar el menos logaritmo de la verosimilitud de nuestros datos).