1 algebra lineal y vectores aleatorios

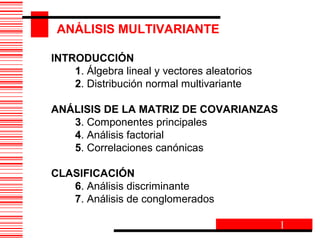

- 1. ANÁLISIS MULTIVARIANTE INTRODUCCIÓN 1. Álgebra lineal y vectores aleatorios 2. Distribución normal multivariante ANÁLISIS DE LA MATRIZ DE COVARIANZAS 3. Componentes principales 4. Análisis factorial 5. Correlaciones canónicas CLASIFICACIÓN 6. Análisis discriminante 7. Análisis de conglomerados 1

- 2. 1. ÁLGEBRA LINEAL Y VECTORES ALEATORIOS Vectores Ortogonalización de Gram-Schmidt Matrices ortogonales Autovalores y autovectores Formas cuadráticas Vectores y matrices aleatorias Matriz de datos 2

- 3. EJEMPLOS 3

- 4. Vectores Matriz de datos: p variables observadas en n objetos Objeto_1 x11 x12 x13 x1 p x21 x22 x23 x2 p x 31 x32 x33 x3 p = X nxp en ℜ p Objeto_n x xn 2 xn 3 xnp n1 Variable_1 Variable_p 4 ALGEBRA LINEAL

- 5. Vectores Dados x1 y1 x= y= x y p p se define: 1. Suma x1 + y1 x+ y = x + y p p 5 ALGEBRA LINEAL

- 6. Vectores 2. Producto de un escalar por un vector c ⋅ x1 c⋅x = c ⋅ x p 3. Producto escalar de dos vectores p x • y = x, y = x' y = ∑ xi y i = x1 y1 + + x p y p i =1 6 ALGEBRA LINEAL

- 7. Vectores Propiedades x, ay + bz = a x, y + b x, z x, y = y , x x x x, x ≥ 0 y x, x = 0 ⇔ x = 0 4. Norma de un vector p x = x ' x = ( x ' x )1 / 2 = ∑ xi2 i =1 7 ALGEBRA LINEAL

- 8. Vectores 5. Distancia entre dos vectores y x− y d ( x, y ) = x − y x 6. Ángulo entre dos vectores x, y θ cosϑ = x y θ ϑ θ x, y = 0 ⇒ cosϑ = 0 ⇒ x ⊥ y 8 ALGEBRA LINEAL

- 9. Vectores Desigualdad de Cauchy-Schwarz x, y ≤ x y Consecuencia: − x y ≤ x, y ≤ x y x, y −1 ≤ ≤1 x y θ − 1 ≤ cos ϑ ≤ 1 9 ALGEBRA LINEAL

- 10. Vectores 7. Ortogonalidad {u1 , u 2 , , u n } es ortogonal si u i ⊥ u j ∀ i, j 8. Ortonormalidad { 1 , e 2 ,, e n } es ortonormal si es ortogonal e y todos los vectores tienen norma 1, es decir, ei = 1 ∀i 10 ALGEBRA LINEAL

- 11. Vectores Ejemplo −1 1 u = 0 v = 0 2 −3 (i ) < u , v > (ii ) u (iii ) u ⊥ v ? (iv ) d (u , v ) (v ) cos θ 11 ALGEBRA LINEAL

- 12. Vectores Un conjunto de vectores { u1 , u 2 , , u n } es linealmente independiente si n ∑c u i =1 i i = 0 ⇒ c1 = c 2 = = c n =0 (la única manera de construir una combinación lineal igual a 0 es que todos los coeficientes sean 0) 12 ALGEBRA LINEAL

- 13. Vectores Proposición. Todo conjunto ortogonal de vectores no nulos es linealmente independiente. { u1 , u 2 ,, u n } ortogonal ⇒ { u1 , u 2 ,, u n } l.i. ⇐ Demostración c1u1 + + cn un = 0 u j , c1u1 + + cnu n = c j u j , u j = 0 u j ,u j ≠ 0 ⇒ cj = 0 13 ALGEBRA LINEAL

- 14. Vectores Proyección de x sobre y x, y x, y pry ( x ) = y = 2 y y, y y 14 ALGEBRA LINEAL

- 15. Vectores Ejemplo − 1 2 x= 0 y = − 1 3 1 pry ( x) ? prx ( y ) ? 15 ALGEBRA LINEAL

- 16. Ortogonalización de Gram-Schmidt V⊂ p ; V subespacio vectorial de ℜ p si V es espacio vectorial, es decir, si u , v ∈ V y ∀a, b ∈ ℜ ; au + bv ∈ V ∀ Dado A = {u1 , u 2 , , u n } n ∑ span A ≡ ci ui i =1 : ci ∈ ℜ Propiedades (i ) A ⊂ span A (ii ) span ( A) es un subespacio 16 ALGEBRA LINEAL

- 17. Ortogonalización de Gram-Schmidt Proposición v ⊥ ui i = 1, , n ⇒ ⇒ v ⊥ span { u1, , un } Demostración u ∈ span { u1 , , un } n n u , v = v, ∑ ci ui = ∑ ci v, ui = 0 i =1 i =1 17 ALGEBRA LINEAL

- 18. Ortogonalización de Gram-Schmidt Dado un conjunto de vectores l.i., se puede construir otro conjunto ortogonal que genere el mismo espacio. Sean { x1 , x2 , , xn } linealmente independientes u1 =x1 x2 , u1 u 2 =x2 − u1 u1 , u1 x3 , u1 x3 , u 2 u3 =x3 − u1 − u2 u1 , u1 u2 , u2 xn , u1 xn , u n − u n = xn − u1 − − 1 un−1 u1 , u1 un − , un − 1 1 18 ALGEBRA LINEAL

- 19. Ortogonalización de Gram-Schmidt Entonces: (i ) span { x1 , , xn } = span { u1 , , un } (ii ) { u1 , , un } es ortogonal 19 ALGEBRA LINEAL

- 20. Matrices ortogonales a11 a12 a1n Amxn = a am 2 amn m1 Matrices ortogonales Anxn; inversa A-1: A A-1 = A-1A = I. A’ transpuesta de A. Qnxn es ortogonal si Q’Q = QQ’ = I. (las columnas de una matriz ortogonal son vectores ortonormales) 20 ALGEBRA LINEAL

- 21. Matrices ortogonales Propiedades x, y ∈ p; Q matriz ortogonal (i ) Qx, Qy = x, y (ii ) x ⊥ y ⇒ Qx ⊥ Qy (iii ) Qx = x y Qx Qy x 21 ALGEBRA LINEAL

- 22. Autovalores y autovectores Anxn; λ autovalor de A ⇔ ∃ x ≠ 0 tal que Ax = λ x x es autovector asociado a λ ∃x ≠ 0, Ax − λ x = 0 ⇔ x ∃x ≠ 0, Ax − λ Ix = 0 ⇔ ∃x ≠ 0, ( A − λ I ) x = 0 ⇔ A−λ I = 0 Polinomio característico Ecuación característica 22 ALGEBRA LINEAL

- 23. Autovalores y autovectores Ejemplo Autovalores y autovectores de 1 − 5 A= −5 1 23 ALGEBRA LINEAL

- 24. Autovalores y autovectores Propiedades (i ) λ 1+ λ 2 + + λn = trA λ1 ≠ λ2 , x1 con autovalor λ1 (ii ) ⇒ x1 y x2 son l.i. x2 con autovalor λ2 Diagonalización de matrices Anxn simétrica ⇔ A = A' ⇔ aij = a ji a11 a1n a12 a12 Anxn = a ann 1n 24 ALGEBRA LINEAL

- 25. Autovalores y autovectores: diagonalización Si A simétrica entonces existen autovalores reales λ 1, , λ n con autovectores asociados e1 , , en ortonormales tales que λ 1 0 e1 ' e1 e2 en λ2 e2 ' Anxn = 0 λ n en ' P D P’ A=PDP’, siendo D diagonal y P ortogonal (Toda matriz simétrica es diagonalizable) 25 ALGEBRA LINEAL

- 26. Autovalores y autovectores: diagonalización Ejemplo Diagonalizar 3 − 2 A= − 2 2 26 ALGEBRA LINEAL

- 27. Autovalores y autovectores: representación espectral a11 a1n a12 a12 Sea Anxn = . a ann 1n Si A es simétrica entonces existen autovalores reales 1, , λ n λ con autovectores ortonormales 1 , , en e tales que A = λ 1e1e1 + λ 2 e2 e2 + + λ n en en . ' ' ' 27 ALGEBRA LINEAL

- 28. Autovalores y autovectores: representación espectral Ejemplo Descomposición espectral de 9 − 2 A= − 2 6 28 ALGEBRA LINEAL

- 29. Formas cuadráticas x1 Anxn simétrica; x ∈ ℜ , n x= f(x)=x’ A x es una forma cuadrática xn ⇓ a11 a12 a1n x1 a21 x2 f ( x) = ( x1 x2 xn ) = a ann xn n1 = a11 x12 + + ann xn + a12 x1 x2 + + aij xi x j + + an −1n xn −1 xn = 2 n n n n n = ∑∑ aij xi x j = ∑ a x + 2∑∑ aij xi x j 2 ij i i =1 j =1 i =1 i =1 j =1 i< j 29 ALGEBRA LINEAL

- 30. Formas cuadráticas Ejemplo Expresar matricialmente la forma cuadrática f ( x1 , x2 , x3 ) = 5 x12 − 2 x2 + 3x3 − 6 x1 x2 + 4 x1 x3 − 5 x2 x3 2 2 Escribir en forma cuadrática 1 2 x1 f ( x1 , x2 ) = ( x1 x2 ) 2 − 2 x 2 30 ALGEBRA LINEAL

- 31. Formas cuadráticas Como Anxn es simétrica, es diagonalizable, se puede escribir A = PDP’ y, por tanto, queda: f(x) = x’PDP’x. Haciendo y = P’x: λ 1 0 y1 n f ( y ) = y ' Dy = ( y1 yn ) = ∑ λ i yi2 , 0 y i =1 λ n n se tiene n f ( y ) = ∑ λ i yi2 = λ 1 y12 + + λ n yn2 . i =1 31 ALGEBRA LINEAL

- 32. Formas cuadráticas x’Ax=c2 representa geométricamente una elipse en ℜ 2 ; los autovalores son λ 1> λ 2 y los autovectores normalizados son e1 y e2. x' Ax = c 2 x' PDP ' x = c 2 ⇒ λ 1 y12 + λ 2 y22 = c 2 y1 x1 y2 c c e1 e2 λ2 λ1 x2 32 ALGEBRA LINEAL

- 33. Formas cuadráticas Ejemplo Representar, hallar los ejes y obtener la expresión reducida de 13 − 5 x1 ( x1 x2 ) − 5 13 x = 9 2 33 ALGEBRA LINEAL

- 34. Formas cuadráticas Clasificación de formas cuadráticas Sea f(x) = x’ A x f es definida positiva si ∀ x ≠ 0, f ( x) > 0 f es semidefinida positiva si ∀ x ∈ , f ( x) ≥ 0 n f es semidefinida negativa si ∀ x ∈ n, f ( x) ≤ 0 f es definida negativa si ∀ x ≠ 0, f ( x) < 0 f es indefinida si ∃ x1 ∈ n y ∃ x2 ∈ n tal que f ( x1 ) > 0 y f ( x2 ) < 0 34 ALGEBRA LINEAL

- 35. Formas cuadráticas λ 1, , λ n Sean los autovalores de A f es definida positiva ⇔ λ 1> 0, , λ n > 0 f es semidefinida positiva ⇔ λ 1≥ 0, , λ n ≥ 0 f es semidefinida negativa ⇔ λ 1≤ 0, , λ n ≤ 0 f es definida negativa ⇔ λ 1< 0, , λ n < 0 f es indefinida ⇔ ∃λ i > 0, ∃λ j < 0 35 ALGEBRA LINEAL

- 36. Raíz cuadrada de una matriz Raíz cuadrada de una matriz: A semidefinida positiva; B es raíz de A si A=BB; B=A1/2 ; A=A1/2 A1/2 Si A es simétrica y A=PDP’ con n descomposición espectral A = ∑ λ i ei e' i =1 entonces: 36 ALGEBRA LINEAL

- 37. Formas cuadráticas Raíz cuadrada de una matriz: λ 1 0 Sea A = P P' 0 λ n λ1 0 ⇒ A1/ 2 = P P' = 0 λ n Nota: 1/ λ 1 0 n 1 A − 1 = P P' = ∑ ei ei ' n 0 1/ λ n i=1 λ i = ∑ λ i ei ei ' i=1 37 ALGEBRA LINEAL

- 38. Descomposición singular de una matriz Dada la matriz Amxn, AA’ es cuadrada y simétrica; por tanto, diagonalizable. 2 λ i es un valor singular de A, si λ i es autovalor de AA’. Descomposición singular Sea A una matriz mxn; 1, , λ k valores singulares de A. λ Entonces existen matrices ortogonales U y V tales que: λ 1 0 0 A=U V 0 λk 0 0 38 ALGEBRA LINEAL

- 39. Vectores y matrices aleatorias X i variable aleatoria µ i= E( X i ) σ ii = σ i2 = V ( X i ) = E[ X i − E ( X i )]2 X1 X 11 X 12 X 1n X = ; Χ= X X X m 2 X mn p m1 Vector Matriz aleatorio aleatoria 31

- 40. Vectores y matrices aleatorias Se llama vector de medias a: µ 1 E( X1) EX = µ = = µ E( X ) p p y covarianza entre dos variables a σ ij = Cov ( X i , X j ) = E[( X i − EX i )( X j − EX j )]. Se define la matriz de covarianzas de X como: σ11 σ1 p VX = ∑ = ∑ X = σ σ pp p1 40

- 41. Vectores y matrices aleatorias X1 c1 X = , c = constantes; EX = µ , VX = Σ. Entonces : X c p p (i ) E (c' X ) = c' µ (ii ) V (c' X ) = c' Σc Cmxp matriz de constantes. Entonces : (i ) E (CX ) = CEX . (ii ) V (CX ) = CΣC '.

- 42. Vectores y matrices aleatorias Ejemplo Y1 = 2 X 2 − X 1 X1 X = X Y2 = X 1 − X 2 2 Y = X − 2 X 3 2 1 − 1 6 − 2 µ = 0 ∑= − 2 4 42 ALGEBRA LINEAL

- 43. Vectores y matrices aleatorias Propiedades Sea Xmxn y sean Akxm y Bnxr matrices de constantes. Entonces: E ( X 11 ) E ( X 1n ) (i ) E ( AX ) = AE ( X ) = A E( X ) E ( X mn ) m1 (ii ) E ( AXB ) = AE ( X ) B (iii ) Ymxn ⇒ E ( X + Y ) = E ( X ) + E (Y ) 43

- 44. Vectores y matrices aleatorias Matriz de correlaciones 1 r12 r1 p r21 1 r2 p σij ρ = , donde rij = ; σii σ jj r rp 2 1 p1 en forma matricial: ρ = V −1/ 2 ∑V −1/ 2 , donde V es la matriz de varianzas: σ11 0 σ12 0 V = = 0 σ pp 0 σp 2 44

- 45. Vectores y matrices aleatorias Partición de un vector aleatorio X1 X1 X (1) Sea X = ; X = r = X X X r +1 X ( 2 ) p X p µ (1) Vector de medias: µ = ( 2 ) µ ∑11 ∑12 Matriz de covarianzas: ∑= ∑ , donde 21 ∑22 ∑11 = V ( X (1) ) ∑22 = V ( X ( 2 ) ) (1) ( 2) ∑12 = ∑'21 = Cov ( X (1) , X ( 2 ) ) = Cov ( X i , X j ) 45

- 46. Matriz de datos Objeto_1 x11 x12 x13 x1 p x21 x22 x23 x2 p x 31 x32 x33 x3 p = X nxp en ℜ p Objeto_n x xn 2 xn 3 xnp n1 n n ∑ xi Variable_11 ∑ xip Variable_p x1 = i =1 xp = i =1 n n 46

- 47. Matriz de datos x1 Vector de medias: x = x p s11 s1 p Matriz de varianzas y covarianzas: S n = n donde sij = ∑( xki − xi )( xkj − x j ) / n s s pp k=1 p1 −1 / 2 −1 / 2 Matriz de correlaciones: R = Vn S n Vn , donde s11 0 Vn = 0 s pp 47

- 48. EJEMPLOS 48

- 49. EJEMPLOS 49

- 50. EJEMPLOS 50

- 51. EJEMPLOS 51

- 52. EJEMPLOS 52

- 53. EJEMPLOS 53

- 54. EJEMPLOS 54

- 55. Matriz de datos Proposición X1 Dado X = ; X 1 , X 2 , , X n i.i.d . ; X p n ∑X i X = i =1 n (i ) E( X ) = µ (ii ) V ( X ) = ∑/ n n −1 (iii ) E ( S n ) = ∑ n 55

- 56. Matriz de datos La matriz de datos se puede representar como: Diagrama de dispersión, n puntos en el espacio ℜ p p=2 p=3 x3 x2 x2 x1 x1 Como para p>3 no es posible representarlo, se utilizan diagramas de dispersión múltiple con pares de variables. 56

- 57. Matriz de datos Considerando las columnas en vez de la filas de la n matriz de datos, es decir, p puntos en Objeto_1 x11 x12 x13 x1 p x21 x22 x23 x2 p x 31 x32 x33 x3 p = X nxp en ℜp Objeto_n x xn 2 xn 3 xnp n1 Y1 Y2 Y3 Yp Para cuatro variables: Variable_1 Variable_p Y1 Y4 x11 x12 x13 x14 Y3 X = x21 x22 x23 x24 x x32 x33 x34 Y2 31 Y1 Y2 Y3 Y4 57

- 58. Matriz de datos 1 Vector de unos: 1 nx1 = n unos 1 Propiedades 1= n y forma el mismo ángulo con todos los ejes. 1/ n es el vector unitario que forma el mismo ángulo en todas las direcciones. 58

- 59. Matriz de datos Proyección de un vector sobre el vector 1: n yi ,1 ∑x j =1 ij xi pr1 ( yi ) = 1= ⋅1 = xi 1 = 1,1 n x i yi 1 xi 1 59

- 60. Matriz de datos Vector de desviaciones a la media: x1i − xi x1i 1 d i = = − xi x − x x 1 ni i ni 60

- 61. Matriz de datos Entonces: 2 • d i = ( x1i − xi ) + ... + ( xni − xi ) ⇒ d i 2 2 = nsii n • d i , d j = ∑ ( xki − xi )( xkj − x j ) = nsij k =1 di , d j nsij sij • cos(d i , d j ) = = = = rij di d j nsii ns jj sii s jj 61

- 62. Matriz de datos Varianza generalizada y varianza total: X1 µ1 σ 11 σ 1 p X = ; µ = E( X ) = ; ∑ = X µ σ σ p p p1 pp 62

- 63. Matriz de datos Varianza generalizada de X: ∑ = det(∑) Varianza total de X: traza ( ∑) = σ11 + + σ pp Varianza generalizada muestral: S n = det( S n ) Varianza total muestral: traza ( S n ) = s11 + + s pp 63

- 64. Matriz de datos Interpretación geométrica Área = = d1 d 2 senθ = ns11 ns22 1 − cos 2 θ = n s11s22 (1 − r12 ) = n | S n | 2 p Varianza generalizada en Volumen 2 Sn = np 64

- 65. EJEMPLOS 65

- 66. EJEMPLOS 66

- 67. EJEMPLOS 67

- 68. Matriz de datos Combinaciones lineales de las componentes de una variable X1 x1 s11 s1 p c1 b1 X = ; x = ; S n = ; c = ; b = X x s s c b p p p1 pp p p c' X = c1 X 1 + + c p X p y las combinaciones lineales: b' X = b X + + b X 1 1 p p Media muestral de c’X: c' x Varianza muestral de c’X: c' S n c Covarianza muestral de c’X y b’X: c' S n b 68

- 69. Matriz de datos Ejemplo 2 0 1 X1 3 1 0 X = X = X2 2 1 0 X 3 4 1 0 c' X = 2 X 1 − 3 X 2 b' X = X 1 − 2 X 3 69 ALGEBRA LINEAL

- 70. EJEMPLOS 70

- 71. EJEMPLOS 71

- 72. EJEMPLOS 72

- 73. EJEMPLOS 73

- 74. EJEMPLOS 74

- 75. EJEMPLOS 75

- 76. EJEMPLOS 76