Este documento presenta un resumen del modelo de regresión múltiple en 3 oraciones:

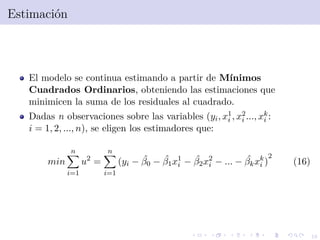

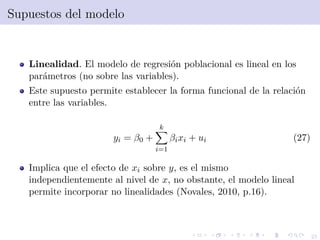

1) El modelo de regresión múltiple generaliza el modelo de regresión simple al permitir que la variable dependiente dependa de múltiples variables independientes de forma simultánea.

2) El modelo estima los coeficientes de cada variable independiente que representan sus efectos parciales sobre la variable dependiente, manteniendo constantes el efecto de las demás variables.

3) El modelo asume una relación lineal entre las variables y que el error es independiente de las variables independientes

![14

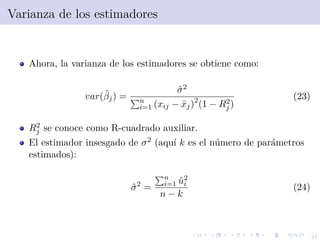

Modelo de regresi´on m´ultiple

Ahora, el modelo se generaliza para controlar de forma expl´ıcita

los dem´as factores que afectan la variable independiente, en el

conocido modelo de regresi´on lineal m´ultiple:

yi = β0 + β1x1

i + β2x2

i + ... + βkxk

i + ui (13)

Donde, β0 indica al efecto medio sobre Y de todas las variables

excluidas del modelo, aunque su interpretaci´on mec´anica del valor

promedio de Y cuando todas las x s se hacen cero continua siendo

valida; las βi ∀i ∈ [1, ..., k] se conocen como coeficientes de

regresi´on parciales; y, ui continua siendo el t´ermino de error.](https://image.slidesharecdn.com/clase3-181030022634/85/Clase3-El-modelo-de-regresion-multiple-14-320.jpg)

![15

Modelo de regresi´on m´ultiple

Tomando esperanza condicionales:

E[yi|x1

i , x2

i , ..., xk

i ] = β0 + β1x1

i + β2x2

i + ... + βkxk

i (14)

Donde el supuesto clave de la relaci´on de ui con X se establece en

t´erminos de esperanza condicional, indicando que el promedio de

los efectos de los factores no observados es igual a cero,

independientemente de los valores de las xi. Es decir,

corr(u, x) = 0.

E[ui|x1

i , x2

i , ..., xk

i ] = 0 (15)](https://image.slidesharecdn.com/clase3-181030022634/85/Clase3-El-modelo-de-regresion-multiple-15-320.jpg)

![27

Supuestos del modelo

Independencia entre el error y las regresoras del modelo.

E[ui|xi] = E[ui] = 0 ∀i = 1, 2, 3, ..., n (28)

Seg´un Gujarati y Swan (2009, p.4), la raz´on de este supuesto es

que la especificaci´on de la regresi´on supon´ıa un efecto aditivo e

independiente entre x e u, de lo contrario, no es posible evaluar los

efectos individuales de las regresoras.](https://image.slidesharecdn.com/clase3-181030022634/85/Clase3-El-modelo-de-regresion-multiple-27-320.jpg)

![28

Supuestos del modelo

Cuando ui no cumple la independencia se obtienen relaciones

espurias, dado que la relaci´on entre u y x se debe a factores no

observados que afectan a y y est´an relacionados con x

(Wooldridge, 2009, p.52).

Suponga ha especificado el modelo siguiente, omitiendo la variable

relevante (x2i).

yi = β0 + β1x1i + νi (29)

Ahora, E[νi] = E[β2x2i + ui] = β2E[x2i].](https://image.slidesharecdn.com/clase3-181030022634/85/Clase3-El-modelo-de-regresion-multiple-28-320.jpg)

![33

Supuestos del modelo

Homocedasticidad o varianza constante de ui condicionada a los

valores de x s, que indica que la varianza es independiente a los

valores de x.

var[ui|xi] = E[ui] = var(ui) = σui (33)

Este supuesto no se utiliza para demostrar insesgamiento.](https://image.slidesharecdn.com/clase3-181030022634/85/Clase3-El-modelo-de-regresion-multiple-33-320.jpg)