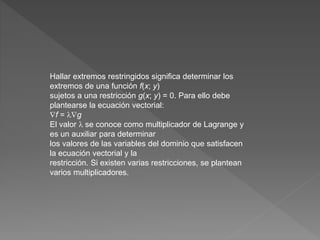

La matriz Jacobiana está formada por las derivadas parciales de primer orden de una función. Representa la derivada de una función multivariable y permite aproximar linealmente la función en un punto. El determinante jacobiano da información sobre el comportamiento local de la función, como si es invertible o cómo expande o contrae volúmenes. El método de los multiplicadores de Lagrange reduce problemas de optimización con restricciones a problemas sin restricciones adicionales.