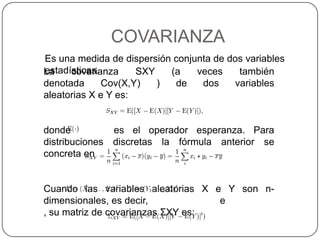

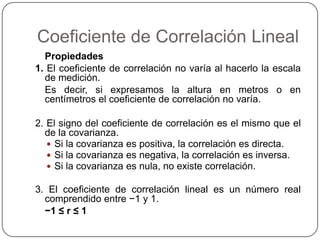

Este documento describe conceptos estadísticos como la correlación, la covarianza, la regresión lineal y la correlación por rangos. Explica que la correlación mide la relación entre dos variables, la covarianza es una medida de dispersión conjunta, y la regresión lineal modeliza la relación entre una variable dependiente y una o más independientes. También cubre cómo calcular el coeficiente de correlación de Pearson y Spearman.