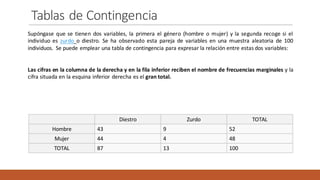

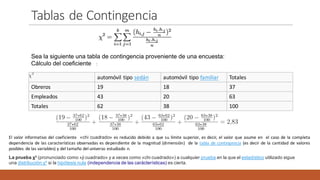

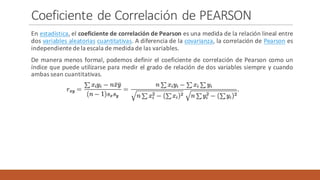

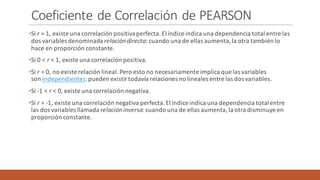

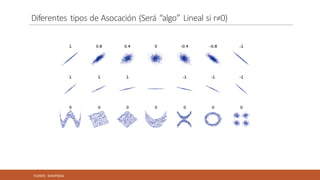

Este documento explica diferentes métodos para medir la asociación entre dos variables, incluyendo tablas de contingencia, el coeficiente chi cuadrado, el coeficiente de correlación de Pearson, y otros coeficientes de correlación. También describe cómo el coeficiente de correlación de Pearson mide la fuerza y dirección de la relación lineal entre dos variables cuantitativas.