El documento describe los errores de añadir agua adicional al hormigón. La relación correcta entre el cemento y el agua es crucial para que el hormigón alcance su resistencia máxima. Añadir más agua aumenta la porosidad y disminuye la durabilidad y resistencia del hormigón. Esto puede conducir a una mayor carbonatación y corrosión de las armaduras con el tiempo. Por lo tanto, la cantidad de agua en el hormigón debe controlarse estrictamente y no debe agregarse agua adicional en la obra.

![útil y al menos el 80% de los mó-

dulos (por peso) deben ser recu-

perados.

El reciclado de paneles fotovol-

taicos no es económicamente

rentable en la actualidad debido a

que los volúmenes tratados son

insignificantes. Se prevé que a

partir del año 2030 empezarán a

generarse grandes cantidades de

residuos.

A nivel europeo, se estima que

las cantidades significativas em-

piecen a aparecer a partir del año

2050. De estas cantidades, la ma-

yoría corresponderán a los pane-

les de primera generación (silicio)

que representarán más del 40%.

Se ha estimado que la gestión de

los paneles empieza a ser econó-

micamente viable a partir de las

20.000t/año, aunque criterios

más realistas apuntan a las 40 -

50.000 t/año.

Las cantidades que se recogen

actualmente, corresponden prin-

cipalmente a roturas durante la

fabricación o en la mala instala-

ción de las placas durante los 2

primeros años.

Una disposición incorrecta del

residuo puede dar lugar a lixivia-

dos de Pb, Cd, pérdida de mate-

rias primas y de metales raros.

Los paneles están compuestos

mayormente por vidrio y alumi-

nio, pero también contienen, en

pequeñas cantidades, otros mate-

riales que tienen un gran valor

debido a su escasez, plata, indio,

galio, germanio, telurio…

Los metales raros no suponen

más de un 1% en peso del panel,

pero tienen un gran valor econó-

mico.

Actualmente sólo hay dos méto-

dos de reciclaje para los paneles

que han sido testados y puestos

en práctica:

- Tratamiento del Silicio crista-

lino de Deustche Solar

(Alemania)

- Tratamiento de Teluro de Cad-

mio de First Solar (EUA, Alema-

nia y Malasia)

Al contrario que en los sistemas

Deutsche Solar y First Solar, el

simple reciclado del vidrio sólo

conlleva una separación física

con el objetivo de recuperar el

vidrio y no se separan otros com-

ponentes como el Cadmio o el

Mercurio.

Con un procedimiento de recicla-

je adecuado, se puede llegar a

recuperar el 100% del Aluminio,

el 95% del vidrio y el 33% de los

metales raros.

Hay que tener en consideración

que existen paneles solares que

contienen pequeñas cantidades

de Mercurio y Cadmio

(representan menos del 1% del

peso). Substancias que tienen que

gestionarse correctamente por el

elevado impacto que puede supo-

ner su emisión al medio. Aunque

la evolución tecnología de los

paneles, lleva a la reducción del

uso de sustancias peligrosas en su

composición, por lo que se redu-

cirá su aparición en los residuos

futuros.

Teniendo en cuenta que solo hay

dos sistemas de reciclaje de pane-

les reconocidos, existen fabrican-

tes que llevan a cabo ciertos pro-

cesos de reciclaje y reutilización

(pendientes de verificar) entre

ellos, fabricantes españoles.

Hay que estar preparados para el

momento en que las cantidades

de residuos de paneles

comunidades autónomas.

Hasta hace poco, el reciclaje de

paneles fotovoltaicos no era obli-

gatorio en Europa. Pero en el

2012 el Parlamento de la Unión

Europea (UE) oficialmente cam-

bió las directrices de su

“Desperdicio de Equipo Eléctri-

co y Electrónico”, WEEE por

sus siglas en ingles. Bajo las nue-

vas modificaciones, el 85% de

todos los módulos fotovoltaicos

deben ser recolectados por los

“productores” al final de su vida

69Nº14. Junio de 2016

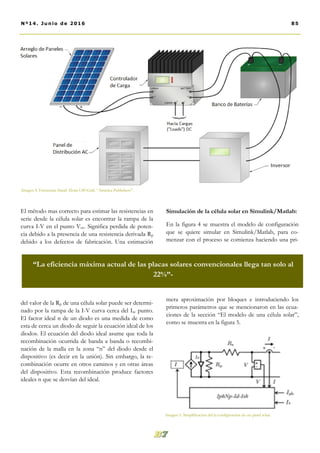

Imagen 1. Potencia solar instalada en España,

fotovoltaica y térmica. [www.ree.es]

Imagen 2. Localización de centrales solares

térmicas en España. [www.protermosolar.es]

Imagen 3. Evolución de la potencia eólica insta-

lada año a año en España (en MW)

[www.aeeolica.org]](https://image.slidesharecdn.com/1606biela7-160523001918/85/1606-Biela-7-65-N-14-69-320.jpg)

![EFE Félix A. López, investigador

del CSIC.

Las palas de molino o aerogene-

radores en desuso son residuos

emergentes (nuevos en el merca-

do) y por tanto todavía no existe

una directiva europea específica

que las catalogue como residuos

peligrosos o tóxicos o inertes, lo

que favorece el vacío legal en

torno a ellas.

A este respecto cabe señalar que

el parque eólico español, los pri-

meros aerogeneradores datan de

1997, está constituido por 17.000

generadores lo que suma un total

de 51.000 palas, de las que unas

1.500 o 2.000 se encuentran a día

de hoy averiadas o en desuso.

Actualmente el destino de estas

palas, sin una legislación que lo

defina, hay que buscarlo en alma-

cenes y depósitos localizados en

las inmediaciones de los grandes

parques eólicos repartidos por

casi toda la península.

Además, los parques eólicos es-

tán situados generalmente en lu-

gares inaccesibles y el transporte

de una pala por una empresa ges-

tora más la trituración de la mis-

ma tiene un coste que varía entre

los 4.000 y 5.000 euros, coste que

a veces es complicado asumir.

Estas palas, miden entre 45 y 48

metros, se pueden averiar bien

por fenómenos meteorológicos

adversos como los rayos, bien

por choques de avifauna o sim-

plemente porque han llegado al

final del ciclo de su vida, unos 15

años dependiendo de diversos

factores, lo que haría imprescin-

dible su sustitución.

Es por eso que el Consejo Supe-

rior de Investigaciones estima

que en España y en un período

entre 2017-2025, alrededor de

1.500 aerogeneradores (4.500

palas) equivalentes a una potencia

instalada de aproximadamente

2128 MW, e instalados en el pe-

ríodo 1997-2000, habrán llegado

al final de su vida útil. Además, el

aprovechamiento de las palas

también estaría orientado a la

recuperación de materiales como

las fibras de carbono ya que tie-

nen un valor añadido para aplica-

ciones dentro de la aeronáutica y

representan una oportunidad de

negocio y de innovación impor-

tante.

fotovoltaicos empiecen a aumen-

tar.

Las palas de los aerogeneradores

en desuso o al final de su vida útil

-entre 1.500 y 2.000 en España-

se están almacenando en vertede-

ros incontrolados, con el consi-

guiente riesgo a una combustión

que libere las sustancias tóxicas

de las que están hechas y generen

un impacto en la salud y el medio

ambiente.

Si las palas se depositan junto a

un bosque y un incendio forestal,

fortuito o provocado las quema-

ra, la combustión de esas aspas

compuestas por fibras de car-

bono y de vidrio, reforzadas en

algunos casos con poliéster, ge-

neraría químicos peligrosos y

muy contaminantes para el me-

dioambiente y el hombre, ha ex-

plicado en una entrevista con

70 Nº14. Junio de 2016

Imagen 4. Fragmentación de pala averiada de un aerogenerador para facilitar su manipulación y tritura-

ción. [www.futurenviro.es]

“El reciclado de paneles fotovoltaicos no es económicamente rentable en la actualidad

debido a que los volúmenes tratados son insignificantes.”](https://image.slidesharecdn.com/1606biela7-160523001918/85/1606-Biela-7-65-N-14-70-320.jpg)

![cundarias. Dicha investigación

estará finalizada en 2017 y se en-

focará hacia la recuperación de

los recursos materiales conteni-

dos en estos residuos (fibras

inorgánicas y otros materiales) en

todas las etapas del proceso de

fin de vida: desmontaje de las

palas en el parque eólico y reci-

claje de los materiales recupera-

dos para su devolución al ciclo

económico como materias pri-

mas secundarias. Concretamente,

se demostrará su aprovechamien-

to como refuerzo en prefabrica-

dos de hormigón, mientras que el

material restante de la pala, con

propiedades aislantes, será utiliza-

do en núcleos de paneles para la

construcción.

El planteamiento propuesto

aborda la problemática de la ges-

tión de estos residuos de forma

integral, es decir, desde el des-

montaje de las palas en el propio

campo eólico y su logística inver-

sa, hasta el tratamiento del resi-

duo y el aprovechamiento de los

materiales reciclados en nuevas

aplicaciones.

Los resultados esperados del pro-

yecto se orientan a desarrollar

una Guía de Buenas Prácticas y

metodología para el desmontaje y

logística inversa de palas de aero-

generador; una Metodología de

Reciclaje que permita alcanzar un

índice de recuperación de mate-

riales superior al 75% en peso de

las palas (metales, fibras inorgáni-

cas, polímeros), una reducción de

los Gases de Efecto Invernadero

(en términos de CO2 equivalen-

te) de al menos 6.000 kg de CO2

por pala reciclada y una Guía de

recomendaciones legislativas diri-

gida a Comisión Europea en ma-

teria de desmantelamiento, ges-

tión y reciclaje de turbinas eólicas

obsoletas.

Desde el punto de vista ambien-

tal y en función de las perspecti-

vas de crecimiento a futuro de la

tecnología, se hace necesario ocu-

parse de un problema emergente

asociado al crecimiento de la can-

tidad de parques eólicos instala-

dos y por instalarse, como es la

gestión de los residuos generados

por los aerogeneradores una vez

cumplida su vida útil.

Ante esta realidad, Iberdrola se

ha aliado con los centros tecnoló-

gicos vascos Gaiker-IK4 y

Tecnalia, para crear un nuevo

sistema sostenible que permita el

aprovechamiento de las palas de

los aerogeneradores, desarrollan-

do el proyecto LIFE+BRIO, fi-

nanciado por el Programa LI-

FE+ de la Unión Europea, cuyo

principal objetivo es demostrar

desde una perspectiva de ciclo de

vida, una metodología innovado-

ra y sostenible de gestión y recu-

peración de los materiales con los

que están fabricadas las palas de

los aerogeneradores para reutili-

zarlos como materias primas se-

Imagen 6. Desguace de aerogenerador

[www.fernandocosano.es]

71Nº14. Junio de 2016

Imagen 5. Aerogenerador destruido debido a

fuertes vientos . [www.occhiodisalerno.it ]

”-

“El aprovechamiento de las palas recupera materiales como fibras de carbono con un valor

añadido para aplicaciones dentro de la aeronáutica y de innovación importante.”

REFERENCIAS Y

BIBLIOGRAFÍA:

- Asociación de empresas de

energías renovables (APPA):

< http://www.appa.es>

- Asociación empresarial eléctrica

(AEE):

< http://www.aeeolica.org/es>

- Iberdrola: < www.iberdrola.es>

- Red eléctrica de España (REE):

<http://www.ree.es/es/>.](https://image.slidesharecdn.com/1606biela7-160523001918/85/1606-Biela-7-65-N-14-71-320.jpg)