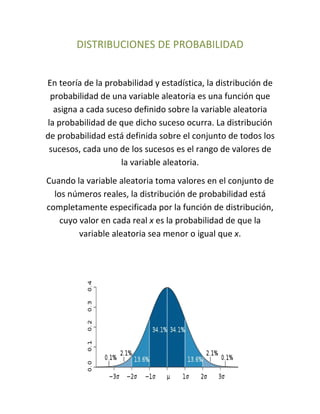

Este documento presenta varias distribuciones de probabilidad importantes como la binomial, Poisson, normal, t student y gamma. Explica que la distribución de probabilidad de una variable aleatoria asigna probabilidades a los posibles resultados y está definida por la función de distribución. También provee ejemplos para ilustrar cómo se aplican estas distribuciones en diferentes contextos estadísticos y de toma de decisiones.