Luis eduardo ahumada recalde

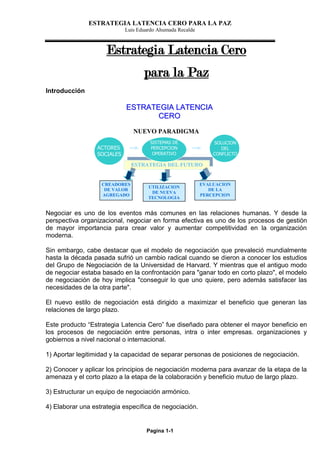

- 1. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Estrategia Latencia Cero para la Paz Introducción ESTRATEGIA LATENCIA CERO NUEVO PARADIGMA SISTEMAS DE SOLUCION ACTORES PERCEPCION DEL SOCIALES OPERATIVO CONFLICTO ESTRATEGIA DEL FUTURO CREADORES EVALUACION UTILIZACION DE VALOR DE LA DE NUEVA AGREGADO PERCEPCION TECNOLOGIA Negociar es uno de los eventos más comunes en las relaciones humanas. Y desde la perspectiva organizacional, negociar en forma efectiva es uno de los procesos de gestión de mayor importancia para crear valor y aumentar competitividad en la organización moderna. Sin embargo, cabe destacar que el modelo de negociación que prevaleció mundialmente hasta la década pasada sufrió un cambio radical cuando se dieron a conocer los estudios del Grupo de Negociación de la Universidad de Harvard. Y mientras que el antiguo modo de negociar estaba basado en la confrontación para "ganar todo en corto plazo", el modelo de negociación de hoy implica "conseguir lo que uno quiere, pero además satisfacer las necesidades de la otra parte". El nuevo estilo de negociación está dirigido a maximizar el beneficio que generan las relaciones de largo plazo. Este producto “Estrategia Latencia Cero” fue diseñado para obtener el mayor beneficio en los procesos de negociación entre personas, intra o inter empresas. organizaciones y gobiernos a nivel nacional o internacional. 1) Aportar legitimidad y la capacidad de separar personas de posiciones de negociación. 2) Conocer y aplicar los principios de negociación moderna para avanzar de la etapa de la amenaza y el corto plazo a la etapa de la colaboración y beneficio mutuo de largo plazo. 3) Estructurar un equipo de negociación armónico. 4) Elaborar una estrategia específica de negociación. Pagina 1-1

- 2. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde 5) Negociar con éxito en proyectos comerciales, internacionales, laborales y políticos EL CONFLICTO NO ESTA EN LA REALIDAD OBJETIVA SINO EN LA MENTE DE LAS PERSONAS. Por ello, de acuerdo al acta de constitución de la UNESCO, -"Puesto que las guerras se originan en la mente de los hombres, es allí donde se deben constituirse las defensas de la paz".- ES POSIBLE ESTABLECER 5 FASES EN EL CICLO DE VIDA DE UN CONFLICTO 1) EL CONFLICTO LATENTE Existe de esta manera cuando hay sólo una estructura del conflicto, generado por la existencia de intereses que tienen una tendencia a oponerse de manera recíproca, pudiendo permanecer latente durante muchos años. 2) INICIACION DEL CONFLICTO. La situación se activa cuando sucede un acontecimiento desencadenante, que inicia el conflicto propiamente dicho, al tornarlo en conflicto manifiesto (como si en el ejemplo anterior, se compraran máquinas que reducen la mano de obra, el gremio amenaza con una huelga). 3) BUSQUEDA DEL EQUILIBRIO DE PODER. Ambas partes, para equilibrar las posiciones pueden recurrir a la fuerza o al derecho, a buscar el equilibrio mediante medios no coercitivo (mediación/Conciliación). 4) EQUILIBRIO DE PODER. Se encuentra el equilibrio a través de medios alternativos de resolución de conflictos. 5) RUPTURA DEL EQUILIBRIO Si las condiciones varían con el tiempo, se llega a una ruptura. La mediación constituye uno de los procesos de búsqueda de equilibrio de poder, pudiendo evitarse a través de ella que surja una conducta de conflicto manifiesta. Los extremos de este curso pretenden mostrar el perfil de la negociación desde su génesis, ocuparse de ella en su estado de latencia, es lo que llamamos LATENCIA CERO. Desarrollamos nuestros trabajo, incorporando a la técnica de la negociación las herramientas informáticas y los principios de la globalización, con lo que obtenemos un producto que llamamos “ESTRATEGIA LATENCIA CERO PARA LA PAZ”. Pagina 1-2

- 3. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde "Destreza en la estrategia", 1) El concepto de Estrategia 2) Perfil del Estrategia 3) Enfoques anteriores y actuales sobre Estrategias E CONCEPCIÓN PROSPECTIVA s Actitud anticipadora Modelo c Utópico a Salto Quántico l a Ubicación N Prospectiva e del suceso g e n t Horizonte Búsqueda creativa Prospectivo r respecto del pasado ó p i Pasado Presente Futuro c a EL CONCEPTO DE ESTRATEGIA "Los administradores son artesanos y la estrategia es su arcilla" Múltiples Interpretaciones: El concepto de estrategia ha sido objeto de múltiples interpretaciones, de modo que no existe una única definición. No obstante, es posible identificar cuatro concepciones alternativas que si bien compiten, tienen la importancia de complementarse: Estrategia como Plan Un curso de acción conscientemente deseado y determinado de forma anticipada, con la finalidad de asegurar el logro de los objetivos de la empresa. Normalmente se recoge de forma explícita en documentos formales conocidos como planes. Estrategia como Pauta La estrategia es cualquier conjunto de acciones o comportamiento, sea deliberado o no. Definir la estrategia como un plan no es suficiente, se necesita un concepto en el que se acompañe el comportamiento resultante. Específicamente, la estrategia debe ser coherente con el comportamiento. Estrategia como Posición Pagina 1-3

- 4. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde La estrategia es cualquier posición viable o forma de situar a la empresa en el entorno, sea directamente competitiva o no. Estrategia como Perspectiva La estrategia consiste, no en elegir una posición, sino en arraigar compromisos en las formas de actuar o responder; es un concepto abstracto que representa para la organización lo que la personalidad para el individuo. El gran aporte de Henry Mintzberg consiste en un enfoque integrador de las distintas perspectivas y la toma de posiciones en diversos temas que tradicionalmente son objeto de debate en el campo de la ciencia de la administración. Las Estrategias son tanto planes para el futuro como patrones del pasado Los enfoques clásicos del concepto de estrategia la definen como un "proceso a través del cual el estratega se abstrae del pasado para situarse mentalmente en un estado futuro deseado y desde esa posición tomar todas las decisiones necesarias en el presente para alcanzar dicho estado." De esta definición se destaca el concepto de estrategia como un plan puramente racional y formal que se define hacia el futuro con total prescindencia del pasado. Bajo esta misma línea de pensamiento, Jean Paul Sallenave expone la existencia de dos enfoques antagónicos en los modelos intelectuales estratégicos, para inclinarse finalmente por el segundo de ellos: Enfoque de preferencia: afirma que el futuro es la "continuación del presente, que, a su vez, es la prolongación del pasado". Enfoque prospectivo: según este enfoque, el futuro no es necesariamente la prolongación del pasado. La estrategia puede concebirse independientemente del pasado. Henry Mintzberg no niega la importancia de mirar hacia al futuro y de impulsar visiones creativas, pero introduce un concepto clave: la existencia de patrones de comportamiento organizacional que dependen en gran medida de las experiencias pasadas. La experiencia que surge de las acciones pasadas –deliberadas o no- no dejan de hacerse sentir, proyectándose hacia el futuro. Así, el estratega sabe con precisión que le ha funcionado y qué no ha servido en el pasado; posee un conocimiento profundo y detallado de sus capacidades y de su mercado. Los estrategas se encuentran situados entre el pasado las capacidades corporativas y el futuro de sus oportunidades de mercado. En consecuencia, al incorporar la importancia de las experiencias pasadas, su concepto de estrategia se aparta de la concepción clásica, para arribar al primer concepto clave: Las estrategias son tanto planes para el futuro como patrones del pasado Estrategias deliberadas y Estrategias emergentes Pagina 1-4

- 5. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde En el campo epistemológico son conocidas dos corrientes rivales que tratan de explicar el proceso de generación de conocimiento científico: el método deductivo y el método inductivo. Bajo el primero de ellos, toda acción está precedida por un conjunto de expectativas e hipótesis. El método inductivo, en cambio, primero realiza la acción y posteriormente arriba a la formulación de hipótesis para sus modelos. Este mismo debate se presenta en el campo del management. En el orden nacional, el Dr. Federico Frischknecht ha titulado a su obra "De las Ideas a la acción.... y de la acción a las ideas!", en una clara referencia a la importancia de la retroalimentación que cierra un circuito de "pensamiento – acción – pensamiento ....-". Henry Mintzberg se introduce en estos temas al reconocer la existencia de "estrategias deliberadas" y "estrategias emergentes" como puntos límites de un continuo a lo largo del cual se pueden encontrar las estrategias que se "modelan" en el mundo real. En efecto, si bien es lógico imaginar que "primero se piensa y después se actúa", no menos importante -e igualmente lógico- es plantear que al momento de ejecutarse las ideas se produzca un proceso de aprendizaje a través del cual "la acción impulse al pensamiento" y de esta forma surja una nueva estrategia. Sencillamente, las estrategias pueden formarse como respuesta a una situación cambiante, o pueden ser generadas en forma deliberada. "No se requiere que las estrategias sean deliberadas, es posible asimismo que, en mayor o menor medida, surjan El aprendizaje estratégico Detrás de lo expuesto en el apartado anterior, se encuentra el concepto del "aprendizaje estratégico". Ningún estratega "piensa unos días y trabaja otros", por el contrario está en constante sincronización "ideas – acción" sin perjudicar el lazo vital de retroalimentación que las une. Este concepto implica que de alguna forma "todos lo niveles de la organización son estrategas". La noción de que la estrategia es algo que debe generarse en los altos niveles, muy lejos de los detalles de la actividad diaria, es una de las más grandes falacias de la administración estratégica convencional. Pagina 1-5

- 6. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Mientras una estrategia exclusivamente deliberada impide el aprendizaje una vez que ha sido formulada, una estrategia emergente lo promueve y estimula. En efecto, el aprendizaje se da sobre la marcha... Sin embargo ha de tenerse en cuenta que así como las estrategias deliberadas impiden el aprendizaje, el desarrollo de estrategias de forma exclusivamente emergente impide el control. Finalmente, puede concluirse: "Las estrategias mas eficaces son aquellas que combinan la deliberación y el control con la flexibilidad y el aprendizaje organizacional" El cambio organizacional Según la teoría del cambio organizacional los estrategas tienen que escoger entre tratar el cambio en forma incremental y lineal, o en forma fundamental y diagnóstica. Si se opta por una estrategia de "cambio incremental", lo probable es que se atienda "primero a lo primero" y que los cambios necesarios se hagan en orden, uno por uno. Si se elige una estrategia de "cambio fundamental", las consecuencias para la organización son que la organización misma, sus partes y sus relaciones cambiarán simultáneamente. La efectividad de estos enfoques rivales es motivo de debates, con adherentes de gran peso en ambos casos. Veamos dos ejemplos: Eliyahu Goldratt, en su obra "La meta" señala que "toda grupo humano, en el proceso de llegar a su meta, se encuentra con uno o mas cuellos de botella. Si no fuese así, la empresa tendría un lucro infinito". Según su enfoque, una vez que un cuello de botella es superado, se genera un feed-back, y se identifica una nueva restricción sobre la cual trabajar. Este proceso permite la mejora continua de los resultados, a través de la administración de cambios incrementales implementados según un ordenamiento específico: la importancia de su incidencia negativa en el logro de los objetivos. Richard Beckhard y Wendy Pritchard, en cambio, se enrolan en el enfoque del "cambio fundamenta". Los líderes de la organización deben tener una visión clara del estado final que desean para todo el sistema, incluyendo dimensiones tales como su negocio, su organización y sus maneras de trabajar. Esa visión debe actuar como fuerza integrante de una multitud de cambios aparentemente dispares que hay que efectuar. El plan para hacer los cambios debe ser integrado. Al respecto, Mintzberg despliega un razonamiento de naturaleza kuhniana: ambos enfoques son efectivos, la clave es saber cómo y cuando promover el cambio. La "teoría cuantitativa" -en la cual se apoya- señala que durante la mayor parte del tiempo se sigue una misma orientación estratégica signada por el cambio "evolutivo", hasta que la organización pierde sincronización con el medio ambiente y se hace necesario un drástico viraje estratégico en el que se alteran muchos de sus patrones. Este disturbio revolucionario provocó un "salto" hacia una nueva estabilidad. Pagina 1-6

- 7. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde En primer lugar, hay que considerar que el concepto mismo de la estrategia está arraigado a la estabilidad y no al cambio; la ausencia de estabilidad implica ausencia de estrategia pues no habrá ningún rumbo hacia el futuro ni patrón del pasado. Hecha esta primera apreciación, identifica dos períodos distintos de comportamiento organizacional según el momento: "Desarrollo Normal" "Revolución Cuantitativa" Se produce un viraje estratégico radical, impulsado por turbulencias del medio ambiente, Gobierna la estabilidad: los cambios en el que se producen cambios en la misión, la estratégicos son incrementales, pero dentro de las relaciones entre los interesados identidad, la misma orientación. clave, en la forma de trabajar y – fundamentalmente- en la cultura. Se da la mayor parte del tiempo. Las reorientaciones estratégicas ocurren a través de saltos cuantitativos breves y concisos. El énfasis está puesto en la eficiencia: Es énfasis está puesto en la eficacia: es el al hacerse "más de lo mismo" se goza de los momento de la experimentación y la beneficios de la curva de aprendizaje, creatividad, en el afán de adaptarse a las lo que permite ganar en eficiencia, al tiempo que se condiciones del medio ambiente. nuevas desarrollan cualidades distintivas y se refuerza la identidad Es el tiempo de "cosechar" Es el tiempo de "sembrar" Se caracteriza por la rigidez y el control Se caracteriza por la flexibilidad y la experimentación PERFIL DEL ESTRATEGA El rol del "modelador" de estrategias El estratega no es sólo un planificador o un visionario sino un sujeto en continuo aprendizaje para gobernar un proceso en el cual las estrategias y las visiones pueden surgir, así como pueden ser concebidas de manera deliberada. La dedicación, experiencia, el toque personal, el dominio del detalle, el sentido de la armonía y la integración, la emoción y la pasión, son los ingredientes básicos para el éxito del estratega. En función de todo lo expuesto, es posible identificar cuatro puntos a tener en cuenta: Pagina 1-7

- 8. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Administración de la estabilidad Si las estrategias requieren de estabilidad, los estrategas no tendrían que obsesionarse con generar cambios fundamentales. Por el contrario, deben mantener la orientación, ganar en eficiencia centrándose en los procesos y reforzar la identidad y las características distintivas. Detección de discontinuidades Sin perjuicio de lo indicado en el punto anterior, es probable que el hecho de "hacer más de lo mismo" provoque que la organización pierda sincronización con el medio ambiente. El reto real del estratega consiste en detectar las sutiles discontinuidades que puedan dar indicios de la necesidad de cambios fundamentales. Para ello el estratega deberá tener la mente ágil y una clara comprensión de la situación. Conocimiento del negocio El líder no puede "diseñar estrategias" alejado de los detalles operativos de su negocio. Por el contrario, allí, en la línea de acción, es donde se encuentra la mejor información, la que permite detectar oportunidades y aprender por la contrastación entre las ideas y los hechos. Administración de patrones La labor del gerente no consiste sólo en preconcebir estrategias, sino también reconocer su surgimiento en cualquier otra parte de la organización e intervenir cuando sea necesario. ENFOQUES ANTERIORES Y ACTUALES SOBRE ESTRATEGIAS Innovación de Conceptos Como resumen de lo expuesto en las secciones anteriores y con el objeto de resaltar los principales aportes de Henry Mintzberg, se expone el siguiente cuadro comparativo: Concepto Enfoque Anterior Henry Mintzberg Definición de "Proceso racional a través del cual el estratega se abstrae del pasado para Estrategia situarse mentalmente en un estado futuro "La estrategia debe ser definida a través de deseado y desde esa posición tomar integración y complementariedad de sus la todas las decisiones necesarias en el presente acepciones: como Plan, como distintas para alcanzar dicho estado." Pauta, como Táctica, como Posición y como Perspectiva" Génesis de la Estrategia estrategias eficaces son formalmente "Las diseñadas a través de un proceso analítico que llevan a cabo los máximos "No se requiere que las estrategias sean responsables de la organización" deliberadas, es posible asimismo que, en mayor o menor medida, surjan" Pagina 1-8

- 9. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Cambio Incremental "El cambio debe implementarse en forma incremental y lineal. Debe atenderse "primero a lo primero", implementándose los cambios necesarios según su orden de importancia, uno por uno Cambio Fundamental Los líderes de la organización deben tener Cambio Organizacional "Ambos enfoques son efectivos, la clave es una visión clara del estado final que desean saber cómo y cuando promover el cambio. para todo el sistema, incluyendo La "teoría cuantitativa" señala que durante dimensiones tales como su negocio, su la mayor parte del tiempo se sigue una organización y sus maneras de trabajar. misma orientación estratégica signada por Esa visión debe actuar como fuerza el cambio "evolutivo", hasta que la integrante de una multitud de cambios organización pierde sincronización con el aparentemente dispares que hay que medio ambiente y se hace necesario un efectuar. El plan para hacer los cambios drástico viraje estratégico en el que se debe ser integrado alteran muchos de sus patrones. Este disturbio revolucionario provocó un "salto" hacia una nueva estabilidad" "De alguna forma, todos los niveles de la organización son estrategas" Ubicación del Estratega estrategias deben ser diseñadas por "Las los niveles superiores de la organización". Pagina 1-9

- 10. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Conocimientos de Informatica 1. Breve historia del desarrollo del computador 2. El computador 3. Organización física del computador (hardware) 4. El software INTRODUCCION La tecnología de la información y las comunicaciones ha logrado tan alto grado de desarrollo que hoy está en todas partes y, si no en todas, en la mayoría de las actividades del ser humano: en la educación, la industria, el comercio, las finanzas, la investigación, etc. Hoy en día, conocer la tecnología y utilizarla ya no constituye ningún privilegio, por el contrario, es una necesidad. El uso de la tecnología es un factor determinante en los niveles de eficiencia y competitividad tanto a nivel empresarial como personal. INFORMÁTICA: Es el tratamiento racional, automático y adecuado de la información, por medio del computador, para lo cual se diseñan y desarrollan estructuras y aplicaciones especiales buscando seguridad e integridad. En el contexto de la informática la información constituye un recurso de gran valor y se busca mantenerla y utilizarla de la mejor manera. BREVE HISTORIA DEL DESARROLLO DEL COMPUTADOR Se dice que el antecesor del computador fue el ábaco, del cual se cree que pudo haber tenido su origen hace cinco mil años y por su funcionalidad fue utilizado hasta mediados del siglo pasado en Oriente Medio y Asia como instrumento de cálculo. En nuestro medio, el ábaco, aún se utiliza en las salas de billar. Después del ábaco se hicieron múltiples intentos hasta lograr el computador como hoy lo conocemos. John Napier (1550-1617) un matemático inventó un dispositivo consistente en unos palillos con números impresos que mediante un ingenioso y complicado mecanismo le permitía realizar operaciones de multiplicación y división. Pagina 1-10

- 11. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Blaise Pascal (1.623-1.662), filósofo francés, en 1642 presentó una máquina que sumaba y restaba, ésta funcionaba con 8 ruedas giratorias, dos para los decimales y seis para los enteros y que podía manejar números entre 000.000 01 y 999.999 99. Leibnitz (1646-1716) en 1672 presentó una máquina que podía, además de sumar y restar, multiplicar, dividir y calcular la raíz cuadrada. Joseph Jacquard (1.752-1.834) utilizó un mecanismo de tarjetas perforadas para controlar el dibujo formado por los hilos de las telas confeccionadas por una máquina de tejer. Charles Babbage, matemático e inventor inglés, en 1822 diseñó su máquina diferencial para el cálculo de polinomios, que fue utilizada con éxito para el cálculo de tablas de navegación y artillería. Posteriormente trabajó en el diseño de una maquina de propósito general, que funcionaba con base en mecanismos de entrada y salida, memoria, unidad de control y unidad aritmético-lógica, como los computadores modernos. La máquina no se pudo construir mientras Babbage vivió. Herman Hollerith, inventó un sistema de computo automático para manipular los datos del censo de Estados Unidos en 1880, su máquina funcionaba con tarjetas perforadas en las que mediante agujeros se representaba el sexo, la edad, la raza etc. Ante las posibilidades comerciales de su máquina Hollerith dejó las oficinas del censo en 1896 para fundar su propia Compañía la Tabulating Machine Company. En 1900 había desarrollado una máquina que podía clasificar 300 tarjetas por minuto, una perforadora de tarjetas y una máquina de cómputo semiautomática. En 1924, fusionó su compañía con otras dos para formar la Internacional Bussines Machines hoy mundialmente conocida como IBM. En los años siguientes, se trabajó intensamente tratando de crear una máquina que permitiera la realización de cálculos automáticos y a gran velocidad. El 9 de Abril de 1943, John Mauchly y Lieutenant Herman Goidstine recibieron aprobación para adelantar un proyecto de construcción de la primera computadora, llamada ENIAC (Electronic Numerical integrator and Computer), aunque el presupuesto inicial fue de 150.000 dólares cuando la máquina estuvo terminada el costo total había sido de 486.804 dólares. En un test de prueba en febrero de 1946 ENIAC resolvió en 2 horas un problema de física nuclear que previamente habría requerido 100 años de trabajo de un hombre. Lo que caracterizaba al ENIAC como a los ordenadores modernos no era simplemente su velocidad de cálculo sino el hecho de que combinando operaciones permitía realizar tareas que antes eran imposibles. Entre 1939 y 1944 Howard Aiken de la universidad de Harvard en colaboración con IBM desarrolló el Mark 1 también conocido como calculador Automático de Secuencia Controlada. Este podía multiplicar tres números de 8 dígitos en 1 segundo y operaba con números de hasta 23 dígitos. En 1946 el matemático húngaro John Von Neumann propuso una versión modificada del Eniac a la que le llamó Edvac (Electronic Discrete Variable Automatic Computer) que se construyó en 1952. A diferencia con el ENIAC, esta maquina empleaba aritmética binaria, lo que simplificaba los circuitos electrónicos de cálculo, y trabajaba con programas almacenados Pagina 1-11

- 12. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde En 1953 IBM fabricó su primer computador para aplicaciones científicas el 701 y seguidamente 702 y el 705, este último fue un sistema revolucionario, el primero en emplear memorias de núcleos de ferrita. Con esta producción y mediante una adecuada estrategia comercial IBM tomo la delantera en las ventas de tecnología en todo el mundo. A partir de esta época se siguieron fabricando y comercializando computadores cada vez más sofisticados, evolucionando a tal grado la tecnología de la información, hasta convertirse en lo que es hoy en día. EL COMPUTADOR Es una maquina electrónica diseñada para la manipulación y procesamiento de datos de datos, capaz de desarrollar complejas operaciones a gran velocidad. Tareas que manualmente requieren días de trabajo, el computador puede hacerlas en solo fracciones de segundo. El computador es una máquina de propósito general, lo que significa que se utiliza en diversos campos de la actividad humana, solo por mencionar algunas, las finanzas, la investigación, edición de imágenes, edición de texto, cálculos matemáticos, administración de pequeñas y grandes bases de datos, entre muchos otros. Para lograr cumplir con sus funciones el computador requiere de dos partes principales, una que es física, tangible, la maquinaria, a la que técnicamente se le llama hardware y otra que es intangible, pero que está allí y hace que el computador funcione, está formada por los programas y toda la información, esta se llama software. Tanto el Hardware como el Software se clasifican según la función que desempeñan, como se puede apreciar en la gráfica siguiente: ORGANIZACIÓN FISICA DEL COMPUTADOR (HARDWARE) El computador, habiendo sido diseñado para el procesamiento de datos, su organización es similar a la de cualquier otro proceso. Indiferente de lo que se desee procesar, siempre se tendrán tres elementos importantes, la materia prima, la transformación que es el proceso en sí, y el producto final, es decir la materia prima transformada en un nuevo producto. Así, el computador está conformado por dispositivos de entrada, unidad central de procesamiento, dispositivos de salida y adicionalmente memoria externa o dispositivos de almacenamiento. Dispositivos de entrada Pagina 1-12

- 13. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Estos son, teclado, ratón, escáner, micrófono, entre muchos otros, todos ellos permiten entrar datos al sistema. Los datos son transformados en señales eléctricas y almacenados en la memoria central, donde permanecerán disponibles para ser procesados o almacenados en medios de almacenamiento permanente. Unidad central de procesamiento Comúnmente se la conoce como CPU, que significa Central Processing unit, ésta es quizá la parte más importante del computador, ya que en ella se encuentra la unidad de control y la unidad aritmético-lógica, las cuales en constante interacción con la memoria principal (también conocida como memoria interna) permiten manipular y procesar la información, y controlar los demás dispositivos de la unidad computacional. Memoria externa También se la conoce como memoria auxiliar, ésta es la encargada de brindar seguridad a la información almacenada, por cuanto guarda los datos de manera permanente e independiente de que el computador esté en funcionamiento, a diferencia de la memoria interna que solo mantiene la información mientras el equipo esté encendido. Los dispositivos de almacenamiento son discos y cintas principalmente, los discos pueden ser flexibles, duros u ópticos. Disco Magnético: es una superficie plana circular, puede ser plástica o metálica, recubierta con oxido de hierro. La superficie recubierta es magnetizada formando puntos microscópicos, cada uno de los cuales actúa como un pequeño imán permanente. Según la polarización de los puntos la señal puede indicar falso o verdadero, 0 o 1. Los puntos se disponen en forma de líneas concéntricas que reciben el nombre de pistas y se numeran desde 0 comenzando desde el exterior. Para poder establecer las direcciones en que se almacena la información, es necesario trazar líneas en sentido perpendicular a las pistas, estas se denominan sectores y dividen el disco en forma similar a como se cortan las rebanadas de un pastel. Cada sector tiene una dirección única en el disco. Pagina 1-13

- 14. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde El proceso de trazado de pistas y sectores en un disco se denomina formatear que equivale a preparar el disco para que pueda almacenar información de manera confiable. Discos flexibles: comúnmente están fabricados en material plástico y tienen la particularidad de que pueden ser introducidos y retirados de la unidad de disco o drive. Estos son muy útiles por cuando son pequeños y fáciles de portar sin embargo su capacidad de almacenamiento es pequeña y su velocidad de acceso es baja. Los discos flexibles más utilizados en el momento son los de 3.5 pulgadas que almacenan 1.44 megabytes. Los discos flexibles tienen la desventaja que pueden dañarse con facilidad, por ello es importante tener en cuenta algunos cuidados, como son: 1. No doblarlos, ni arquearlos 2. No presionarlos 3. No acercarlos a campos magnéticos Discos duros: a diferencia de los discos flexibles, estos están hechos generalmente de aluminio, giran a una velocidad 10 veces mayor y su capacidad de almacenamiento es muy grande (40 gigabytes). Un disco duro es un paquete herméticamente cerrado, conformado por varios discos o placas, sus respectivas cabezas de lectura/escritura y la unidad de disco. El disco duro constituye el medio de almacenamiento más importante de un computador, ya que en la actualidad, por los volúmenes de información que se maneja, es muy difícil trabajar sin éste. CD-ROM: disco compacto de solo lectura. Estos discos forman parte de la nueva tecnología para el almacenamiento de información. Esta tecnología consiste en almacenar la información en forma de pozos y planos microscópicos que se forman en la superficie del disco. Un haz de un pequeño láser en el reproductor de CD-ROM ilumina la superficie y refleja la información almacenada. Un disco compacto de datos, en la actualidad, almacena 650 y 700 megabytes de información. Dispositivos de salida Permiten presentar los resultados del procesamiento de datos, son el medio por el cual el computador presenta información a los usuarios. Los más comunes son la pantalla y la impresora. Pantalla o monitor: exhibe las imágenes que elabora de acuerdo con el programa o proceso que se esté ejecutando, puede ser videos, gráficos, fotografías o texto. Es la salida por defecto donde se presentan los mensajes generados por el computador, como errores, solicitud de datos, etc. Hay dos grandes clasificaciones de los monitores: los monocromáticos que presentan la información en gama de grises y lo policromáticos o monitores a color que pueden utilizar Pagina 1-14

- 15. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde desde 16 colores hasta colores reales. Los monocromáticos son cada vez menos usados, sin embargo aun quedan muchos de este tipo en el mercado. En los monitores de color existen dos tipos, los VGA y los SVGA (superVGA). Estas características determinan la cantidad de colores que pueden reproducir y la resolución o nitidez. Toda pantalla está formada por puntos de luz llamados pixeles que se iluminan para dar forma a las imágenes y a los caracteres. Cuantos más pixeles tenga una pantalla mejor es su resolución, por eso se habla de pantallas de 640 x 480, de 600x800 y de 1280 x 1024, siendo las últimas las de mayor nitidez. La distancia existente entre los puntos se conoce como dot pitch y es inversamente proporcional a la resolución de la pantalla, entre menor sea la distancia entre puntos, mejor es la imagen. En el mercado se escucha ofertas de equipos con pantalla superVGA punto 28, esto significa que la pantalla es de tipo SPVGA y que la distancia entre puntos es de 0.28 mm. Impresora: fija sobre el papel la información que se tiene en pantalla, en archivo o el resultado de un proceso. La impresión puede ser en negro o en colores según el tipo de impresora que se tenga. Hay tres grupos de impresoras: las de matriz de puntos, las de burbuja y las laser. Las primeras son las más antiguas, son ruidosas y lentas, pero muy resistentes y económicas. Se llaman de matriz de puntos porque forman los caracteres mediante puntos marcados por los pines del cabezote. Hasta hace poco eran muy económicas, pero en la actualidad, algunas series, son mucho más costosas que las impresoras de otros tipos. Las impresoras de burbuja, también se llaman de inyección de tinta, estas son silenciosas e imprimen hasta cinco páginas por minuto, la calidad de impresión es muy buena, el costo de la impresora es moderado, sin embargo el costo de la impresión es alto. No son recomendables para trabajo pesado. Las impresoras láser trabajan como una fotocopiadora y producen imágenes de optima calidad, tienen un bajo nivel de ruido y son las más rápidas, las impresoras son costosas pero la impresión es económica. Son recomendables para trabajos gráficos profesionales. Hasta el momento se ha centrado la atención en la parte física del computador, ahora se presenta la parte intangible, que al igual que la anterior, también está clasificada según la función que realiza. EL SOFTWARE Como se anotó anteriormente, está conformado por toda la información, ya sean instrucciones o datos, que hacen que el computador funcione, sin el concurso de éste el hardware no realizar ninguna función. El software está clasificado en cuatro grupos, según la tarea que realiza. Pagina 1-15

- 16. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde SISTEMA OPERATIVO Es un conjunto de programas indispensable para que el computador funcione. Estos se encargan de administrar todos los recursos de la unidad computacional y facilitan la comunicación con el usuario. El sistema operativo cuenta con programas especializados para diversas tareas, como son la puesta en marcha del equipo, la interpretación de comandos, el manejo de entrada y salida de información a través de los periféricos, acceso a discos, procesamiento de interrupciones, administración de memoria y procesador, entre otros. Algunos sistemas operativos conocidos son Windows, con versiones 95, 98, 2000, Mileniun y NT; DOS; Netware; Unix, Linux, entre otros. SOFTWARE DE APLICACIÓN Es un conjunto de programas diferente al software del sistema, éstos se encargan de manipular la información que el usuario necesita procesar, son programas que desarrollan una tarea específica y cuya finalidad es permitirle al usuario realizar su trabajo con facilidad, rapidez, agilidad y precisión. Entre el software de aplicación se tiene varios grupos, como son: procesadores de texto, hoja electrónica, graficadores, bases de datos, agendas, programas de contabilidad, aplicaciones matemáticas, entre otros, algunos ejemplos son: Word, Excel, Acces, Corel.Draw, Foxpro, Trident, etc LENGUAJES DE PROGRAMACION En términos coloquiales, son programas que sirven para crear otros programas. Al igual que el lenguaje natural constan de sintaxis, semántica y vocabulario que el computador puede entender y procesar. Los lenguajes de programación se clasifican en tres categorías: lenguaje de máquina, lenguaje de bajo nivel y lenguaje de alto nivel. En la actualidad se utilizan los últimos, cuyo vocabulario está formado por términos en inglés, como son: C++, Foxpro, Visual Basic, Java, HTML. DATOS Esta categoría está conformada por toda la información que el usuario introduce y procesa en el sistema, por ejemplo la información almacenada en las bases de datos, los textos y gráficos. Pagina 1-16

- 17. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Las Redes Informáticas 1. Resumen 2. Introducción 3. ¿Qué es una red informática? 4. Breve reseña sobre la evolución de las redes 5. Estructura de las redes 6. Tipos de redes 7. Topologías de redes 8. Protocolo de redes 9. Servicios de una Red 10. Conclusiones Resumen Este curso sintetizadamente, aborda algunos aspectos acerca de las redes Informáticas. Por tal motivo, primeramente se define qué es una red desde un punto de vista informático y se muestra una breve reseña sobre la evolución de las mismas. De igual modo, se analiza la estructura de las redes, los tipos en que se agrupan y las topologías que las caracteriza según la distribución geométrica de sus estaciones de trabajo. También se hace referencia a los protocolos que se utilizan para la configuración de estas estructuras así como los servicios que prestan las mismas. Finalmente aparece un glosario con algunos términos que pudieran esclarecer al cursante. Introducción El desarrollo del hombre desde el nivel físico de su evolución, pasando por su crecimiento en las áreas sociales y científicas hasta llegar a la era moderna se ha visto apoyado por herramientas que extendieron su funcionalidad y poder como ser viviente. Sintiéndose conciente de su habilidad creativa, metódicamente elaboró procedimientos para organizar su conocimiento, sus recursos y manipular su entorno para su comodidad, impulsando las ciencias y mejorando su nivel de vida a costa de sacrificar el desarrollo natural de su ambiente, produciendo así todos los adelantos que un gran sector de la población conoce: automóviles, aeroplanos, trasatlánticos, teléfonos, televisiones, etc. En el transcurso de todo este desarrollo, también evolucionó dentro del sector tecnológico el cómputo electrónico. Este nació con los primeros ordenadores en la década de los años 40, porque la necesidad del momento era extender la rapidez del cerebro humano para realizar algunos cálculos aritméticos y procedimientos repetitivos. Este esfuerzo para continuar avanzando, se reflejó en crear unidades de procesamiento cada vez más veloces, divididas en cuatro generaciones bien definidas: la primera con tubos al vacío, la segunda con transistores, la tercera con circuitos integrados y la cuarta con circuitos integrados que permitieron el uso de computadoras personales y el desarrollo de las redes de datos. Pagina 1-17

- 18. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Este último elemento, las redes de ordenadores, consisten en "compartir recursos", y uno de sus objetivos principales es hacer que todos los programas, datos y hasta los propios equipos estén disponibles para cualquier usuario que así lo solicite, sin importar la localización física del recurso y del propio usuario. Desarrollo ¿Qué es una red informática? Una red es un sistema donde los elementos que lo componen (por lo general ordenadores) son autónomos y están conectados entre sí por medios físicos y/o lógicos y que pueden comunicarse para compartir recursos. Independientemente a esto, definir el concepto de red implica diferenciar entre el concepto de red física y red de comunicación. Respecto a la estructura física, los modos de conexión física, los flujos de datos, etc; una red la constituyen dos o más ordenadores que comparten determinados recursos, sea hardware (impresoras, sistemas de almacenamiento...) o sea software (aplicaciones, archivos, datos...). Desde una perspectiva más comunicativa, podemos decir que existe una red cuando se encuentran involucrados un componente humano que comunica, un componente tecnológico (ordenadores, televisión, telecomunicaciones) y un componente administrativo (institución o instituciones que mantienen los servicios). En fin, una red, más que varios ordenadores conectados, la constituyen varias personas que solicitan, proporcionan e intercambian experiencias e informaciones a través de sistemas de comunicación. Breve reseña sobre la evolución de las redes Los primeros enlaces entre ordenadores se caracterizaron por realizarse entre equipos que utilizaban idénticos sistemas operativos soportados por similar hardware y empleaban líneas de transmisión exclusivas para enlazar sólo dos elementos de la red. En 1964 el Departamento de Defensa de los EE.UU. pide a la agencia DARPA (Defense Advanced Research Proyects Agency) la realización de investigaciones con el objetivo de lograr una red de ordenadores capaz de resistir un ataque nuclear. Para el desarrollo de esta investigación se partió de la idea de enlazar equipos ubicados en lugares geográficos distantes, utilizando como medio de transmisión la red telefónica existente en el país y una tecnología que había surgido recientemente en Europa con el nombre de Conmutación de Paquetes. Ya en 1969 surge la primera red experimental ARPANET, en 1971 esta red la integraban 15 universidades, el MIT; y la NASA; y al otro año existían 40 sitios diferentes conectados que intercambiaban mensajes entre usuarios individuales, permitían el control de un ordenador de forma remota y el envío de largos ficheros de textos o de datos. Durante 1973 ARPANET desborda las fronteras de los EE.UU. al establecer conexiones internacionales con la "University College of London" de Inglaterra y el "Royal Radar Establishment" de Noruega. En esta etapa inicial de las redes, la velocidad de transmisión de información entre los ordenadores era lenta y sufrían frecuentes interrupciones. Ya avanzada la década del 70, DARPA, le encarga a la Universidad de Stanford la elaboración de protocolos que permitieran la transferencia de datos a mayor velocidad y entre diferentes tipos de redes de ordenadores. En este contexto es que Vinton G. Cerf, Robert E. Kahn, y un grupo de sus estudiantes desarrollan los protocolos TCP/IP. Pagina 1-18

- 19. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde En 1982 estos protocolos fueron adoptados como estándar para todos los ordenadores conectados a ARPANET, lo que hizo posible el surgimiento de la red universal que existe en la actualidad bajo el nombre de Internet. En la década de 1980 esta red de redes conocida como la Internet fue creciendo y desarrollándose debido a que con el paso del tiempo cientos y miles de usuarios, fueron conectando sus ordenadores. Estructura de las redes Las redes tienen tres niveles de componentes: software de aplicaciones, software de red y hardware de red. El Software de Aplicaciones, programas que se comunican con los usuarios de la red y permiten compartir información (como archivos, gráficos o vídeos) y recursos (como impresoras o unidades de disco). El software de Red, programas que establecen protocolos para que los ordenadores se comuniquen entre sí. Dichos protocolos se aplican enviando y recibiendo grupos de datos formateados denominados paquetes. El Hardware de Red, formado por los componentes materiales que unen los ordenadores. Dos componentes importantes son los medios de transmisión que transportan las señales de los ordenadores (típicamente cables o fibras ópticas) y el adaptador de red, que permite acceder al medio material que conecta a los ordenadores, recibir paquetes desde el software de red y transmitir instrucciones y peticiones a otros ordenadores. En resumen, las redes están formadas por conexiones entre grupos de ordenadores y dispositivos asociados que permiten a los usuarios la transferencia electrónica de información. En estas estructuras, los diferentes ordenadores se denominan estaciones de trabajo y se comunican entre sí a través de un cable o línea telefónica conectada a los servidores. Dichos servidores son ordenadores como las estaciones de trabajo pero con funciones administrativas y están dedicados en exclusiva a supervisar y controlar el acceso a la red y a los recursos compartidos. Además de los ordenadores, los cables o la línea telefónica, existe en la red el módem para permitir la transferencia de información convirtiendo las señales digitales a analógicas y viceversa, también existen en esta estructura los llamados Hubs y Switches con la función de llevar acabo la conectividad. Tipos de Redes Las redes según sea la utilización por parte de los usuarios pueden ser: Redes Compartidas, aquellas a las que se une un gran número de usuarios, compartiendo todas las necesidades de transmisión e incluso con transmisiones de otra naturaleza. Pagina 1-19

- 20. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Redes exclusivas, aquellas que por motivo de seguridad, velocidad o ausencia de otro tipo de red, conectan dos o más puntos de forma exclusiva. Este tipo de red puede estructurarse en redes punto a punto o redes multipunto. Otro tipo se analiza en cuanto a la propiedad a la que pertenezcan dichas estructuras, en este caso se clasifican en: Redes privadas, aquellas que son gestionadas por personas particulares, empresa u organizaciones de índole privado, en este tipo de red solo tienen acceso los terminales de los propietarios. Redes públicas, aquellas que pertenecen a organismos estatales y se encuentran abiertas a cualquier usuario que lo solicite mediante el correspondiente contrato. Otra clasificación, la más conocida, es según la cobertura del servicio en este caso pueden ser: Redes LAN (Local Area Network), redes MAN (Metropolitan Area Network), redes WAN (Wide Area Network), redes internet y las redes inalámbricas. Topologías de Red Cuando se menciona la topología de redes, se hace referencia a la forma geométrica en que están distribuidas las estaciones de trabajo y los cables que las conectan. Su objetivo es buscar la forma más económica y eficaz de conexión para, al mismo tiempo, aumentar la fiabilidad del sistema, evitar los tiempos de espera en la transmisión, permitir un mejor control de la red y lograr de forma eficiente el aumento del número de las estaciones de trabajo. Dentro de las topologías que existen, las más comunes son: Pagina 1-20

- 21. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Aunque no son las más comunes también existen otras topologías generadas por las combinaciones entre las ya mencionadas anteriormente como es el caso de: Protocolo de Redes Los protocolo de red son una o más normas standard que especifican el método para enviar y recibir datos entre varios ordenadores. Su instalación esta en correspondencia con el tipo de red y el sistema operativo que la computadora tenga instalado. No existe un único protocolo de red, y es posible que en un mismo ordenador coexistan instalados varios de ellos, pues cabe la posibilidad que un mismo ordenador pertenezca a redes distintas. La variedad de protocolos puede suponer un riesgo de seguridad: cada protocolo de red que se instala en un sistema queda disponible para todos los adaptadores de red existentes en dicho sistema, físicos (tarjetas de red o módem) o lógicos (adaptadores VPN). Si los dispositivos de red o protocolos no están correctamente configurados, se puede dar acceso no deseado a los recursos de la red. En estos casos, la regla de seguridad más sencilla es tener instalados el número de protocolos indispensable; en la actualidad y en la mayoría de los casos debería bastar con sólo TCP/IP. Dentro de la familia de protocolos se pueden distinguir Pagina 1-21

- 22. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Protocolos de transporte: ATP (Apple Talk Transaction Protocol) NetBios/NetBEUI TCP (Transmission Control Protocol) Protocolos de red: DDP (Delivery Datagram Protocol) IP (Internet Protocol) IPX (Internet Packed Exchange) NetBEUI Desarrollado por IBM y Microsoft. Protocolos de aplicación: AFP (Appletalk File Protocol) FTP (File Transfer Protocol) Http (Hyper Text transfer Protocol) Dentro de los protocolos antes mencionados, los más utilizados son: IPX/SPX, protocolos desarrollados por Novell a principios de los años 80 los cuales sirven de interfaz entre el sistema operativo de red Netware y las distintas arquitecturas de red. El protocolo IPX es similar a IP, SPX es similar a TCP por lo tanto juntos proporcionan servicios de conexión similares a TCP/IP. NETBEUI/NETBIOS (Network Basic Extended User Interface / Network Basic Input/Output System) NETBIOS es un protocolo de comunicación entre ordenadores que comprende tres servicios (servicio de nombres, servicio de paquetes y servicio de sesión, inicialmente trabajaba sobre el protocolo NETBEUI, responsable del transporte de datos. Actualmente con la difusión de Internet, los sistemas operativos de Microsoft más recientes permiten ejecutar NETBIOS sobre el protocolo TCP/IP, prescindiendo entonces de NETBEUI. APPLE TALK es un protocolo propietario que se utiliza para conectar computadoras Macintosh de Apple en redes locales. TCP/IP (Transmission Control Protocol/Internet Protocol) este protocolo fue diseñado a finales de los años 60, permite enlazar computadoras con diferentes sistemas operativos. Es el protocolo que utiliza la red de redes Internet. Servicios de una Red Para que el trabajo de una red sea efectivo, debe prestar una serie de servicios a sus usuarios, como son: 1. Acceso, este servicios de acceso a la red comprenden tanto la verificación de la identidad del usuario para determinar cuales son los recursos de la misma que puede utilizar, como servicios para permitir la conexión de usuarios de la red desde lugares remotos. Pagina 1-22

- 23. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde 2. Ficheros, el servicio de ficheros consiste en ofrecer a la red grandes capacidades de almacenamiento para descargar o eliminar los discos de las estaciones. Esto permite almacenar tanto aplicaciones como datos en el servidor, reduciendo los requerimientos de las estaciones. Los ficheros deben ser cargados en las estaciones para su uso. 3. Impresión, este servicio permite compartir impresoras entre múltiples usuarios, reduciendo así el gasto. En estos casos, existen equipos servidores con capacidad para almacenar los trabajos en espera de impresión. Una variedad de servicio de impresión es la disponibilidad de servidores de fax. 4. Correo, el correo electrónico, aplicación de red más utilizada que ha permitido claras mejoras en la comunicación frente a otros sistemas. Este servicio además de la comodidad, ha reducido los costos en la transmisión de información y la rapidez de entrega de la misma. 5. Información, los servidores de información pueden bien servir ficheros en función de sus contenidos como pueden ser los documentos hipertexto, como es el caso de esta presentación. O bien, pueden servir información dispuesta para su proceso por las aplicaciones, como es el caso de los servidores de bases de datos. 6. Otros, generalmente existen en las redes más modernas que poseen gran capacidad de transmisión, en ellas se permite transferir contenidos diferentes de los datos, como pueden ser imágenes o sonidos, lo cual permite aplicaciones como: estaciones integradas (voz y datos), telefonía integrada, servidores de imágenes, videoconferencia de sobremesa, etc. Conclusiones Según el estudio realizado para la confección de este trabajo y analizando cada uno de los aspectos necesarios para el uso de las redes informáticas podemos concluir que: Una red de ordenadores posibilita: 1. Mayor facilidad en la comunicación entre usuarios. 2. Reducción en el presupuesto para software y hardware. 3. Organización de los grupos de trabajo que la conforman. 4. Mejoras en la administración de los equipos y programas. 5. Mejoras en la integridad de los datos. 6. Mayor seguridad para acceder a la información. DESCRIPCION DEL SISTEMA DE PERCEPCIÓN OPERATIVA Elementos y características del Sistema de Percepción Operativa. Pagina 1-23

- 24. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde ESTRATEGIA LATENCIA CERO CONFLICTO 1. “SCANNEAR” EL 2. GENERAR AMBIENTE ALTERNATIVAS CONFLICTO Estrategia Latencia Cero 5. CONTROLAR 4. APLICAR 3. ELEGIR CONFLICTO a) Las corrientes de entrada. El funcionamiento de los sistemas requiere importar ciertos recursos del medio. Por ejemplo, el hombre requiere oxígeno, alimento, etc. Con el fin de utilizar un término que comprenda todos estos insumos, podemos emplear el concepto “energía”. Por lo tanto, los sistemas, a través de su corriente de entrada, reciben la energía necesaria para su funcionamiento y mantención. En una negociación se entenderá, por ejemplo, que la corriente de entrada son los mensajes que emita una de las partes a otra. b) Proceso de conversión. ¿Hacia dónde va esa energía? La energía que importan los sistemas sirve para mover y hacer actuar sus mecanismos particulares con el fin de alcanzar los objetivos para los cuales fueron diseñados. En otras palabras, los sistemas convierten o transforman la energía (en sus diferentes formas) que importan en otro tipo de energía, que representa la producción característica del sistema particular. En la negociación, de acuerdo a la teoría de la comunicación, entenderíamos ese proceso de conversión como la decodificación del mensaje y la integración del mismo dentro del marco de referencia del receptor. c) Corriente de salida. La corriente de salida equivale a la “exportación” que el sistema hace al medio. En general, podemos dividir estas corrientes de salida como positivas y negativas para el medio y entorno, entendiéndose aquí por medio todos aquellos otros sistemas (o supersistemas) que utilizan de una forma u otra la energía que exporta ese sistema. En general, podríamos decir que la corriente de salida es positiva cuando es “útil” a la comunidad y negativa en el caso contrario. En la negociación, cuando la respuesta al mensaje es "útil" para estabilizar el sistema y puede sostenerse. En ese sentido, no nos olvidemos que las partes negociadoras vienen a conformar un sistema, cuyo resultado dependerá si se mantiene o si se destruye. Paradojalmente, el objetivo del sistema "negociador" es destruir solidariamente o mancomunadamente el sistema, es decir, las partes negocian para no tener que encontrarse más en situación de conflicto. Sin embargo, el objetivo es destruir el sistema de tal manera que ambas partes estén satisfechas de haberlo destruido. Cuando Pagina 1-24

- 25. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde sólo una de las partes queda satisfecha, no se ha producido una negociación, se ha producido un quiebre de voluntad o una imposición de poder, simplemente. Cuando en un sistema particular, de acuerdo con los valores de un individuo o de una comunidad, la corriente de salida positiva es muy superior a la corriente de salida negativa, es probable que ese sistema cuente con la “legalización” de su existencia por parte del individuo y de la sociedad, en general. Esta legalización del sistema, o mejor dicho de su corriente de salida, es vital, entonces, para la misma existencia del sistema. Dada la gran dependencia que tiene del medio (especialmente los sistemas sociales), la actividad positiva o negativa de ese medio hacia el sistema será el factor más importante para determinar la continuación de su existencia o su desaparición. Podemos entonces hablar de “sistema viable” como aquel que sobrevive, es decir, que es legalizado por el medio y se adapta a él y a sus exigencias, de modo que con su exportación de corrientes positivas de salida al medio, esté en condiciones de adquirir en ese mismo medio sus corrientes de entrada (o la energía necesaria para el continuo desarrollo de su función de transformación). Sin embargo, el concepto de viabilidad es más amplio. Stafford Beer define a un sistema viable como aquel que es capaz de adaptarse a las variaciones de un medio en cambio. Para que esto pueda ocurrir, el sistema debe poseer tres características básicas: Ser capaz de autoorganizarse, es decir, mantener una estructura permanente y modificarla de acuerdo a las exigencias; Ser capaz de autocontrolarse, es decir, mantener sus principales variables dentro de ciertos límites que forman un área de normalidad y finalmente; Poseer un cierto grado de autonomía; es decir, poseer un suficiente nivel de libertad determinado por sus recursos para mantener esas variables dentro de su área de normalidad. Algunos autores han denominado “ciclo de actividad” a esta relación entre corriente de salida y corriente de entrada, es decir, al proceso mediante el cual la corriente de salida regenera la corriente de entrada del sistema. Este "ciclo de actividad" es básico en el proceso de negociación, donde los mensajes del emisor que se traducen en ofertas, serán decodificadas por el receptor, quien a su vez responderá con concesiones o con contraofertas. Estas contraofertas serán decodificadas por el emisor (ahora receptor) para realizar concesiones o nuevas ofertas frente a la contraoferta del receptor (ahora emisor). Como se puede observar, el ciclo comienza a fluir. d) La comunicación de retroalimentación. Recordemos nuevamente, que todo sistema tiene algún propósito y la conducta que desarrolla, una vez que dispone de la energía suficiente, prevista por sus corrientes de entrada, tiende a alcanzar ese propósito u objetivo. La pregunta que tenemos en mente es ¿cómo sabe el sistema cuándo ha alcanzado su objetivo? O ¿cuándo existe diferencia entre la conducta que desarrolla para lograr el objetivo y el objetivo mismo? A esa información que llega a través de mi vista y que muestra el resultado que se está obteniendo con la acción que estoy desarrollando y que llega al cerebro para ser allí interpretada es lo que se denomina “comunicación de retroalimentación” o “feedback”. Así, la comunicación de retroalimentación es la información que indica cómo lo está haciendo el sistema en la búsqueda de su objetivo, y que es introducido nuevamente al Pagina 1-25

- 26. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde sistema con el fin de que se lleven a cabo las correcciones necesarias para lograr su objetivo (retroalimentación). Desde este punto de vista, es un mecanismo de control que posee el sistema para asegurar el logro de su meta. e) El enfoque corriente de entrada y salida o “enfoque de flujos”. El enfoque “corriente de entrada - corriente de salida” (input – output), aplicado a la teoría de sistemas, identifica a un sistema como una entidad reconocible a la cual llegan diferentes corrientes de entrada (con numerosos tipos de recursos) y de la cual salen una o varias corrientes de salida bajo la forma de algún producto (bienes o servicios). Desde este punto de vista, el sistema propiamente tal se considera como una “caja negra”, considerándose sólo las interacciones (llegadas o salidas). En este caso, sólo nos limitamos a preguntar cuáles son las corrientes de entrada y qué corrientes de salida produce. No nos preocupemos por lo que sucede dentro del sistema, es decir, por la forma en que operan los mecanismos y procesos internos del sistema y mediante los cuales se producen esas corrientes de salida, a menos que en un momento dado nos interese alguna de ellas. En ese caso procedemos a abrir la caja. Este enfoque produce la ventaja de identificar claramente los sistemas y subsistemas y estudiar las relaciones que existen entre ellos, permitiendo así maximizar la eficiencia de estas relaciones sin tener que introducirnos en los procesos complejos que se encuentran encerrados en esas cajas negras. Evidentemente, cuando algún subsistema presenta problemas, es decir, cuando las relaciones entre las corrientes de entrada y las de salida presentan anomalías, entonces, y sólo entonces nos vemos obligados a destapar la caja negra y estudiar ese sistema en forma más precisa. Otra ventaja de este enfoque, especialmente en los sistemas empresas industriales, es que permite identificar en forma bastante simple la existencia de los “cuellos de botellas”, es decir, subsistemas que limitan la acción del sistema para alcanzar sus objetivos. También permite descubrir aquellos subsistemas que son críticos. Común denominador de perspectivas múltiples. Entropia y Neguentropia. La entropía es un concepto que proviene de la física y deriva de la segunda ley de la termodinámica. Según esta ley, los sistemas en general tienen la tendencia a alcanzar su estado más probable, es decir, existe una tendencia natural de los cuerpos a pasar de distribuciones menos probables a otras más probables. Ahora bien, en el mundo de la física, el estado más probable de esos sistemas es el caos, el desorden y la desorganización. La ley de la entropía indica que ésta es creciente, es decir, la entropía va en aumento. Los sistemas pasan por diferentes estados, cada vez más desordenados y más caóticos. Sin embargo, la simple observación del transcurso histórico de numerosos sistemas, parece contradecir este aspecto de la ley de entropía siempre creciente. Por ejemplo, la Iglesia Católica al cabo de dos mil años de existencia no parece indicar un grado de desorganización ni de caos. En numerosos casos, los sistemas mantienen su ordenamiento a través del tiempo. Aún se presentan otros casos en que los sistemas parecen organizarse más a medida que pasan de un estado a otro. Sin embargo, esta contradicción o violación de la ley de la entropía es más aparente que real. Si observamos los sistemas que “violan” la ley, podemos concluir que ellos poseen una importante característica en común. Todos son sistemas vivos y, más general aún, son todos sistemas abiertos. En el mundo físico no existe creación de neguentropía o entropía negativa. En otras palabras, dentro de los sistemas cerrados, se observa un desarrollo siempre creciente de Pagina 1-26

- 27. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde la entropía. Cualquier objeto físico, por muy resistente que pueda aparecer, se encuentra sometido al desgaste del tiempo y su fin es inexorable. Si usted deja un dormitorio cerrado, sin que entre aire ni iluminación, al cabo de un mes, se dará cuenta del efecto que produce la entropía. Si este cuarto lo deja en ese estado por cincuenta años, el resultado será aún más evidente. Un organismo viviente continuamente incrementa su entropía y, por lo tanto, tiende a aproximarse al peligroso estado de entropía máxima, que significa la muerte. Sólo puede mantenerse alejado de ella, es decir, vivo, si continuamente está extrayendo de su medio entropía negativa (que es algo muy positivo, como veremos). Un organismo se alimenta de entropía negativa o, colocándolo de una manera menos paradójica, lo esencial en el metabolismo es que el organismo tiene éxito en liberarse de toda la entropía que no le ayuda a permanecer vivo. En otras palabras, el organismo se alimenta de entropía negativa atrayéndola hacia él para compensar el incremento de entropía que produce al vivir y manteniéndose así, dentro de un estado estacionario con un nivel relativamente bajo de entropía. La expresión “entropía negativa” (neguentropía) es en sí una medida de orden. De este modo, el mecanismo mediante el cual el organismo se mantiene estacionario y a un nivel bastante alto de ordenamiento, es decir, a un nivel bajo de entropía, realmente consiste en agregar continuamente orden y organización de su medio. Así, los sistemas abiertos al extraer orden del medio y reemplazar con el orden producido por sus procesos vitales, rompen la ley inexorable que ataca a los sistemas: la entropía creciente. Podemos, entonces, establecer claramente una nueva distinción entre sistema cerrado y sistema abierto. El sistema cerrado tiene una vida contada, sucumbe ante la entropía creciente. El sistema abierto presenta características tales (interacción con su medio e importación de entropía negativa u orden) que está en condiciones de subsistir y aún de eliminar la ley de entropía. Un sistema abierto puede presentarse como aquel que importa energía (corriente de entrada), transforma esa energía (proceso de transformación) y luego exporta al medio esa nueva energía. Con el producto de esa exportación, el sistema está en condiciones de obtener nuevamente sus corrientes de entrada necesarias para llevar a cabo el proceso de transformación que lo caracteriza y diferencia del resto de los sistemas. Desde el punto de vista de un sistema jerarquizado, podemos señalar que el máximo desorden (o máxima entropía) se produce cuando se llega a un estado tal en que todos los elementos del sistema poseen una misma jerarquía. Trasladando estos conceptos a elementos mensurables en un escenario posible tenemos 1.- Los contratos existentes entre las partes en conflicto. 2.- Recursos materiales, financieros y humanos de las empresas o actores en conflicto. 3.- Información acerca de los elementos de entrada del sistema antes de fracasar, congestionar o desintegrarse (por ejemplo, de qué manera interactuaba una empresa de servicios con su cliente antes de la crisis, ruptura, o cesación de pagos...). ¿Cómo se puede combatir la entropía? Se debe interactuar con el medio. Adaptarse a las circunstancias externas que tienden a desarmonizar el sistema. Sin embargo, para llevar a cabo todas estas acciones es necesario disponer de energía (recursos). Si toda la energía que trae la corriente de entrada es destinada una función específica, evidentemente que no dispondremos de energía adicional para otras actividades. Pero si la energía generada por la corriente de salida es mayor que la Pagina 1-27

- 28. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde necesaria para adquirir la corriente de entrada destinada al proceso de transformación, entonces sí que se puede obtener energía adicional. Es este saldo el que se utiliza para combatir la entropía. En otras palabras, así se genera la neguentropía o entropía negativa. IMPORTANCIA DE LO SUBJETIVO EN EL MODELO LEAR Selección de datos por creencia Desde el Modelo de Negociación LEAR Sistema de Percepción Operativa es de fundamental importancia el estado de ánimo, de ello dependerán, quizás, importantes decisiones, y el negociador LEAR deberá estar muy atento a esta circunstancia, pues ella hará que la percepción del actor se modifique. Puede ser que las personas con las que se negocia presenten diferentes estados de ánimo en distintos momentos del proceso. Si bien algunas veces y en forma premeditada, alzar la voz y mostrar que también pueden ponerse límites tiene algún resultado favorable, no conviene como regla general, escalar en la agresividad verbal y mucho menos entrar en la emoción. Sin embargo, en otros estados de ánimo, como la depresión o la preocupación, acompasar puede ser el primer paso recomendado para cambiarlos. Pocas cosas causan más efecto negativo a una persona que está deprimida o preocupada que decirle eufóricamente que no hay motivo alguno para su estado de ánimo, por cuanto descalificar su emoción, se le presenta como alguien que no tiene un manejo mesurado de sus sentimientos. Como hemos visto, es definitivo prestar atención a la complejidad de los procesos que se desarrollan durante el transcurso de la negociación. La negociación no es una expresión de deseo, no es un acto voluntarista, no es un proceso lineal, se trata de un proceso complejo, para expertos y requiere de habilidad, formación, creatividad y entendemos que para lograr un resultado adecuado deben estar presente los cuatro principios Liderazgo, Efectividad, Alternativas, Rentabilidad. La simplicidad del Modelo de Negociación LEAR Sistema de Percepción Operativa exige una visión orgánica del conflicto. El principio de organicidad. El universo puede ser representado como un sistema o como una colección de muchos sistemas (subsistemas) que de una forma u otra actúan y se interrelacionan unos con otros dentro de una realidad dinámica. Existe entre ellos un continuo intercambio de energía y se llevan a cabo millares de procesos de conversión. Fuerzas van y vienen. A las acciones se suceden las reacciones que no sólo afectan al sistema sobre el cual se ejecuta la fuerza sino que también sobre el sistema que la aplica y, más aún, sobre otros que, aparentemente, nada parecían tener que ver con aquel sistema que reacciona. Sin embargo, a pesar de toda esta enorme dinámica de fuerza, de acciones y reacciones entre los diferentes sistemas, no existe un caos, sino un cierto orden y equilibrio que dan más una impresión de avance suave que de cambios y avances pronunciados. Este fenómeno, es decir, la acción equilibrada de la totalidad frente a la gran variabilidad que experimentan sus partes puede ser explicado a partir de dos concepciones diferentes. Una de ellas es el aparente equilibrio del sistema según la mecánica newtoniana y la otra es la teoría general de sistemas, especialmente desde el punto de vista de la cibernética. Pagina 1-28

- 29. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde a) La explicación newtoniana. A cada acción sigue una reacción igual: la acción mutua de dos cuerpos, del uno sobre el otro es siempre igual y en dirección opuesta. Cuando uno tira o empuja un cuerpo, también es tirado o empujado por ese objeto con una fuerza equivalente. Cuando presionamos una piedra con el dedo, el dedo es presionado por la piedra con una fuerza igual. Esta ley de Newton ha dado origen al principio de acción-reacción que señala que cada acción se encuentra acompañada por una o más reacciones, este principio es más conocido como causa – efecto. Por lo tanto, si bien es cierto que los diferentes subsistemas terrestres se mantienen en continuo movimiento, los cambios que se producen entre los subsistemas se cancelan unos con otros, permaneciendo así el sistema total (la Tierra) en equilibrio. b) La explicación de la Teoría General de Sistemas Su aplicación al Modelo de Percepción Operativa. Lazslo plantea una definición de sinergia desde el punto de vista de la variabilidad del sistema total con relación a la variabilidad de sus partes. Significa que un objeto es un sistema cuando la variabilidad que experimenta la totalidad es menor que la suma de las variabilidades de cada una de sus partes o componentes. Se puede observar que existe una gran variabilidad en el medio y una constancia en el cuerpo. El mecanismo que permite que esto suceda es el denominado “homeóstato” (derivado de homeostasis). Ahora, si unimos los dos conceptos que hemos desarrollado, la variabilidad de los subsistemas y la variabilidad del medio, podemos comprender el equilibrio que puede mostrar un sistema. En efecto, frente a los cambios externos que se producen en su medio, el sistema, provisto de los homeóstatos necesarios, aminora esos impactos, desarrollando programas preestablecidos que tienden a hacer posible una serie de reacciones internas del sistema que lo defienden de las variaciones del medio. Por otra parte, el principio de la sinergia tiende a nivelar los cambios internos que sufren los subsistemas. Todo esto hace que el sistema tenga la propiedad de autocontrol y de autorregulación que lo lleva hacia un equilibrio homeostático o hacia un “estado permanente” (steady state). Esta situación no implica un estado inmóvil de equilibrio. Existe un flujo continuo de energía desde el medio externo y una exportación continua de los “productos” del sistema hacia el medio. Aunque el sistema, en un estado permanente, a medida que pasa no es idéntico al organismo que fue, pero si, bastante similar, mantiene su mismo carácter. Este intercambio con el medio permite que el sistema pueda generar neguentropía y así obtener la energía necesaria para hacer funcionar los mecanismos homeostáticos correspondientes cuando los cambios del medio lo exigen, o los mecanismos de excepción cuando esos cambios superan el radio de acción de los mecanismos homeostáticos. Parece existir aquí una contradicción entre esta tendencia al caos, por una parte y un proceso de evolución que tiende a aumentar el grado de organización que poseen los sistemas abiertos, fenómeno que podemos denominar el “principio de la organicidad”. Sin embargo, esta contradicción es más aparente que real. Esta contradicción se soluciona a través de la neguentropía o entropía negativa. Debemos entenderla como la energía necesaria que requiere el principio de la organicidad para desarrollarse. En otras palabras, el principio de organicidad establece las condiciones necesarias para el orden. La Pagina 1-29

- 30. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde neguentropía es la fuerza necesaria para hacer operar este principio. Un sistema social que desee sobrevivir debe conscientemente crear dos tipos de energía a través de su mecanismo de importación del medio: la energía necesaria para el proceso de transformación o conversión, y la energía necesaria para mantener y mejorar su organización interna y sus relaciones con el medio dentro del cual se conduce. En conclusión el modelo de negociación LEAR en nuestra propuesta de sistemas de percepción operativa, estamos en el marco de los sistemas abiertos que como todo sistema, tiende a desorganizarse como efecto de las fuerzas entrópicas que los atacan. Sin embargo, poseen mecanismos potenciales que buscan su supervivencia. Ahora bien, la supervivencia de estos sistemas parece encontrarse en su capacidad de organización o de mantenerse organizados frente a los cambios y fuerzas negativas del medio. Esto es lo que podemos denominar el “principio de la organicidad”. Principio que operará en la medida que el sistema sea capaz de generar este exceso de energía que conocemos como neguentropía. La Negociación Modelo LEAR Sistemas de Percepción Operativa: sus proyecciones. Insisto que este modelo, proveerá al negociador la facultad de diagnosticar cuándo el sistema comenzó a sentir los efectos de la entropía y, por lo tanto, le resultará más fácil determinar de qué manera puede regenerarse (mediante la aplicación o estímulo de fuerzas contrarias o neguentropía) o bien, en caso de que esto no fuera posible, podrá construir un nuevo sistema viable que soporte a sus antiguos componentes. De esta forma, el negociador LEAR (Sistemas de Percepción Operativa) se transforma en una suerte de mecánico social, por cuanto puede arreglar o diseñar un nuevo motor para que el vehículo transporte a sus primitivos pasajeros. Las etapas que puede seguir un negociador para alcanzar el objetivo de describir y definir un sistema total son las siguientes: 1.- Los objetivos del sistema de percepción operativa total; 2.- El medio en que vive el sistema de percepción operativa; 3.- Los recursos del sistema de percepción operativa; 4.- Los componentes del sistema de percepción operativa; 5.- La dirección del sistema de percepción operativa. El cursante debe comprender que, en ningún caso, estos pasos deben, forzosamente, tomarse de acuerdo con la secuencia aquí presentada. Más bien, a medida que uno avanza en el análisis y descripción del sistema de percepción operativa, es probable que uno deba reexaminar el trabajo realizado en los pasos previos. Este es un proceso lógico y la lógica es esencialmente un proceso de controlar y recontrolar nuestros razonamientos. Bibliografía AHUMADA RECALDE LUIS EDUARDO – Negociación Creativa - junio 2005 Pagina 1-30

- 31. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde AHUMADA RECALDE LUIS EDUARDO – El Libro azul de la Negociación Julio 2007. Apuntes de Redes._ http://www.ignside.net/man/redes._junio, 2005 COMER, DOUGLAS E. Redes Globales de información con Internet y TCP/IP. Principios básicos, protocolos y arquitectura: T. I y II.-- La Habana: Ed. Pueblo y Educación, 2005._ 621p DELGADO UREÑA HÉCTOR._ http://nti.educa.rcanaria.es/conocernos_mejor GIRALT VICTORIANO. Las Redes._ http://vgg.sci.uma.es/redes._ marzo, 2004 Introducción a los Protocolos._ http://fmc.axarnet.es/redes/tema_06.htm._ enero, 2002 Redes de Computadoras: T. I.-- La Habana: Ed. Félix Varela, 2002. -- 242p WALES, JIMMY. Wikipedia._ http://es.wikipedia.org/wiki/Topología_de_red._mayo, 2001 YÁNEZ MENÉNDEZ, JOSÉ A. Redes comunicación y el laboratorio de informática/ M.C. José A. Yánez Menéndez, Lic. Alberto García Fumero._ La Habana: Ed. Pueblo y Educación, 2002._ 137p Glosario ARPANET Red pionera de gran alcance fundada por ARPA (Advanced Research Projects Agency) después DARPA. Sirvió de 1969 a 1990 como base para las primeras investigaciones de red durante el desarrollo de Internet. ARPANET consiste en nodos individuales conmutadores de paquetes interconectados por líneas arrendadas. Conmutación de paquetes Método que consiste en dividir toda la información que sale de un ordenador para ser trasmitida por la red en bloque de determinada longitud (Paquetes) que contienen la información relacionada con el origen y destino del paquete así como el orden que ocupa dentro de la división realizada. Esto permite que cada paquete se mueva de forma independiente en la red y al llegar a su destino puedan ser reensamblados para construir nuevamente la información enviada. Hardware (maquinaria) Componentes físicos de una computadora o de una red, a diferencia de los programas o elementos lógicos que los hacen funcionar. Hub (concentrador) Dispositivo electrónico al que se conectan varios ordenadores, por lo general mediante un cable de par trenzado. Un concentrador simula en la red que interconecta a los ordenadores conectados. Pagina 1-31

- 32. ESTRATEGIA LATENCIA CERO PARA LA PAZ Luis Eduardo Ahumada Recalde Internet Conjunto de redes y ruteadores que utiliza los protocolos TCP/IP para formar una sola red virtual cooperativa. Modems Equipo utilizado para adecuar las señales digitales de una computadora a una línea telefónica o a una red digital de servicios integrados, mediante procesos denominados modulación (para transmitir información) y demodulación (para recibir información). Protocolo Descripción formal de formatos de mensajes y reglas que dos o más ordenadores deben seguir para intercambiar mensajes. Los protocolos pueden describir detalles de bajo nivel de las interfaces de ordenador a ordenador o el intercambio entre programas de aplicación. Sistema Operativo Conjunto de programas o software destinado a permitir la comunicación del usuario con un ordenador y gestionar sus recursos de manera eficiente. Software Conjunto de programas, documentos, procesamientos y rutinas asociadas con la operación de un sistema de computadoras, es decir, la parte intangible o lógica de una computadora. Switch (interruptor o conmutador) Dispositivo de interconexión de redes de ordenadores. Un switch interconecta dos o más segmentos de red, pasando datos de una red a otra, de acuerdo con la dirección de destino de los datagramas en la red. Los switches se utilizan cuando se desea conectar múltiples redes, dado que funcionan como un filtro en la red, mejoran el rendimiento y la seguridad de las mismas. TCP/IP Protocolo que proporciona transmisión fiable de paquetes de datos sobre redes. El nombre TCP / IP proviene de dos protocolos importantes de la familia, el Transmission Control Protocol (TCP) y el Internet Protocol (IP). Todos juntos llegan a ser más de 100 protocolos diferentes. Pagina 1-32