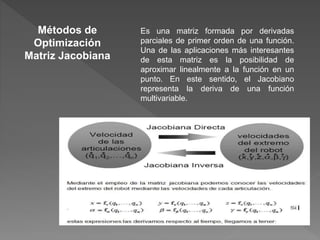

El documento trata sobre conceptos básicos de optimización. Explica que la optimización busca encontrar la mejor solución entre alternativas sin tener que evaluar todas explícitamente. Luego describe tres componentes necesarios para formular un problema de optimización: un modelo matemático, variables que pueden controlarse, y una función objetivo que representa el objetivo. Finalmente, resume algunos métodos para resolver problemas de optimización como el método de Lagrange y el método de Kuhn Tucker.