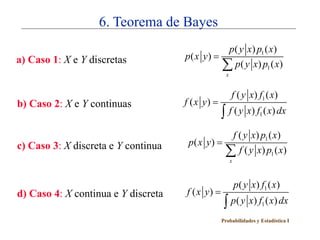

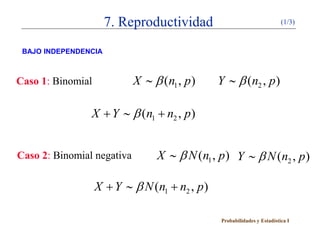

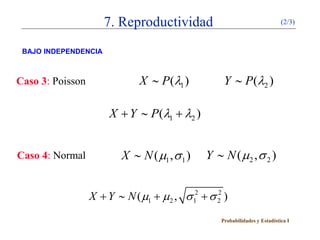

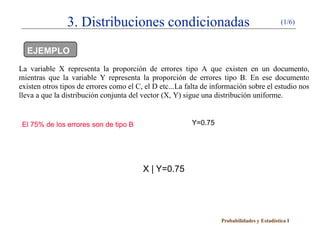

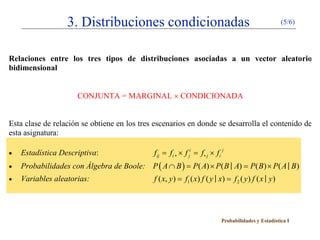

Este documento presenta un esquema inicial sobre distribuciones de probabilidad bidimensionales que incluye: 1) distribuciones conjuntas y marginales, 2) distribuciones condicionadas, 3) independencia, 4) momentos, 5) teorema de Bayes y 6) reproductividad bajo independencia.

![4. V. aleatorias independientes (2/2)

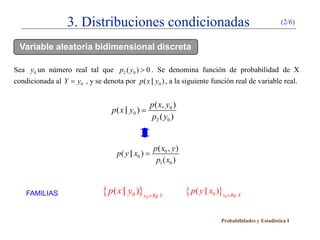

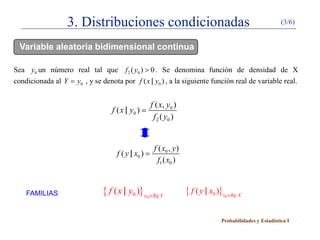

P [ a ≤ X ≤ b, c ≤ Y ≤ d ] P [ a ≤ X ≤ b ] × P [ c ≤ Y ≤ d ]

=

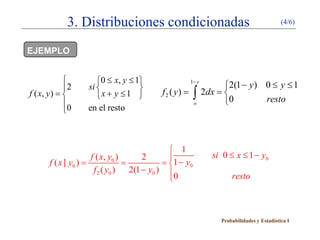

EJEMPLO

4 xy si 0 ≤ x, y ≤ 1

f ( x, y ) =

0 resto

2 x si 0 ≤ x ≤ 1 2 y si 0 ≤ y ≤ 1

f1 ( x) = f2 ( y) =

0 resto 0 resto

Probabilidades y Estadística I](https://image.slidesharecdn.com/tema8b-ud3-120409050749-phpapp02/85/Tema8b-ud3-10-320.jpg)

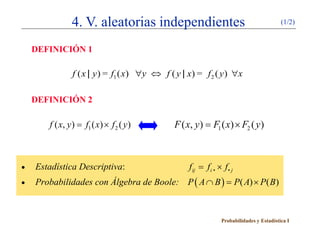

![5. Momentos (1/3)

Caso discreto E [ g ( x, y ) ] = ∑∑ g ( x, y ) p ( x, y )

x y

+∞ +∞

Caso continuo E [ g ( x, y ) ] = ∫ ∫ g ( x, y) f ( x, y) dx dy

−∞ −∞

Momentos centrados en el origen α k , l = E[ x k y l ]

Momentos centrados en la media µ k ,l =

E ( x − α ) k ( y − α )l

0, 1

1, 0

Probabilidades y Estadística I](https://image.slidesharecdn.com/tema8b-ud3-120409050749-phpapp02/85/Tema8b-ud3-12-320.jpg)

![5. Momentos (2/3)

Momentos destacados

= E[ X ] µ X

α1,0 = = E[Y ] µY

α 0,1 =

= Var [ X ] σ X

µ2, 0 = 2 = Var [Y ] σ Y

µ0, 2 = 2

cov( X , Y )

µ1,1 = Cov( X , Y ) ρ=

σ Xσ y

Probabilidades y Estadística I](https://image.slidesharecdn.com/tema8b-ud3-120409050749-phpapp02/85/Tema8b-ud3-13-320.jpg)

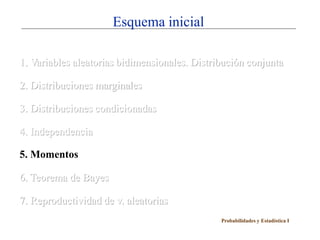

![5. Momentos (3/3)

Propiedades

a) E [ aX + bY= aE [ X ] + bE [Y ]

]

b) Var (aX + = a 2Var ( X ) + b 2Var (Y ) + 2ab cov( X , Y )

bY )

c) cov( X , Y ) E [ XY ] − E [ X ] E [Y ]

=

BAJO INDEPENDENCIA

d) E [ XY ] = E [ X ] E [Y ]

cov( X , Y ) = 0 Var (aX + = a 2Var ( X ) + b 2Var (Y )

bY )

Probabilidades y Estadística I](https://image.slidesharecdn.com/tema8b-ud3-120409050749-phpapp02/85/Tema8b-ud3-14-320.jpg)